A subscription to JoVE is required to view this content. Sign in or start your free trial.

Method Article

اختبار روبوتي لمواقع الكاميرا لتحديد التكوين المثالي لتصور ستيريو 3D لجراحة القلب المفتوح

In This Article

Summary

يعتمد إدراك العمق البشري لمقاطع فيديو ستيريو 3D على فصل الكاميرا ونقطة التقارب والمسافة إلى الكائن ومعرفته. تقدم هذه الورقة طريقة روبوتية لجمع بيانات الاختبار السريع والموثوق به أثناء جراحة القلب المفتوح الحية لتحديد التكوين المثالي للكاميرا.

Abstract

يمكن أن يكون فيديو ستيريو 3D من العمليات الجراحية ذا قيمة عالية للتعليم الطبي وتحسين التواصل السريري. لكن الوصول إلى غرفة العمليات والمجال الجراحي مقيد. إنها بيئة معقمة ، والمساحة المادية مزدحمة بالموظفين الجراحيين والمعدات التقنية. في هذا السياق ، من الصعب التقاط الإجراءات الجراحية دون حجبها واستنساخها واقعيا. تقدم هذه الورقة طريقة لجمع البيانات بسرعة وموثوقية لمقاطع الفيديو المجسمة 3D على مسافات خط أساس الكاميرا المختلفة ومسافات التقارب. لجمع بيانات الاختبار بأقل قدر من التداخل أثناء الجراحة ، بدقة عالية وقابلية للتكرار ، تم توصيل الكاميرات بكل يد من الروبوت ثنائي الذراع. كان الروبوت مثبتا في السقف في غرفة العمليات. تمت برمجته لأداء تسلسل زمني لحركات الكاميرا المتزامنة التي تخطو عبر مجموعة من مواضع الاختبار مع مسافة خط الأساس بين 50-240 مم عند خطوات تدريجية تبلغ 10 مم ، وعلى مسافة تقارب 1100 مم و 1400 مم. تم إيقاف الجراحة مؤقتا للسماح ب 40 عينة فيديو متتالية من 5 ثوان. تم تسجيل ما مجموعه 10 سيناريوهات جراحية.

Introduction

في الجراحة ، يمكن استخدام التصور ثلاثي الأبعاد للتعليم والتشخيص والتخطيط قبل الجراحة وتقييم ما بعد الجراحة1,2. يمكن أن يحسن إدراك العمق الواقعي فهم3،4،5،6 من التشريح الطبيعي وغير الطبيعي. تسجيلات الفيديو 2D بسيطة من العمليات الجراحية هي بداية جيدة. ومع ذلك ، فإن عدم وجود إدراك للعمق يمكن أن يجعل من الصعب على الزملاء غير الجراحيين أن يفهموا تماما العلاقات الأمامية الخلفية بين الهياكل التشريحية المختلفة ، وبالتالي يقدمون أيضا خطر سوء تفسير التشريح7،8،9،10.

تتأثر تجربة المشاهدة ثلاثية الأبعاد بخمسة عوامل: (1) يمكن أن يكون تكوين الكاميرا إما متوازيا أو ملتصقا كما هو موضح في الشكل 1 ، (2) المسافة الأساسية (الفصل بين الكاميرات). (3) المسافة إلى موضوع الاهتمام وخصائص المشهد الأخرى مثل الخلفية. (4) خصائص أجهزة العرض مثل حجم الشاشة وموضع العرض1،11،12،13. (5) التفضيلات الفردية للمشاهدين14،15.

يبدأ تصميم إعداد كاميرا ثلاثية الأبعاد بالتقاط مقاطع فيديو تجريبية مسجلة على مسافات وتكوينات أساسية مختلفة للكاميرا لاستخدامها في التقييم الذاتي أو التلقائي16،17،18،19،20. يجب أن تكون مسافة الكاميرا ثابتة إلى المجال الجراحي لالتقاط صور حادة. يفضل التركيز البؤري الثابت لأن التركيز البؤري التلقائي سيتكيف للتركيز على اليدين أو الأدوات أو الرؤوس التي قد تظهر للعيان. ومع ذلك ، لا يمكن تحقيق ذلك بسهولة عندما يكون المشهد المثير للاهتمام هو المجال الجراحي. غرف العمليات هي مناطق مقيدة الوصول لأن هذه المرافق يجب أن تبقى نظيفة ومعقمة. غالبا ما يتم تجميع المعدات التقنية والجراحين وممرضات الفرك بشكل وثيق حول المريض لتأمين نظرة عامة بصرية جيدة وسير عمل فعال. لمقارنة وتقييم تأثير مواضع الكاميرا على تجربة المشاهدة ثلاثية الأبعاد، يجب أن يكون نطاق اختبار كامل لمواضع الكاميرا هو تسجيل نفس المشهد لأن خصائص الكائن مثل الشكل والحجم واللون يمكن أن تؤثر على تجربة المشاهدة ثلاثية الأبعاد21.

للسبب نفسه ، يجب تكرار نطاقات الاختبار الكاملة لمواضع الكاميرا في العمليات الجراحية المختلفة. يجب تكرار التسلسل الكامل للمواقف بدقة عالية. في الإعداد الجراحي، الطرق الحالية التي تتطلب إما تعديلا يدويا لمسافة خط الأساس22 أو أزواج كاميرات مختلفة ذات مسافات خط أساس ثابتة23 غير مجدية بسبب قيود المكان والزمان على حد سواء. لمواجهة هذا التحدي ، تم تصميم هذا الحل الآلي.

تم جمع البيانات باستخدام روبوت صناعي تعاوني ثنائي الذراع مثبت في السقف في غرفة العمليات. تم توصيل الكاميرات بمعصمي الروبوت وتحركت على طول مسار على شكل قوس مع زيادة مسافة خط الأساس ، كما هو موضح في الشكل 2.

لإثبات هذا النهج ، تم تسجيل 10 سلسلة اختبارات من 4 مرضى مختلفين يعانون من 4 عيوب خلقية مختلفة في القلب. تم اختيار المشاهد عندما كان التوقف مؤقتا في الجراحة ممكنا: مع القلوب النابضة قبل وبعد الإصلاح الجراحي مباشرة. كما تم إنتاج المسلسلات عندما تم القبض على القلوب. تم إيقاف العمليات الجراحية مؤقتا لمدة 3 دقائق و 20 ثانية لجمع أربعين سلسلة من 5 تسلسلات مع مسافات تقارب الكاميرا المختلفة ومسافات خط الأساس لالتقاط المشهد. تمت معالجة مقاطع الفيديو لاحقا بعد معالجتها ، وتم عرضها في 3D للفريق السريري ، الذي قيم مدى واقعية الفيديو ثلاثي الأبعاد على طول مقياس من 0-5.

نقطة التقاء كاميرات الاستريو ذات الأصابع هي المكان الذي تلتقي فيه النقاط المركزية لكلتا الصورتين. يمكن وضع نقطة التقارب ، من حيث المبدأ ، إما أمام الجسم أو داخله أو خلفه ، انظر الشكل 1A-C. عندما تكون نقطة التقارب أمام الكائن، سيتم التقاط الكائن وعرضه على يسار خط الوسط لصورة الكاميرا اليسرى ويمين خط الوسط لصورة الكاميرا اليمنى (الشكل 1A). وينطبق العكس عندما تكون نقطة التقارب خلف الكائن (الشكل 1B). عندما تكون نقطة التقارب على الكائن ، سيظهر الكائن أيضا في خط الوسط لصور الكاميرا (الشكل 1C) ، والذي يفترض أن ينتج عنه العرض الأكثر راحة نظرا لعدم الحاجة إلى التحديق لدمج الصور. لتحقيق فيديو ستيريو 3D مريح ، يجب أن تكون نقطة التقارب موجودة على ، أو خلف قليلا ، موضوع الاهتمام ، وإلا يطلب من المشاهد الحول طواعية إلى الخارج (exotropia).

تم جمع البيانات باستخدام روبوت صناعي تعاوني ثنائي الذراع لوضع الكاميرات (الشكل 2A-B). يزن الروبوت 38 كجم بدون معدات. الروبوت آمن في جوهره. عندما يكتشف تأثيرا غير متوقع ، فإنه يتوقف عن الحركة. تمت برمجة الروبوت لوضع الكاميرات بدقة 5 ميجابكسل مع عدسات C-mount على طول مسار على شكل قوس يتوقف عند مسافات خط الأساس المحددة مسبقا (الشكل 2C). تم توصيل الكاميرات بأيدي الروبوت باستخدام لوحات محول ، كما هو موضح في الشكل 3. تم تسجيل كل كاميرا بمعدل 25 إطارا في الثانية. تم ضبط العدسات على f-stop 1/8 مع التركيز الثابت على الكائن محل الاهتمام (المركز الهندسي التقريبي للقلب). يحتوي كل إطار صورة على طابع زمني تم استخدامه لمزامنة دفقي الفيديو.

تمت معايرة الإزاحات بين معصم الروبوت والكاميرا. يمكن تحقيق ذلك عن طريق محاذاة الشعيرات المتقاطعة لصور الكاميرا ، كما هو موضح في الشكل 4. في هذا الإعداد، كان إجمالي الإزاحة الانتقالية من نقطة التركيب على معصم الروبوت ومركز مستشعر صورة الكاميرا 55.3 مم في الاتجاه X و 21.2 مم في الاتجاه Z، المعروض في الشكل 5. تمت معايرة الإزاحات الدورانية على مسافة تقارب 1100 مم ومسافة خط أساس 50 مم وتم تعديلها يدويا باستخدام عصا التحكم الموجودة على لوحة تحكم الروبوت. كان للروبوت في هذه الدراسة دقة محددة تبلغ 0.02 مم في الفضاء الديكارتي ودقة دورانية تبلغ 0.01 درجة24. عند نصف قطر 1100 م ، يعوض فرق الزاوية البالغ 0.01 درجة نقطة المركز 0.2 مم. أثناء الحركة الكاملة للروبوت من فصل 50-240 مم ، كان التقاطع لكل كاميرا على بعد 2 مم من مركز التقارب المثالي.

وزادت المسافة الأساسية تدريجيا عن طريق الفصل المتماثل للكاميرات حول مركز مجال الرؤية بزيادات قدرها 10 ملم تتراوح بين 50-240 ملم (الشكل 2). تم الاحتفاظ بالكاميرات في حالة توقف تام لمدة 5 ثوان في كل موضع وتحركت بين المواضع بسرعة 50 مم / ثانية. ويمكن ضبط نقطة التقارب في الاتجاهين X وZ باستخدام واجهة مستخدم رسومية (الشكل 6). اتبع الروبوت وفقا لذلك ضمن نطاق عمله.

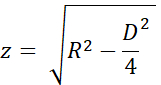

وقدرت دقة نقطة التقارب باستخدام المثلثات الموحدة وأسماء المتغيرات الواردة في الشكلين 7 ألف وباء. تم حساب الارتفاع "z" من مسافة التقارب "R" مع نظرية فيثاغورس على النحو التالي:

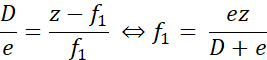

عندما تكون نقطة التقارب الحقيقية أقرب من النقطة المطلوبة، كما هو موضح في الشكل 7A، يتم حساب مسافة الخطأ "f1" على النحو التالي:

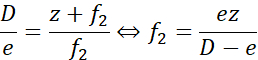

وبالمثل ، عندما كانت نقطة التقارب بعيدة عن النقطة المطلوبة ، تم حساب مسافة الخطأ "f2" على النحو التالي:

هنا ، كان "e" هو الحد الأقصى للفصل بين الشعيرات المتقاطعة ، على الأكثر 2 مم عند أقصى فصل خط الأساس أثناء المعايرة (D = 240 مم). بالنسبة إلى R = 1100 مم (z = 1093 مم)، كان الخطأ أقل من ± 9.2 مم. بالنسبة إلى R = 1400 مم (z = 1395 مم) ، كان الخطأ ± 11.7 مم. أي أن خطأ وضع نقطة التقارب كان في حدود 1٪ من المطلوب. وبالتالي تم فصل مسافتي الاختبار 1100 مم و 1400 مم بشكل جيد.

Access restricted. Please log in or start a trial to view this content.

Protocol

تمت الموافقة على التجارب من قبل لجنة الأخلاقيات المحلية في لوند ، السويد. وكانت المشاركة طوعية، وقدم الأوصياء القانونيون على المرضى موافقة خطية مستنيرة.

1. إعداد الروبوت وتكوينه

ملاحظة: استخدمت هذه التجربة روبوتا صناعيا تعاونيا ثنائي الذراع ولوحة تحكم قياسية مع شاشة تعمل باللمس. يتم التحكم في الروبوت باستخدام برنامج تحكم RobotWare 6.10.01 وبيئة تطوير الروبوت المتكاملة (IDE) RobotStudio 2019.525. تتوفر البرامج التي طورها المؤلفون ، بما في ذلك تطبيق الروبوت وتطبيق التسجيل والبرامج النصية لما بعد المعالجة ، في مستودع GitHub26.

تنبيه: استخدم النظارات الواقية وخفض السرعة أثناء إعداد واختبار برنامج الروبوت.

- قم بتركيب الروبوت على السقف أو الطاولة باستخدام مسامير ذات أبعاد 100 كجم كما هو موضح في الصفحة 25 في مواصفات المنتج24 ، وفقا لمواصفات الشركة المصنعة. تأكد من أن الذراعين يمكن أن تتحرك بحرية وأن خط البصر إلى مجال الرؤية غير محجوب.

تنبيه: استخدم حبال الرفع أو الأمان عند تركيب الروبوت في وضع مرتفع. - ابدأ تشغيل الروبوت عن طريق تشغيل مفتاح البدء الموجود في قاعدة الروبوت. معايرة الروبوت باتباع الإجراء الموضح في دليل التشغيل في الصفحات 47-5625.

- بدء تشغيل الروبوت IDE على جهاز كمبيوتر يعمل بنظام Windows.

- اتصل بنظام الروبوت الفعلي (دليل التشغيل صفحة 14027).

- قم بتحميل التعليمات البرمجية لبرنامج الروبوت ومكتبات التطبيقات لواجهة المستخدم إلى الروبوت:

- يوجد رمز الروبوت للروبوت المثبت على السقف في المجلد Robot / InvertedCode وللروبوت المثبت على الطاولة في Robot / TableMountedCode. لكل ملف من الملفات اليسرى / Data.mod ، اليسار / MainModule.mod ، اليمين / Data.mod واليمين / MainModule.mod:

- إنشاء وحدة نمطية جديدة للبرنامج (راجع صفحة دليل التشغيل 31827) بنفس اسم الملف (البيانات أو الوحدة الرئيسية) ونسخ محتوى الملف إلى الوحدة النمطية الجديدة.

- اضغط على تطبيق في الروبوت IDE لحفظ الملفات إلى الروبوت.

- استخدم "نقل الملفات" (صفحة دليل التشغيل 34627) لنقل ملفات تطبيق الروبوت TpSViewStereo2.dll و TpsViewStereo2.gtpu.dll و TpsViewStereo2.pdb الموجودة في مجلد FPApp إلى الروبوت. بعد هذه الخطوة ، لن يتم استخدام الروبوت IDE بشكل أكبر.

- اضغط على زر إعادة الضبط الموجود في الجزء الخلفي من شاشة اللمس الروبوتية (FlexPendant) لإعادة تحميل الواجهة الرسومية. سيكون تطبيق الروبوت Stereo2 مرئيا الآن ضمن قائمة العرض باللمس.

- قم بتثبيت تطبيق التسجيل (Liveview) وتطبيق المعالجة اللاحقة على جهاز كمبيوتر Ubuntu 20.04 عن طريق تشغيل البرنامج النصي install_all_linux.sh ، الموجود في المجلد الجذر في مستودع Github.

- قم بتركيب كل كاميرا على الروبوت. يتم عرض المكونات اللازمة للتركيب في الشكل 3A.

- قم بتركيب العدسة على الكاميرا.

- قم بتركيب الكاميرا على لوحة محول الكاميرا بثلاثة مسامير M2.

- قم بتركيب لوحة التركيب الدائرية على لوحة محول الكاميرا بأربعة مسامير M6 على الجانب الآخر من الكاميرا.

- كرر الخطوات من 1.9.1 إلى 1.9.3 للكاميرا الأخرى. وتنعكس التجميعات الناتجة، كما هو مبين في الشكل 3 باء والشكل 3 جيم.

- قم بتركيب لوحة المحول على معصم الروبوت بأربعة مسامير M2.5 ، كما هو موضح في الشكل 3D.

- بالنسبة للروبوت المثبت في السقف: قم بتوصيل الكاميرا اليسرى في الشكل 3C بذراع الروبوت الأيسر كما هو موضح في الشكل 2A.

- بالنسبة للروبوت المثبت على الطاولة: قم بتوصيل الكاميرا اليسرى في الشكل 3C بذراع الروبوت الأيمن.

- قم بتوصيل كبلات USB بالكاميرات ، كما هو موضح في الشكل 3E ، وبالكمبيوتر Ubuntu.

2. تحقق من معايرة الكاميرا

- على شاشة الروبوت التي تعمل باللمس، اضغط على زر القائمة وحدد Stereo2 لبدء تشغيل تطبيق الروبوت. سيؤدي ذلك إلى فتح الشاشة الرئيسية ، كما هو موضح في الشكل 6A.

- على الشاشة الرئيسية ، اضغط على Go للبدء لمدة 1100 مم في تطبيق الروبوت وانتظر حتى ينتقل الروبوت إلى وضع البدء.

- قم بإزالة أغطية العدسات الواقية من الكاميرات وقم بتوصيل كبلات USB بكمبيوتر Ubuntu.

- ضع شبكة معايرة مطبوعة (CalibrationGrid.png في المستودع) بحجم 1100 مم من مستشعرات الكاميرا. لتسهيل التحديد الصحيح للمربعات المقابلة ، ضع صمولة لولبية صغيرة أو علامة في مكان ما في وسط الشبكة.

- ابدأ تشغيل تطبيق التسجيل على كمبيوتر Ubuntu (قم بتشغيل البرنامج النصي start.sh الموجود في مجلد liveview داخل مستودع Github). يؤدي ذلك إلى بدء تشغيل الواجهة ، كما هو موضح في الشكل 4.

- اضبط فتحة العدسة وركز على العدسة باستخدام حلقات الفتحة والتركيز البؤري.

- في تطبيق التسجيل ، تحقق من Crosshair لتصور الشعيرات المتقاطعة.

- في تطبيق التسجيل، تأكد من محاذاة الشعيرات المتقاطعة مع شبكة المعايرة في نفس الموضع في كلتا صورتي الكاميرا، كما هو موضح في الشكل 4. على الأرجح ، ستكون هناك حاجة إلى بعض التعديل على النحو التالي:

- إذا لم تتداخل الصلبان ، فاضغط على أيقونة Gear (أسفل اليسار الشكل 6A) في تطبيق الروبوت على شاشة اللمس الروبوتية لفتح شاشة الإعداد ، كما هو موضح في الشكل 6B.

- اضغط على 1. انتقل إلى بدء نقاط البيع ، كما هو موضح في الشكل 6B.

- اركض الروبوت باستخدام عصا التحكم لضبط موضع الكاميرا (دليل التشغيل صفحة 3123).

- قم بتحديث موضع الأداة لكل ذراع روبوت. اضغط 3. تحديث الأداة اليسرى و 4. قم بتحديث الأداة اليمنى لحفظ المعايرة للذراع اليسرى واليمنى، على التوالي.

- اضغط على أيقونة السهم للخلف (أعلى اليمين، الشكل 6B) للعودة إلى الشاشة الرئيسية.

- اضغط على Run Experiment (الشكل 6A) في تطبيق الروبوت وتحقق من محاذاة الشعيرات المتقاطعة. وإلا، كرر الخطوات من 2.3 إلى 2.3.5.

- أضف واختبر أي تغييرات على المسافات و / أو الوقت في هذه المرحلة. وهذا يتطلب تغييرات في رمز برنامج الروبوت ومهارات برمجة الروبوت المتقدمة. تغيير المتغيرات التالية في وحدة البيانات في المهمة اليسرى (الذراع): مسافات الفصل المطلوبة في متغير الصفيف الصحيح المسافات، مسافات التقارب في الصفيف الصحيح ConvergencePos وتحرير الوقت في كل خطوة عن طريق تحرير المتغير Nwaittime (القيمة بالثواني).

تنبيه: لا تقم أبدا بتشغيل برنامج روبوت لم يتم اختباره أثناء الجراحة الحية. - عند اكتمال المعايرة، اضغط على Raise لرفع أذرع الروبوت إلى وضع الاستعداد.

- قم بإيقاف تشغيل الروبوت اختياريا.

ملاحظة: يمكن إيقاف الإجراء مؤقتا بين أي من الخطوات المذكورة أعلاه.

3. التحضير في بداية الجراحة

- غبار الروبوت.

- إذا تم إيقاف تشغيل الروبوت ، فابدأ تشغيله بتشغيل مفتاح البدء الموجود في قاعدة الروبوت.

- ابدأ تشغيل تطبيق الروبوت على تطبيق العرض باللمس والتسجيل الموضح في الخطوتين 2.1 و 2.2.

- في تطبيق التسجيل، قم بإنشاء المجلد الذي تريد حفظ الفيديو فيه ثم حدده (اضغط على تغيير المجلد).

- في تطبيق الروبوت: اضغط على رمز الترس ، ضع الكاميرات فيما يتعلق بالمريض. قم بتغيير اتجاه X و Z عن طريق الضغط على +/- لمسافة اليد من الروبوت والارتفاع ، على التوالي ، بحيث تلتقط الصورة المجال الجراحي. قم بإجراء تحديد المواقع في الاتجاه Y عن طريق تحريك الروبوت أو المريض يدويا.

ملاحظة: يمكن إيقاف التحضيرات مؤقتا بين خطوات التحضير 3.1-3.4.

4. التجربة

تنبيه: يجب إبلاغ جميع الموظفين بالتجربة مسبقا.

- أوقف الجراحة مؤقتا.

- أبلغ موظفي غرفة العمليات بأن التجربة قد بدأت.

- اضغط على تسجيل في تطبيق التسجيل.

- اضغط على تشغيل التجربة في تطبيق الروبوت.

- انتظر أثناء تشغيل البرنامج ؛ يعرض الروبوت "تم" في تطبيق الروبوت على شاشة اللمس عند الانتهاء.

- إيقاف التسجيل في تطبيق التسجيل بالضغط على إنهاء.

- أبلغ موظفي غرفة العمليات بأن التجربة قد انتهت.

- استئناف الجراحة.

ملاحظة: لا يمكن إيقاف التجربة مؤقتا أثناء الخطوات من 4.1 إلى 4.6.

5. كرر

- كرر الخطوات من 4.1 إلى 4.6 لالتقاط تسلسل آخر والخطوات من 3.1 إلى 3.4 والخطوات من 4.1 إلى 4.6 لالتقاط تسلسلات من عمليات جراحية مختلفة. التقط حوالي عشرة تسلسلات كاملة.

6. المعالجة اللاحقة

ملاحظة: يمكن تنفيذ الخطوات التالية باستخدام معظم برامج تحرير الفيديو أو البرامج النصية المتوفرة في مجلد المعالجة اللاحقة.

- في هذه الحالة ، debayer الفيديو كما يتم حفظه بتنسيق RAW:

- قم بتشغيل البرنامج النصي postprocessing/debayer/run.sh لفتح تطبيق debayer الموضح في الشكل 8A.

- اضغط على استعراض دليل الإدخال وحدد المجلد الذي يحتوي على فيديو RAW.

- اضغط على استعراض دليل الإخراج وحدد مجلدا لملفات الفيديو الناتجة التي تم حذفها وتعديلها بالألوان.

- اضغط على ديباير! وانتظر حتى تنتهي العملية - كلا شريطي التقدم ممتلئان ، كما هو موضح في الشكل 8B.

- دمج مقاطع الفيديو المتزامنة اليمنى واليسرى بتنسيق ستيريو 3D28:

- قم بتشغيل المعالجة اللاحقة للبرنامج النصي / merge_tb / run .sh لبدء تشغيل تطبيق الدمج ؛ يفتح واجهة المستخدم الرسومية الموضحة في الشكل 8C.

- اضغط على استعراض دليل الإدخال وحدد المجلد الذي يحتوي على ملفات الفيديو debayered.

- اضغط على استعراض دليل الإخراج وحدد مجلدا لملف ستيريو 3D المدمج الناتج.

- اضغط على دمج! وانتظر حتى تظهر شاشة النهاية في الشكل 8D .

- استخدم برامج تحرير الفيديو الجاهزة مثل Premiere Pro لإضافة تسميات نصية إلى كل مسافة كاميرا في الفيديو.

ملاحظة: في الفيديو ، هناك اهتزاز مرئي في كل مرة يتحرك فيها الروبوت ، وزادت مسافة الكاميرا. في هذه التجربة ، تم استخدام التسميات A-T لمسافات الكاميرا.

7. التقييم

- عرض الفيديو بتنسيق 3D من أعلى إلى أسفل باستخدام جهاز عرض 3D نشط.

- تعتمد تجربة المشاهدة على زاوية المشاهدة والمسافة إلى الشاشة. تقييم الفيديو باستخدام الجمهور المستهدف والإعداد.

Access restricted. Please log in or start a trial to view this content.

النتائج

يتم عرض فيديو تقييم مقبول مع وضع الصورة الصحيحة في الأعلى في 3D مجسمة من أعلى إلى أسفل في Video1. يجب أن يكون التسلسل الناجح حادا ومركزا وبدون إطارات صور غير متزامنة. ستؤدي تدفقات الفيديو غير المتزامنة إلى حدوث ضبابية، كما هو موضح في ملف الفيديو 2. يجب أن تكون نقطة التقارب متمر...

Access restricted. Please log in or start a trial to view this content.

Discussion

أثناء الجراحة الحية ، كان الوقت الإجمالي للتجربة المستخدمة لجمع بيانات الفيديو 3D محدودا ليكون آمنا للمريض. إذا كان الكائن غير مركز أو مفرط التعرض، فلا يمكن استخدام البيانات. تتمثل الخطوات الحاسمة أثناء معايرة أداة الكاميرا وإعدادها (الخطوة 2). لا يمكن تغيير فتحة الكاميرا والتركيز البؤري ع...

Access restricted. Please log in or start a trial to view this content.

Disclosures

وليس لدى صاحبي البلاغ ما يكشفان عنه.

Acknowledgements

تم إجراء البحث بتمويل من Vinnova (2017-03728 و 2018-05302 و 2018-03651) ومؤسسة القلب والرئة (20180390) ومؤسسة Family Kamprad Foundation (20190194) ومؤسسة Anna-Lisa و Sven Eric Lundgren Foundation (2017 و 2018).

Access restricted. Please log in or start a trial to view this content.

Materials

| Name | Company | Catalog Number | Comments |

| 2 C-mount lenses (35 mm F2.1, 5 M pixel) | Tamron | M112FM35 | Rated for 5 Mpixel |

| 3D glasses (DLP-link active shutter) | Celexon | G1000 | Any compatible 3D glasses can be used |

| 3D Projector | Viewsonic | X10-4K | Displays 3D in 1080, can be exchanged for other 3D projectors |

| 6 M2 x 8 screws | To attach the cXimea cameras to the camera adaptor plates | ||

| 8 M2.5 x 8 screws | To attach the circular mounting plates to the robot wrist | ||

| 8 M5 x 40 screws | To mount the robot | ||

| 8 M6 x 10 screws with flat heads | For attaching the circular mounting plate and the camera adaptor plates | ||

| Calibration checker board plate (25 by 25 mm) | Any standard checkerboard can be used, including printed, as long as the grid is clearly visible in the cameras | ||

| Camera adaptor plates, x2 | Designed by the authors in robot_camera_adaptor_plates.dwg, milled in aluminium. | ||

| Circular mounting plates, x2 | Distributed with the permission of the designer Julius Klein and printed with ABS plastic on an FDM 3D printer. License Tecnalia Research & Innovation 2017. Attached as Mountingplate_ROBOT_SIDE_ NewDesign_4.stl | ||

| Fix focus usb cameras, x2 (5 Mpixel) | Ximea | MC050CG-SY-UB | With Sony IMX250LQR sensor |

| Flexpendant | ABB | 3HAC028357-001 | robot touch display |

| Liveview | recording application | ||

| RobotStudio | robot integrated development environment (IDE) | ||

| USB3 active cables (10.0 m), x2 | Thumbscrew lock connector, water proofed. | ||

| YuMi dual-arm robot | ABB | IRB14000 |

References

- Held, R. T., Hui, T. T. A guide to stereoscopic 3D displays in medicine. Academic Radiology. 18 (8), 1035-1048 (2011).

- van Beurden, M. H. P. H., IJsselsteijn, W. A., Juola, J. F. Effectiveness of stereoscopic displays in medicine: A review. 3D Research. 3 (1), 1-13 (2012).

- Luursema, J. M., Verwey, W. B., Kommers, P. A. M., Geelkerken, R. H., Vos, H. J. Optimizing conditions for computer-assisted anatomical learning. Interacting with Computers. 18 (5), 1123-1138 (2006).

- Takano, M., et al. Usefulness and capability of three-dimensional, full high-definition movies for surgical education. Maxillofacial Plastic and Reconstructive Surgery. 39 (1), 10(2017).

- Triepels, C. P. R., et al. Does three-dimensional anatomy improve student understanding. Clinical Anatomy. 33 (1), 25-33 (2020).

- Beermann, J., et al. Three-dimensional visualisation improves understanding of surgical liver anatomy. Medical Education. 44 (9), 936-940 (2010).

- Battulga, B., Konishi, T., Tamura, Y., Moriguchi, H. The Effectiveness of an interactive 3-dimensional computer graphics model for medical education. Interactive Journal of Medical Research. 1 (2), (2012).

- Yammine, K., Violato, C. A meta-analysis of the educational effectiveness of three-dimensional visualization technologies in teaching anatomy. Anatomical Sciences Education. 8 (6), 525-538 (2015).

- Fitzgerald, J. E. F., White, M. J., Tang, S. W., Maxwell-Armstrong, C. A., James, D. K. Are we teaching sufficient anatomy at medical school? The opinions of newly qualified doctors. Clinical Anatomy. 21 (7), 718-724 (2008).

- Bergman, E. M., Van Der Vleuten, C. P. M., Scherpbier, A. J. J. A. Why don't they know enough about anatomy? A narrative review. Medical Teacher. 33 (5), 403-409 (2011).

- Terzić, K., Hansard, M. Methods for reducing visual discomfort in stereoscopic 3D: A review. Signal Processing: Image Communication. 47, 402-416 (2016).

- Fan, Z., Weng, Y., Chen, G., Liao, H. 3D interactive surgical visualization system using mobile spatial information acquisition and autostereoscopic display. Journal of Biomedical Informatics. 71, 154-164 (2017).

- Fan, Z., Zhang, S., Weng, Y., Chen, G., Liao, H. 3D quantitative evaluation system for autostereoscopic display. Journal of Display Technology. 12 (10), 1185-1196 (2016).

- McIntire, J. P., et al. Binocular fusion ranges and stereoacuity predict positional and rotational spatial task performance on a stereoscopic 3D display. Journal of Display Technology. 11 (11), 959-966 (2015).

- Kalia, M., Navab, N., Fels, S. S., Salcudean, T. A method to introduce & evaluate motion parallax with stereo for medical AR/MR. IEEE Conference on Virtual Reality and 3D User Interfaces. , 1755-1759 (2019).

- Kytö, M., Hakala, J., Oittinen, P., Häkkinen, J. Effect of camera separation on the viewing experience of stereoscopic photographs. Journal of Electronic Imaging. 21 (1), 1-9 (2012).

- Moorthy, A. K., Su, C. C., Mittal, A., Bovik, A. C. Subjective evaluation of stereoscopic image quality. Signal Processing: Image Communication. 28 (8), 870-883 (2013).

- Yilmaz, G. N. A depth perception evaluation metric for immersive 3D video services. 3DTV Conference: The True Vision - Capture, Transmission and Display of 3D Video. , 1-4 (2017).

- Lebreton, P., Raake, A., Barkowsky, M., Le Callet, P. Evaluating depth perception of 3D stereoscopic videos. IEEE Journal on Selected Topics in Signal Processing. 6, 710-720 (2012).

- López, J. P., Rodrigo, J. A., Jiménez, D., Menéndez, J. M. Stereoscopic 3D video quality assessment based on depth maps and video motion. EURASIP Journal on Image and Video Processing. 2013 (1), 62(2013).

- Banks, M. S., Read, J. C., Allison, R. S., Watt, S. J. Stereoscopy and the human visual system. SMPTE Motion Imaging Journal. 121 (4), 24-43 (2012).

- Kytö, M., Nuutinen, M., Oittinen, P. Method for measuring stereo camera depth accuracy based on stereoscopic vision. Three-Dimensional Imaging, Interaction, and Measurement. 7864, 168-176 (2011).

- Kang, Y. S., Ho, Y. S. Geometrical compensation algorithm of multiview image for arc multi-camera arrays. Advances in Multimedia Information Processing. 2008, 543-552 (2008).

- Product Specification IRB 14000. DocumentID: 3HAC052982-001 Revision J. ABB Robotics. , Available from: https://library.abb.com/en/results (2018).

- Operating Manual IRB 14000. Document ID: 3HAC052986-001 Revision F. ABB Robotics. , Available from: https://library.abb.com/en/results (2019).

- Github repository. , Available from: https://github.com/majstenmark/stereo2 (2021).

- Operating manual RobotStudio. Document ID: 3HAC032104-001 Revision Y. ABB Robotics. , Available from: https://library.abb.com/en/results (2019).

- Won, C. S. Adaptive interpolation for 3D stereoscopic video in frame-compatible top-bottom packing. IEEE International Conference on Consumer Electronics. 2011, 179-180 (2011).

- Kim, S. K., Lee, C., Kim, K. T. Multi-view image acquisition and display. Three-Dimensional Imaging, Visualization, and Display. Javidi, B., Okano, F., Son, J. Y. , Springer. New York. 227-249 (2009).

- Liu, F., Niu, Y., Jin, H. Keystone correction for stereoscopic cinematography. IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops. 2012, 1-7 (2012).

- Kang, W., Lee, S. Horizontal parallax distortion correction method in toed-in camera with wide-angle lens. 3DTV Conference: The True Vision - Capture, Transmission and Display of 3D Video. 2009, 1-4 (2009).

Access restricted. Please log in or start a trial to view this content.

Reprints and Permissions

Request permission to reuse the text or figures of this JoVE article

Request PermissionExplore More Articles

This article has been published

Video Coming Soon

Copyright © 2025 MyJoVE Corporation. All rights reserved