このコンテンツを視聴するには、JoVE 購読が必要です。 サインイン又は無料トライアルを申し込む。

Method Article

Cohoused 水生動物の長期のビデオ追跡: ノルウェー オマール海老 (アカザエビ norvegicus) の毎日の歩行活動の事例

要約

ここで時間の長い期間にわたって動物を個別に追跡するためのプロトコルを提案する.コンピュータ ビジョン同時に家、に関する情報を提供する事例としてロブスターのグループを使用して手動で構築されたタグのセットを識別するためのメソッドの操作、およびロブスターをマークを使用します。

要約

背景差分と cohoused 動物を個別に追跡することが可能になります画像の閾値に基づいてビデオ追跡手法に関連するプロトコルを提案します。5 日間の暗闇に光条件下で 4 cohoused ノルウェーのロブスター (アカザエビ norvegicus) と追跡ルーチンをテストしました。ロブスターは個別にタグ付けされていた。実験のセットアップと使用されるトラッキング技術は、オープン ソースのソフトウェアに基づいています完全。手動検出と追跡出力の比較は、ロブスターが正しくされたことを示します、倍の 69% を検出します。正しく検出されたロブスターの間で彼らの個々 のタグが正しく時代の 89.5% を識別します。プロトコルで使用されるフレーム レートとロブスターの移動率を考えるビデオのトラッキングの性能は良い品質と代表の結果研究ニーズ (個人の貴重なデータを生産のプロトコルの有効性をサポート空間の収容人数や自発運動パターン)。ここで提示されたプロトコルは、簡単にカスタマイズすることができ、、それ故に、グループの標本の個々 の追跡が貴重な研究の質問に答えるためにすることができます他の種に譲渡。

概要

ここ数年でイメージ ベースの自動追跡は生態および行動の訓練1の基本的な質問を探検する使用ことができる高精度なデータセットを提供しています。これらのデータセットは、動物の行動2,3の定量分析に使用できます。ただし、動物と行動評価を追跡するために使用される各画像の方法論は、その長所と短所。映画の前のフレームから空間情報を使用して、トラックの動物4,5,6イメージ ベースの追跡プロトコル、2 つの動物のパスが渡るときエラーを導入できます。これらのエラーは一般的に不可逆と反映されるまでの時間。この問題5,7をほぼ排除に削減したりコンピューターの進歩にもかかわらず正確な動物の個体識別と追跡のためこれらのテクニックは同種の実験環境をまだ必要があります。

動物を一意に識別することができますマークの雇用これらのエラーを回避し、識別された個人の長期的な追跡が可能します。広く使用されているマーカー (例えばバーコード、QR コード) 商工業の存在し、識別できるよく知られているコンピューター ビジョン技術を使用して拡張現実感など現実 (例えば、ARTag8) とカメラのキャリブレーション (例えば、CALTag9).タグ動物は隔離タグ3を認識するための例、アリ3または蜂10がこれらの以前のシステムのいくつかが最適化されていないため以前異なる動物種の高スループット行動研究のため使用されています。

本稿で示される追跡プロトコルが適しており、1 チャンネル画像、赤外線 (IR) や単色光などで動物を追跡するため (特に、青色光を使用)。したがって、開発メソッドはされても、その他の設定に適用されるカラー キューを使用しませんが照明で制約があります。さらに、我々 はロブスターを邪魔し、同時に低価格のカメラで記録を可能にしないように設計されているカスタマイズされたタグを使用します。さらに、ここで使用されるメソッドはフレームに依存しないタグ検出に基づいて (すなわち.、アルゴリズムに関係なく、以前の軌道イメージの各タグの存在を認識し)。この機能は、動物は一時的に遮蔽することができます、または動物の軌道が交差する可能性がありますに関連します。

タグのデザインは、動物の異なるグループにその使用をことができます。メソッドのパラメーターを設定した後は、特定の分類子 (他の甲殻類や巻貝) の訓練を必要とせず他の動物追跡の問題に取り組むために転送でした。プロトコルをエクスポートの主な制限は、タグとなる小さな昆虫、ハエ、蜂などには適していません) 動物への愛着の必要性と動物の動きの 2次元仮定のサイズです。この制約は重要な手法は、タグのサイズは一定前提としています。(例えば、魚) の 3 D 環境で自由に動く動物は、カメラへの距離に応じて別のタグのサイズを示すでしょう。

このプロトコルの目的は、時間 (数日または数週間など) の 2D コンテキストの長い期間にわたって複数のタグ動物を追跡するためのユーザーフレンドリーな方法を提供することです。方法論的アプローチは、オープン ソースのソフトウェアとハードウェアの使用に基づいています。フリーでオープン ソース ソフトウェアにより、適応、変更、および自由な再配布;したがって、生成されるソフトウェアが各ステップ11,12で向上します。

プロトコルは実験室を追跡し、5 日間のタンクの 4 つの水生動物の自発運動を評価するように設定に焦点を当てて紹介。動画ファイルは 1 秒のタイムラプス映像から記録あり (1 記録された日は、ビデオの約 1 時間を占めている) 1 秒あたり 20 フレームでビデオでコンパイルされます。すべてのビデオ録画が自動的にポストプロセッシング済みコンピューター ビジョン メソッドは、アルゴリズムを適用する動物の位置を取得します。プロトコルは、大量の追跡データ、時間かかると以前の実験論文13で示されている彼らの手動アノテーションを回避を取得できます。

ノルウェーのロブスター (アカザエビ norvegicus) を使用して、ケース ・ スタディのしたがって、我々 はそれらを維持するために種特異的な実験条件を提供します。ロブスターは概日時計の14,15の制御下にあるよく研究穴の出現リズムを行い、cohoused、支配階層16,17が形成します。したがって、ここに示すモデルは行動の概日リズムの特定の焦点との社会の変調に興味がある研究者の良い例です。

ここで紹介する方法は、再現が容易と個々 のタグを持つ動物を区別する可能性がある場合に他の種に適用できます。研究室では、このようなアプローチを再現するための最小要件が (i) 等温室実験のセットアップ;(ii) の連続的な水の供給;(iii) 水の温度制御機構;(iv) の調光システム。(v)、USB カメラと標準的なコンピューター。

このプロトコルでは、Python18と OpenCV19 (オープン ソース コンピューター ビジョン ライブラリ) を使用します。我々 高速で広く用いられているなどの操作 (実装および実行の点では両方) バック グラウンド減算20と画像閾値21,22に頼る。

プロトコル

本研究で使用される種は、種の絶滅危惧種や保護種ではありません。サンプリングおよび実験室の実験は、スペインの法律および動物福祉に関する社内制度 (ICM CSIC) 規定に続いた。地方自治体 (カタルーニャ地方政府) の権限を持つ動物のサンプリングを行った。

1. 動物のメンテナンスとサンプリング

注:次のプロトコルは、研究者が光受容体23への損傷を避けるために夜の間にフィールド名どぶねずみを試すことができます仮定に基づいています。(名) どぶねずみの日光への暴露を避ける必要があります。サンプリング後、ロブスターは順化施設報告以前17,24海水 (13 ° C) の連続的な流れのような建物になっています。本研究で使用される動物は、頭胸部長 (CL; 平均 ± SD) 43.92 ± の intermoult 状態男性 2.08 mm (N = 4)。

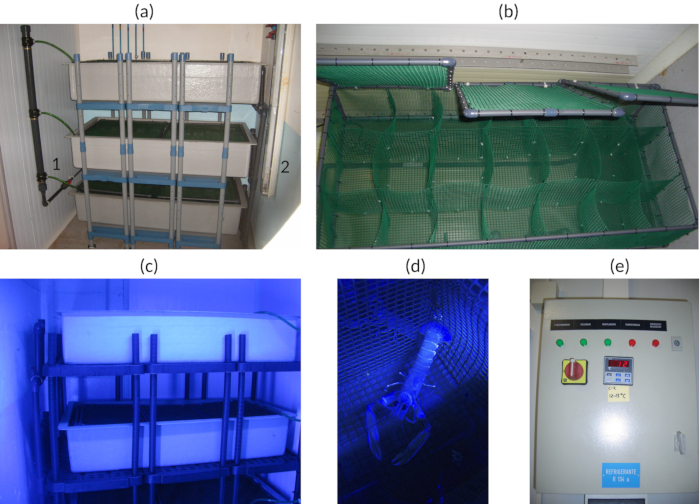

- 個々 の戦い (図 1 a・ dを参照) による損害を避けるために分離されたコンパートメントに個人をしてください。

- 餌を約 3 倍の概日リズムに干渉されていないランダムな時間で 1 週間。

注:この実験でムール貝 (ロブスター当たり約 4 グラム) は食品として使用されました。ムール貝は冷凍食品サプライヤーから購入した、人間の消費のために適していた。 - 25種、400 m 深い26環境条件のスペクトル感度によると光の時間をシミュレートするために青い光 (425 515 nm) を使用して (図 1 c、dを参照してください)。

注:ここで使用する施設は 2 つの青色の垂直天井 (478 nm) 12 の光強度を生産蛍光灯ランプからの距離 1 m で lx。天井のランプの位置、図 1 aを参照してください、製造元と技術的なランプの特性に合わせた材料の表を参照してください。 - 12/12 光/闇の時間に順化施設の日長を調整または緯度地域の自然の日長をシミュレートします。

- 13 ° c 施設温度を調節し、モニター 2 倍効果の海水の温度は 13 ° C のまわりをチェックする毎日 (図 1e参照)。

- 良い酸素を維持するために約 4 リットル/分の割合で海水の流入を調節します。

注:(フィルター、その他のポンプは使用しない) 開回路に海水が循環しています。水の供給は、メイン水槽工場サービスに依存します。

図 1: 施設順化ビュー 。タンク棚 (、)。(a1)海水を入力します。(a2)蛍光灯シーリング ライト。青い光の詳細 (b) 照明。(c) 動物細胞の詳細。(d) 分離施設コントロール パネルの詳細。入口の 1 つの (e) 温度設定。この図の拡大版を表示するのにはここをクリックしてください。

2. タグの建設

注:ここで使用するタグは、対象動物または他の特定の考慮事項の特性に応じて変更できます。

- 黒いプラスチック シートから直径 40 mm の 4 つの円をカットします。

- 白 PVC プラスチック シート 2 つの等辺三角形 26 mm 側面からカットします。

- 直径 26 mm の白いポリ塩化ビニール プラスチック シート 2 円からカットします。

- 白い三角形と円の中心をマーク、10 mm の穴を作る。

- 4 つの黒い円の中心に 4 つの白い図形に接着します。

図 2: ロブスターの個々 のタグ付けに使用される 4 つのタグです。円、丸穴、三角形、三角形の穴。この図の拡大版を表示するのにはここをクリックしてください。

3. 実験のセットアップ

注:実験のアリーナは、実験室から独立したが、順化施設に近接するはずです。

- 実験的舞台で海水と同じ温度で空気の温度を管理して維持できる実験室を設定します。

-

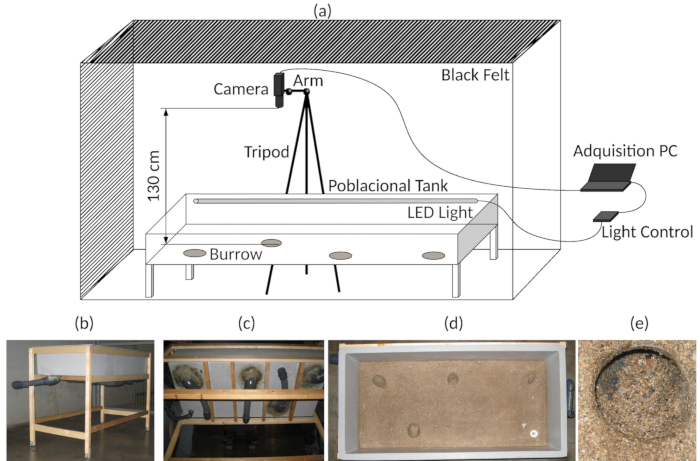

実験場として使用されるガラス繊維タンク (1,500 × 700 × 300 mm) を変更します。ロブスターは、(図 3 be) を移動することになって表面にタンクとスティックの砂の下で柔軟なパイプを使用して 4 つの穴を追加します。詳細については、17,27を参照してください。

- 水中の青色 Led で実験のアリーナを提供 (472 nm、光の時間をシミュレートする) と IR Led (850 nm、暗い) (また見なさい図 3 a)17,24。

注:LED ライトは、その低熱影響と使用可能な電子制御と無料ハードウェアの可用性のために使用されます。13 ± 0.5 ° C の環境と海水温度で分離された施設が使用されました。 - 常に赤外線 Led が点灯します。

注:IR は、暗い状態で、光の条件でビデオの記録に必要です。スイッチをオフにする必要はありません。 - 日長を管理する装置に青色 Led を接続します。提案材料表、および詳細についてを参照してください。、Sbragaglia らです。を参照してください。17 (また図 3 aに示すように)。

注:ビデオまたは画像自動解析における照明は、重要な要因です。水表面の反射を回避するアリーナ中影なし通常照明は、簡単に後部のビデオや画像解析をなります。このプロトコルのコンテキストでのみ 12/12 光/闇条件が使用されました。光と闇は徐々 に 30 分以内で達成された、光コント ローラー スクリプトはファイル 1 の補足として追加されます。 - タンクの 1 つのコーナーで冷えた海水の入口と反対側の角に対応するコンセントの場所。

- 約 4 L/分の流量で海水の入力を規制します。

- 他の光 (図 3 a) からの完全分離を提供するために黒いカーテンを使用してタンクを囲みます。

- 水中の青色 Led で実験のアリーナを提供 (472 nm、光の時間をシミュレートする) と IR Led (850 nm、暗い) (また見なさい図 3 a)17,24。

- Web カメラは実験的アリーナのセンターで実験的アリーナと上記ビデオ カメラ (130 cm) の位置の側面に固定する三脚を配置 (75 cm × 32.5 cm (図 3 aを参照してください)。

- ビデオ カメラが中心の位置にあるかどうかを確認してください (手順 3.3 参照) を確認するそれが移動されていない思わず。

-

カーテン (図 3 a) の外側に配置されているコンピューターに web カメラを接続します。

- ビデオ カメラでコマ撮り録画を管理するソフトウェアをインストールします。

注:時間経過の録音は、種の移動の速度に依存します。また、カメラ、魚眼レンズ、PC、ソフトウェアの特性とここで使用されるメーカーの材料表を参照してください。 - 種の特性によると記録ビデオのパラメーターを調整します。

注:N. どぶねずみの移動速度を考慮した 1 秒のコマ撮り録画はここでは、使用された、ビデオのすべての 24 h 保存されました。 - (これは、行動の将来の手動スコアリングの助けることができる) とタイムラプス ビデオのタイムスタンプ (日付を含む) を作成することを確認します。

- ビデオ カメラでコマ撮り録画を管理するソフトウェアをインストールします。

図 3: 実験のセットアップ。(、) の実験の組み立て図のタンクとビデオ集録。(b) 試験水槽の一般的なビュー。人工巣穴を示す実験タンクの下部 (c) 表示。船型試験水槽の底を示す (d) 上に表示します。(e) 巣穴の入り口の 1 つの詳細です。この図の拡大版を表示するのにはここをクリックしてください。

4. 実験的試みと動物の準備

注:順化施設で、ノルウェーのロブスター25の分光感度によると赤い光条件の下で、動物のすべての手順を行う必要があります。馴化および実験施設間動物を移動するときは、不透明の黒バッグを使用して冷蔵庫をカバーする光、ロブスターの任意の露出を避けてください。

- 以前約 7 ° C で水で冠水した 4 つの区画に区切られた冷蔵庫を準備します。

- 構築された高速接着剤、シアノアクリ レートのような以前の 4 つのタグを準備します。

- 砕いた氷のトレイを準備します。

- 順化施設にタグ付けして冷蔵庫のコンパートメントで、それぞれに 4 つのロブスターを選択します。

-

30 分待って、その後、タグ付け手順を開始します。

- ロブスターを取るし、それを固定し、タグの操作を容易にするために 5 分の砕いた氷の上に置きます。

- 吸着紙でロブスターの頭胸部の上部を乾燥し、高速接着剤のドロップを置きます。

- 接着剤と接触して、動物の頭胸部の上に水平方向にタグを配置し、強化する十分な時間を待つ (約 20 秒)。

- 冷蔵庫のコンパートメントにロブスターを戻り、同じ方法で他の 3 つの動物を続行します。

- 彼らがいた細胞に戻ってロブスターを入れて、タグは適切に接着していることを確認 24 h を待ちます。

- タグ付けのプロシージャのために使用された同じ冷蔵庫を使用して実験室に順化施設からロブスターを転送します。

- ビデオ録画を起動し、タグのロブスターを導入する前に 5 分を待ちます。初期の 100 フレームから平均の背景イメージを取得します。

注:1 分以上を待機は必須タグ ロブスター; なし背景フレームを取得するには彼らは、ビデオ処理のために必要です。 - それで水を保つ実験タンクに一つずつ、それぞれのコンパートメントの中動物をご紹介します。

- アウトを取得するまで待機します。彼らは出てこない場合、コンパートメントを傾けることによって優しく手助けします。実験条件下でタンク内の動物の例として図 4を参照してください。

図 4: Raw ビデオ フレーム。時間経過のビデオの 1 つからの代表的なフレームの例は、実験中に収集されました。右上に日付、時刻、およびフレームのタイムスタンプを示す.イメージの下の隅にタンクのイルミネーションの違いに気づきます。この図の拡大版を表示するのにはここをクリックしてください。

5. ビデオ解析スクリプト

-

実験が完了した後、分析を実行します。

- ビデオ解析用コンピューター ビジョンのスクリプトを起動します。

- 位置とロブスターで距離を計算する Java プログラムを起動し、データベースにデータを挿入します。

注:このプログラムは、ユークリッド距離に基づくアルゴリズム28です。 - 適切な時間間隔としてデータをビン分割する SQL スクリプトを起動 (例: 10 分)。

6. コンピューター ビジョン スクリプト ビデオ解析用

注:実験のセットアップに関連するエラーが発生しないために、スクリプトは魚眼レンズの画像補正を回避できます。それにもかかわらず、OpenCV カメラ校正機能29ベクトルと行列の回転方法30,31に基づくとこれを修正することが可能です。

- Python18プログラム言語を選択します。

- OpenCV19画像と動画像処理ライブラリを選択します。

- ビデオをロードします。

注:ビデオ フォーマット .avi または.mp4 は、この実験で使用されたが、これは必須ではありません。それは、オペレーティング システムにインストールされている FourCC32コーデックに依存します。 -

ビデオのフレーム付きごとに次の手順を実行します。

- 背景20B (ステップ 4.6 から取得された、最後 100 フレームの平均) を引く現在のFiのフレームし、 FiとしてBの背景イメージを更新します。OpenCV19ライブラリから関数BackgroundSubtractorMOG2を使用 (補足ファイル 2内のスクリプトを参照してください)。

- 興味 (ROIs) Rバック グラウンド減算によって示される関連する動きでは、ピクセルからの領域のセットを決定します。OpenCV19ライブラリ内、法適用からBackgroundSubtractorMOG2を使用して (補足ファイル 2内のスクリプトを参照してください)。セットでアカウント移動しない動物を考慮する前のフレームから動物の検出が含まれます。

- 各投資収益率Riの次の手順に従います

- 膨張関数を適用し、投資収益率Riの輪郭33を計算します。OpenCV19ライブラリの機能を拡張し、 findContoursを使用 (補足ファイル 2内のスクリプトを参照してください)。

- 船体領域34こんにちはピクセル数で計算してください。OpenCV19ライブラリから関数convexHullを使用 (補足ファイル 2内のスクリプトを参照してください)。

- 半径35を計算の投資収益率Riri 。OpenCV19ライブラリから関数minEnclosingCircleを使用 (補足ファイル 2内のスクリプトを参照してください)。

- 投資収益率Riの堅実性siを計算します。堅実さは、 Riの凸領域 (6.4.3.2 の手順で得られた) に (手順 6.4. 3.1. 認証取得) 輪郭領域の比率です。

- 投資収益率Riのアスペクト比aiを計算します。アスペクト比は、 Riの高さと幅の比-外接する四角形。外接する四角形は、OpenCV19ライブラリから関数boundingRectを使用して計算されます。

- ハル周辺地域、半径、堅牢性、および縦横比のプロパティを調整することによって、動物を含む候補者として・ ロワの縮小セットを選択します。

- こんにちはが未満のかどうか500.0 100000.0より大きいかを確認します。もしそうなら、 Riの投資収益率を破棄します。そうでなければ、動物の場所の候補 ROI としてRiを維持します。

- Riは40.0未満であるかどうかを確認します。もしそうなら、 Riの投資収益率を破棄します。そうでなければ、動物の場所の候補 ROI としてRiを維持します。

- Siは-4.0破棄Riの投資収益率よりも小さいかどうかはチェックしてください。そうでなければ、動物の場所の候補 ROI としてRiを維持します。

- Aiが0.15以上、 4.0未満のかどうかチェックしてください。ですので、投資収益率Riを破棄します。そうでなければ、動物の場所の候補 ROI としてRiを維持します。

注: ・ ロワの使用は、動物の体領域のタグ検索に焦点を当て、計算コストを削減します。前のフレームから動物が検出されたが、動物が動いていないときに間違って検出を避けるために含まれます。

- 動物タグ id を決定する Roi を分析します。・ デ ・各投資収益率Riおよび各内部投資収益率Pi、手順を実行し、内部・ ロワPを抽出します。

- Π 乙36 閾値処理アルゴリズムを使用してグレースケール画像を 2 値化する。

- 6.4. 3.1. ステップのようにPiの輪郭33を計算します。

- 船体領域34こんにちはとアスペクト比ai手順 6.4.3.2 と 6.4.3.5 のように計算します。

- Piの形状の瞬間37,38miを計算します。OpenCV19ライブラリから関数のモーメントを使用 (補足ファイル 2内のスクリプトを参照してください)。

- 次の条件を使用して、タグを格納する候補として・ ロワの縮小セットを選択します。

- 確認してくださいこんにちは 150.0以上、 500.0未満。もしそうなら、投資収益率Piを破棄します。それ以外の場合、タグの位置のための候補者 ROI としてPiを維持します。

- Aiが0.5以上、 1.5未満のかどうかチェックしてください。もしそうなら、投資収益率Piを破棄します。そうでなければ、動物の場所の候補 ROI としてPiを維持します。

- Miが0.3より大きいかを確認します。もしそうなら、投資収益率Piを破棄します。そうでなければ、動物の場所の候補 ROI としてPiを維持します。

- タグ ・ ロワを分類します。おおよその各選択した投資収益率Pi19OpenCV19関数38を使用してポリゴン39 。

- 多角形近似に正確に 3 つの頂点があるかどうかチェックしてください。三角形クラスにタグを割り当てます。そうでなければ、 circleクラスをタグ領域に割り当てます。

注:近似の多角形は、頂点に行列を使用して格納されます。 - 投資収益率Piの中心のピクセルを確認します。黒のピクセルの場合は、孔クラスにPiを割り当てます。それ以外の場合、白のクラスにPiを割り当てます。

注:図形の中心、6.4.5.4 のステップで計算された瞬間から推測します。4 ピクセル半径中心部の黒のピクセルを検索します。

- 多角形近似に正確に 3 つの頂点があるかどうかチェックしてください。三角形クラスにタグを割り当てます。そうでなければ、 circleクラスをタグ領域に割り当てます。

- フレーム データを保存: フレームの日付、時間、図形中心の図形座標と y 中心の図形座標 x クラス。

- 次のフレームを続行するか、プロセスを終了します。作業のスクリプト ステップの視覚的な例として下の図 5を参照してください、スクリプト機能の例としてビデオ 1 を見る。

図 5: ビデオ処理スクリプトの関連するステップ(1) 評価最後の 100 の平均をバック グラウンド減算モーション フレーム。(2) バック グラウンド減算アルゴリズムの結果です。(3) 適用ホワイト検出エリアを拡張させる形態操作。(4) 適用を修正、静的、メインの投資収益率黄色のポリゴンは、下部タンクに対応します。(5) はメインの ROI 内の各白検出領域の輪郭を計算し、各検出された輪郭線の構造解析を実行します。(6) 構造のプロパティ値をチェックし、次に、2 番目のレベルの投資収益率の候補者を選択します。Binarize 大津閾値アルゴリズム; を使用してフレーム (7)スクリプトは、2 番目レベル ・ ロワでのみ動作します。(8) それぞれは第 2 レベルの投資収益率を二値化、白領域の輪郭を計算して輪郭検出のために構造の解析を実行します。(9) チェック構造のプロパティ値し、内部投資収益率の候補者を選択します。(10) 各輪郭内部投資収益率候補で、記述子/モーメントを計算します。(11) モデルで検出された図形と一致する図形し、最高試合候補者に多角形を近似する場合はチェックします。(12) おおよその多角形の頂点の数を確認し、幾何学的図形を決定する: 円または三角形。(13) 計算図センターと黒のピクセルが発生する場合はチェックyes の場合、穴の図です。(14) フレーム解析後視覚的な結果です。この図の拡大版を表示するのにはここをクリックしてください。

結果

自動ビデオ解析を検証する実験データのサブセットを手動で構築しました。(これはサンプルがその許容誤差内の人口を正確に反映するかどうかを示すものさし) 99% の信頼水準との 4% の誤差 1,308 フレームのサンプル サイズ (どれだけ近いかを表す比率である、サンプルを与えた応答は人口の実際の値) ランダムに選択された Roi を正確に識別の各 ROI 内のタグの正しい?...

ディスカッション

ビデオ追跡プロトコルにより得られたパフォーマンスと代表の結果は、社会的変調と cohoused 動物の概日リズムの特定の焦点と、動物行動の分野での応用研究の有効性を確認しました。動物検出 (69%) の効率化タグ差別 (89.5%) の精度使用対象種の行動特性 (すなわち、運動率) と相まってここでこのプロトコルである長期的な実験 (例えば、数日から数週間) に最適なソリューションを提案します...

開示事項

著者が明らかに何もありません。

謝辞

著者は、この作品の出版を資金博士ジョアン * 会社に感謝しています。また、著者らは、実験的な作品の中に彼らの助けのための実験的水族館ゾーン バルセロナ (ICM CSIC) 海洋科学研究所の技術者に感謝しています。

この作品は、RITFIM プロジェクトによって支えられた (CTM2010 16274; 主任: J. 阻害される) スペイン語省、科学とイノベーション (MICINN) とスペイン語省経済と競争力から TIN2015 66951 C2 2 R の助成金によって設立されました。

資料

| Name | Company | Catalog Number | Comments |

| Tripod 475 | Manfrotto | A0673528 | Discontinued |

| Articulated Arm 143 | Manfrotto | D0057824 | Discontinued |

| Camera USB 2.0 uEye LE | iDS | UI-1545LE-M | https://en.ids-imaging.com/store/products/cameras/usb-2-0-cameras/ueye-le.html |

| Fish Eye Len C-mount f = 6 mm/F1.4 | Infaimon | Standard Optical | https://www.infaimon.com/es/estandar-6mm |

| Glass Fiber Tank 1500 x 700 x 300 mm3 | |||

| Black Felt Fabric | |||

| Wood Structure Tank | 5 Wood Strips 50x50x250 mm | ||

| Wood Structure Felt Fabric | 10 Wood Strips 25x25x250 mm | ||

| Stainless Steel Screws | As many as necessary for fix wood strips structures | ||

| PC | 2-cores CPU, 4GB RAM, 1 GB Graphics, 500 GB HD | ||

| External Storage HDD | 2 TB capacity desirable | ||

| iSPY Sotfware for Windows PC | iSPY | https://www.ispyconnect.com/download.aspx | |

| Zoneminder Software Linux PC | Zoneminder | https://zoneminder.com/ | |

| OpenCV 2.4.13.6 Library | OpenCV | https://opencv.org/ | |

| Python 2.4 | Python | https://www.python.org/ | |

| Camping Icebox | |||

| Plastic Tray | |||

| Cyanocrylate Gel | To glue tag’s | ||

| 1 black PVC plastic sheet (1 mm thickness) | Tag's construction | ||

| 1 white PVC plastic sheet (1 mm thickness) | Tag's construction | ||

| 4 Tag’s Ø 40 mm | Maked with black & white PVC plastic sheet | ||

| 3 m Blue Strid Led Ligts (480 nm) | Waterproof as desirable | ||

| 3 m IR Strid Led Ligts (850 nm) | Waterproof as desirable | ||

| 6 m Methacrylate Pipes Ø 15 mm | Enclosed Strid Led | ||

| 4 PVC Elbow 45o Ø 63 mm | Burrow construction | ||

| 3 m Flexible PVC Pipe Ø 63 mm | Burrow construction | ||

| 4 PVC Screwcap Ø 63 mm | Burrow construction | ||

| 4 O-ring Ø 63 mm | Burrow construction | ||

| 4 Female PVC socket glue / thread Ø 63 mm | Burrow construction | ||

| 10 m DC 12V Electric Cable | Light Control Mechanism | ||

| Ligt Power Supply DC 12 V 300 W | Light Control Mechanism | ||

| MOSFET, RFD14N05L, N-Canal, 14 A, 50 V, 3-Pin, IPAK (TO-251) | RS Components | 325-7580 | Light Control Mechanism |

| Diode, 1N4004-E3/54, 1A, 400V, DO-204AL, 2-Pines | RS Components | 628-9029 | Light Control Mechanism |

| Fuse Holder | RS Components | 336-7851 | Light Control Mechanism |

| 2 Way Power Terminal 3.81 mm | RS Components | 220-4658 | Light Control Mechanism |

| Capacitor 220 µF 200 V | RS Components | 440-6761 | Light Control Mechanism |

| Resistance 2K2 7 W | RS Components | 485-3038 | Light Control Mechanism |

| Fuse 6.3 x 32 mm2 3A | RS Components | 413-210 | Light Control Mechanism |

| Arduino Uno Atmel Atmega 328 MCU board | RS Components | 715-4081 | Light Control Mechanism |

| Prototipe Board CEM3,3 orific.,RE310S2 | RS Components | 728-8737 | Light Control Mechanism |

| DC/DC converter,12 Vin,+/-5 Vout 100 mA 1 W | RS Components | 689-5179 | Light Control Mechanism |

| 2 SERA T8 blue moonlight fluorescent bulb 36 watts | SERA | Discontinued/Light isolated facility |

参考文献

- Dell, A. I., et al. Automated image-based tracking and its application in ecology. Trends in Ecology & Evolution. 29 (7), 417-428 (2014).

- Berman, G. J., Choi, D. M., Bialek, W., Shaevitz, J. W. Mapping the stereotyped behaviour of freely moving fruit flies. Journal of The Royal Society Interface. 11 (99), (2014).

- Mersch, D. P., Crespi, A., Keller, L. Tracking Individuals Shows Spatial Fidelity Is a Key Regulator of Ant Social Organization. Science. 340 (6136), 1090 (2013).

- Tyson, L. Hedrick Software techniques for two- and three-dimensional kinematic measurements of biological and biomimetic systems. Bioinspiration & Biomimetics. 3 (3), 034001 (2008).

- Branson, K., Robie, A. A., Bender, J., Perona, P., Dickinson, M. H. High-throughput ethomics in large groups of Drosophila. Nature Methods. 6 (6), 451-457 (2009).

- de Chaumont, F., et al. Computerized video analysis of social interactions in mice. Nature Methods. 9, 410 (2012).

- Pérez-Escudero, A., Vicente-Page, J., Hinz, R. C., Arganda, S., de Polavieja, G. G. idTracker: tracking individuals in a group by automatic identification of unmarked animals. Nature Methods. 11 (7), 743-748 (2014).

- Fiala, M. ARTag, a fiducial marker system using digital techniques. 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR’05). 2, 590-596 (2005).

- Koch, R., Kolb, A., Rezk-Salama, C., Koch, R., Kolb, A., Rezk-salama, C. . CALTag: High Precision Fiducial Markers for Camera Calibration. , (2010).

- Crall, J. D., Gravish, N., Mountcastle, A. M., Combes, S. A. BEEtag: A Low-Cost, Image-Based Tracking System for the Study of Animal Behavior and Locomotion. PLOS ONE. 10 (9), e0136487 (2015).

- Charpentier, R. Free and Open Source Software: Overview and Preliminary Guidelines for the Government of Canada. Open Source Business Resource. , (2008).

- Crowston, K., Wei, K., Howison, J. Free/Libre Open Source Software Development: What We Know and What We Do Not Know. ACM Computing Surveys. 37, (2012).

- Edmonds, N. J., Riley, W. D., Maxwell, D. L. Predation by Pacifastacus leniusculus on the intra-gravel embryos and emerging fry of Salmo salar. Fisheries Management and Ecology. 18 (6), 521-524 (2011).

- Sbragaglia, V., et al. Identification, Characterization, and Diel Pattern of Expression of Canonical Clock Genes in Nephrops norvegicus (Crustacea: Decapoda) Eyestalk. PLOS ONE. 10 (11), e0141893 (2015).

- Sbragaglia, V., et al. Dusk but not dawn burrow emergence rhythms of Nephrops norvegicus (Crustacea: Decapoda). Scientia Marina. 77 (4), 641-647 (2013).

- Katoh, E., Sbragaglia, V., Aguzzi, J., Breithaupt, T. Sensory Biology and Behaviour of Nephrops norvegicus. Advances in Marine Biology. 64, 65-106 (2013).

- Sbragaglia, V., Leiva, D., Arias, A., Antonio García, J., Aguzzi, J., Breithaupt, T. Fighting over burrows: the emergence of dominance hierarchies in the Norway lobster (Nephrops norvegicus). The Journal of Experimental Biology. 220 (24), 4624-4633 (2017).

- . Welcome to Python.org Available from: https://www.python.org/ (2018)

- Bradski, G. . OpenCV Library. Dr. Dobb’s Journal of Software Tools. , (2000).

- Piccardi, M. Background subtraction techniques: a review. 2004 IEEE International Conference on Systems, Man and Cybernetics (IEEE Cat. No.04CH37583). 4, 3099-3104 (2004).

- Sankur, B. Survey over image thresholding techniques and quantitative performance evaluation. Journal of Electronic Imaging. 13 (1), 146 (2004).

- Lai, Y. K., Rosin, P. L. Efficient Circular Thresholding. IEEE Transactions on Image Processing. 23 (3), 992-1001 (2014).

- Gaten, E. Light‐induced damage to the dioptric apparatus of Nephrops norvegicus (L.) and the quantitative assessment of the damage. Marine Behaviour and Physiology. 13 (2), 169-183 (1988).

- Sbragaglia, V., et al. An automated multi-flume actograph for the study of behavioral rhythms of burrowing organisms. Journal of Experimental Marine Biology and Ecology. 446, 177-186 (2013).

- Johnson, M. L., Gaten, E., Shelton, P. M. J. Spectral sensitivities of five marine decapod crustaceans and a review of spectral sensitivity variation in relation to habitat. Journal of the Marine Biological Association of the United Kingdom. 82 (5), 835-842 (2002).

- Markager, S., Vincent, W. F. Spectral light attenuation and the absorption of UV and blue light in natural waters. Limnology and Oceanography. 45 (3), 642-650 (2000).

- Aguzzi, J., et al. A New Laboratory Radio Frequency Identification (RFID) System for Behavioural Tracking of Marine Organisms. Sensors. 11 (10), 9532-9548 (2011).

- Audin, M. . Geometry [Electronic Resource. , (2003).

- . . OpenCV Team Structural Analysis and Shape Descriptors - OpenCV 2.4.13.7 documentation. , (2018).

- Slabaugh, G. G. . Computing Euler angles from a rotation matrix. 7, (1999).

- Zhang, Z. A flexible new technique for camera calibration. IEEE Transactions on Pattern Analysis and Machine Intelligence. 22 (11), 1330-1334 (2000).

- . www.FOURCC.org - Video Codecs and Pixel Formats Available from: https://www.fourcc.org/ (2018)

- Suzuki, S., be, K. Topological structural analysis of digitized binary images by border following. Computer Vision, Graphics, and Image Processing. 30 (1), 32-46 (1985).

- Sklansky, J. Finding the convex hull of a simple polygon. Pattern Recognition Letters. 1 (2), 79-83 (1982).

- Fitzgibbon, A., Fisher, R. . A Buyer’s Guide to Conic Fitting. , 51.1-51.10 (1995).

- Otsu, N. A Threshold Selection Method from Gray-Level Histograms. IEEE Transactions on Systems, Man, and Cybernetics. 9 (1), 62-66 (1979).

- Hu, M. K. Visual pattern recognition by moment invariants. IRE Transactions on Information Theory. 8 (2), 179-187 (1962).

- . Structural Analysis and Shape Descriptors - OpenCV 2.4.13.6 documentation Available from: https://docs.opencv.org/2.4/modules/imgproc/doc/structural_analysis_and_shape_descriptors.html?highlight=cvmatchshapes#humoments (2018)

- Douglas, D. H., Peucker, T. K. Algorithms for the Reduction of the Number of Points Required to Represent a Digitized Line or its Caricature. Cartographica: The International Journal for Geographic Information and Geovisualization. 10 (2), 112-122 (1973).

- Vanajakshi, B., Krishna, K. S. R. Classification of boundary and region shapes using Hu-moment invariants. Indian Journal of Computer Science and Engineering. 3, 386-393 (2012).

- Kahle, D., Wickham, H. ggmap : Spatial Visualization with ggplot2. The R Journal. , 144-162 (2013).

- Venables, W. N., Ripley, B. D. . Modern Applied Statistics with S. , (2010).

- Abbas, Q., Ibrahim, M. E. A., Jaffar, M. A. A comprehensive review of recent advances on deep vision systems. Artificial Intelligence Review. , (2018).

- Menesatti, P., Aguzzi, J., Costa, C., García, J. A., Sardà, F. A new morphometric implemented video-image analysis protocol for the study of social modulation in activity rhythms of marine organisms. Journal of Neuroscience Methods. 184 (1), 161-168 (2009).

- Chapman, C. J., Shelton, P. M. J., Shanks, A. M., Gaten, E. Survival and growth of the Norway lobster Nephrops norvegicus in relation to light-induced eye damage. Marine Biology. 136 (2), 233-241 (2000).

- . Video tracking software | EthoVision XT Available from: https://www.noldus.com/animal-behavior-research/products/ethovision-xt (2018)

- Correll, N., Sempo, G., Meneses, Y. L. D., Halloy, J., Deneubourg, J., Martinoli, A. SwisTrack: A Tracking Tool for Multi-Unit Robotic and Biological Systems. 2006 IEEE/RSJ International Conference on Intelligent Robots and Systems. , 2185-2191 (2006).

- . . MATLAB - MathWorks. , (2018).

- Leggat, P. A., Smith, D. R., Kedjarune, U. Surgical Applications of Cyanoacrylate Adhesives: A Review of Toxicity. ANZ Journal of Surgery. 77 (4), 209-213 (2007).

- Dizon, R. M., Edwards, A. J., Gomez, E. D. Comparison of three types of adhesives in attaching coral transplants to clam shell substrates. Aquatic Conservation: Marine and Freshwater Ecosystems. 18 (7), 1140-1148 (2008).

- Cary, R. . Methyl cyanoacrylate and ethyl cyanoacrylate. , (2001).

- Krizhevsky, A., Sutskever, I., Hinton, G. E. Imagenet classification with deep convolutional neural networks. Advances in neural information processing systems. , 1097-1105 (2012).

転載および許可

このJoVE論文のテキスト又は図を再利用するための許可を申請します

許可を申請さらに記事を探す

This article has been published

Video Coming Soon

Copyright © 2023 MyJoVE Corporation. All rights reserved