Zum Anzeigen dieser Inhalte ist ein JoVE-Abonnement erforderlich. Melden Sie sich an oder starten Sie Ihre kostenlose Testversion.

Method Article

SSVEP-basierten Versuchsdurchführung für Brain-Roboter-Interaktion mit Humanoide Roboter

In diesem Artikel

Zusammenfassung

The overall goal of this method is to establish an SSVEP-based experimental procedure by integrating multiple software programs to enable the study of brain-robot interaction with humanoid robots, which is prospective in assisting the sick and elderly as well as performing unsanitary or dangerous jobs.

Zusammenfassung

Brain-Robot Interaction (BRI), which provides an innovative communication pathway between human and a robotic device via brain signals, is prospective in helping the disabled in their daily lives. The overall goal of our method is to establish an SSVEP-based experimental procedure by integrating multiple software programs, such as OpenViBE, Choregraph, and Central software as well as user developed programs written in C++ and MATLAB, to enable the study of brain-robot interaction with humanoid robots.

This is achieved by first placing EEG electrodes on a human subject to measure the brain responses through an EEG data acquisition system. A user interface is used to elicit SSVEP responses and to display video feedback in the closed-loop control experiments. The second step is to record the EEG signals of first-time subjects, to analyze their SSVEP features offline, and to train the classifier for each subject. Next, the Online Signal Processor and the Robot Controller are configured for the online control of a humanoid robot. As the final step, the subject completes three specific closed-loop control experiments within different environments to evaluate the brain-robot interaction performance.

The advantage of this approach is its reliability and flexibility because it is developed by integrating multiple software programs. The results show that using this approach, the subject is capable of interacting with the humanoid robot via brain signals. This allows the mind-controlled humanoid robot to perform typical tasks that are popular in robotic research and are helpful in assisting the disabled.

Einleitung

Brain-Roboter-Interaktion (BRI), die eine innovative Kommunikationspfad zwischen den Menschen und einem Roboter-Vorrichtung über Gehirnsignale bietet, ist Interessenten zu helfen in ihrem täglichen Leben 1,2 Behinderte. Eine Vielzahl von Verfahren sind in der Lage, Gehirnsignale entweder invasiv oder nicht invasiv für den Aufbau der zu erwerben, wie Elektrokortikographie (ECoG), Elektroenzephalogramm (EEG), die funktionelle Magnetresonanztomographie (fMRI) usw. Die am häufigsten verwendeten nicht-invasive Methode BRI Systems ist es, EEG-Signale von Elektroden, die auf der Kopfhaut erhalten. Dieses Verfahren ist kostengünstig, leicht zu bedienen und bietet eine annehmbare Zeitauflösung 3. Unter einer Vielzahl von Robotervorrichtungen sind humanoide Roboter fortgeschritten wie sie erstellt werden, um einige der gleichen körperlichen und geistigen Aufgaben, die Menschen zu unterziehen täglich imitieren. BRI mit einem humanoiden Roboter werden eine wichtige Rolle bei der Unterstützung der Kranken und Alten, sowie die Durchführung von unhygienischen oder gefährliche Arbeiten zu spielen. Aber Steuereines humanoiden Roboters durch BRI-System ist eine große Herausforderung, da die humanoiden Roboter mit voller Körperbewegung wird entwickelt, um komplexe Aufgaben wie die persönliche Unterstützung 4, 5 durchzuführen.

Steady-State visuell evozierten Potential (SSVEP) ist eine Art von Gehirnsignal durch die Modulation des optischen Reiz mit einer gegebenen Frequenz 6 hervorgerufen. Es enthält Sinuskurven bei den Grund- und Oberschwingungsfrequenzen des flackernden Reiz und prominent erscheint in der gesamten Sehrinde im Hinterkopf der Kopfhaut 7. Der Grund für die Wahl der SSVEP Signalen ist, dass die SSVEP basierte BRI-System ergibt relativ hohe Informationsübertragungsrate und erfordert weniger Trainings 8. Andere Arten von Gehirnwellen, wie beispielsweise ereigniskorrelierte Potenziale (ERP) 9 oder Motor-Bildern (MI) Potentiale 10, kann auch in diesem experimentellen Verfahren eingebettet werden.

Unser Verfahren für Gehirn Roboter-Interaktion mit humanoidenRoboter auf Cerebot basiert - eine gedankengesteuerte humanoide Roboter-Plattform - bestehend aus einem EEG-Datenerfassungssystem und einen humanoiden Roboter 11. Die EEG-System ist in der Lage zu erfassen, Vorverarbeitung und Anzeige von verschiedenen Arten von Elektroden erfasst Biopotential-Signale. Es bietet mehrere analoge I / Os und digitalen I / Os und ist in der Lage die Aufzeichnung von bis zu 128 Signalkanäle gleichzeitig mit einer Abtastrate von 30 kHz mit 16-Bit-Auflösung. Seine Software Development Kits in C ++ und MATLAB sind für die Benutzer einfach, um die experimentellen Verfahren zu entwerfen. Der humanoide Roboter hat 25 Freiheitsgrade und ist mit mehreren Sensoren, darunter 2 Kameras, 4 Mikrofone, 2 Sonarentfernungsmesser, 2 IR-Sender und Empfänger, 1 Trägheitsplatte, 9 taktilen Sensoren, und 8 Drucksensoren ausgestattet. Es bietet chorégraphe und C ++ SDK zum Erstellen und Bearbeiten Bewegungen und interaktive Roboter Verhaltensweisen.

Das übergeordnete Ziel dieses Verfahrens ist es, eine SSVEP-basierten experimentellen proce etablierendure durch die Integration mehrerer Software-Programme, wie zB OpenViBE, Choregraph, Zentral Software sowie Benutzer entwickelten Programme in C ++ und MATLAB geschrieben, um das Studium der Gehirn-Roboter-Interaktion mit humanoiden Robotern 11 zu ermöglichen. Abbildung 1 zeigt die Systemstruktur. Der dedizierte Reizdarbietung Computer (SPC) zeigt die Benutzerschnittstelle, um das Thema mit visuellen Reizen, Anweisungen und Umweltrückmeldungen liefern. Der dedizierte Datenverarbeitung Computer (DPC) wird mit der Data Recorder und das Offline-Data Analyzer in der Offline-Trainingsprozess, und betreibt das Online-Signal-Prozessor und der Robotersteuerung für die Online-Steuerung der humanoiden Roboter. Im Vergleich zu anderen SSVEP-basierte Steuerungssysteme, ist unser System zuverlässiger, flexibler und vor allem bequemer, wiederverwendet und aktualisiert, wie es durch die Integration einer Reihe von standardisierten Softwarepaketen wie OpenViBE, Choregraph, Zentral-Software entwickelt werden, und Module in C ++ geschriebenund MATLAB.

Das folgende Verfahren wurde überprüft und von Tianjin Medical University General Hospital Ethik-Kommission genehmigt, und alle Fächer gab schriftlichen Zustimmung.

Access restricted. Please log in or start a trial to view this content.

Protokoll

1. Der Erwerb EEG-Signale

- Erläutern Sie die Versuchsdurchführung an das Thema und erhalten eine schriftliche Einverständniserklärung an Versuchen.

- Messen Sie den Umfang der Kopf der Person mit einem Maßband und wählen Sie das EEG Kappengröße, die in der Nähe der Messung ist. Die Elektroden-Anordnung ist auf der "Internationalen 10-20 System" 12 basiert.

- Messen Sie den Abstand zwischen dem Nasion und Inion. Verwenden Sie einen Hautmarker Bleistift bis 10% des Abstandes als Referenz für die Ausrichtung der Kappe zu markieren, und markieren Sie den Mittelpunkt der Entfernung wie der Scheitelpunkt auf der Person Kopfhaut.

- Legen Sie die EEG-Haube über das Thema durch Ausrichten der 10% Marke mit dem Mittelpunkt der FP1 und FP2 Elektroden. Position Elektrode Cz der Kappe auf dem Scheitel.

- Sicherzustellen, dass der Fz, Cz, Pz und Oz sind auf der Mittellinie des Kopfes, und daß jedes Paar von Elektroden auf jeder Seite der Mittellinie angeordnet sind, in einer horizontalen Linie.

- Schmieren die REF1 und REF2 Elektroden mit leitendem Gel. Legen Sie die Referenzelektroden, die auf der linken und rechten Mastoide mit medizinischem Klebeband. Ziehen Sie den Kinnriemen.

- Legen Sie ein stumpfer Spitze Spritze in den Elektrodenhalter und injizieren leitfähiges Gel in jeder Elektrode in der folgenden Reihenfolge: zuerst die "Masse" Elektrode auf der Stirn und die zweite, die fünf Elektroden in dem Experiment verwendet, O2, O1, Oz, Pz und Cz.

- Setzen Sie das Thema in einem bequemen Sessel 60 cm vor einem Konjunkturmonitor. Weisen Sie den Gegenstand, um seine / ihre Augen in der gleichen horizontalen Ebene mit der Mitte des Bildschirms zu halten.

- Verbinden Sie die Elektrodendrähte an den EEG-Datenerfassungssystem. Konfigurieren Sie die Abtastrate auf 1 kHz.

- Untersuchen Sie die EEG-Signalqualität auf dem dedizierten DPC. Wenn es ein Problem mit einer bestimmten Elektrode, erneut inject Gel die Impedanz des Kanals einzustellen.

- Verwenden Sie die spezielle SPC zu vier Roboter Bilder bei Frequenzen von 4,615, 12, 15 und 20 flackernHz als visuelle Reize auf die Benutzerschnittstelle, wie in Abbildung 2 dargestellt.

2. Offline-Analyse SSVEP Eigenschaften

- Führen Sie 32 Studien mit Offline-Trainingsversuche für jeden Probanden und notieren ihre aus dem EEG-System während des gesamten Prozesses erworbenen Hirnsignale.

Hinweis: Dieser Vorgang ist nur durch erstmalige Subjekte der Versuch durchgeführt, um ihre SSVEP Merkmalsvektoren zu schaffen und den Klassifikator zu trainieren. - Wenn ein Versuch gestartet wird, wählen Sie einen Stimulus als Ziel nach dem Zufallsprinzip und zeigt ein gelber Pfeil darüber.

- 1 Sekunde später flackern die vier visuelle Reize bei verschiedenen Frequenzen auf der Benutzerschnittstelle für 5 Sekunden.

- Fordern Sie den Gegenstand auf dem ausgewählten Zielreiz zu konzentrieren, während seine / ihre Körperbewegung auf ein Minimum.

- Nach jedem Versuch geben, den Gegenstand 3 sec zu entspannen, und starten Sie dann den nächsten Versuch.

- Wenn alle Prüfungen abgeschlossen haben, lesen Sie die gespeicherten Daten. Extrahieren Sie ein 3-sec Datenepoche sein zwischen 2 Sekunden und 5 Sekunden nach dem Trigger die einen Stimulus als Target in jedem Versuch auswählt.

- Berechnen Sie die Leistungsspektrumsdichte (PSD) der Daten Epochen mit der Offline-Data Analyzer in MATLAB-Skripte. Verwenden Sie das im Detail unten beschriebenen Verarbeitungsalgorithmus:

- Berechnen Sie die kanonische Korrelationsanalyse (CCA) Koeffizienten der Mehrkanal-EEG-Daten mit Referenzdaten. CCA ist ein multivariaten statistischen Verfahren für zwei Sätze von Daten verwendet werden, um die zugrunde liegenden Korrelations 13 finden. In Anbetracht der 3s Segment der Mehrkanal-EEG-Daten X und Referenzdaten Y der gleichen Länge, verwenden CCA, um die Gewichtsvektoren, W x und W y zu finden, um den Korrelationskoeffizienten ρ zwischen x = X T W x und y = Y T zu maximieren W y. Stellen Sie die Referenzdaten, um die periodische Signale an bestimmten Stimulusfrequenzen sein.

/ftp_upload/53558/53558eq1.jpg "/>

wobei f 1, f 2, f 3, f 4 die Funktion Frequenzen der vier visuellen Stimuli. - Räumlich filtern das Mehrkanal-EEG-Daten X unter Verwendung des berechneten CCA-Koeffizienten X, um eine eindimensionale gefilterten Daten x, der die prominentesten Korrelation mit der Linearkombination der Referenzdaten ist zu erhalten.

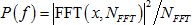

- Berechnung der PSD der räumlich gefilterten Daten x unter Verwendung der schnellen Fourier-Transformation (FFT).

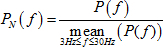

wobei N FFT ist die Probengröße von Daten x und FFT (x, N FFT) liefert den N FFT -Punkt diskreten Fourier-Transformation von x. - Normalisieren der PSD in Bezug auf seinen Mittelwert zwischen 3 und 30 Hz.

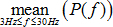

woher60; den Mittelwert des Leistungsspektrums von 3 bis 30 Hz.

den Mittelwert des Leistungsspektrums von 3 bis 30 Hz.

- Berechnen Sie die kanonische Korrelationsanalyse (CCA) Koeffizienten der Mehrkanal-EEG-Daten mit Referenzdaten. CCA ist ein multivariaten statistischen Verfahren für zwei Sätze von Daten verwendet werden, um die zugrunde liegenden Korrelations 13 finden. In Anbetracht der 3s Segment der Mehrkanal-EEG-Daten X und Referenzdaten Y der gleichen Länge, verwenden CCA, um die Gewichtsvektoren, W x und W y zu finden, um den Korrelationskoeffizienten ρ zwischen x = X T W x und y = Y T zu maximieren W y. Stellen Sie die Referenzdaten, um die periodische Signale an bestimmten Stimulusfrequenzen sein.

- Kalibrieren Sie die Klassifikationsparameter für die vier Stimulusfrequenzen. Erstens, beachten Sie die normalisierten PSD-Spektrum, das seine Impulse Ziel entspricht und die Frequenz mit dem stärksten PSD Amplitude wie die Funktion Frequenz manuell zu konfigurieren. Auf der Grundlage der Merkmalsfrequenz, teilen die normalisierten PSD-Daten in zwei Gruppen: Die eine ist erworben, wenn die entsprechenden Impulse als das Ziel ausgewählt, und der andere wird erworben, wenn die Nicht-Zielstimuli ausgewählt sind. Berechnen Sie den Mittelwert der jeweils eingestellt sind. Bestimmen Sie die Schwelle durch den Median der beiden Mittelwerte zur Klassifizierung der Ziel- und Nichtzielsätze 14.

3. Online Verarbeitung Gehirn Signale

- Öffnen Sie die Online-Signalprozessor, wie in Abbildung 3, die b entwickelt wird gezeigt,auf der OpenViBE Umwelt und den MATLAB-Skripten, auf dem DPC für die Online-Verarbeitung Gehirnsignale ased.

- Doppelklicken Sie auf die Erfassung und Verarbeitung Signal Box, die mit einem roten Zyklus in 3 gekennzeichnet ist, um die OpenViBE Einstellungsfenster zu öffnen. Konfigurieren Sie die Klassifikationsparameter für das Thema:. Die Abtastrate als 1 kHz, stellen Sie die Zeitdauer für die FFT als 3 Sekunden, und setzen Sie die Funktion Frequenzen gemäß den Ergebnissen der Offline-Analyse, beispielsweise 4,667, 24, 15 und 20 Hz .

- Klicken Sie auf die Schaltfläche, um die Starts Online-Signalprozessor, der die Daten in Echtzeit mit dem folgenden Algorithmus in drei Schritten Prozesse laufen.

- Zunächst wird der Algorithmus erwirbt EEG-Daten von den Kanälen Oz, O1, O2, Pz und CPZ des EEG-Systems alle 0,5s, und extrahiert die Daten-Segment in den letzten 3-Fettsäuren für die Online-Verarbeitung.

- Zweitens, verarbeitet der Algorithmus die 3-sec-Datensegment unter Verwendung der in Schritt 2.7 beschriebenen Algorithmen und berechnet die Echtzeit-PSD für classification.

- Drittens, der Algorithmus klassifiziert die Gehirnwellenmuster entsprechend den PSD Amplituden an den vier Spiel Frequenzen. Wenn die Amplitude der ein Merkmal Frequenz oberhalb einer gegebenen Schwelle, Klassifizieren des Reizes Flackern bei der entsprechenden Frequenz als SSVEP vorbei.

4. Anschließen des Humanoid Robot

- Drücken Sie die Brust-Taste des Menschenroboters und warten, bis es startet.

Hinweis: Dieser Vorgang dauert ca. 1 min und ist abgeschlossen, wenn der Roboter sagt "OGNAK GNOUK", während seine Brust Taste wird weiß. - Stellen Sie ihre Wireless Fidelity (WiFi) Verbindung mit dem DPC 15.

- In Visual C ++ Skripts auf dem DPC öffnen Sie die Robotersteuerung programmiert. Der Controller empfängt die Klassifizierungsergebnisse aus dem Online-Prozessor über Signal Virtual-Reality-Peripherie Network (VRPN) -Schnittstelle, übersetzt sie in der Roboter Befehle und steuert die entsprechenden Verhaltensweisen des humanoid Roboter über eine drahtlose Verbindung.

- Konfigurieren Sie die Robotersteuerung durch Eingabe der IP-Adresse des Roboters entsprechend seiner WiFi-Verbindung, definieren drei Sätze von Roboter Verhaltensweisen wider, die einfach umgeschaltet, um die drei verschiedene Aufgaben durchführen, und die Einstellung der Ausführungsparameter dieser Verhaltensweisen (z. B. Schrittgeschwindigkeit oder Abstand), um die Aufgabe Anforderung zu passen.

HINWEIS: Weitere Einzelheiten zu diesen Verhaltensweisen werden in Schritten 5.2.1, 5.3.1 und 5.4.1 beschrieben. - Klicken Sie auf die Schaltfläche Erstellen der Visual Studio-Plattform an die Robotersteuerung ausführen.

- Öffnen Sie die chorégraphe Programm auf der SPC. Klicken Sie auf "Connect to", um Pop-up eine Verbindung Widget. Wählen Sie den Roboter nach seiner IP-Adresse gesteuert werden kann, und doppelklicken Sie auf das Symbol, um eine Verbindung herzustellen.

- Öffnen Sie den Video-Monitor aus dem Menü Ansicht in der Menüleiste chorégraphe, und bewegen Sie den Monitor an der Frontseite der Benutzeroberfläche, um Live-Video-Feedback von der Roboterkamera anzuzeigen.

5. Durchführung von Regel Experimente

- Fordern Sie das Thema auf drei spezifische Regelungsaufgaben in unterschiedlichen Umgebungen, um das Gehirn-Roboter-Interaktion Leistung zu bewerten durchzuführen.

HINWEIS: Diese Aufgaben, die im Roboter-Anwendungen wichtig sind, weil sie hilfsbereit und half in ihrem täglichen Leben die behinderte und ältere Menschen sind, müssen verschiedene Roboter-Verhalten zu aktivieren. - Führen Sie die erste Regel Aufgabe, Telepräsenz kontrollieren die humanoiden Roboter über Hirnsignale, um durch Hindernisse zu gehen und drücken Sie einen Lichtschalter, um das Licht einzuschalten, wie in Abbildung 4 dargestellt.

- Um die erste Aufgabe zu erfüllen, die Kontrolle der Roboter Verhaltensweisen, die von den vier SSVEP Reize wie codiert werden: Schritt nach vorn mit einem festen Abstand von 0,15 m, biegen Sie links mit einem festen Einheitswinkel von 0,3 rad, nach rechts mit einer festen Einheitswinkel von 0,3 rad, und Drücken des Schalters mit seiner rechten Hand.

HINWEIS: die ConfiguraProzess in Schritt 4.4 beschrieben. - Informieren den Gegenstand der Aufgabenziel und die vier Verhalten kontrolliert werden.

- Führen Sie die Robotersteuerung wie in Schritten von 4,5 bis 4,7, und starten Sie das Experiment. Geben Sie dem Subjekt die Freiheit, die Umwelt wahrnehmen und Entscheidungen treffen, basierend auf Live-Video-Feedback, und die Roboter Verhaltensweisen durch starrte auf die entsprechenden Reize zu aktivieren.

Anmerkung: keine Anweisung oder helfen sollen, die Gegenstand angewendet werden, wenn in Notfällen, beispielsweise etwa mit einem Hindernis kollidiert ist der Roboter..

- Um die erste Aufgabe zu erfüllen, die Kontrolle der Roboter Verhaltensweisen, die von den vier SSVEP Reize wie codiert werden: Schritt nach vorn mit einem festen Abstand von 0,15 m, biegen Sie links mit einem festen Einheitswinkel von 0,3 rad, nach rechts mit einer festen Einheitswinkel von 0,3 rad, und Drücken des Schalters mit seiner rechten Hand.

- Führen Sie die zweite Aufgabe, Telepräsenz kontrollieren die humanoiden Roboter über Hirnsignale in Richtung der Treppe zu Fuß nach der Ausfahrt, wie in Abbildung 5 dargestellt. Wenn konfrontiert die Passanten, fragen Sie den Gegenstand, um den Roboter zu steuern, zu sagen "Entschuldigung" und warten Sie die Passanten, nachzugeben.

- Steuerung der Roboterverhalten durch die vier SSVEP Reize codiert als: zu Fuß nach vorne continuously mit einer Geschwindigkeit von 0,05 m / sec, biegen kontinuierlich mit einer Geschwindigkeit von 0,1 rad / s nach links, mit einer Geschwindigkeit von 0,1 rad / s nach rechts laufend, und stoppen Sie alle zu Fuß Verhaltensweisen.

- Schalten Sie die Robotersteuerung zu der Haltung abhängigen Steuerfunktion 16.

HINWEIS: Wenn der Roboter geht, verwendet diese Funktion die vierte Konjunktur wie der Befehl zum Stoppen der Wanderverhalten; wenn der Roboter nicht zu Fuß, verwendet es die vierte Konjunktur, um den Roboter zu sagen "Entschuldigung" zu steuern. Die Funktion ist in C ++ Skripts durch Erfassen Fuß Status des Roboters implementiert. - Informieren Sie den Betreff der Aufgabe, objektive und die fünf Verhaltensweisen kontrolliert werden.

- Führen Sie die Robotersteuerung und starten Sie das Experiment, wie in Schritt 5.2.3 beschrieben.

- Leiten die dritte Aufgabe, Telepräsenz kontrollieren die humanoiden Roboter in Richtung einer Ballon Ziel zu gehen, um ihn abzuholen, und sie auf die Hand der Person zu liefern, wie in Abbildung 6 gezeigt,.

- Steuerung der Roboterverhalten durch die vier SSVEP Reize codiert als: Schritt nach vorn mit einem festen Abstand von 0,15 m, biegen Sie links mit einem festen Einheitswinkel von 0,3 rad, nach rechts mit einer festen Einheitswinkel von 0,3 rad und Ergreifen von Gegenständen.

- Aktivieren Sie die Haltung abhängige Steuerungsfunktion in der Robotersteuerung, die vierte Konjunktur wie der Befehl der Niederschlagung des Objekts, wenn es bereits abgeholt wiederverwenden.

- Informieren Sie den Betreff der Aufgabe, objektive und die fünf Verhaltensweisen kontrolliert werden.

- Führen Sie die Robotersteuerung und starten Sie das Experiment, wie in Schritt 5.2.3 beschrieben.

Access restricted. Please log in or start a trial to view this content.

Ergebnisse

Die hier dargestellten Ergebnisse wurden aus einem männlichen Subjekt mit korrigierten-zu-normal erhalten Version. 7 zeigt das Verfahren der Verarbeitung von EEG-Daten, einschließlich der Extraktion eines Mehrkanal-Datenepoche (7A), räumliches Filtern der Daten unter Verwendung von CCA-Koeffizienten (7B) und Berechnen der normierten PSD (7C).

Abbild...

Access restricted. Please log in or start a trial to view this content.

Diskussion

Dieser Beitrag stellt eine SSVEP-basierten experimentellen Verfahren, um das Gehirn-Roboter-Interaktion System mit humanoiden Robotern durch die Integration mehrerer Software-Programme zu etablieren. Weil die menschliche Absicht wird durch Interpretieren Echtzeit-EEG-Signalen wahrgenommen wird, ist es entscheidend, den Elektrodenanschlüssen und EEG-Signalqualitäten vor der Durchführung des Experiments zu verifizieren. Wenn Signale von allen Elektroden erfasst sind von schlechter Qualität, ist es notwendig, die Verbi...

Access restricted. Please log in or start a trial to view this content.

Offenlegungen

The authors have nothing to disclose.

Danksagungen

Die Autoren möchten ihren Dank an Herrn Hong Hu für seine Hilfe bei der Durchführung der Versuche in dieser Veröffentlichung zum Ausdruck bringen. Diese Arbeit wurde zum Teil durch die National Natural Science Foundation of China (No. 61473207) unterstützt.

Access restricted. Please log in or start a trial to view this content.

Materialien

| Name | Company | Catalog Number | Comments |

| Cerebus EEG Data Acquisition System | Blackrock Microsystems | 4176-9967 | |

| NAO humanoid robot | Aldebaran Robotics | H25 | |

| EEG cap | Neuroscan | 8732 | |

| Ten20 Conductive gel | Weaver and company | 10-20-8 |

Referenzen

- McFarland, D. J., Wolpaw, J. R. Brain-Computer Interface Operation of Robotic and Prosthetic Devices. Computer. 41, 52-56 (2008).

- Lebedev, M. A., Nicolelis, M. A. Brain-machine interfaces: Past, present and future. Trends Neruosci. 29 (9), 536-546 (2006).

- Wolpaw, J. R., Birbaumer, N., McFarland, D. J., Pfurtscheller, G., Vaughan, T. M. Brain-computer interfaces for communication and control. Clin. Neurophysiol. 113, 767-791 (2002).

- Bell, C. J., Shenoy, P., Chalodhorn, R., Rao, R. P. Control of a humanoid robot by a noninvasive brain-computer interface in humans. J. Neural. Eng. 5, 214-220 (2008).

- Li, W., Li, M., Zhao, J. Control of humanoid robot via motion-onset visual evoked potentials. Front. Syst. Neurosci. 8, 247(2014).

- Regan, D. Some characteristics of average steady-state and transient responses evoked by modulated light. Electroencephalogr. Clin. Neurophysiol. 20, 238-248 (1966).

- Vialatte, F. B., Maurice, M., Dauwels, J., Cichocki, A. Steady-state visually evoked potentials: focus on essential paradigms and future perspectives. Prog. Neurobiol. 90, 418-438 (2010).

- Bin, G., Gao, X., Wang, Y., Li, Y., Hong, B., Gao, S. A high-speed BCI based on code modulation VEP. J. Neural. Eng. 8, 025015(2011).

- Sutton, S., Braren, M., Zubin, J., John, E. R. Evoked-potential correlates of stimulus uncertainty. Science. 150, 1187-1188 (1965).

- Pfurtscheller, G., Lopes da Silva, H. F. Event-related EEG/MEG synchronization and desynchronization: basic principles. Clin. Neurophysiol. 110, 1842-1857 (1999).

- Zhao, J., Meng, Q., Li, W., Li, M., Sun, F., Chen, G. OpenViBE-based brainwave control system for Cerebot. Proc. IEEE International Conference on Robotics and Biomimetics. , 1169-1174 (2013).

- Homan, R. W., Herman, J., Purdy, P. Cerebral location of international 10-20 system electrode placement. Electroencephalogr. Clin. Neurophysiol. 66, 376-382 (1987).

- Bin, G., Gao, X., Yan, Z., Hong, B., Gao, S. An online multi-channel SSVEP-based brain-computer interface using a canonical correlation analysis method. J. Neural. Eng. 6, 046002(2009).

- Wang, Y., Wang, R., Gao, X., Hong, B., Gao, S. A practical VEP-based brain-computer interface. IEEE Trans. Neural Syst. Rehabil. Eng. 14, 234-239 (2006).

- Setting NAO's WiFi connection - Aldebaran 2.1.3.3 documentation [Internet]. , Aldebaran Robotics Co. Available from: http://doc.aldebaran.com/2-1/nao/nao-connecting.html (2015).

- Chae, Y., Jeong, J., Jo, S. Toward brain-actuated humanoid robots: asynchronous direct control using an EEG-based BCI. IEEE T. Robot. 28, 1131-1144 (2012).

- Croft, R. J., Barry, R. J. Removal of ocular artifact from the EEG: a review. Neurophysiol. Clin. 30, 5-19 (2000).

- Hwang, H. J., Hwan Kim, D., Han, C. H., Im, C. H. A new dual-frequency stimulation method to increase the number of visual stimuli for multi-class SSVEP-based brain-computer interface (BCI). Brain Res. 1515, 66-77 (2013).

- Wang, M., Daly, I., Allison, B., Jin, J., Zhang, Y., Chen, L., Wang, X. A new hybrid BCI paradigm based on P300 and SSVEP. J Neurosci Methods. 244, 16-25 (2015).

- Allison, B. Z., Jin, J., Zhang, Y., Wang, X. A four-choice hybrid P300 SSVEP BCI for improved accuracy. Brain-Computer Interfaces. 1, 17-26 (2014).

- Pan, J. H., Xie, Q., Herman, Y., Wang, F., Di, H., Laureys, S., Yu, R., Li, Y. Detecting awareness in patients with disorders of consciousness using a hybrid brain-computer interface. J. Neural. Eng. 11, 056007(2014).

- Li, J., Ji, H., Cao, L., Zhang, D., Gu, R., Xia, B., Wu, Q. Evaluation and application of a hybrid brain computer interface for real wheelchair parallel control with multi-degree of freedom. Int J Neural Syst. 24, 1450014-14 (2014).

- Zhao, J., Meng, Q., Li, W., Li, M., Chen, G. SSVEP-based hierarchical architecture for control of a humanoid robot with mind. Proc. 11th World Congress on Intelligent Control and Automation. , 2401-2406 (2014).

- Zhu, D., Bieger, J., Molina, G. G., Aarts, R. M. A survey of stimulation methods used in SSVEP-based BCIs. Comput Intell Neurosci. 2010, 1-12 (2010).

- Muller-Putz, G. R., Scherer, R., Brauneis, C., Pfurtscheller, G. Steady-state visual evoked potential (SSVEP)-based communication: impact of harmonic frequency components. J Neural Eng. 2, 123-130 (2005).

Access restricted. Please log in or start a trial to view this content.

Nachdrucke und Genehmigungen

Genehmigung beantragen, um den Text oder die Abbildungen dieses JoVE-Artikels zu verwenden

Genehmigung beantragenThis article has been published

Video Coming Soon

Copyright © 2025 MyJoVE Corporation. Alle Rechte vorbehalten