JoVE 비디오를 활용하시려면 도서관을 통한 기관 구독이 필요합니다. 전체 비디오를 보시려면 로그인하거나 무료 트라이얼을 시작하세요.

Method Article

Cohoused 수 중 동물의 장기 비디오 추적: 노르웨이 가재 (Nephrops norvegicus)의 매일 운동 활동의 사례 연구

요약

여기 우리는 개별적으로 시간의 긴 기간 동안 동물을 추적 하는 프로토콜을 제시. 컴퓨터 비전 사례 연구, 집, 하는 방법에 정보를 제공 하는 동시에로 랍 스타의 그룹을 사용 하 여 수동으로 생성 된 태그의 집합을 식별 하는 방법을 조작 및 표시는 랍 스타를 사용 합니다.

초록

선물이 배경 빼기와 cohoused 동물을 개별적으로 추적할 수 있게 해 주는 이미지 임계 처리 기반 비디오 추적 기술에 관련 된 프로토콜. 5 일 동안 암흑 빛 조건에서 4 개의 cohoused 노르웨이 가재 (Nephrops norvegicus)와 추적 루틴 테스트. 랍 스타는 개별적으로 태그 했다. 실험 설정 및 사용 하는 추적 기술을 완전히 오픈 소스 소프트웨어에 근거한 다. 수동 감지 추적 출력의 비교는 랍 스타 잘못 했다 나타냅니다 시간의 69%를 발견. 올바르게 감지 바닷가재 가운데 그들의 개별 태그 제대로 했다 시간의 89.5%를 발견. 프로토콜에 사용 되는 프레임 속도 랍 스타의 운동 속도, 고려 비디오 추적의 성능 좋은 품질 있으며 대표적인 결과 지원 프로토콜의 타당성 연구 필요 (개인에 대 한 귀중 한 데이터를 생성 공간 점령 또는 운동 활동 패턴)입니다. 여기에 제시 된 프로토콜 쉽게 사용자 정의할 수 있습니다 그리고, 따라서, 표본 그룹에서의 개별 추적 연구 질문에 대 한 중요 한 될 수 있는 다른 종에 게 양도할 수 있다.

서문

지난 몇 년 동안, 자동된 이미지 기반 추적 생태학과 행동 분야1기본적인 질문을 탐구 하는 데 사용할 수 있는 매우 정확한 데이터를 제공 하고있다. 동물의 행동2,3의 정량 분석을 위해 이러한 데이터 집합을 사용할 수 있습니다. 그러나, 동물 및 행동 평가 추적 하는 데 사용 되는 각 이미지 방법론의 장점과 한계는 있습니다. 동물4,,56을 추적 하는 영화에서 이전 프레임에서 공간 정보를 사용 하는 이미지 기반 추적 프로토콜 오류 수 소개 때 두 동물의 경로. 이러한 오류는 일반적으로 가역 하지 않으며 시간을 통해 전파 합니다. 감소 또는 거의이 문제5,7을 제거 하는 진보에 대 한 계산에 불구 하 고 이러한 기술을 여전히 균질 실험 환경 정확한 동물 식별 및 추적에 대 한 필요 합니다.

동물에 고유 하 게 식별 될 수 있는 마크의 고용 이러한 오류를 방지 하 고 확인 된 개인의 장기 추적을 허용 한다. 널리 사용 되는 마커 (예를 들어, 바코드 및 QR 코드) 산업과 상업에 존재 하 고 확인할 수 있습니다 잘 알려진 컴퓨터 비전 기술을 사용 하 여와 같은 증강 현실 (예를 들어, ARTag8) 및 (예를 들어, CALTag9 카메라 보정 ). 대 한 예를 들어, 개미3 또는 꿀벌10, 하지만 이러한 이전 시스템의 일부 고립 된 태그3인식에 대 한 최적화 되어 있지 않으며 태그 동물 이전 다른 동물 종에서 높은 처리량 행동 연구에 대 한 사용 되어 왔습니다.

이 문서에 소개 된 추적 프로토콜은 단일 채널 이미지, 적외선 (IR) 빛 등 단색 빛에에서 동물을 추적 하는 데 특히 적합 (특히, 우리 블루 빛을 사용). 따라서, 개발 하는 방법 색상 신호, 또한 다른 설정에 적용 되 고 사용 하지 않는 조명에 제약 조건이 있다. 또한, 우리는 그렇게 하지 않도록는 바닷가재를 방해 하 고, 동시에 저가 카메라와 녹음을 허용 하도록 설계 된 사용자 지정된 태그를 사용 합니다. 또한, 여기에 사용 되는 방법 프레임 독립적인 태그 검색 기반은 (즉., 이전 궤도에 이미지에 각 태그의 존재를 인식 하는 알고리즘). 이 기능은 동물 일시적으로 차단 될 수 있습니다, 또는 동물 들의 궤적을 교차 수 있습니다 응용 프로그램에서 관련입니다.

태그 디자인 동물의 서로 다른 그룹에 그것의 사용을 허용 한다. 메서드의 매개 변수가 설정 되 면 다른 갑각류 (복족류) 특정 분류자를 훈련을 위한 필요 없이 다른 동물 추적 문제를 해결 하기 위해 옮겨질 수 있습니다. 프로토콜을 수출의 주요 제한 태그 및 첨부 파일 (파리, 꿀벌, 등 작은 곤충에 적합 하지 않은 게) 동물을 위한 필요 및 동물 운동에 대 한 2D 가정의 크기 이다. 이 제약은 중요 한, 주어진 제안된 방법 가정 태그 크기 일정 하 게 유지 합니다. 동물 3D 환경 (예를 들어, 물고기)에 자유롭게 이동 카메라의 거리에 따라 다른 태그 크기를 보여줄 것입니다.

이 프로토콜의 목적은 시간 2D 컨텍스트 (즉, 일 또는 주)의 오랜 기간 동안 여러 태그 동물을 추적 하기 위한 사용자 친화적인 방법을 제공 하는 것입니다. 방법 론 적 접근은 오픈 소스 소프트웨어와 하드웨어의 사용을 기반으로 합니다. 무료 및 오픈 소스 소프트웨어 허용 각 색, 수정, 및 무료 재배포; 따라서, 생성 된 소프트웨어11,12각 단계에서 향상 됩니다.

프로토콜 제시 여기 실험실을 추적 하 고 5 일 동안 탱크에서 4 수생 동물의 운동 활동 평가 설정에 초점을 맞추고. 비디오 파일은 1 s 시간 경과 이미지에서 기록 하 고 (1 기록된 일 차지 비디오의 약 1 시간) 초당 20 프레임에서 비디오에서 컴파일된. 모든 비디오 녹화는 컴퓨터 비전 방법 및 알고리즘 적용 동물 위치를 자동으로 postprocessed. 프로토콜 추적 데이터, 시간 및 이전 실험 논문13힘 드는 될 표시 되었습니다 그들의 수동 주석 피하의 다량을 얻기 수 있습니다.

우리가 노르웨이 가재 (Nephrops norvegicus)를 사용 하 여 사례 연구; 따라서, 우리는 그들을 유지 하기 위해 종의 실험실 조건을 제공 합니다. 바닷가재 수행 잘 공부 뚫 출현 리듬 circadian 시계14,15의 컨트롤 아래에 있는 그리고 cohoused 때 그들은 지배 계층16,17. 따라서, 여기에 제시 된 모델 circadian 리듬에 특정 초점 행동의 사회 변조에 관심이 있는 연구자에 대 한 좋은 예입니다.

여기에 제시 된 방법론은 쉽게 복제 하 고 개별 태그 동물 사이 구별 하는 가능성 있으면 다른 종에 적용 될 수 있습니다. 이러한 접근은 실험실에서 재현에 대 한 최소 요구는 (i) 등온 실험 설정; (2) 지속적인 물 공급; (iii) 물 온도 제어 메커니즘; (4) 조명 제어 시스템; (v)는 USB 카메라와 표준 컴퓨터.

이 프로토콜을 사용 하 여 파이썬18 과 OpenCV19 (오픈 소스 컴퓨터 비전 라이브러리). 우리는 신속 하 고 일반적인 적용 등의 작업 (구현 및 실행 둘 다), 배경 빼기20 및 이미지 임계 처리21,22에 의존 한다.

Access restricted. Please log in or start a trial to view this content.

프로토콜

이 연구에 사용 된 종 멸종 위기 또는 보호 종이 아니다. 샘플링 및 실험실 실험 스페인 입법 및 동물 복지에 관한 내부 기관 (ICM-CSIC) 규정에 따 랐 다. 동물 샘플링 지방 기관 (카탈로니아 지역 정부)의 허가 함께 실시 했다.

1. 동물 유지 보수 및 샘플링

참고: 다음 프로토콜 연구원23대뇌 손상을 방지 하려면 밤 동안 필드에서 명 norvegicus 샘플 수 가정 기반으로 합니다. 명. norvegicus 햇빛에 노출은 피해 야 한다. 샘플링, 후에 랍 스타 이전17,24, 냉장 된 바닷물 (13 ° C)의 지속적인 흐름에 보고 하는 것과 유사한 새 환경 순응 시설에서 지 내게 되어 있습니다. 이 연구에 사용 된 동물 43.92 ± cephalothorax 길이 (CL, 평균 ± SD) intermoult 상태에서 남성은 2.08 m m (N = 4).

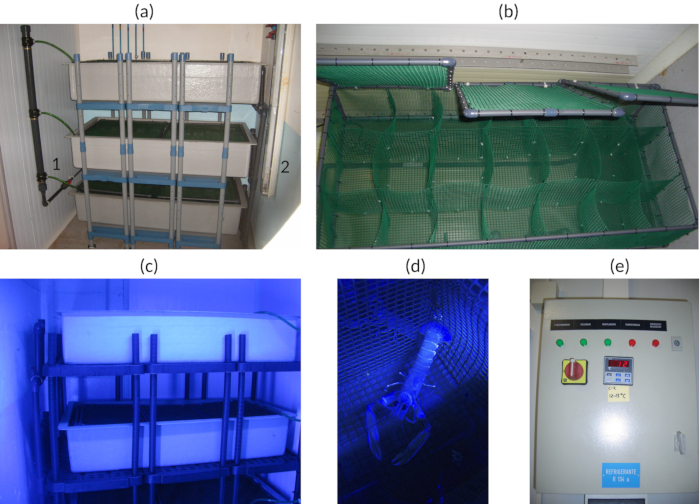

- ( 그림 1a-d참조) 개별 싸움으로 인해 손해를 피하기 위해 격리 된 구획에서 개인 유지.

- 그들 circadian 리듬을 방해 하지 않도록 무작위 시간에 1 주일 x 3에 대 한 피드.

참고: 이 실험에서 홍합 (랍스터 당 약 4 g)는 음식으로 사용 되었다. 홍합 냉동 식품 공급 업체 로부터 구입 했다 하 고 인간의 소비에 적합 했다. - 푸른 빛 (425-515 nm) 스펙트럼 감도 종25 와 400 m 깊은26 에서 환경 조건에 따라 가벼운 시간을 시뮬레이션을 사용 하 여 (참조 그림 1 c,d).

참고: 시설 여기에 사용 되는 두 개의 파란색 세로 천장 (478 nm) 12의 빛의 강도 생산 하는 형광 램프에서 거리의 1 개 m에서 lx. 천장 램프의 위치에 대 한 그림 1a 및 제조업체의 기술 램프의 특성에 대 한 테이블의 자료 를 참조. - 12/12 빛/어둠 시간 새 환경 순응 시설 photoperiod 조정 하거나 지역의 위도의 자연 photoperiod 시뮬레이션 합니다.

- 시설 온도 13 ° C를 통제 하 고 2 모니터 inflowing 바닷물의 온도 13 ° C의 주위에 매일 x ( 그림 1e참조).

- 좋은 산소를 유지 하기 위해 약 4 L/분의 속도로 해 수의 유입을 조절 합니다.

참고: 해 수 순환 (필터 및 추가 펌프 사용) 개방 회로에. 물 공급 주요 수족관 식물 서비스에 따라 달라 집니다.

그림 1 : 시설 새 환경 순응 보기. (가) 탱크 선반. (a1) 해 수 입력입니다. (a2) 형광 성 천장 조명입니다. (b) 블루 빛의 조명. (c) 동물 세포 세부입니다. (d) 격리 시설 제어판의 세부 사항. (e) 온도 설정의 입구 중 하나입니다. 이 그림의 더 큰 버전을 보려면 여기를 클릭 하십시오.

2. 태그의 건설

참고: 여기에 사용 되는 태그는 대상 동물 또는 다른 특정 고려의 특성에 따라 변경할 수 있습니다.

- 검은 플라스틱 시트에서 지름 40 m m의 4 개의 동그라미를 잘라.

- 백색 PVC 플라스틱 시트 2 등변 삼각형 26mm 측면에서 잘라.

- 26 m m 직경에서의 백색 PVC 플라스틱 시트 두 원형에서 잘라.

- 백색 삼각형, 동그라미의 센터를 표시 하 고 그것에 10mm 구멍을 만들.

- 4 개의 검은 동그라미의 센터에 4 개의 흰색 셰이프를 붙입니다.

그림 2 : 4 태그는 바닷가재의 개별 태그에 대 한 사용. 원형, 원형 홀, 삼각형, 삼각형 구멍. 이 그림의 더 큰 버전을 보려면 여기를 클릭 하십시오.

3. 실험 설치

참고: 실험 분야에서 실험 챔버 독립적인 그러나 새 환경 순응 시설에 가까운 근접에서 되어있다.

- 실험 분야에서 해 수로 같은 온도에서 공기 온도 제어 하 고 유지 수 있는 실험 챔버를 설정 합니다.

-

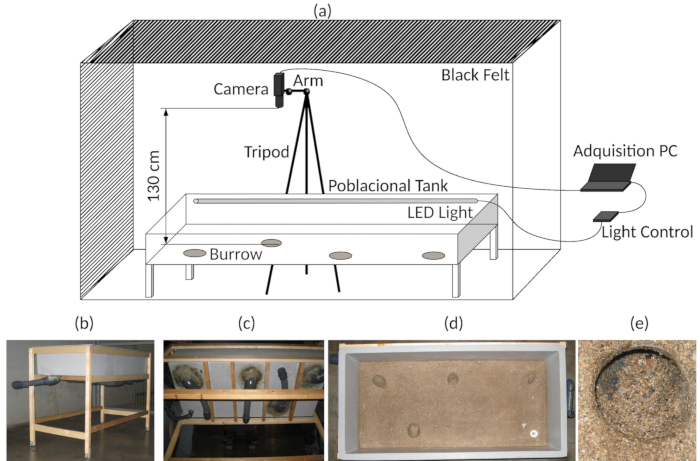

실험적인 경기장으로 사용할 유리 섬유 탱크 (1500 x 700 x 300mm)를 수정 합니다. 사용 하 여 PVC 유연한 파이프 표면에 탱크와 스틱 모래의 하단에는 랍 스타는 (그림 3b-e)를 이동 해야 하는 4 개의 버 로우를 추가 합니다. 자세한 내용은17,27를 참조 하십시오.

- Submergible 블루 Led와 실험적인 무대를 제공 (472 빛 시간 시뮬레이션 nm) 및 IR Led (850 nm, 어두운 조건) ( 그림 3a참조)17,24.

참고: LED 빛은 그것의 낮은 열 영향 및 가능한 전자 제어 및 무료 하드웨어의 가용성으로 인해 사용 됩니다. 13 ± 0.5 ° C의 환경 및 해 수 온도와 격리 시설 사용 되었다. - 항상 켜져 IR Led를 유지.

참고: IR은 비디오 기록 어두운 조건에서 조명 조건에 필요 합니다. 그것을 끄고 필요는 없습니다. - 파란색 Led는 photoperiod 관리 하는 장치에 연결 합니다. 테이블의 자료에 대 한 자세한 내용은 권장 사항을 참조 하십시오, Sbragaglia 외. 를 참조 하십시오 17 ( 그림 3a에 표시).

참고: 조명 비디오 또는 이미지 자동 분석에 중요 한 요소 이다. 물 표면 반사 방지는 아레나 전 그림자 없이 일반 조명 쉽게 후부 비디오 또는 이미지 분석. 이 프로토콜의 맥락에서만 12/12 빛/어둠 조건 사용 되었다. 빛과 어둠에 점차적으로 30 분 이내 달성 했다 고 빛 컨트롤러 스크립트 보충 파일 1로 추가 됩니다. - 탱크와 반대 코너에서 해당 콘센트의 한 모퉁이에 냉장된 해 수 흡입구를 배치 합니다.

- 약 4 L/분의 유량에서 해 수 입력을 통제 한다.

- (그림 3a) 다른 빛 으로부터 완전 격리를 제공 하기 위해 검은 커튼으로 탱크를 둘러싸고 있습니다.

- Submergible 블루 Led와 실험적인 무대를 제공 (472 빛 시간 시뮬레이션 nm) 및 IR Led (850 nm, 어두운 조건) ( 그림 3a참조)17,24.

- 배치는 웹 카메라 실험 경기장의 센터에서 실험 무대와 위치 비디오 카메라 위의 (130 cm)의 측면에 고정 하는 삼각대 (75 cm x 32.5 cm ( 그림 3a참조).

- 비디오 카메라 중심된 위치 인지 확인 하십시오 (단계 3.3 참조) 확인을 그것은 이동 되지 무의식적으로.

-

커튼 (그림 3a)의 바깥쪽에 배치 하는 컴퓨터에 웹 카메라를 연결 합니다.

- 비디오 카메라와 함께 시간 경과 녹화를 관리 소프트웨어를 설치 합니다.

참고: 시간 경과 기록 종의 움직임의 속도에 따라 달라 집니다. 또한, 카메라, fisheye 렌즈, PC 및 소프트웨어 특성 및 여기에 사용 하는 제조 업체에 대 한 테이블의 자료 를 참조 하십시오. - 종족의 특성에 따라 녹화 비디오의 매개 변수를 조정 합니다.

참고: 명. norvegicus이동성 속도 고려 하면 그리고 1 s 시간 경과 기록 여기, 사용 비디오 모든 24 h를 저장 했다. - (로이 동작의 미래 수동 점수 수) 시간 경과 비디오에서 타임 스탬프 (날짜 포함)를 만들 수 있는지 확인 합니다.

- 비디오 카메라와 함께 시간 경과 녹화를 관리 소프트웨어를 설치 합니다.

그림 3 : 실험 설치. (한) 실험의 어셈블리의 탱크 및 비디오 취득. (b) 실험 탱크의 일반적인 보기. (c) 아래 인공 버 로우를 나타내는 실험 탱크의 보기. (d) 상단 보기, 실험 탱크의 바닥을 보여주는. (e) 뚫으 입구 중 하나의 세부 사항. 이 그림의 더 큰 버전을 보려면 여기를 클릭 하십시오.

4. 실험적인 시도 동물 준비

참고: 새 환경 순응 시설에서 및 노르웨이 가재25의 스펙트럼 민감도 따라 붉은 빛 조건 하에서 동물 들과 함께 모든 단계를 수행 합니다. 새 환경 순응 실험 시설 간의 동물을 이동, 빛, 랍 스타는 아이스 박스를 커버 하는 불투명 한 검은 가방을 사용 하 여 어떤 노출 하지 않도록 합니다.

- 이전 약 7 ° c.에 물과 함께 4 개의 침수 구획으로 구분 하는 아이스 박스를 준비

- 4 태그 준비 이전 건설 하 고 빠른 접착제, cyanoacrylate 처럼.

- 짓 눌린 얼음 트레이 준비 합니다.

- 새 환경 순응 시설에 태그 하는 아이스 박스의 구획에 그들의 각각을 넣어 4 바닷가재를 선택 합니다.

-

30 분 대기 하 고, 다음, 태그 절차를 시작.

- 새우 하 고 5 분 그것을 무력화 하 고 태그 작업을 용이 하 게 분쇄 한 얼음에 넣어.

- 랍스터의 cephalothorax 흡착 종이 위쪽 부분을 건조 하 고 그것에 빠른 접착제의 방울을 넣어.

- 태그 동물의 cephalothorax, 접착제, 접촉 위에 가로로 놓고 강화에 그것에 대 한 충분 한 시간을 기다려 (약 20 s).

- 랍스터는 아이스 박스에 그 구획을 반환 하 고 다른 3 개의 동물 같은 방식으로 진행.

- 어디 그들이 이전 셀에 다시는 가재를 넣어 고 확실 하 게 태그에 붙어 제대로 하는 24 h에 대 한 기다립니다.

- 새 환경 순응 시설에서 태그 절차에 사용 된 동일한 아이스 박스를 사용 하 여 실험 챔버는 바닷가재를 전송.

- 비디오 녹화를 시작 하 고 태그 바닷가재를 도입 하기 전에 5 분 기다립니다. 초기 100 프레임에서 평균된 배경 이미지를 가져옵니다.

참고: 필수 태그 랍 스타; 없이 배경 프레임을 얻을 수는 최소 1 분 대기 그들은 비디오 처리를 위해 필요 합니다. - 동물 실험 탱크에 하나 하나 그들의 각각 구획 안쪽에 물 유지를 소개 합니다.

- 나가야; 그들에 대 한 대기 그들은 밖으로 서 하지 않으면, 그들을 도울 부드럽게 구획을 기울이기로. 실험 조건 하에서 탱크 안에 동물의 예를 들어 그림 4 를 참조 하십시오.

그림 4 : 원시 비디오 프레임. 시간 경과 비디오 중에서 대표적인 프레임의 예로 실험 기간 동안 수집. 오른쪽 상단 모서리에서 우리는 날짜, 시간, 및 프레임 타임 스탬프를 보여줍니다. 이미지의 하단에서 탱크 조명에 차이 알 수 있습니다. 이 그림의 더 큰 버전을 보려면 여기를 클릭 하십시오.

5. 비디오 분석 스크립트

-

실험의 완료 후 분석을 수행 합니다.

- 비디오 분석을 위한 컴퓨터 비전 스크립트를 시작 합니다.

- 위치와 거리는 랍 스타 적용 계산을 자바 프로그램을 실행 하 고 데이터베이스에 데이터를 삽입.

참고: 이 프로그램은 유클리드 거리 기반 알고리즘28. - 원하는 시간 간격으로 데이터를 범주화 하는 SQL 스크립트 실행 (예: 10 분).

6. 컴퓨터 비전 스크립트 비디오 분석에 대 한

참고: 실험 설정에 관련 된 오류를 소개 하지 않습니다 때문에 스크립트 fisheye 이미지 보정을 방지 합니다. 그럼에도 불구 하 고, OpenCV 카메라 캘리브레이션 기능29 벡터 및 행렬 회전 방법30,31에 따라 해결이 가능 하다.

- Python18 프로그램 언어를 선택 합니다.

- OpenCV19 이미지 및 비디오 처리 라이브러리를 선택 합니다.

- 비디오를 로드 합니다.

참고: 비디오 포맷.avi 또는 입니다. mp4이이 실험에 사용 되었다 그러나 이것은 필수. 그것은 운영 체제에 설치 된 FourCC32 코덱에 따라 다릅니다. -

각 프레임 인터넷 비디오에 대 한 다음 단계를 수행 합니다.

- 배경20B (단계 4.6에서에서 얻은 마지막 100 프레임의 평균) 빼기에서 Fi, 프레임과 배경 이미지 B Fi로 업데이트. OpenCV19 라이브러리에서 BackgroundSubtractorMOG2 함수를 사용 하 여 ( 보충 파일 2에서 스크립트 참조).

- 관심 (ROIs) R 관련 모션 배경 뺄셈으로 표시 된 픽셀에서 영역 집합을 결정 합니다. OpenCV19 라이브러리에는 방법 적용 BackgroundSubtractorMOG2 에서 사용 ( 보조 파일 2에서 스크립트 참조). 설정, 계정 nonmoving 동물에 이전 프레임에서 동물 탐지를 포함 합니다.

- 각 투자 수익 Ri 에 대 한 다음 단계를 수행

- 같은데요 함수를 적용 하 고 계산 ROI Ri의 등고선33 . OpenCV19 라이브러리에서 기능 확장 및 findContours 사용 ( 보조 파일 2에서 스크립트 참조).

- 선체 지역34안녕하세요 픽셀 수에 계산. OpenCV19 라이브러리에서 convexHull 함수 사용 하 여 ( 보충 파일 2에서 스크립트 참조).

- Radius35계산리 Ri의 투자 수익. OpenCV19 라이브러리에서 minEnclosingCircle 함수 사용 하 여 ( 보충 파일 2에서 스크립트 참조).

- Ri의 투자 수익 입체 시 를 계산 합니다. 견고의 볼록 선체 지역 (단계 6.4.3.2에서에서 얻은) Ri의 윤곽 영역 (단계 6.4.3.1에서에서 얻은)의 비율입니다.

- Ri의 투자 수익 가로 세로 비율 ai 를 계산 합니다. 가로 세로 비율 Ri높이 너비 사이의 비율입니다-경계 사각형. 경계 사각형 OpenCV19 라이브러리에서 boundingRect 함수 사용 하 여 계산 됩니다.

- 선체 지역, 반지름, 견고, 및 가로 세로 비율에 대 한 속성을 조정 하 여 동물을 포함 하는 후보로 ROIs의 감소 집합을 선택 합니다.

- 안녕하세요 인지 확인 500.0 보다 작거나 100000.0보다 큰 합니다. 그렇다면, Ri의 투자 수익 버리십시오. 그렇지 않으면, 동물의 위치에 대 한 투자 수익으로 Ri 를 유지.

- Ri 40.0미만 인지 확인 합니다. 그렇다면, Ri의 투자 수익 버리십시오. 그렇지 않으면, 동물의 위치에 대 한 투자 수익으로 Ri 를 유지.

- Si -4.0 삭제 Ri의 투자 수익 보다는 더 적은 인지 확인 합니다. 그렇지 않으면, 동물의 위치에 대 한 투자 수익으로 Ri 를 유지.

- Ai 0.15 보다 작거나 4.0이상 인지 확인 합니다. 그래서, Ri의 투자 수익 삭제. 그렇지 않으면, 동물의 위치에 대 한 투자 수익으로 Ri 를 유지.

참고: ROIs 사용 하 여 동물의 신체 영역에 태그 검색 초점 계산 비용을 줄일 수 있습니다. 이전 프레임에서 동물 탐지 동물 이동 하지 않는 경우 잘못 된 탐지를 피하기 위해 포함 되어 있습니다.

- 동물 태그 id를 확인 하려면 ROIs를 분석 합니다. 드 및 각 내부 투자 수익 Pi, 각 ROI Ri 에 대 한 단계를 실행 하 고 내부 ROIs P를 추출 합니다.

- 회색 음영 이미지 Pi 오쓰36 임계 처리 알고리즘을 사용 하 여 binarize

- 6.4.3.1 단계에서 Pi의 등고선33 을 계산 합니다.

- 선체 지역34안녕 및 가로 세로 비율 ai, 단계 6.4.3.2 및 6.4.3.5로 계산 합니다.

- 모양 순간37,38마일 Pi의 계산 합니다. OpenCV19 라이브러리에서 사용 하는 기능 순간 ( 보충 파일 2에서 스크립트 참조).

- 다음과 같은 기준을 사용 하 여 태그를 포함 하는 후보로 ROIs의 감소 집합을 선택 합니다.

- 안녕하세요 인지 150.0 보다 작거나 500.0보다 큰 확인 하십시오. 그렇다면, Pi투자 수익 버리십시오. 그렇지 않으면, 태그 위치에 대 한 투자 수익으로 Pi 를 유지.

- Ai 가 0.5 보다 작거나 1.5보다 큰 인지 확인 합니다. 그렇다면, Pi투자 수익 버리십시오. 그렇지 않으면, 동물의 위치에 대 한 투자 수익으로 Pi 를 유지.

- 미 0.3보다 큰 인지 확인 합니다. 그렇다면, Pi투자 수익 버리십시오. 그렇지 않으면, 동물의 위치에 대 한 투자 수익으로 Pi 를 유지.

- 태그 ROIs를 분류 합니다. 대략적인 각 선택 된 ROI Pi19OpenCV19 기능38 을 사용 하 여 다각형39 .

- 근접된 다각형; 정확히 세 꼭지점 인지 확인 삼각형 클래스에 태그를 지정 합니다. 그렇지 않으면, 태그 영역에 circle 클래스를 할당 합니다.

참고: 근접된 다각형 정점으로 행렬을 사용 하 여 저장 됩니다. - 투자 수익 Pi의 중앙 픽셀을 선택 합니다. 그것은 검은 픽셀, 숨어 클래스에 Pi 를 할당 합니다. 그렇지 않으면, 흰색 클래스에 Pi 를 할당 합니다.

참고: 모양 센터 단계 6.4.5.4에서에서 계산 하는 순간부터 추론 이다. 4 픽셀 반경 중심의 영역에 검정 픽셀을 검색 합니다.

- 근접된 다각형; 정확히 세 꼭지점 인지 확인 삼각형 클래스에 태그를 지정 합니다. 그렇지 않으면, 태그 영역에 circle 클래스를 할당 합니다.

- 프레임 데이터 저장: 프레임 날짜, 프레임 시간, 모양 센터 모양 좌표 및 y 센터 모양 좌표 x 클래스.

- 다음 프레임으로 하거나 프로세스를 종료. 시계 작동 하는 스크립트의 예를 들어 비디오 1 및 작업 스크립트 단계의 시각적 예제로 아래 그림 5 를 참조 하십시오.

그림 5 : 비디오 처리 하시기의 관련 단계 (1) 평가 마지막 100의 평균에 배경 빼기 모션 프레임. (2) 배경 빼기 알고리즘의 결과. (3) 적용 화이트 감지 영역에 같은데요 형태학 작업. (4) 적용 수정, 정적, 주요 투자 수익; 노란 다각형 하단 탱크 영역에 해당합니다. (5) 주요 투자 수익에서 각 화이트 감지 영역에 대 한 윤곽을 계산 하 고 각 검색 된 윤곽선에 대 한 구조적 분석을 수행. (6) 구조 속성 값을 확인 하 고, 두 번째 수준의 투자 수익 후보자를 선택 합니다. (7) Binarize; 오쓰 임계 처리 알고리즘을 사용 하 여 프레임 스크립트 2 수준 ROIs 에서만 작동합니다. (8) 각 2 차 투자 수익 binarized, 대 한 흰색 영역의 윤곽선을 계산 하 고 각 윤곽선 검출 구조 분석을 수행. (9) 확인 구조 속성 값, 내부 투자 수익 후보자를 선택 합니다. (10)는 내부 투자 수익에서에서 각 윤곽선에 대 한 설명자/순간 계산. (11) 모델과 일치 하는 검색 된 모양 형성 하 고 최고의 경기 후보에 다각형을 대략적인 검사. (12) 대략적인 다각형의 꼭지점의 수를 확인 하 고 기하학적 인 그림을 결정: 원 또는 삼각형. (13) 계산 그림 센터와 확인 검은 픽셀 발생; 그렇다면, 숨어 인물 이다입니다. (14) 프레임 분석 후 시각적 결과입니다. 이 그림의 더 큰 버전을 보려면 여기를 클릭 하십시오.

Access restricted. Please log in or start a trial to view this content.

결과

우리는 수동으로 자동된 비디오 분석을 확인 하기 위해 실험 데이터의 하위 집합을 건설 한다. 1,308 프레임의 샘플 크기 (샘플 오류의 여백 내에서 인구를 정확 하 게 반영 여부를 보여 주는 보안의 측정 인) 99%의 신뢰 수준 및 4%의 오차의 한계를 (는 백분율로 얼마나 가까운 설명 하는 샘플 준 응답은 인구에 있는 실제 값 이다) 무작위로 선택 했다 ROIs의 올바른 식별 및 각 R...

Access restricted. Please log in or start a trial to view this content.

토론

비디오 추적 프로토콜 성능 및 대표 결과 사회 변조 및 cohoused 동물의 circadian 리듬에 특정 초점으로 동물 행동 분야에서 응용된 연구에 대 한 유효성을 확인 했다. 동물 검색 (69%)의 효율성 그리고 태그 차별 (89.5%)의 정확도 사용 대상 동물의 행동 특성 (즉, 이동 속도)과 함께 여기는 것이 좋습니다이 프로토콜 장기 실험 시험 (예를 들어, 일 및 주)에 대 한 완벽 한 솔루션. 또한, 프로토콜의 개발에 ?...

Access restricted. Please log in or start a trial to view this content.

공개

저자는 공개 없다.

감사의 말

저자는이 작품의 출판 자금 박사 조 안 나 회사에 감사. 또한, 저자는 실험적인 작품 하는 동안 그들의 도움에 대 한 실험 수족관 영역에서의 해양 과학 연구소 (ICM-CSIC) 바르셀로나에서의 기술자에 게 감사.

이 작품은 RITFIM 프로젝트에 의해 지원 되었다 (CTM2010-16274; 연구 책임자: J. Aguzzi) 과학 스페인 교육부 및 혁신 (MICINN), 및 경제와 경쟁력의 스페인 정부에서 TIN2015-66951-c 2-2-R 그랜트에 의해 설립.

Access restricted. Please log in or start a trial to view this content.

자료

| Name | Company | Catalog Number | Comments |

| Tripod 475 | Manfrotto | A0673528 | Discontinued |

| Articulated Arm 143 | Manfrotto | D0057824 | Discontinued |

| Camera USB 2.0 uEye LE | iDS | UI-1545LE-M | https://en.ids-imaging.com/store/products/cameras/usb-2-0-cameras/ueye-le.html |

| Fish Eye Len C-mount f = 6 mm/F1.4 | Infaimon | Standard Optical | https://www.infaimon.com/es/estandar-6mm |

| Glass Fiber Tank 1500 x 700 x 300 mm3 | |||

| Black Felt Fabric | |||

| Wood Structure Tank | 5 Wood Strips 50x50x250 mm | ||

| Wood Structure Felt Fabric | 10 Wood Strips 25x25x250 mm | ||

| Stainless Steel Screws | As many as necessary for fix wood strips structures | ||

| PC | 2-cores CPU, 4GB RAM, 1 GB Graphics, 500 GB HD | ||

| External Storage HDD | 2 TB capacity desirable | ||

| iSPY Sotfware for Windows PC | iSPY | https://www.ispyconnect.com/download.aspx | |

| Zoneminder Software Linux PC | Zoneminder | https://zoneminder.com/ | |

| OpenCV 2.4.13.6 Library | OpenCV | https://opencv.org/ | |

| Python 2.4 | Python | https://www.python.org/ | |

| Camping Icebox | |||

| Plastic Tray | |||

| Cyanocrylate Gel | To glue tag’s | ||

| 1 black PVC plastic sheet (1 mm thickness) | Tag's construction | ||

| 1 white PVC plastic sheet (1 mm thickness) | Tag's construction | ||

| 4 Tag’s Ø 40 mm | Maked with black & white PVC plastic sheet | ||

| 3 m Blue Strid Led Ligts (480 nm) | Waterproof as desirable | ||

| 3 m IR Strid Led Ligts (850 nm) | Waterproof as desirable | ||

| 6 m Methacrylate Pipes Ø 15 mm | Enclosed Strid Led | ||

| 4 PVC Elbow 45o Ø 63 mm | Burrow construction | ||

| 3 m Flexible PVC Pipe Ø 63 mm | Burrow construction | ||

| 4 PVC Screwcap Ø 63 mm | Burrow construction | ||

| 4 O-ring Ø 63 mm | Burrow construction | ||

| 4 Female PVC socket glue / thread Ø 63 mm | Burrow construction | ||

| 10 m DC 12V Electric Cable | Light Control Mechanism | ||

| Ligt Power Supply DC 12 V 300 W | Light Control Mechanism | ||

| MOSFET, RFD14N05L, N-Canal, 14 A, 50 V, 3-Pin, IPAK (TO-251) | RS Components | 325-7580 | Light Control Mechanism |

| Diode, 1N4004-E3/54, 1A, 400V, DO-204AL, 2-Pines | RS Components | 628-9029 | Light Control Mechanism |

| Fuse Holder | RS Components | 336-7851 | Light Control Mechanism |

| 2 Way Power Terminal 3.81 mm | RS Components | 220-4658 | Light Control Mechanism |

| Capacitor 220 µF 200 V | RS Components | 440-6761 | Light Control Mechanism |

| Resistance 2K2 7 W | RS Components | 485-3038 | Light Control Mechanism |

| Fuse 6.3 x 32 mm2 3A | RS Components | 413-210 | Light Control Mechanism |

| Arduino Uno Atmel Atmega 328 MCU board | RS Components | 715-4081 | Light Control Mechanism |

| Prototipe Board CEM3,3 orific.,RE310S2 | RS Components | 728-8737 | Light Control Mechanism |

| DC/DC converter,12 Vin,+/-5 Vout 100 mA 1 W | RS Components | 689-5179 | Light Control Mechanism |

| 2 SERA T8 blue moonlight fluorescent bulb 36 watts | SERA | Discontinued/Light isolated facility |

참고문헌

- Dell, A. I., et al. Automated image-based tracking and its application in ecology. Trends in Ecology & Evolution. 29 (7), 417-428 (2014).

- Berman, G. J., Choi, D. M., Bialek, W., Shaevitz, J. W. Mapping the stereotyped behaviour of freely moving fruit flies. Journal of The Royal Society Interface. 11 (99), (2014).

- Mersch, D. P., Crespi, A., Keller, L. Tracking Individuals Shows Spatial Fidelity Is a Key Regulator of Ant Social Organization. Science. 340 (6136), 1090(2013).

- Tyson, L. Hedrick Software techniques for two- and three-dimensional kinematic measurements of biological and biomimetic systems. Bioinspiration & Biomimetics. 3 (3), 034001(2008).

- Branson, K., Robie, A. A., Bender, J., Perona, P., Dickinson, M. H. High-throughput ethomics in large groups of Drosophila. Nature Methods. 6 (6), 451-457 (2009).

- de Chaumont, F., et al. Computerized video analysis of social interactions in mice. Nature Methods. 9, 410(2012).

- Pérez-Escudero, A., Vicente-Page, J., Hinz, R. C., Arganda, S., de Polavieja, G. G. idTracker: tracking individuals in a group by automatic identification of unmarked animals. Nature Methods. 11 (7), 743-748 (2014).

- Fiala, M. ARTag, a fiducial marker system using digital techniques. 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR’05). 2, 590-596 (2005).

- Koch, R., Kolb, A., Rezk-Salama, C. CALTag: High Precision Fiducial Markers for Camera Calibration. Koch, R., Kolb, A., Rezk-salama, C. , (2010).

- Crall, J. D., Gravish, N., Mountcastle, A. M., Combes, S. A. BEEtag: A Low-Cost, Image-Based Tracking System for the Study of Animal Behavior and Locomotion. PLOS ONE. 10 (9), e0136487(2015).

- Charpentier, R. Free and Open Source Software: Overview and Preliminary Guidelines for the Government of Canada. Open Source Business Resource. , (2008).

- Crowston, K., Wei, K., Howison, J. Free/Libre Open Source Software Development: What We Know and What We Do Not Know. ACM Computing Surveys. 37, (2012).

- Edmonds, N. J., Riley, W. D., Maxwell, D. L. Predation by Pacifastacus leniusculus on the intra-gravel embryos and emerging fry of Salmo salar. Fisheries Management and Ecology. 18 (6), 521-524 (2011).

- Sbragaglia, V., et al. Identification, Characterization, and Diel Pattern of Expression of Canonical Clock Genes in Nephrops norvegicus (Crustacea: Decapoda) Eyestalk. PLOS ONE. 10 (11), e0141893(2015).

- Sbragaglia, V., et al. Dusk but not dawn burrow emergence rhythms of Nephrops norvegicus (Crustacea: Decapoda). Scientia Marina. 77 (4), 641-647 (2013).

- Katoh, E., Sbragaglia, V., Aguzzi, J., Breithaupt, T. Sensory Biology and Behaviour of Nephrops norvegicus. Advances in Marine Biology. 64, 65-106 (2013).

- Sbragaglia, V., Leiva, D., Arias, A., Antonio García, J., Aguzzi, J., Breithaupt, T. Fighting over burrows: the emergence of dominance hierarchies in the Norway lobster (Nephrops norvegicus). The Journal of Experimental Biology. 220 (24), 4624-4633 (2017).

- Welcome to Python.org. , https://www.python.org/ (2018).

- Bradski, G. OpenCV Library. Dr. Dobb’s Journal of Software Tools. , (2000).

- Piccardi, M. Background subtraction techniques: a review. 2004 IEEE International Conference on Systems, Man and Cybernetics (IEEE Cat. No.04CH37583). 4, 3099-3104 (2004).

- Sankur, B. Survey over image thresholding techniques and quantitative performance evaluation. Journal of Electronic Imaging. 13 (1), 146(2004).

- Lai, Y. K., Rosin, P. L. Efficient Circular Thresholding. IEEE Transactions on Image Processing. 23 (3), 992-1001 (2014).

- Gaten, E. Light‐induced damage to the dioptric apparatus of Nephrops norvegicus (L.) and the quantitative assessment of the damage. Marine Behaviour and Physiology. 13 (2), 169-183 (1988).

- Sbragaglia, V., et al. An automated multi-flume actograph for the study of behavioral rhythms of burrowing organisms. Journal of Experimental Marine Biology and Ecology. 446, 177-186 (2013).

- Johnson, M. L., Gaten, E., Shelton, P. M. J. Spectral sensitivities of five marine decapod crustaceans and a review of spectral sensitivity variation in relation to habitat. Journal of the Marine Biological Association of the United Kingdom. 82 (5), 835-842 (2002).

- Markager, S., Vincent, W. F. Spectral light attenuation and the absorption of UV and blue light in natural waters. Limnology and Oceanography. 45 (3), 642-650 (2000).

- Aguzzi, J., et al. A New Laboratory Radio Frequency Identification (RFID) System for Behavioural Tracking of Marine Organisms. Sensors. 11 (10), 9532-9548 (2011).

- Audin, M. Geometry [Electronic Resource. , Springer Berlin Heidelberg:, Imprint: Springer. Berlin, Heidelberg. (2003).

- OpenCV Team Structural Analysis and Shape Descriptors - OpenCV 2.4.13.7 documentation. , https://docs.opencv.org/2.4/modules/imgproc/doc/structural_analysis_and_shape_descriptors.html?highlight=findcontours#void%20HuMoments(const%20Moments&%20m,%20OutputArray%20hu) (2018).

- Slabaugh, G. G. Computing Euler angles from a rotation matrix. 7, (1999).

- Zhang, Z. A flexible new technique for camera calibration. IEEE Transactions on Pattern Analysis and Machine Intelligence. 22 (11), 1330-1334 (2000).

- www.FOURCC.org - Video Codecs and Pixel Formats. , https://www.fourcc.org/ (2018).

- Suzuki, S., be, K. Topological structural analysis of digitized binary images by border following. Computer Vision, Graphics, and Image Processing. 30 (1), 32-46 (1985).

- Sklansky, J. Finding the convex hull of a simple polygon. Pattern Recognition Letters. 1 (2), 79-83 (1982).

- Fitzgibbon, A., Fisher, R. A Buyer’s Guide to Conic Fitting. , 51.1-51.10 (1995).

- Otsu, N. A Threshold Selection Method from Gray-Level Histograms. IEEE Transactions on Systems, Man, and Cybernetics. 9 (1), 62-66 (1979).

- Hu, M. K. Visual pattern recognition by moment invariants. IRE Transactions on Information Theory. 8 (2), 179-187 (1962).

- Structural Analysis and Shape Descriptors - OpenCV 2.4.13.6 documentation. , https://docs.opencv.org/2.4/modules/imgproc/doc/structural_analysis_and_shape_descriptors.html?highlight=cvmatchshapes#humoments (2018).

- Douglas, D. H., Peucker, T. K. Algorithms for the Reduction of the Number of Points Required to Represent a Digitized Line or its Caricature. Cartographica: The International Journal for Geographic Information and Geovisualization. 10 (2), 112-122 (1973).

- Vanajakshi, B., Krishna, K. S. R. Classification of boundary and region shapes using Hu-moment invariants. Indian Journal of Computer Science and Engineering. 3, 386-393 (2012).

- Kahle, D., Wickham, H. ggmap : Spatial Visualization with ggplot2. The R Journal. , 144-162 (2013).

- Venables, W. N., Ripley, B. D. Modern Applied Statistics with S. , Springer. New York. (2010).

- Abbas, Q., Ibrahim, M. E. A., Jaffar, M. A. A comprehensive review of recent advances on deep vision systems. Artificial Intelligence Review. , (2018).

- Menesatti, P., Aguzzi, J., Costa, C., García, J. A., Sardà, F. A new morphometric implemented video-image analysis protocol for the study of social modulation in activity rhythms of marine organisms. Journal of Neuroscience Methods. 184 (1), 161-168 (2009).

- Chapman, C. J., Shelton, P. M. J., Shanks, A. M., Gaten, E. Survival and growth of the Norway lobster Nephrops norvegicus in relation to light-induced eye damage. Marine Biology. 136 (2), 233-241 (2000).

- Video tracking software | EthoVision XT. , https://www.noldus.com/animal-behavior-research/products/ethovision-xt (2018).

- Correll, N., Sempo, G., Meneses, Y. L. D., Halloy, J., Deneubourg, J., Martinoli, A. SwisTrack: A Tracking Tool for Multi-Unit Robotic and Biological Systems. 2006 IEEE/RSJ International Conference on Intelligent Robots and Systems. , 2185-2191 (2006).

- MATLAB - MathWorks. , https://www.mathworks.com/products/matlab.html (2018).

- Leggat, P. A., Smith, D. R., Kedjarune, U. Surgical Applications of Cyanoacrylate Adhesives: A Review of Toxicity. ANZ Journal of Surgery. 77 (4), 209-213 (2007).

- Dizon, R. M., Edwards, A. J., Gomez, E. D. Comparison of three types of adhesives in attaching coral transplants to clam shell substrates. Aquatic Conservation: Marine and Freshwater Ecosystems. 18 (7), 1140-1148 (2008).

- Cary, R. Methyl cyanoacrylate and ethyl cyanoacrylate. , World Health Organization. Geneva. (2001).

- Krizhevsky, A., Sutskever, I., Hinton, G. E. Imagenet classification with deep convolutional neural networks. Advances in neural information processing systems. , http://papers.nips.cc/paper/4824-imagenet-classification-w 1097-1105 (2012).

Access restricted. Please log in or start a trial to view this content.

재인쇄 및 허가

JoVE'article의 텍스트 или 그림을 다시 사용하시려면 허가 살펴보기

허가 살펴보기This article has been published

Video Coming Soon

Copyright © 2025 MyJoVE Corporation. 판권 소유