Zum Anzeigen dieser Inhalte ist ein JoVE-Abonnement erforderlich. Melden Sie sich an oder starten Sie Ihre kostenlose Testversion.

Method Article

Anwendung der indikierten visuellen Stimuli während der Objektübertragung mit Vibro-Taktile Feedback

In diesem Artikel

Zusammenfassung

Wir stellen ein Protokoll vor, um inkongruente visuell-taktile Reize während einer Objektübertragungsaufgabe anzuwenden. Insbesondere zeigt eine virtuelle Darstellung des Blocks bei der Verborgung des Blattes während der verborgenen Sperrangabe zufällige Erscheinungen falscher Blocktropfen. Das Protokoll beschreibt auch das Hinzufügen von vibrotactilen Feedback während der Motoraufgabe.

Zusammenfassung

Die Anwendung von inkongruenten sensorischen Signalen, die ein gestörtes taktiles Feedback beinhalten, wird selten erforscht, insbesondere mit dem Vorhandensein von vibrotaktilen Rückkopplungen (VTF). Dieses Protokoll zielt darauf ab, die Wirkung von VTF auf die Reaktion auf inkongruente visuell-taktile Reize zu testen. Die taktile Rückkopplung wird durch das Erfassen eines Blocks und das Verschieben über eine Partition gewonnen. Das visuelle Feedback ist eine virtuelle Echtzeit-Präsentation des bewegten Blocks, der mit einem Motion Capture-System aufgenommen wird. Das übereinstimmende Feedback ist die zuverlässige Darstellung der Bewegung des Blocks, so dass das Subjekt das Gefühl hat, dass der Block gepackt wird und sehen, wie er sich mit dem Pfad der Hand bewegt. Das inkongruente Feedback erscheint, wenn die Bewegung des Blocks vom eigentlichen Bewegungsweg abweicht, so dass er aus der Hand zu fallen scheint, wenn er tatsächlich noch vom Subjekt gehalten wird, und damit dem taktilen Feedback widerspricht. Zwanzig Probanden (Alter 30,2 ± 16,3) wiederholten 16 Blocktransfers, während ihre Hand versteckt war. Diese wurden mit VTF und ohne VTF wiederholt (insgesamt 32 Blocktransfers). Unpassende Reize wurden innerhalb der 16 Wiederholungen in jedem Zustand (mit und ohne VTF) zufällig zweimal dargestellt. Jedes Thema wurde gebeten, den Schwierigkeitsgrad der Ausführung der Aufgabe mit und ohne VTF zu bewerten. Es gab keine statistisch signifikanten Unterschiede in der Länge der Handwege und der Dauer zwischen den Transfers, die mit übereinstimmenden und inkongruenten visuell-taktilen Signalen aufgezeichnet wurden, – mit und ohne VTF. Der wahrgenommene Schwierigkeitsgrad der Ausführung der Aufgabe mit dem VTF korrelierte signifikant mit der normalisierten Pfadlänge des Blocks mit VTF (r = 0,675, p = 0.002). Mit diesem Setup wird der additive oder reduktive Wert von VTF während der Motorfunktion quantifiziert, die inkongruente visuell-taktile Reize beinhaltet. Mögliche Anwendungen sind Prothetik-Design, intelligente Sportbekleidung oder andere Kleidungsstücke, die VTF enthalten.

Einleitung

Illusionen sind Ausnutzung der Begrenzungen unserer Sinne, da wir irrtümlich Informationen wahrnehmen, die von der objektiven Realität abweichen. Unsere Wahrnehmungsabnahme basiert auf unserer Erfahrung bei der Interpretation von Sinnesdaten und auf der Berechnung unseres Gehirns der zuverlässigsten Einschätzung der Realität in Gegenwart von zweideutigem Sinneseingang1.

Eine Unterkategorie in der Erforschung von Illusionen ist eine, die inkongruente Sinnessignale kombiniert. Die Illusion, die sich aus inkongruenten Sinnessignalen ergibt, geht von der ständigen multisensorischen Integration hervor, die unser Gehirn durchführt. Während es zahlreiche Studien über die Unstimmigkeit in visuell-auditiven Signalen gibt, wird die Unstimmigkeit bei anderen Sinnespaaren weniger berichtet. Dieser Unterschied in der Anzahl der Berichte könnte auf die höhere Einfachheit bei der Gestaltung eines Setups zurückzuführen sein, das visuelle auditive Inkongruenz beinhaltet. Interessant sind jedoch Studien, die Ergebnisse im Zusammenhang mit anderen Sinnespaaren berichten. So wurde beispielsweise die Wirkung von inkongruenten visuellen haptischen Signalen auf die visuelle Empfindlichkeit2 mit Hilfe eines Systems untersucht, in dem die visuellen und haptischen Reize räumlich aufeinander abgestimmt wurden; Die haptische und visuelle Orientierung war jedoch identisch (kongruent) oder orthogonal (inkongruent). In einer anderen Studie wurde die Wirkung von inkongruenten visuell-taktilen Bewegungsreizen auf die wahrgenommene visuelle Bewegungsrichtung mit Hilfe eines visuell-taktilen kreuzmodalen Integrationsstimulators mit einer beleuchteten Tafel untersucht, die visuelle Reize und ein taktiles Tastenspiel präsentiert. Stimulator, der taktile Bewegungsreize mit beliebiger Bewegungsrichtung, Geschwindigkeit und Einrückungstiefe in der Haut3präsentiert. Es wurde vorgeschlagen, dass wir sowohl die statistische Verteilung der Aufgabe als auch unsere sensorische Ungewissheit intern repräsentieren und sie in einer Weise kombinieren, die mit einem leistungsoptimierenden bayerischen Prozess4übereinstimmt.

Virtuelle Realität hat die Fähigkeit, die visuelle Rückmeldung zum Thema zu täuschen, zu einer einfachen Aufgabe gemacht. Mehrere Studien nutzten multisensorische virtuelle Realität, um visuelle und somatosensorische Informationen zu fälschend zu beeinflussen. So wurde beispielsweise die virtuelle Realität kürzlich genutzt, um die Verkörperung im Körper eines Kindes zu induzieren, mit oder ohne Aktivierung einer kindlichen Sprachverzerrung5. In einem anderen Beispiel wurde die visuelle Darstellung des Gehweges während der Selbstbewegung erweitert und war daher mit dem Fahrdistanz, der durch körperbasierte Farben6zu spüren war, unvereinbar. Ein ähnliches Virtual-Reality-Setup wurdefür eine Radfahraktivität 7 entwickelt. Die gesamte erwähnte Literatur kombinierte aber nicht neben dem inkongruenten Signal auch keine Einmischung zu einem der Sinne. Wir haben uns für den taktilen Sinn entschieden, um eine solche Störung zu erhalten.

Unser taktiles Sinnessystem liefert direkte Hinweise darauf, ob ein Objekt erfasst wird. Wir gehen daher davon aus, dass bei einer Verzerrung oder Unverfügbarkeit des direkten visuellen Feedbacks die Rolle des taktilen Sinnessystems bei der Objektmanipulation im Vordergrund stehen wird. Was aber würde passieren, wenn auch der taktile Sinneskanal gestört würde? Dies ist ein mögliches Ergebnis der Verwendung von vibrotactilem Feedback (VTF) für die sensorische Vergrößerung, da es die Aufmerksamkeit der einzelnen8 erfasst. Heute wird das erweiterte Feedback verschiedener Modalitäten als externes Werkzeug verwendet, um unser internes sensorisches Feedback zu verbessern und die Leistung während des motorischen Lernens, im Sport und inder Rehabilitation zu verbessern.

Die Untersuchung von inkongruenten visuell-taktilen Reizen kann unser Verständnis für die Wahrnehmung des Sinneseinsatzes verbessern. Insbesondere die Quantifizierung des additiven oder reduktiven Wertes von VTF während der Motorfunktion, die inkongruente visuell-taktile Reize beinhaltet, kann bei der zukünftigen Prothetik Design, intelligenten Sportverschleiß, oder alle anderen Kleidungsstücke, die VTF enthalten helfen. Da Amputierten an der distalen Seite ihres Rückstands beraubt sind, könnte ihre tägliche Nutzung des VTF, eingebettet in die Prothese, um zum Beispiel das Wissen über das Erfassen zu vermitteln, die Wahrnehmung des visuellen Feedbacks beeinflussen. Das Verständnis des Wahrnehmungsmechanismus unter diesen Bedingungen wird es Ingenieuren ermöglichen, die VTF-Modalitäten zu perfektionieren, um den negativen Effekt auf die VTF-Nutzer zu verringern.

Wir haben uns zum Ziel gesetzt, die Wirkung von VTF auf die Reaktion auf inkongruente visuell-taktile Reize zu testen. In der vorgestellten Einrichtung wird das taktile Feedback durch das Erfassen eines Blocks und das Verschieben über eine Partition erfasst; Das visuelle Feedback ist eine virtuelle Echtzeit-Präsentation des bewegten Blocks und der Partition (aufgenommen mit einem Motion Capture System). Da das Motiv daran gehindert wird, die eigentliche Handbewegung zu sehen, ist die einzige visuelle Rückmeldung die virtuelle. Die übereinstimmende Rückmeldung ist die verlässliche Darstellung der Bewegung des Blocks, so dass das Subjekt das Gefühl hat, dass der Block gepackt wird und sieht, wie er sich mit dem Pfad der Hand bewegt. Das inkongruente Feedback erscheint, wenn die Bewegung des Blocks vom eigentlichen Bewegungsweg abweicht, so dass er aus der Hand zu fallen scheint, wenn er tatsächlich noch vom Subjekt gehalten wird, und damit dem taktilen Feedback widerspricht. Drei Hypothesen wurden getestet: Wenn ein Objekt mit virtuellem visuellen Feedback von einem Ort zum anderen bewegt wird, wird (i) der Pfad und die Dauer der Transaktionsbewegung des Objekts zunehmen, wenn inkongruente visuell-taktile Reize präsentiert werden, (ii) diese Änderung wird diese Änderung Erhöhen Sie sich, wenn inkongruente visuell-taktile Reize präsentiert werden und VTF auf dem beweglichen Arm aktiviert wird, und (iii) wird eine positive Korrelation zwischen dem wahrgenommenen Schwierigkeitsgrad der Ausführung der Aufgabe mit dem VTF aktiviert und dem Pfad und der Dauer des Transfer-Bewegung des Objekts. Die erste Hypothese stammt aus der oben genannten Literatur, die berichtet, dass verschiedene Modalitäten von inkongruentem Feedback unsere Reaktionen beeinflussen. Die zweite Hypothese bezieht sich auf die bisherigen Erkenntnisse, dass VTF die Aufmerksamkeit des Einzelnen auf sich zieht. Für die dritte Hypothese gingen wir davon aus, dass Subjekte, die durch den VTF mehr gestört wurden, dem virtuellen visuellen Feedback mehr vertrauen werden als ihrem taktilen Sinn.

Protokoll

Das folgende Protokoll folgt den Richtlinien der Ethikkommission für Humanforschung der Universität. Siehe Materialtabelle für die kommerziellen Produkte.

Hinweis: Nach der Zustimmung der Ethikkommission der Universität wurden 20 gesunde Personen (7 Männer und 13 Frauen, mittlere und Standardabweichung [SD] im Alter von 30,2 ± 16,3 Jahren) rekrutiert. Jedes Subjekt las und unterzeichnete ein informiertes Einwilligungsformular vor dem Prozess. Einschlusskriterien waren Rechtshänder ab 18 Jahren. Ausschlusskriterien waren neurologische oder orthopädische Beeinträchtigungen, die die oberen Extremitäten betreffen, oder unkorrigierte Sehbehinderungen. Die Themen waren naiv zu den Ereignissen des inkongruenten visuell-taktilen Feedbacks.

1. Vorbereitung vor Gericht

- Verwenden Sie die Holzkiste aus der Box und BlöckeTest 10. Die Abmessungen der Box sind 53,7 cm x 26,9 cm x 8,5 cm und in der Mitte ist eine 15,2 cm hohe Trennwand. Legen Sie eine weiche Schwammschicht auf beiden Seiten der Trennwand. Legen Sie sechs passive reflektierende Markierungen auf den Aspekt gegenüber dem Bildschirm, an den vier Ecken und an beiden Enden der Partition (Abbildung 1a).

- Verwenden Sie einen 3D-Drucker, um einen Würfel mit den Abmessungen von 2,5 cm x 2,5 cm x 2,5 cm zu fertigen, der an einem Sockel mit den Abmessungen 4,5 cm x 4,5 cm x 1 cm befestigt ist. Schneiden Sie vor dem Drucken jede Ecke des Sockels, um an jeder Ecke ein Quadrat von 1 cm x 1 cm zu schaffen (Abbildung 1a). An den vier Ecken der Basis passiven reflektierenden Markierungen befestigen.

- Legen Sie eine große Leinwand etwa 1,5 m vor einen Tisch, so dass ein Motiv, das hinter dem Tisch steht, etwa 2 m vom Bildschirm entfernt ist. Legen Sie den Kasten auf den Tisch, 10 cm von der Kante gegenüber dem Bildschirm.

- Verwenden Sie ein 6-Kamera-Bewegungsaufnahmesystem, das bei 100 Hz aktiviert ist, mit einem Plug-in, um die Partition und die Bewegung des Blocks in Echtzeit zu visualisieren (Abbildung1). Kalibrieren Sie das Bewegungsaufnahmesystem nach den Richtlinien des Herstellers, so dass der Block und die Teilung der Box als starre Körper erkannt werden.

Hinweis: Um die Illusion aufrecht zu erhalten, ist eine richtige Kalibrierung des Bewegungsaufnahmesystems und die Verwendung von kleinen Markern erforderlich, die fest am Block und der Partition befestigt sind.

2. Platzierung des vibrotaktilen Feedbacksystems zum Thema

Hinweis: Das hier beschriebene VTF-System wurde zuvoram 11., 12.,13.,14.

- Umleiten Sie das Motiv, Armbanduhr, Armbänder und Ringe zu entfernen. Befestigen Sie den VTF-Systemcontroller an den Unterarm des Motivs (Abbildung 2, linkes Bild).

- Befestigen Sie zwei dünne und flexible Kraftsensoren an den Palmar-Aspekt des Daumens und der Zeigefinger über eine dünne, schwammige Schicht (Abbildung2, rechtes Bild).

- Legen Sie eine Manschette auf die Haut des Oberarms des Motivs (Abbildung 2, linkes Bild) und verwenden Sie den Verschluss, um die Manschette bequem zu schließen. Die Manschette wird drei vibrotaktile Aktoren enthalten, die über eine Open-Source-elektronische Prototyping-Plattform mit einer Frequenz von 233 Hz in einem linearen Verhältnis zur von den Kraftsensoren wahrgenommene Kraft aktiviert werden. Die Kraftsensoren und Vibrotiklak-Antriebe sind über abgeschirmte elektrische Leitungen an die Open-Source-elektronische Prototyping-Plattform angeschlossen.

3. VTF-Aktivierung

- Drücken Sie den Knopf, um die Batterie zu aktivieren, die an der Steuerung befestigt ist (Abbildung 2, linkes Bild).

- Bitten Sie das Subjekt, die instrumentierten Finger des Kraftsensors (also Daumen und Zeigefinger) leicht zusammen zu drücken. Beachten Sie, dass das Thema ein Gefühl der Vibration auf dem Bereich unter der Manschette zu berichten.

- Bringen Sie das Motiv so gut wie möglich 10 Minuten lang zu trainieren, um den Block so leicht wie möglich zu greifen. Bitten Sie den Betreffenden, den Block zu heben, ihn zu bewegen und ihn mehrmals wieder auf den Tisch zu legen, um eine minimale Menge an Kraft auf den Block anzuwenden. Ermutigen Sie das Subjekt zu versuchen, die angewandte Kraft zu reduzieren, auch wenn der Block während des Greifens abgelegt wird.

4. Positionierung und Vorbereitung des Themas

- Weisen Sie das Subjekt an, in der Nähe des Tisches zu stehen (bis zu 10 cm davon entfernt), wo die Box und die Trennwand platziert sind.

- Legen Sie einen Teiler an den Rand des Tisches in der Nähe des Subjekts und über der Box, so dass das Subjekt nicht in der Lage ist, die Box zu sehen, aber leicht den Bildschirm vor ihm oder sie sehen kann (Abbildung 1a). Für den Teiler verwenden Sie ein hartes, nicht reflektierendes Material, vorzugsweise Holz, das auf vier Beinen befestigt ist, die die Anpassung ihrer Höhe erlauben, um Motive unterschiedlicher Höhe unterzubringen.

- Weisen Sie das Thema an, die Kopfhörer auf den Kopf zu stellen.

- Legen Sie den Block in die Mitte des rechten Faches der Box und führen Sie die Hand des Subjekts zu ihm.

5. Prozess zu Beginn

Hinweis: Die beschriebene Studie wird zweimal wiederholt, mit und ohne VTF (ein Cross-over-Design wird empfohlen, um einen Lerneffekt zu überprüfen). Um die Prüfung ohne VTF durchzuführen, schalten Sie die Batterie, die am Controller befestigt ist, aus (Abbildung 2).

- Aktivieren Sie die Software, die die Kameras des Motion Capture-Systems steuert.

- Wählen Sie im Bedienfeld der visuellen Feedback-Software (Abbildung 1b) ohne VTF, tippen Sie den Code des Motivs ein, klicken Sie auf Run, Connect, Openund Start.

- Weisen Sie das Subjekt an, 16 Wiederholungen durchzuführen, um den Block mit der instrumentierten Hand des Kraftsensors zu übertragen, während Sie die Bewegung des virtuellen Blocks auf dem Bildschirm betrachten (Abbildung 1b). Nach jedem Transfer bewegen Sie den Block über die Partition zurück an den Startort.

- Nachdem das Thema 16 Wiederholungen abgeschlossen hat, klicken Sie auf Stop.

- Bitten Sie das Subjekt, den Schwierigkeitsgrad der Durchführung der Aufgabe der Übertragung des Blocks 16-mal zweimal zu bewerten, mit und ohne den VTF, nach der folgenden Skala: ' 0 ' (überhaupt nicht schwierig), ' 1 ' (leicht schwierig), ' 2 ' (mäßig schwierig), ' 3 ' (sehr ), und ' 4 ' (extrem schwierig).

6. Post-Analyse

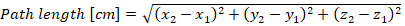

- Verwenden Sie die 3D-Koordinatendaten des Blocks, berechnen Sie den Pfad des Blocks und seine Übertragungszeit. Markieren Sie die Ein-und Offset-Zeit jeder Übertragung manuell, wie wenn sich der Block auf der Höhe der Felgen der rechten (einsetzenden) und dann linken (Offset-) Seiten der Box befindet. Berechnen Sie die Weglänge jeder Übertragung nach folgender Gleichung:

(1)

Wo

und wo sind die 3D-Koordinaten des Blocks in zwei nachfolgenden Zeitpunkten.

und wo sind die 3D-Koordinaten des Blocks in zwei nachfolgenden Zeitpunkten. - Für beide Bedingungen, mit und ohne VTF, ist der Durchschnitt der Wegelänge und die Übertragungszeit einmal für die beiden Transfers mit inkongruenten visuell-taktilen Signalen und einmal für die 14 Transfers mit den übereinstimmenden visuell-taktilen Signalen.

- Normalisiert den Pfad und die Zeit während der Blockübertragung in Anwesenheit von inkongruenten visuell-taktilen Signalen durch den Pfad und die Zeit während der Blockübertragung mit dem Vorhandensein von kongruenten visuell-taktilen Signalen. Führen Sie die Normalisierung für die beiden Bedingungen (mit und ohne VTF) separat durch.

- Führen Sie eine inbei-fach-Wiederholungs-Maßnahmen ANOVA mit zwei Faktoren: VTF (mit und ohne) und inkongruentes visuell-taktiles Feedback (mit und ohne).

- Wenn es keine statistischen Unterschiede bei der Analyse der Ergebnisse nach den Anweisungen in Abschnitt 6.4 gibt, verwenden Sie Bayesianische wiederholte Maßnahmen ANOVAs mit zwei Faktoren15.

- Verwenden Sie den Korrelationstest der Spearman mit dem wahrgenommenen Schwierigkeitsgrad der Ausführung der Aufgabe mit dem VTF aktiviert und mit dem normalisierten Pfad und der Dauer der Bewegung

- Setzen Sie die statistische Bedeutung auf p < .05.

Ergebnisse

Wir haben die beschriebene Technik benutzt, um die drei Hypothesen zu testen, dass beim Verschieben eines Objekts von einem Ort zum anderen mittels virtueller visueller Rückkopplung: (i) der Pfad und die Dauer der Transfer-Bewegung des Objekts zunehmen, wenn inkongruente visuell-taktile Reize Präsentiert; (ii) diese Veränderung wird zunehmen, wenn inkongruente visuell-taktile Reize präsentiert werden und VTF auf dem beweglichen Arm aktiviert wird; Und (iii) wird eine positive Korrelation zwischen dem wahrgenommenen S...

Diskussion

In dieser Studie wurde ein Protokoll vorgestellt, das die Wirkung des Zusatz von VTF auf die Objektübertragungskinematik in Anwesenheit von inkongruenten visuell-taktilen Reizen quantifiziert. Nach bestem Wissen und Gewissen ist dies das einzige verfügbare Protokoll, das die Wirkung von VTF auf die Reaktion auf inkongruente visuell-taktile Reize testet. Die verschiedenen kritischen Schritte, die bei der Anwendung von inkongruenten visuell-taktilen Reizen während der Objektübertragung mit VTF beteiligt sind, umfassen:...

Offenlegungen

Die Autoren haben nichts zu offenbaren.

Danksagungen

Diese Studie wurde nicht finanziert.

Materialien

| Name | Company | Catalog Number | Comments |

| 3D printer | Makerbot | https://www.makerbot.com/ | |

| Box and Blocks test | Sammons Preston | https://www.performancehealth.com/box-and-blocks-test | |

| Flexiforce sensors (1lb) | Tekscan Inc. | https://www.tekscan.com/force-sensors | |

| JASP | JASP Team | https://jasp-stats.org/ | |

| Labview | National Instruments | http://www.ni.com/en-us/shop/labview/labview-details.html | |

| Micro Arduino | Arduino LLC | https://store.arduino.cc/arduino-micro | |

| Motion capture system | Qualisys | https://www.qualisys.com | |

| Shaftless vibration motor | Pololu | https://www.pololu.com/product/1638 | |

| SPSS | IBM | https://www.ibm.com/analytics/spss-statistics-software |

Referenzen

- Aggelopoulos, N. C. Perceptual inference. Neuroscience and Biobehavioral Reviews. 55, 375-392 (2015).

- van der Groen, O., van der Burg, E., Lunghi, C., Alais, D. Touch influences visual perception with a tight orientation-tuning. PloS One. 8 (11), e79558 (2013).

- Pei, Y. C., et al. Cross-modal sensory integration of visual-tactile motion information: instrument design and human psychophysics. Sensors. 13 (6), 7212-7223 (2013).

- Kording, K. P., Wolpert, D. M. Bayesian integration in sensorimotor learning. Nature. 427 (6971), 244-247 (2004).

- Tajadura-Jimenez, A., Banakou, D., Bianchi-Berthouze, N., Slater, M. Embodiment in a Child-Like Talking Virtual Body Influences Object Size Perception, Self-Identification, and Subsequent Real Speaking. Scientific Reports. 7 (1), (2017).

- Campos, J. L., Butler, J. S., Bulthoff, H. H. Multisensory integration in the estimation of walked distances. Experimental Brain Research. 218 (4), 551-565 (2012).

- Sun, H. J., Campos, J. L., Chan, G. S. Multisensory integration in the estimation of relative path length. Experimental Brain Research. 154 (2), 246-254 (2004).

- Parmentier, F. B., Ljungberg, J. K., Elsley, J. V., Lindkvist, M. A behavioral study of distraction by vibrotactile novelty. Journal of Experimental Psychology, Human Perception, and Performance. 37 (4), 1134-1139 (2011).

- Sigrist, R., Rauter, G., Riener, R., Wolf, P. Augmented visual, auditory, haptic, and multimodal feedback in motor learning: a review. Psychonomic Bulletin & Review. 20 (1), 21-53 (2013).

- Hebert, J. S., Lewicke, J., Williams, T. R., Vette, A. H. Normative data for modified Box and Blocks test measuring upper-limb function via motion capture. Journal of Rehabilitation Research and Development. 51 (6), 918-932 (2014).

- Raveh, E., Portnoy, S., Friedman, J. Adding vibrotactile feedback to a myoelectric-controlled hand improves performance when online visual feedback is disturbed. Human Movement Science. 58, 32-40 (2018).

- Raveh, E., Friedman, J., Portnoy, S. Evaluation of the effects of adding vibrotactile feedback to myoelectric prosthesis users on performance and visual attention in a dual-task paradigm. Clinical Rehabilitation. 32 (10), 1308-1316 (2018).

- Raveh, E., Portnoy, S., Friedman, J. Myoelectric Prosthesis Users Improve Performance Time and Accuracy Using Vibrotactile Feedback When Visual Feedback Is Disturbed. Archives of Physical Medicine and Rehabilitation. , (2018).

- Raveh, E., Friedman, J., Portnoy, S. Visuomotor behaviors and performance in a dual-task paradigm with and without vibrotactile feedback when using a myoelectric controlled hand. Assistive Technology: The Official Journal of RESNA. , 1-7 (2017).

- Dienes, Z. Using Bayes to get the most out of non-significant results. Frontiers in Psychology. 5, 781 (2014).

- Shams, L., Murray, M. M., Wallace, M. T. Early Integration and Bayesian Causal Inference in Multisensory Perception. The Neural Bases of Multisensory Processes. , (2012).

- D'Amour, S., Pritchett, L. M., Harris, L. R. Bodily illusions disrupt tactile sensations. Journal of Experimental Psychology, Human Perception, and Performance. 41 (1), 42-49 (2015).

- Tidoni, E., Fusco, G., Leonardis, D., Frisoli, A., Bergamasco, M., Aglioti, S. M. Illusory movements induced by tendon vibration in right- and left-handed people. Experimental Brain Research. 233 (2), 375-383 (2015).

- Fuentes, C. T., Gomi, H., Haggard, P. Temporal features of human tendon vibration illusions. The European Journal of Neuroscience. 36 (12), 3709-3717 (2012).

- de Vignemont, F., Ehrsson, H. H., Haggard, P. Bodily illusions modulate tactile perception. Current Biology. 15 (14), 1286-1290 (2005).

- Marotta, A., Tinazzi, M., Cavedini, C., Zampini, M., Fiorio, M. Individual Differences in the Rubber Hand Illusion Are Related to Sensory Suggestibility. PloS One. 11 (12), e0168489 (2016).

- Stevenson, R. A., Zemtsov, R. K., Wallace, M. T. Individual differences in the multisensory temporal binding window predict susceptibility to audiovisual illusions. Journal of Experimental Psychology, Human Perception, and Performance. 38 (6), 1517-1529 (2012).

- Maravita, A., Spence, C., Driver, J. Multisensory integration and the body schema: close to hand and within reach. Current Biology. 13 (13), R531-R539 (2003).

- Carey, D. P. Multisensory integration: attending to seen and felt hands. Current Biology. 10 (23), R863-R865 (2000).

- Tsakiris, M., Haggard, P. The rubber hand illusion revisited: visuotactile integration and self-attribution. Journal of Experimental Psychology, Human Perception, and Performance. 31 (1), 80-91 (2005).

Nachdrucke und Genehmigungen

Genehmigung beantragen, um den Text oder die Abbildungen dieses JoVE-Artikels zu verwenden

Genehmigung beantragenThis article has been published

Video Coming Soon

Copyright © 2025 MyJoVE Corporation. Alle Rechte vorbehalten