Method Article

Erfassung dynamischer Fingergesten mit hochauflösender Oberflächen-Elektromyographie und Computer Vision

In diesem Artikel

Zusammenfassung

In der Arbeit wird ein umfassendes Protokoll zur gleichzeitigen Aufzeichnung der Hand-Elektromyographie (EMG) und des visuellen Fingertrackings während der natürlichen Fingergestik vorgestellt. Die visuellen Daten sollen als Grundlage für die Entwicklung präziser EMG-basierter Rechenmodelle für die Gestenerkennung von Fingern dienen.

Zusammenfassung

Fingergesten sind ein kritisches Element in der menschlichen Kommunikation, und als solches wird die Fingergestenerkennung als Mensch-Computer-Schnittstelle für modernste Prothesen und optimierte Rehabilitation umfassend untersucht. Die Oberflächen-Elektromyographie (sEMG) in Verbindung mit Deep-Learning-Methoden gilt als vielversprechende Methode in diesem Bereich. Aktuelle Methoden beruhen jedoch oft auf umständlichen Aufzeichnungsaufbauten und der Identifizierung statischer Handpositionen, was ihre Wirksamkeit in der Praxis einschränkt. Das Protokoll, über das wir hier berichten, stellt einen fortschrittlichen Ansatz vor, der ein tragbares Oberflächen-EMG und ein Finger-Tracking-System kombiniert, um umfassende Daten bei dynamischen Handbewegungen zu erfassen. Die Methode zeichnet die Muskelaktivität von weich gedruckten Elektrodenarrays (16 Elektroden) auf, die auf dem Unterarm platziert werden, während die Probanden Gesten in verschiedenen Handpositionen und während der Bewegung ausführen. Visuelle Anweisungen fordern die Probanden auf, bestimmte Gesten auszuführen, während EMG und Fingerpositionen aufgezeichnet werden. Die Integration von synchronisierten EMG-Aufzeichnungen und Fingertracking-Daten ermöglicht eine umfassende Analyse von Muskelaktivitätsmustern und entsprechenden Gesten. Der vorgestellte Ansatz zeigt das Potenzial der Kombination von EMG- und visuellen Tracking-Technologien als wichtige Ressource für die Entwicklung intuitiver und reaktionsschneller Gestenerkennungssysteme mit Anwendungen in der Prothetik, Rehabilitation und interaktiven Technologien. Dieses Protokoll soll Forschern und Praktikern als Leitfaden dienen und weitere Innovationen und Anwendungen der Gestenerkennung in dynamischen und realen Szenarien fördern.

Einleitung

Handgesten sind in der menschlichen Kommunikation von entscheidender Bedeutung, so dass die Erkennung von Fingergesten ein wichtiger Forschungsbereich in Bereichen wie Mensch-Computer-Interaktion, fortschrittliche Prothesen 1,2,3,4 und Rehabilitationstechnologien 5,6 ist. Infolgedessen hat die Gestenerkennung mit den Fingern aufgrund ihres Potenzials, intuitive Steuerungssysteme und Hilfsmittel zu verbessern, große Aufmerksamkeit erregt. Die Oberflächen-Elektromyographie (sEMG) in Kombination mit Deep-Learning-Algorithmen erweist sich als vielversprechender Ansatz für die Erfassung und Interpretation dieser Gesten, da sie in der Lage ist, die elektrische Aktivität der Muskeln zu erkennen, die mit Handbewegungen verbunden sind 7,8,9,10,11,12,13,14,15.

Trotz dieser Fortschritte stoßen die aktuellen Ansätze in der Praxis jedoch an ihre Grenzen. Die meisten bestehenden Systeme erfordern komplexe, umständliche Aufzeichnungsaufbauten mit zahlreichen Elektroden 5,7,9,16,17 und präziser Positionierung 3,18, die außerhalb kontrollierter Umgebungen oft nur schwer zu implementieren sind. Darüber hinaus neigen diese Systeme dazu, sich auf statische Handhaltungen 13,18,19,20,21 zu konzentrieren, was ihre Fähigkeit einschränkt, dynamische, fließende Gesten zu interpretieren, die bei täglichen Aktivitäten auftreten. Das Protokoll zielt darauf ab, diese Einschränkungen zu beheben, indem es die dynamische Gestenerkennung unter natürlicheren Bedingungen unterstützt. Eine solche Methodik würde praktischere und benutzerfreundlichere Anwendungen in Bereichen wie Prothetik und Rehabilitation ermöglichen, in denen eine natürliche Gesteninterpretation in Echtzeit unerlässlich ist.

Um diese Herausforderungen zu bewältigen, erfordert die Entwicklung genauerer und anpassungsfähigerer Algorithmen Datensätze, die die natürlichen, alltäglichen Bedingungen widerspiegeln 3,4. Solche Datensätze müssen eine breite Palette dynamischer Bewegungen, verschiedener Handpositionen und großer Datenmengen erfassen, um die Robustheit des Modells zu gewährleisten. Darüber hinaus ist die Variabilität zwischen Trainings- und Testdatensätzen von entscheidender Bedeutung, so dass Modelle über verschiedene Handhaltungen, Muskelaktivierungsmuster und Bewegungen hinweg verallgemeinert werden können. Die Einbeziehung dieser Vielfalt in die Daten wird es Algorithmen ermöglichen, die Gestenerkennung in alltäglichen, realen Anwendungen genauer durchzuführen22.

Die Überwindung dieser Herausforderungen wird für die zukünftige Entwicklung praktischerer und breiter anwendbarer Gestenerkennungssysteme von entscheidender Bedeutung sein. Die hier beschriebene Studie und das beschriebene Protokoll ergeben sich aus der Notwendigkeit, ein tragbares, benutzerfreundliches Setup zu haben, das dynamische Handbewegungen in natürlichen Umgebungen erfassen kann. Umfassende Datensätze und fortschrittliche Algorithmen sind entscheidend, um das Potenzial von sEMG und Deep Learning in Mensch-Computer-Schnittstellen, Neuroprothesen und Rehabilitationstechnologien voll auszuschöpfen. Wir erwarten, dass dieses Protokoll einen Beitrag zum Feld leistet, indem es eine umfassende Datenerfassung ermöglicht, um die Entwicklung von Algorithmusmodellen zu ermöglichen, die über verschiedene Handpositionen hinweg verallgemeinert werden können.

Eine große Herausforderung bei der Gestenerkennung liegt in der Empfindlichkeit von sEMG-Signalen für die Handpositionierung. Während sich viele Studien auf feste Handpositionen für die Gestenvorhersage konzentrieren, erfordern reale Anwendungen Modelle, die in der Lage sind, Fingerbewegungen über verschiedene Handhaltungen hinweg zu erkennen. Neuere Ansätze haben dieses Problem gelöst, indem sie Computer Vision als Ground-Truth-Referenz einbeziehen und die Genauigkeit und Flexibilität dieser Modelle verbessern15,19. Darüber hinaus bieten Hybridmodelle, die sEMG-Signale mit visuellen Daten integrieren, weitere Verbesserungen der Erkennungsgenauigkeit in verschiedenen Szenarien23.

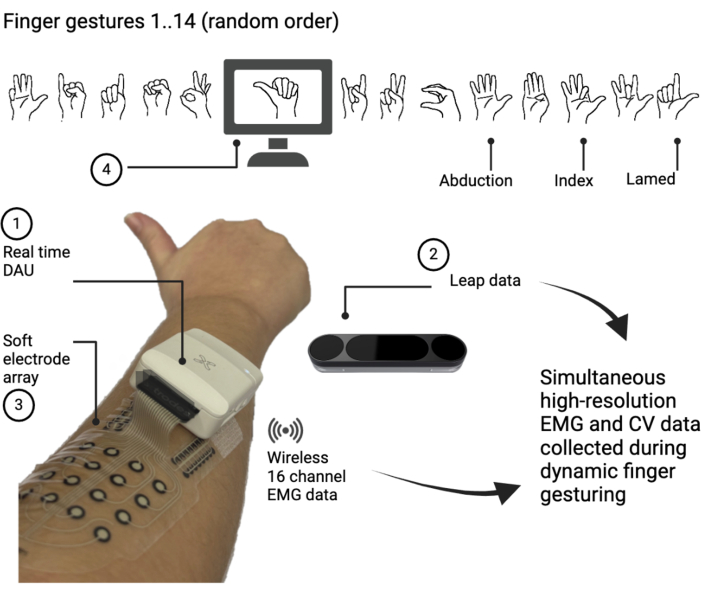

In diesem Protokoll stellen wir einen synchronisierten Ansatz für die Datenerfassung vor, der die dynamische Gestenerkennung verbessert, indem sowohl EMG- als auch Hand-Tracking-Daten unter realen Bedingungen einbezogen werden. Im Gegensatz zu herkömmlichen Methoden, die die Gestenleistung auf statische Positionen beschränken, umfasst dieses Protokoll Gesten, die in vier verschiedenen Positionen ausgeführt werden: Hand nach unten, Hand nach oben, Hand gerade und Hand bewegend. Die Hand-Tracking-Kamera verfolgt Handbewegungen innerhalb einer dreidimensionalen interaktiven Zone, identifiziert unterschiedliche Handelemente und erfasst dynamische Bewegungen mit hoher Auflösung. Ein weiches Elektrodenarray aus 16 Elektroden, die am Unterarm platziert werden, um die Muskelaktivität aufzuzeichnen, bietet stabile und kabellose Aufzeichnungen, ohne die Mobilität der Teilnehmer einzuschränken. Die synchronisierten Daten aus diesen beiden Quellen bieten eine umfassende Grundlage für die Entwicklung fortschrittlicher Gestenerkennungsalgorithmen, die unter realen Bedingungen eingesetzt werden können. Der Ansatz geht speziell auf die Grenzen aktueller Setups ein, indem er freie Bewegung und stabile Signalaufzeichnung in realistischen Szenarien ermöglicht. Diese Weiterentwicklung unterstützt Gestenerkennungstechnologien für Anwendungen in der Prothetik, Rehabilitation und interaktiven Technologien, bei denen intuitive Steuerung und Flexibilität unerlässlich sind.

Protokoll

Gesunde Teilnehmer (n = 18, im Alter von 18-32 Jahren, sowohl Männer als auch Frauen) wurden für diese Studie rekrutiert, die vom Ethikprüfungsausschuss der Universität Tel Aviv genehmigt wurde (Zulassungsnummer 0004877-3). Das Protokoll hält sich an die Richtlinien des Boards für Forschung mit menschlichen Teilnehmern. Von allen Teilnehmenden wurde eine Einwilligungserklärung gemäß den institutionellen Vorgaben eingeholt.

1. Einweisung des Experimentators

- Bitten Sie die Teilnehmer, eine Reihe von 14 verschiedenen Fingergesten auszuführen (siehe Abbildung 1) und wiederholen Sie jede Geste 7x in einer zufälligen Reihenfolge. Bitten Sie sie, jede Geste 5 Sekunden lang fest zu halten, gefolgt von einer Ruhepause von 3 Sekunden. Die Gesamtdauer für jede Sitzung beträgt 13:04 Minuten.

- Ein großes Bild der Geste, das auf einem Computerbildschirm angezeigt wird, wird von einem Countdown-Timer begleitet, der die Gestenleistung anzeigt. Bitten Sie den Teilnehmer während der Ruhephase, auf das kleine Bild der bevorstehenden Geste zu schauen, zusammen mit einem Timer, der die verbleibende Ruhezeit anzeigt. Zwei unterschiedliche Pieptöne signalisieren den Beginn und das Ende jeder Geste und helfen den Teilnehmern, sich auf die nächste Geste vorzubereiten.

- Bitten Sie jeden Teilnehmer, die Prozedur in vier verschiedenen Positionen auszuführen, ähnlich wie zuvorvorgestellt 22:

Position 1: Teilnehmer stehend. Mit der Hand nach unten, gerade und entspannt.

Position 2: Teilnehmer sitzt im Sessel. Die Hand ist um 90° nach vorne gestreckt, die Handfläche entspannt (eine Stützvorrichtung kann verwendet werden).

Position 3: Hand nach oben geklappt (mit einem Ellbogen auf dem Sessel ruhend), Handfläche entspannt.

Position 4: Der Teilnehmer wählt eine der vorherigen Positionen und darf die Hand innerhalb des Erfassungsbereichs der Kamera frei bewegen, der in Echtzeit auf einem PC-Bildschirm überwacht wird (siehe Schritt 1.4 für weitere Details). - Lassen Sie den Teilnehmer bei jeder Sitzung ein Elektromyographie-Gerät am Arm tragen und positionieren Sie eine Hand-Tracking-Kamera auf ihn. Bitten Sie die Teilnehmer, darauf zu achten, dass ihre Handflächen immer in die Kamera zeigen. Die Hand-Tracking-Software wird auf einem separaten Bildschirm angezeigt, so dass sowohl der Teilnehmer als auch der Dirigent überprüfen können, ob die Hand korrekt erkannt wird.

- Passen Sie für jede Position die Position und den Winkel der Hand-Tracking-Kamera an, um eine genaue Handerkennung zu gewährleisten. Beurteilen Sie außerdem die Qualität der Signale von den Elektroden mithilfe des Spektrogrammskripts.

Abbildung 1: Schematische Darstellung des Datenerfassungsprozesses. Der Proband ist mit einem weichen Elektrodenarray ausgestattet, das auf dem Unterarm (3) platziert ist und hochauflösende Oberflächen-Elektromyographie-Signale (sEMG) während der Gestenausführung erfasst. Der Proband führt 14 verschiedene Fingergesten aus, die in zufälliger Reihenfolge auf einem Computerbildschirm präsentiert werden (4). Die EMG-Daten werden von der Datenerfassungseinheit (DAU; 1) drahtlos an einen PC (PC) gestreamt. Gleichzeitig werden mit einer Hand-Tracking-Kamera (2) handkinematische Daten (HKD) erfasst, die die Fingergelenkswinkel darstellen. Bitte klicken Sie hier, um eine größere Version dieser Abbildung anzuzeigen.

2. Einrichten der Datenerfassungseinheiten

- Öffnen Sie das Github-Repository unter https://github.com/NeuroEngLabTAU/Fingers_Gestures_Recognition.git und folgen Sie den detaillierten Anweisungen im Abschnitt Installation. Suchen Sie die primäre Python-Datei data_collection.py im Ordner finger_pose_estimation/data_acquisition. Verwenden Sie diese Option, um das Experiment auszuführen, verwenden Sie das Skript spectrogram.py, um die EMG-Signalqualität zu bewerten, bevor das Experiment beginnt, und verwenden Sie die Skript data_analysis.py für die Signalfilterung und Segmentierung.

- Stellen Sie sicher, dass die EMG Data Acquisition Unit (DAU) vor jeder Sitzung vollständig aufgeladen ist, und schalten Sie sie ein.

- Verbinden Sie die DAU über Bluetooth mit der entsprechenden Anwendung mit dem PC. Stellen Sie die Bluetooth-Kommunikationsrate auf 500 Abtastungen pro Sekunde (S/s) ein.

- Installieren und öffnen Sie die Software der Hand-Tracking-Kamera auf dem PC. Verbinden Sie die Hand-Tracking-Kamera über ein Kabel mit dem PC.

- Verwenden Sie einen Bildschirm, um immer die Hand-Tracking-Kamerasoftware anzuzeigen. Auf diese Weise können der Dirigent und der Teilnehmer sicherstellen, dass die Kamera die Hand während des Experiments korrekt erkennt.

3. Vorbereitung der Teilnehmer

- Einleitung und Einwilligung

- Erklären Sie dem Teilnehmer kurz die Relevanz der Studie und den experimentellen Ablauf. Einholung einer Einwilligungserklärung gemäß den institutionellen Richtlinien für die Forschung am Menschen.

- Platzierung der Elektroden

- Weisen Sie den Teilnehmer an, seine rechte Hand zu beugen, indem er eine starke Faust formt. Während der Teilnehmer sich beugt, tasten Sie den Unterarm ab, indem Sie sanft entlang des Muskels drücken, um die Stelle zu identifizieren, an der die Muskelaktivierung am stärksten ausgeprägt ist. Diese Stelle ist leicht zu erkennen, indem man den Bereich fühlt, in dem sich der Muskel während der Kontraktion wölbt.

- Optional: Bereiten Sie die identifizierte Hautpartie vor, indem Sie sie mit einem alkoholfaserfreien Tuch, Präparationsgel oder Wasser und Seife reinigen. Lassen Sie den Bereich an der Luft trocknen. Vermeiden Sie übermäßige Reinigung mit Alkohol, da dieser die Haut austrocknen kann. Dieser Schritt ist optional. Siehe den Diskussionsbereich.

- Ziehen Sie die weiße Schutzschicht vom EMG-Elektrodenarray ab und befestigen Sie die Elektroden vorsichtig an dem identifizierten Unterarmbereich, wie in Schritt 3.2.1 bestimmt. (siehe Abbildung 1). Stellen Sie sicher, dass das Klebeband näher an der Handfläche anliegt. Befestigen Sie das Elektrodenarray durch leichtes Klopfen auf der Haut.

- Sobald das Elektrodenarray an der Haut befestigt ist, ziehen Sie die transparente Stützschicht ab.

- Stecken Sie die Elektrodenarray-Anschlusskarte in die Anschlussbuchse der DAU. Befestigen Sie die DAU auf dem Klebeband neben den Elektroden.

- Führen Sie ein benutzerdefiniertes Python-Spektrogramm-Skript Spectrogram.py aus, um die Signalqualität in Echtzeit zu überprüfen. Es erscheint ein Fenster, in dem die Rohdaten (links) und der Frequenzbereich (rechts) für alle Elektroden angezeigt werden (siehe Ergänzende Abbildung 1 als Referenz).

- Stellen Sie sicher, dass alle Elektroden erkannt werden und ordnungsgemäß funktionieren und dass das Signal frei von übermäßigem Rauschen und 50-Hz-Rauschen ist.

- Reduzieren Sie bei Bedarf das 50-Hz-Rauschen, indem Sie sich von elektronischen Geräten entfernen, die Störungen verursachen können, und unnötige Geräte vom Stromnetz trennen. Warten Sie Zeit, bis sich das Signal stabilisiert hat.

- Überprüfen Sie die EMG-Signalerfassung: Weisen Sie die Teilnehmer an, einen Ellbogen auf den Sessel zu legen, die Finger zu bewegen und sich dann zu entspannen. Stellen Sie sicher, dass ein klares EMG-Signal angezeigt wird, gefolgt von statischem Grundrauschen.

- Schließen Sie das Skript, sobald die Signalüberprüfung abgeschlossen ist.

- Überprüfung der Gesten- und Handposition

- Öffnen Sie den Ordner Bilder, indem Sie auf Finger_pose_estimation > Data_acquisition klicken. Überprüfen Sie die Gestenbilder mit den Teilnehmern.

- Stellen Sie sicher, dass sie jede Bewegung verstehen und genau ausführen können. Erklären Sie dem Teilnehmer die vier Handpositionen deutlich.

- Weisen Sie den Teilnehmer vor jeder Sitzung an, wie er die Hand halten soll, um die richtige Haltung und Positionierung sicherzustellen.

- Teilnehmer- und Kamerapositionierung

- Weisen Sie den Teilnehmer für die Handposition 1 an, etwa 1 m vom Tisch entfernt gerade zu stehen. Weisen Sie den Teilnehmer an, die rechte Hand gerade und entspannt nach unten zu halten, wobei die Handfläche zur Hand-Tracking-Kamera zeigt. Fixieren Sie die Hand-Tracking-Kamera mit einem Selfie-Stick auf dem Tisch und richten Sie sie auf die Hand des Teilnehmers.

- Weisen Sie den Teilnehmer für die Handposition 2 an, bequem in einem Sessel zu sitzen, der 40-70 cm von den Monitoren entfernt positioniert ist. Weisen Sie den Teilnehmer an, die rechte Hand um 90° nach vorne zu strecken, wobei eine entspannte Handfläche zur Hand-Tracking-Kamera zeigt. Verwenden Sie bei Bedarf eine Stützvorrichtung, um die Hand stabil zu halten. Platzieren Sie die Handverfolgungskamera mit der Vorderseite nach oben auf dem Tisch.

HINWEIS: Da der Teilnehmer aufgefordert wird, in einer festen Haltung zu bleiben, ist es wichtig, eine bequeme Position zu finden, die er während der gesamten Sitzung beibehalten kann. - Für die Handposition 3 weisen Sie den Teilnehmer an, wie in Schritt 3.4.2 beschrieben zu sitzen. Weisen Sie den Teilnehmer an, die Hand nach oben zu falten, während er den Ellbogen auf dem Sessel abstützt. Die Handfläche sollte entspannt sein und der Teilnehmer sollte sich der Hand-Tracking-Kamera zuwenden. Befestigen Sie die Hand-Tracking-Kamera auf dem Tisch mit Blick auf die Hand des Teilnehmers (verwenden Sie ggf. einen Selfie-Stick). Stellen Sie sicher, dass die Position des Teilnehmers sowohl für den Blick auf die Bildschirme als auch für den Aufenthalt im Sichtfeld der Kamera optimal ist.

- Überwachen Sie kontinuierlich den Bildschirm, auf dem Hand-Tracking-Daten angezeigt werden, um sicherzustellen, dass die Kamera die Hand und die Finger während des gesamten Experiments erkennt. Optional: Überprüfen Sie die EMG-Signalqualität (Schritt 3.2.6.) in jeder Handposition, bevor Sie das Experiment starten.

4. Datenerhebung

- Ausführen des Experiments

- Öffnen Sie Python und laden Sie data_collection.py. Vergewissern Sie sich, dass die Parameter num_repetition, gesture_duration rest_duration wie gewünscht eingestellt sind.

- num_repetition: Legen Sie fest, wie oft jedes Gestenbild angezeigt wird. Legen Sie für dieses Experiment den Wert auf 7 fest, was bedeutet, dass jedes Bild 7 Mal angezeigt wird. gesture_duration: Geben Sie die Dauer (in s) an, für die der Teilnehmer die Handgeste ausführt. Legen Sie für dieses Experiment den Wert auf 5 s fest, um zu bestimmen, wie lange jedes Gestenbild angezeigt wird. Rest_duration: Geben Sie die Dauer (in s) an, für die der Teilnehmer seine Handfläche zwischen den Gesten entspannt. Legen Sie für dieses Experiment den Wert auf 3 s fest.

- Passen Sie die Position und den Winkel der Hand-Tracking-Kamera an die Handposition des Teilnehmers an.

- Führen Sie das Skript data_collection.py aus. Es erscheint ein Fenster, in dem Sie die Daten des Teilnehmers eingeben können (Seriennummer, Alter, Geschlecht, Sitzungsnummer und Handposition). Geben Sie diese Informationen ein, und drücken Sie OK, um das Experiment automatisch zu starten.

- Öffnen Sie Python und laden Sie data_collection.py. Vergewissern Sie sich, dass die Parameter num_repetition, gesture_duration rest_duration wie gewünscht eingestellt sind.

- Datensammlung

- Zeichnen Sie für jede Sitzung EMG- und Hand-Tracking-Daten auf, die automatisch gespeichert werden. Wiederholen Sie das Experiment 4x für jeden Teilnehmer, einmal pro Handposition.

5. Datenverarbeitung am Ende des Versuchs und nach dem Versuch

- Nach Abschluss des Experiments werden die Daten automatisch gespeichert. Stellen Sie sicher, dass die Daten in einem Ordner gespeichert werden, der mit der Seriennummer des Teilnehmers gekennzeichnet ist. Jede Sitzung wird in einem Unterordner mit dem Namen S# (z. B. S1) gespeichert, mit vier Unterordnern für jede Handposition P# (P1, P2, P3 und P4). Die Ordnergröße für eine einzelne Sitzung beträgt ca. 160 MB.

- Wenn ein Teilnehmer mehrere Sitzungen abschließt, stellen Sie sicher, dass alle Daten im entsprechenden Sitzungsordner (z. B. S1, S2) gespeichert sind.

- Dateien

Stellen Sie sicher, dass jeder Handpositionsordner (P#) die folgenden Dateien enthält: EMG-Daten, die in einer EDF-Datei gespeichert sind und wie folgt benannt sind: fpe_pos{Positionsnummer}_{Probandennummer}_S{Sitzungsnummer}_rep0_BT; Hand-Tracking-Daten, die in einer CSV-Datei mit dem Namen fpe_pos{Positionsnummer}_{Betreffnummer}_S{Sitzungsnummer}_rep0_BT_full gespeichert sind; und eine Protokolldatei, log.txt, die Metadaten über die Sitzung enthält. - Datenverarbeitung

HINWEIS: Ein Benutzer kann wählen, wie er mit der Signalanalyse fortfahren möchte und welche Tools verwendet werden sollen. Hier stellen wir ein Skript für die Durchführung von Signalfilterung und Datensegmentierung in Python zur Verfügung. Wenn Sie Python verwenden, stellen Sie sicher, dass alle Abhängigkeiten (z. B. Numpy, Pandas, SciPy, MNE, Sklearn) installiert sind.- Öffnen Sie Python, laden Sie data_analysis.py und führen Sie das Skript aus.

- In der Konsole wird eine Anfrage angezeigt, um die notwendigen Parameter für die Datenverarbeitung anzugeben: Pfad zur EMG-Datei, Pfad zu den kinematischen Handdaten, Pfad, in dem die verarbeiteten Daten gespeichert werden, Abtastrate in Hz, Fensterdauer in ms und Schrittintervall in ms.

- Nach diesem Schritt führt das Skript die Datenverarbeitung durch.

- EMG-Signalfilterung: Führen Sie das Skript wie oben beschrieben aus. Das Skript filtert zunächst das sEMG-Signal, indem es einen Butterworth-Hochpassfilter 4. Ordnung mit einem Cutoff von 20 Hz anwendet, um Nicht-EMG-Signale zu entfernen, und dann einen Notch-Filter, um 50-Hz- und 100-Hz-Oberwellen zu entfernen. Zusätzlich wendet das Skript eine Normalisierung des EMG-Signals an.

- EMG, HKD-Daten und segmentierte Gesten: Führen Sie das Skript wie oben beschrieben aus. Das Skript wendet die Segmentierung an, wobei eine Rolling-Window-Technik verwendet wird, die durch die angegebene Fensterdauer und das Schrittintervall definiert wird. Legen Sie sie in diesem Experiment auf 512 bzw. 2 ms fest. Das Skript transformiert dann die Organisation des sEMG-Kanals in eine 4 x 4 räumliche Gitterkonfiguration, wobei das Layout des Elektrodenarrays beibehalten wird. Schließlich generiert das Skript ein Wörterbuch, das Metadaten als Pickle-Datei enthält.

- Schritte zur Datenbereinigung und -validierung

- Identifizieren und Ausschließen von Segmenten, die Artefakte, Rauschen oder inkonsistente Gestenbeschriftungen enthalten, aus dem Datensatz.

- Stellen Sie die Vollständigkeit der Segmente und die zeitliche Kontinuität über Fenster hinweg sicher, um die Zuverlässigkeit der Daten zu gewährleisten.

- Vergleichen Sie die Gestendaten mit dem HKD auf Konsistenz. Entfernen Sie Fenster, in denen Gestenmuster angezeigt werden, die von den HKD-Sitzungsstandards abweichen.

- Erkennen und verwerfen Sie Ausreißersegmente, die nicht den erwarteten kinematischen Mustern für die Sitzung entsprechen.

- Führen Sie weitere Datenanalysen mit fortschrittlichen Algorithmen durch. Diese sind im aktuellen Protokoll nicht vorgesehen.

Ergebnisse

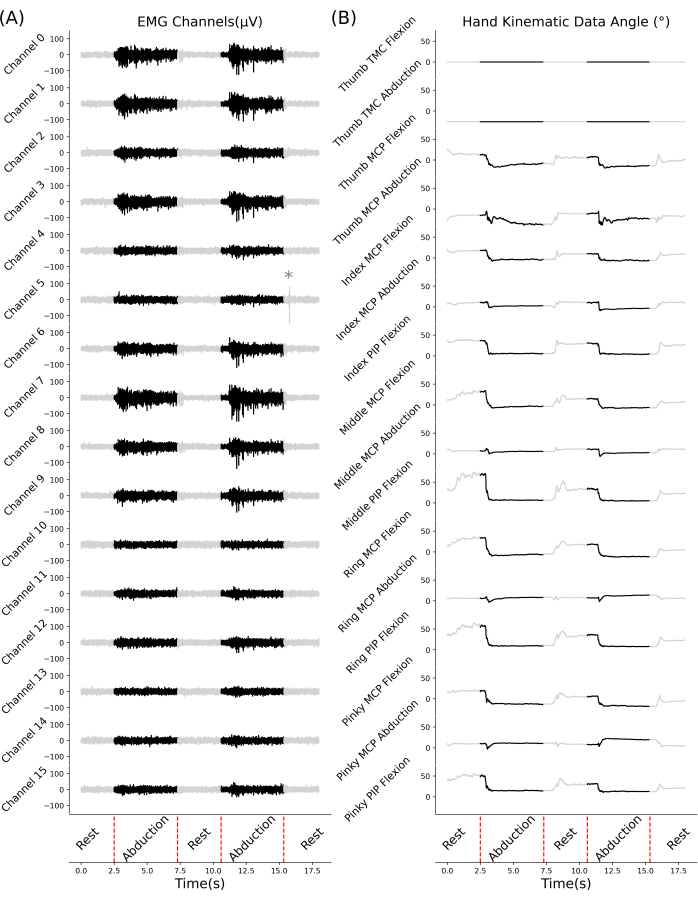

Der Datensatz besteht aus zwei zeitsynchronisierten Komponenten: einem 16-Kanal-EMG-Datensatz und Daten eines Hand-Tracking-Kamerasystems. Die 16-Kanal-EMG-Daten erfassen die Muskelaktivität, indem sie elektrische Signale von verschiedenen Muskeln im Laufe der Zeit aufzeichnen. Das Hand-Tracking-System liefert 16 Datenkanäle, die Schlüsselpunkten auf einem Skelettmodell der Hand entsprechen. Während das Modell ohne Handgelenk 21 Punkte hat, wurde diese Zahl aufgrund von Bewegungseinschränkungenauf 16 reduziert. Das EMG und die visuellen Daten wurden gesammelt, indem während der Aufzeichnung zwei separate Prozesse auf demselben Computer ausgeführt wurden, um eine Synchronität herzustellen. Ein Zeitstempel wurde verwendet, um den Beginn jedes Prozesses zu markieren, so dass der Datenanalysecode die Muskelaktivitäts- und Handbewegungsdaten am Ende der Aufzeichnung ausrichten konnte. Zeitstempel-Anmerkungen wurden automatisch sowohl in EDF- als auch in CSV-Dateien gespeichert, um den genauen Zeitpunkt zu markieren, zu dem bestimmte Fingergesten angewiesen wurden, und die Ausrichtung während der Datenanalyse zu erleichtern. Das gefilterte EMG-Signal (20 Hz Butterworth-Hochpassfilter 4. Ordnung) zeichnet sich durch eine niedrige Basislinie (grau schattierte Bereiche) aus, die typischerweise im Bereich von 3-9 μV25 liegt. Diese Grundlinie wird beobachtet, wenn die Hand des Probanden stationär ist und die Muskeln in Ruhe sind. Ist jedoch auch in der Ruheposition ein Muskeltonus vorhanden, kann ein deutliches EMG-Signal nachgewiesen werden. Mechanische Artefakte, die durch Bewegung verursacht werden, manifestieren sich meist im Bereich von 10-20 Hz und sollten entsprechend herausgefiltert werden. Deutlich erhöhte Ausgangswerte können auf eine 50-Hz-Leitungsstörung hinweisen und sollten während der Versuchsaufbauphase vermieden werden. In Fällen, in denen mäßiges 50-Hz-Rauschen anhält; Ein Kerbfilter wird angewendet. Scharfe Bewegungsartefakte, die schwieriger zu entfernen sind, erscheinen oft als ausgeprägte Spitzen mit hoher Amplitude im Signal (siehe Sternchen in Abbildung 2A). Die Amplitude des EMG-Signals über das 16-Elektroden-Array variiert und spiegelt die räumliche Verteilung der Muskelaktivität über den gemessenen Bereich wider. Diese Varianz liefert wertvolle Einblicke in die Heterogenität der Muskelkontraktion während der Handgesten.

Die Hand-Tracking-Kamera liefert direkte Informationen über Fingerwinkel (Hand Kinematic Data, HKD), von denen erwartet wird, dass sie eng mit den aufgezeichneten EMG-Signalen korrelieren. Während der Gesten bewegen sich die Fingerwinkel im Normalbereich26, abhängig von der spezifischen Geste. Wenn der visuelle Pfad zwischen der Hand-Tracking-Kamera und der Hand frei ist, ist das resultierende Signal stabil und genau, wie in Abbildung 2 gezeigt. In Fällen, in denen der Sichtkontakt verloren geht oder wenn das System technische Einschränkungen aufweist, kann der HKD jedoch unregelmäßig werden und Sprünge zwischen falschen Werten anzeigen. Solche Ausreißerdaten sollten während der Datenerfassung minimiert und in der endgültigen Analyse verworfen werden, um die Integrität der Ergebnisse zu wahren.

Der HKD ist intuitiv und ermöglicht einen direkten Vergleich mit den tatsächlich ausgeführten Gesten. Es weist eine geringe Variabilität zwischen den Motiven und über verschiedene Handpositionen hinweg auf. Im Gegensatz dazu variieren die EMG-Daten aufgrund anatomischer Unterschiede wie Handgröße und Muskelentwicklung tendenziell erheblich zwischen den Individuen27. Darüber hinaus kann eine Variabilität zwischen dominanten und nicht-dominanten Händen beobachtet werden. Diese fachspezifische Variabilität kann im Rahmen der Offline-Analyse angesprochen werden.

In Abbildung 2 ist ersichtlich, dass sowohl das EMG als auch das HKD relativ zum angewiesenen Gestenauslöser versetzt sind. Diese Diskrepanz ergibt sich aus der Reaktionszeit und der natürlichen Bewegungsausführung28. Bei Regressionsaufgaben könnte eine solche Variabilität zur Reichhaltigkeit der Daten beitragen, während sie bei Klassifikationsaufgaben mit einem verallgemeinerten Likelihood-Ratio-Ansatz gehandhabt werden kann, wie er in ähnlichen Szenarienangewendet wird 28.

Abbildung 2: Repräsentatives sEMG und HKD während der Fingerabduktion. Oberflächen-Elektromyographie (sEMG) Signale und kinematische Handdaten (HKD), die während der dynamischen Fingerabduktion und -pause während der Handposition 1 (Hand nach unten, gerade und entspannt) von einem einzelnen Teilnehmer aufgezeichnet wurden. (A) Gefilterte EMG-Signale von 16 Kanälen als Funktion der Zeit. Ein Sternchen (*) kennzeichnet ein mechanisches Artefakt, das in der EMG-Aufzeichnung von Kanal 5 entdeckt wurde. (B) HKD, das die Gelenkwinkel als Funktion der Zeit zeigt. Die Gelenkwinkel werden an verschiedenen Gelenken gemessen: trapeziometakarpal (TMC), metacarpophalangeal (MCP) und proximales Interphalangeal (PIP). Die Phasen des Experiments (Ruhe und Abduktion) sind entlang der x-Achse angedeutet. Bitte klicken Sie hier, um eine größere Version dieser Abbildung anzuzeigen.

Diese repräsentativen Ergebnisse zeigten die Nützlichkeit der synchronisierten EMG- und HKD-Daten bei der Erfassung von Handgesten. Die Ausrichtung der EMG-Signale mit den entsprechenden HKD ermöglicht es, die Muskelaktivität auf bestimmte Fingerbewegungen abzubilden. Bei der Erstellung eines Vorhersagemodells können Forscher HKD als Ground Truth verwenden und EMG-basierte Gestenvorhersagen iterativ verifizieren und verfeinern. Dieser Ansatz unterstreicht die praktische Anwendbarkeit des Protokolls und deutet auf die Notwendigkeit weiterer Forschung in natürlicheren Umgebungen hin.

Ergänzende Abbildung 1: Spektrogrammfenster, die während des Signalverifizierungsschritts angezeigt werden. Die linken Felder zeigen EMG-Rohdaten, während die rechten Felder die erkannten Frequenzbereiche anzeigen. (A) Beispiel für ein sehr verrauschtes EMG-Signal mit starken 50 Hz und 100 Hz Störungen. (B) Beispiel für die gleiche EMG-Signalaufzeichnung, nachdem der Teilnehmer weiter von elektrischen Geräten entfernt wurde, was zu einem sauberen EMG-Signal mit minimalen Interferenzen führte. Bitte klicken Sie hier, um diese Datei herunterzuladen.

Diskussion

Das in dieser Studie vorgestellte Protokoll beschreibt kritische Schritte, Modifikationen und Fehlerbehebungsstrategien, die darauf abzielen, die Erkennung von Handgesten durch die Kombination von sEMG-Signalen und HKD zu verbessern. Er befasst sich mit den wichtigsten Einschränkungen und vergleicht diesen Ansatz mit bestehenden Alternativen, wobei seine potenziellen Anwendungen in verschiedenen Forschungsbereichen hervorgehoben werden. Einer der wichtigsten Aspekte des Protokolls ist die Sicherstellung der korrekten Positionierung und Ausrichtung der Hand-Tracking-Kamera. Die genaue Gestenerfassung hängt stark vom Winkel und der Entfernung der Kamera relativ zur Hand des Teilnehmers ab. Schon geringfügige Abweichungen in der Kamerapositionierung können zu Ungenauigkeiten bei der Verfolgung führen, wodurch die Genauigkeit der Gestendaten verringert wird. Diese Ausrichtung muss für jeden Teilnehmer und jede Handhaltung sorgfältig angepasst werden, um eine konsistente und zuverlässige Datenerfassung zu gewährleisten. Darüber hinaus ist es wichtig, dass die Teilnehmer mit dem Protokoll gut vertraut sind, um Junk-Data zu vermeiden - bei dem Gesten entweder falsch ausgeführt oder falsch mit dem experimentellen Ablauf ausgerichtet werden. Wenn sichergestellt wird, dass die Teilnehmer mit den Gesten und dem Versuchsaufbau vertraut sind, kann das Datenrauschen minimiert und die Qualität der Aufzeichnungen verbessert werden.

Eine häufige Herausforderung bei dieser Art von Studie ist die Lärmbelastung sowohl im sEMG als auch im HKD. sEMG-Signale reagieren besonders empfindlich auf Faktoren wie Muskelermüdung, Bewegungsartefakte und Umgebungsgeräusche wie elektromagnetische Störungen. Vorverarbeitungstechniken wie Bandpassfilterung sind unerlässlich, um das Rauschen zu reduzieren und die Signalklarheit zu verbessern. Die richtige Platzierung der Elektrode und die Anweisung an die Teilnehmer, während der Ruhephasen entspannte Muskeln zu erhalten, können Bewegungsartefakte weiter abschwächen. Trotz dieser Vorsichtsmaßnahmen ist eine gewisse Variabilität der sEMG-Signale aufgrund individueller Unterschiede in der Anatomie, der Handkraft und den Muskelaktivierungsmustern unvermeidlich. Diese Variabilität kann durch flexible Algorithmen angegangen werden, die in der Lage sind, diese Unterschiede zwischen Probanden und Bedingungen zu normalisieren.

Ein Schlüsselfaktor für qualitativ hochwertige sEMG-Signale ist die Erstsignalverifizierung. Herkömmliche Protokolle mit Gelelektroden erfordern eine Vorbereitung der Haut, wie z. B. ein Peeling oder eine Reinigung mit Alkohol, um die Signalklarheit zu verbessern. In einer früheren Studie haben wir jedoch gezeigt, dass die Hautvorbereitung bei trockenen Elektroden die Signalqualität nicht signifikant beeinflussenkann 25. In diesem Protokoll ist die Hautreinigung optional und vereinfacht somit den Prozess. Ein weiteres hautbezogenes Problem, das die Signalqualität beeinträchtigt, ist übermäßige und dicke Armbehaarung. In solchen Fällen schlagen wir vor, entweder den Bereich zu rasieren oder den Probanden aus der Studie auszuschließen.

Eine der größten Herausforderungen bei der Verwendung von sEMG für die Gestenerkennung ist die Empfindlichkeit gegenüber der Handpositionierung. Selbst bei der gleichen Geste können Variationen in der Handausrichtung zu unterschiedlichen EMG-Signalmustern führen. Um dieses Problem zu lösen, sind Modelle des maschinellen Lernens, die die Variabilität der Handpositionen berücksichtigen können, unerlässlich22. Diese Modelle müssen mit Daten aus mehreren Handhaltungen trainiert werden, um die Robustheit und Generalisierbarkeit zu verbessern. Die Synchronisation von visuellen und sEMG-Daten ist ein weiterer wichtiger Aspekt. Ein konsistentes Timing der Gesten ist entscheidend, um Diskrepanzen zwischen der Gestenausführung und der Datenaufzeichnung zu vermeiden. Dieses Protokoll verwendet visuelle Countdowns und akustische Hinweise, um sicherzustellen, dass bei Bedarf genaue Timing- und Rekalibrierungsschritte angewendet werden, um Fehlausrichtungen während der Datenerfassung zu korrigieren.

Trotz seiner Stärken hat dieses Protokoll mehrere Einschränkungen. Eine große Einschränkung ist das eingeschränkte Sichtfeld der Hand-Tracking-Kamera, das erfordert, dass die Hände des Teilnehmers innerhalb des Erfassungsbereichs der Kamera bleiben. Dadurch wird die Analyse auf eine kleine Menge von Bewegungen beschränkt. Für Experimente außerhalb des Labors ist eine komplexere Videobildgebung oder die Verwendung von intelligenten Handschuhen erforderlich. Die Ermüdung der Teilnehmer stellt auch bei längeren Sitzungen eine Herausforderung dar und kann die Genauigkeit der Gesten und die Muskelaktivierung beeinträchtigen, was die Qualität der sEMG-Daten beeinträchtigen kann. Um diese Auswirkungen abzumildern, kann es notwendig sein, die Sitzungsdauer zu begrenzen oder Pausen einzuführen, um die Ermüdung zu minimieren. Darüber hinaus können Powerline-Interferenzen Rauschen in die sEMG-Signale einbringen, insbesondere wenn sich die Teilnehmer zum Zwecke der Datenerfassung in der Nähe des PCs befinden. Eine drahtlose Version des Systems könnte solche Interferenzen reduzieren, indem sie es den Teilnehmern ermöglicht, weiter vom Computer entfernt zu sein.

Eine wesentliche methodische Einschränkung der EMG-basierten Fingergestenerkennung ergibt sich aus der hohen Variabilität der sEMG-Signale zwischen den Probanden, die die Entwicklung individueller Modelle für jeden Teilnehmer erfordert. Dieser fachspezifische Ansatz ist zwar genauer, schränkt aber die Skalierbarkeit des Protokolls ein und erfordert zusätzliche Kalibrierungs- und Schulungszeit für jeden neuen Benutzer. EMG- und HKD-Datenströme weisen aufgrund der dualen Prozessaufzeichnung geringfügige zeitliche Synchronisationsunterschiede auf. Diese zeitlichen Diskrepanzen haben nur minimale Auswirkungen auf die statische Gestenanalyse, da die beibehaltenen Posen zeitlich stabil sind. Die anhaltende Natur statischer Gesten bietet ausreichend Zeit für die Stabilisierung sowohl des EMG als auch der kinematischen Merkmale, im Gegensatz zu dynamischen Gesten, die eine präzisere Synchronisation erfordern.

Ein wesentlicher Vorteil dieser Methode ist ihre Flexibilität bei der Erfassung von Gesten. Im Gegensatz zu anderen Systemen, die starre Einstellungen und strenge Gestenparameter erfordern, ermöglicht dieses Protokoll dynamische und flexible Handpositionen19. Diese Flexibilität ist besonders nützlich in Studien, die darauf abzielen, ein breites Spektrum von Bewegungen zu analysieren, um sie besser an reale Anwendungen anzupassen. Darüber hinaus ist dieses Protokoll im Vergleich zu fortschrittlicheren Motion-Capture- und sEMG-Systemen, die oft komplexe Setups erfordern, kostengünstig29. Durch die Integration einer Hand-Tracking-Kamera mit halbautomatischen sEMG-Algorithmen bietet diese Methode eine praktikable Alternative für Gestenerkennungsstudien, ohne die Datenqualität zu beeinträchtigen. Darüber hinaus eröffnet das Potenzial des Systems für die Echtzeit-Datenverarbeitung Möglichkeiten für sofortiges Feedback in Anwendungen wie Neuroprothetik und Rehabilitation, bei denen Echtzeit-Reaktionsfähigkeit unerlässlich ist. Dieses Protokoll hat erhebliche Auswirkungen auf mehrere Bereiche, insbesondere auf die Neuroprothetik. Die genaue Vorhersage von Handgesten aus sEMG-Signalen ist entscheidend für die Steuerung von Prothesen, und die Flexibilität in der Handpositionierung, die diese Methode bietet, macht sie zu einem idealen Kandidaten für Echtzeit-Prothesen. In der Rehabilitation könnte dieses Protokoll eingesetzt werden, um die motorische Erholung bei Patienten mit Hand- oder Fingerbeeinträchtigungen zu überwachen und zu verbessern. Durch die Analyse von Muskelaktivierungsmustern während der Gestenausführung könnte dieses System verwendet werden, um Rehabilitationsübungen an die individuellen Bedürfnisse anzupassen und einen personalisierten Ansatz für die motorische Erholung zu bieten. Für die Mensch-Computer-Interaktion (HCI) ermöglicht diese Methode natürlichere gestenbasierte Steuerungssysteme, die die Intuitivität und Effizienz von Benutzeroberflächen verbessern. Schließlich könnte das Protokoll auf ergonomische Studien angewendet werden, um zu beurteilen, wie unterschiedliche Handhaltungen und Gesten die Muskelaktivität und -ermüdung beeinflussen, was möglicherweise zu Fortschritten bei der Arbeitsplatzgestaltung und der Benutzerergonomie führen könnte.

Um eine gleichbleibende Kontraktionsstärke bei allen Teilnehmern zu gewährleisten, könnten zukünftige Studien einen Handschuh mit kraftempfindlichen Widerständen implementieren, um die Kraft direkt zu messen. Dies würde einen standardisierten Aufwand für alle Probanden ermöglichen und die Zuverlässigkeit der EMG-Daten verbessern. Darüber hinaus würde die Integration dieser Kraftmessung als Beschriftung in die Gelenkkinematik eine detailliertere Darstellung des inneren Zustands des Muskels ermöglichen, was die Analyse von Muskelfunktionen und Bewegungsmustern möglicherweise bereichern würde. Dieser Ansatz würde nicht nur die Datenkonsistenz verbessern, sondern auch tiefere Einblicke in die Beziehung zwischen Muskelkontraktion und Gelenkbewegung bieten.

Zusammenfassend lässt sich sagen, dass dieses Protokoll einen neuartigen und flexiblen Ansatz für die Erkennung von Handgesten mit breiten Anwendungen in den Bereichen Neuroprothetik, Rehabilitation, HCI und Ergonomie bietet. Obwohl das System Einschränkungen aufweist, stellen seine Flexibilität, Kosteneffizienz und sein Potenzial für den Einsatz in Echtzeit einen erheblichen Fortschritt gegenüber bestehenden Methoden dar. Diese Stärken machen es zu einem vielversprechenden Werkzeug für die Weiterentwicklung und Innovation von Gestenerkennungstechnologien.

Offenlegungen

Yael Hanein erklärt eine finanzielle Beteiligung an X-trodes Ltd., die die in dieser Arbeit verwendete Siebdruckelektrodentechnologie kommerzialisiert hat. Die anderen Autoren haben keine andere relevante finanzielle Beteiligung an einer Organisation oder Einrichtung, die ein finanzielles Interesse an oder einen finanziellen Konflikt mit dem im Manuskript besprochenen Thema oder Material hat, abgesehen von den offengelegten.

Danksagungen

Dieses Projekt wurde teilweise mit einem Grant des ERC (OuterRetina) und des ISF finanziert. Die Geldgeber spielten keine Rolle beim Studiendesign, der Datenerhebung und -analyse, der Entscheidung über die Veröffentlichung oder der Vorbereitung des Manuskripts. Wir danken David Buzaglo, Cheni Hermon, Liron Ben Ari und Adi Ben Ari für ihre Unterstützung bei der Gestaltung der ursprünglichen Version des Protokolls.

Materialien

| Name | Company | Catalog Number | Comments |

| Adjustable Selfie Stick | Used to position and angle the hand-tracking camera in the desired orientation for optimal data capture during the experiment. | ||

| Alcohol pad | To clean the area for electrode placement. | ||

| Data acquisition unit (DAU) | X-trodes Ltd. | XTR-BT V1.3 | Realtime compatible DAU 2.0.17 or 4.0.1 |

| Finger Gestures Recognition library | https://github.com/NeuroEngLabTAU/Fingers_Gestures_Recognition.git | ||

| Leap Motion Controller 2 | Ultraleap | 129-SP4-00005-03 | Hand-tracking camera |

| Long Type-C to Type-C cable | Connection of the hand-tracking camera to the PC. | ||

| PC Monitors | One for guidelines, one for viewing the hand-tracking camera data | ||

| Personal Computer (PC) | Windows | Windows 10+; Processors: Inteli7 processor. BT receiver. | |

| Python code | A script enabling seamless data streaming and recording up to 500 S/s when DAU is connected to PC via Bluetooth | ||

| Ultraleap Camera Python API | Ultraleap | Python API and instructions from Ultraleap’s GitHub repository (https://github.com/ultraleap/leapc-python-bindings) used to collect data from the Ultraleap unit during the experiment | |

| Ultraleap Hyperion | Ultraleap | Tracking software | |

| XTR EXG16 | X-trodes Ltd. | XTELC0003405RM | 16-channel wearable dry electrode array patch for EMG, ECG monitoring |

| X-trodes PC App | X-trodes Ltd. | 1.1.35.0 | An application for connecting X-trodes DAU to PC via BT |

Referenzen

- Fang, B., et al. Simultaneous sEMG recognition of gestures and force levels for interaction with prosthetic hand. IEEE Trans Neural Sys Rehabilitation Eng. 30, 2426-2436 (2022).

- Yadav, D., Veer, K. Recent trends and challenges of surface electromyography in prosthetic applications. Biomed Eng Lett. 13 (3), 353-373 (2023).

- Sapsanis, C., Georgoulas, G., Tzes, A. EMG based classification of basic hand movements based on time-frequency features. , 716-722 (2013).

- Qaisar, S. M., Lopez, A., Dallet, D., Ferrero, F. J. sEMG signal based hand gesture recognition by using selective subbands coefficients and machine learning. , 1-6 (2022).

- Zhang, X., Zhou, P. High-density myoelectric pattern recognition toward improved stroke rehabilitation. IEEE Trans Biomed Eng. 59 (6), 1649-1657 (2012).

- Guo, K., et al. Empowering hand rehabilitation with AI-powered gesture recognition: a study of an sEMG-based system. Bioengineering. 10 (5), 557 (2023).

- Sun, T., Hu, Q., Libby, J., Atashzar, S. F. Deep heterogeneous dilation of LSTM for transient-phase gesture prediction through high-density electromyography: towards application in neurorobotics. IEEE Robot Autom Lett. 7 (2), 2851-2858 (2022).

- Atzori, M., et al. Characterization of a benchmark database for myoelectric movement classification. IEEE Trans Neural Sys Rehabilitat Eng. 23 (1), 73-83 (2015).

- Amma, C., Krings, T., Schultz, T. Advancing muscle-computer interfaces with high-density electromyography. , 929-938 (2015).

- Geng, W., et al. Gesture recognition by instantaneous surface EMG images. Sci Rep. 6 (1), 36571 (2016).

- Wei, W., et al. A multi-stream convolutional neural network for sEMG-based gesture recognition in muscle-computer interface. Pattern Recognit Lett. 119, 131-138 (2019).

- Padhy, S. A tensor-based approach using multilinear SVD for hand gesture recognition from sEMG signals. IEEE Sens J. 21 (5), 6634-6642 (2021).

- Moin, A., et al. A wearable biosensing system with in-sensor adaptive machine learning for hand gesture recognition. Nat Electron. 4 (1), 54-63 (2021).

- Côté-Allard, U., et al. Deep learning for electromyographic hand gesture signal classification using transfer learning. IEEE Trans Neural Sys Rehabilita Eng. 27 (4), 760-771 (2019).

- Liu, Y., Zhang, S., Gowda, M. NeuroPose: 3D hand pose tracking using EMG wearables. , 1471-1482 (2021).

- Dere, M. D., Lee, B. A novel approach to surface EMG-based gesture classification using a vision transformer integrated with convolutive blind source separation. IEEE J Biomed Health Inform. 28 (1), 181-192 (2024).

- Chen, X., Li, Y., Hu, R., Zhang, X., Chen, X. Hand gesture recognition based on surface electromyography using convolutional neural network with transfer learning method. IEEE J Biomed Health Inform. 25 (4), 1292-1304 (2021).

- Lee, K. H., Min, J. Y., Byun, S. Electromyogram-based classification of hand and finger gestures using artificial neural networks. Sensors. 22 (1), 225 (2022).

- Zhou, X., et al. A novel muscle-computer interface for hand gesture recognition using depth vision. J Ambient Intell Humaniz Comput. 11 (11), 5569-5580 (2020).

- Zhang, Z., Yang, K., Qian, J., Zhang, L. Real-time surface EMG pattern recognition for hand gestures based on an artificial neural network. Sensors. 19 (14), 3170 (2019).

- Nieuwoudt, L., Fisher, C. Investigation of real-time control of finger movements utilizing surface EMG signals. IEEE Sens J. 23 (18), 21989-21997 (2023).

- Ben-Ari, L., Ben-Ari, A., Hermon, C., Hanein, Y. Finger gesture recognition with smart skin technology and deep learning. Flexible Printed Electron. 8 (2), 25012 (2023).

- Yang, C., Xie, L. Gesture recognition method based on computer vision and surface electromyography: implementing intention recognition of the healthy side in the hand assessment process. , 663-668 (2024).

- Lin, J., Wu, Y., Huang, T. S. Modeling the constraints of human hand motion. Proc Workshop Human Motion. , 121-126 (2000).

- Arché-Núñez, A., et al. Bio-potential noise of dry printed electrodes: physiology versus the skin-electrode impedance. Physiol Meas. 44 (9), 95006 (2023).

- Gracia-Ibáñez, V., Vergara, M., Sancho-Bru, J. L., Mora, M. C., Piqueras, C. Functional range of motion of the hand joints in activities of the International Classification of Functioning, Disability and Health. J Hand Ther. 30 (3), 337-347 (2017).

- Milosevic, B., Farella, F., Benatti, S. Exploring arm posture and temporal variability in myoelectric hand gesture recognition. , 1032-1037 (2018).

- Gijsberts, A., Atzori, M., Castellini, C., Müller, H., Caputo, B. Movement error rate for evaluation of machine learning methods for sEMG-based hand movement classification. IEEE Trans Neural Sys Rehabilitation Eng. 22 (4), 735-744 (2014).

- Armitano-Lago, C., Willoughby, D., Kiefer, A. W. A SWOT analysis of portable and low-cost markerless motion capture systems to assess lower-limb musculoskeletal kinematics in sport. Front Sports Act Living. 3, 809898 (2022).

Nachdrucke und Genehmigungen

Genehmigung beantragen, um den Text oder die Abbildungen dieses JoVE-Artikels zu verwenden

Genehmigung beantragenWeitere Artikel entdecken

This article has been published

Video Coming Soon

Copyright © 2025 MyJoVE Corporation. Alle Rechte vorbehalten