JoVE 비디오를 활용하시려면 도서관을 통한 기관 구독이 필요합니다. 전체 비디오를 보시려면 로그인하거나 무료 트라이얼을 시작하세요.

Method Article

설계 및 스마트 유리의 음식 섭취 량과 신체 활동 분류에 대 한 평가

요약

이 연구 설계 및 음식 섭취 량의 패턴을 감지 하는 안경 형 착용 형 장치 제조의 프로토콜을 선물 하 고 로드 셀을 사용 하 여 다른 추천된 신체적 활동 안경의 두 경첩에 삽입.

초록

이 연구는 디자인 하 고 음식 섭취 량 그리고 다른 신체 활동 하는 동안 temporalis 근육 활동의 패턴을 감지 하는 안경 형 착용 형 장치 제조의 프로토콜의 일련을 제공 합니다. 우리는 유리와 프레임의 두 경첩에 삽입 된 부하 셀 통합 인쇄 회로 기판 (PCB) 모듈의 3D 인쇄 프레임 조작. 힘 신호를 취득 하 고 그들을 무선으로 전송 하는 모듈 사용 되었다. 이 절차는 높은 이동성, 산책 등 waggling 실용적인 착용 조건에서 계산 될 수 있는 시스템을 제공 합니다. 분류의 성능 또한 그 신체 활동에서 음식 섭취 량의 패턴을 구분 하 여 평가 됩니다. 알고리즘의 시리즈 신호 전처리 기능 벡터를 생성 하 고 몇몇의 패턴을 인식 하는 데 사용 했다 활동 (씹는 및 윙크), 그리고 다른 신체 활동 (앉아있는 나머지, 이야기, 및 산책). 결과 평균 F1 점수 추천된 활동 중 분류의 91.4%가 나타났다. 우리는이 이렇게 자동이 고 객관적인 ingestive 문제를 치료 하는 실용적인 수단으로 높은 정확도와 ingestive 동작의 모니터링을 위한 잠재적으로 유용할 수 있습니다 믿습니다.

서문

음식 섭취 량의 지속적이 고 객관적인 모니터링으로 과도 한 에너지 축적 overweightness 및 비만1, 다양 한 의료 합병증2발생할 수 발생할 수 있습니다 인간의 신체의 에너지 균형을 유지 하기 위한 필수적 이다. 에너지 불균형에 주요 요인으로 과도 한 음식 섭취 및 부족 한 신체 활동3알려져 있습니다. 일일 에너지 지출을 모니터링에 대 한 다양 한 연구 에서도 착용 할 수 있는 장치4,,56, 신체 활동 패턴의 자동 및 객관적인 측정으로 도입 되어 있는 최종 소비자의 수준과 의료 단계7. 그러나 음식 섭취 량의 모니터링에 대 한 연구는, 실험실 설정, 직접적이 고 객관적인 방식으로 음식 섭취 활동을 감지 하기가 어렵습니다 때문에 아직도 이다. 여기, 우리는 장치 설계 및 음식 섭취 및 일상 생활에 실용적인 수준에서 신체 활동 패턴을 모니터링을 위한 그것의 평가 제시 하고자 합니다.

씹는 삼 키는 소리8,9,10, 손목11,,1213의 움직임을 통해 음식 섭취 량을 모니터링, 이미지를 다양 한 간접 접근 되었습니다. 분석14, 그리고 치십시오 (EMG)15. 그러나, 이러한 접근은 그들의 한계 때문에 일상 생활에 대 한 응용 프로그램에 적용 하기 어려운: 소리를 사용 하 여 방법 환경 소리;에 의해 영향을 받을에 취약 했다 손목의 움직임을 사용 하 여 방법 음식;를 소모 하지 때 다른 신체 활동에서 구별 하기 어려운 했다 그리고 이미지와 EMG 신호를 사용 하 여 방법 운동과 환경의 경계에 의해 제한 됩니다. 이러한 연구의 센서를 사용 하 여 음식 섭취 량의 자동된 감지 기능을 보여주지만 여전히 실험실 설정 외에 일상 생활에 실용적인 적용의 제한 했다.

본이 연구에서는 우리 음식 섭취 량을 자동 및 객관적인 모니터링으로 temporalis 근육 활동의 패턴을 사용. Temporalis 근육 수축과 음식 섭취 량16,17; 하는 동안 masticatory 근육의 일환으로 이완을 반복 하는 일반적으로 따라서, 음식 섭취 활동 temporalis 근육 활동의 주기적 패턴을 감지 하 여 모니터링할 수 있습니다. 최근, 여러 연구는 temporalis를 이용 하 여 근육 활동18,19,20,21, EMG 또는 압 전 긴장 사용 되었습니다 센서 및 인간에 직접 연결 피부입니다. 그러나 이러한 접근, EMG 전극 또는 스트레인 센서의 피부 위치에 민감한 되었고 실제 운동 또는 땀이 피부에서 쉽게 분리 했다. 따라서, 우리 안경의 쌍을 사용 하 여 새롭고 효과적인 방법 그런 의미는 temporalis 근육 활동 우리의 이전 연구22에서 두 관절에 삽입 하는 두 개의 로드 셀을 통해 제안 했다. 이 방법은 피부를 건드리지 않고 높은 정확도로 음식 섭취 활동을 감지의 위대한 잠재력을 보여주었다. 그것은 또한 취소 돌출 및 비-간섭, 이후 일반적인 안경 형 장치를 사용 하는 우리.

이 연구에서는 선물이 안경 형 장치를 구현 하는 방법 및 음식 섭취 량과 신체 활동 모니터링을 위한 temporalis 근육 활동의 패턴을 사용 하는 방법의 상세한 프로토콜의 시리즈. 프로토콜의 하드웨어 설계 및 3D 인쇄 프레임 안경, 회로 모듈 및 데이터 수집 모듈의 구성 된 제조 과정을 포함 하 고 데이터 처리 및 분석을 위한 소프트웨어 알고리즘을 포함. 우리는 또한 여러 추천된 활동 (예를 들어, 씹는, 산책, 그리고 윙크) 중 분류 검사 음식 섭취 량 그리고 다른 신체 활동 분 차이 말할 수 있는 실용적인 시스템으로 가능성을 입증 하 패턴입니다.

Access restricted. Please log in or start a trial to view this content.

프로토콜

참고: 인간을 대상의 사용을 포함 한 모든 절차는 단순히 착용 하는 안경의 한 쌍의 비-침략 적 방법에 의해 달성 되었다. 모든 데이터는 로드 셀 피부와 직접 접촉에서 되지 않은 안경에 삽입에서 힘 신호를 측정 하 여 인수 했다. 데이터, 경우에이 연구에 대 한 지정 된 smartphone 데이터 기록 모듈, 무선 전송 했다. 모든 프로토콜은 관련이 없는 비보에/생체 외에서 인간 연구. 아니 약물과 혈액 샘플 실험에 사용 되었다. 동의 실험의 모든 과목에서 얻은 했다.

1. 센서 통합 회로 모듈의 제조

-

전자 부품 회로 모듈 제조 구매.

- 구입 두 공 형 로드 셀, 각각 0 N과 N, 15 사이의 범위에서 동작 하며 3.3 V 여기에서 최대 120 mV 범위와 낮은 차동 전압의 출력을 생성 합니다.

참고:이 로드 셀을 측정 하 되 왼쪽 안경의 오른쪽 측면에 신호를 강제로. - 2 계측 증폭기와 2 개의 15 k ω 이득 설정 저항 구입.

참고: 계측 증폭기 및 이득 설정 저항 960까지 8 회, 로드 셀의 힘 신호를 증폭 하는 데 사용 됩니다 mV. - (예를 들어, Wi-Fi를 연결), 무선 기능 및 10 비트 아날로그-디지털 컨버터 (ADC)와 마이크로 컨트롤러 유닛 (MCU)를 구입.

참고: MCU는 힘 신호를 읽고 무선 데이터 수집 모듈을 그들을 전송 하는 데 사용 됩니다. 2 개의 아날로그 힘 입력 한 아날로그 입력된 핀 사용 됩니다, 때문에 멀티플렉서의 사용 다음 단계 1.1.4에서에서 소개 된다. - MCU에 대 한 ADC 핀 2 개의 입력된 신호를 처리 하는 2 채널 아날로그 멀티플렉서를 구입.

- 3.7 V 공칭 전압, 300 mAh 공칭 용량, 그리고 1 C 방전 율 리튬 이온 중합체 (LiPo) 배터리를 구입.

참고: 배터리 용량 200 mAh 시간당 충분 한 전류를 공급 하 고 실험의 약 1.5 h에 대 한 안정적으로 시스템을 작동 하도록 선택 되었다. - 3.7 V 배터리 전압 3.3 V의 선형 다운 규제에 대 한 3.3 V 전압 조정기를 구입 운영 시스템의 전압.

- MCU의 풀업 저항으로 구매 5 12 k ω 표면 실장 소자 (SMD) 타입 저항 저항기의 발자국은 2.0 m m x 1.2 m m (크기 2012).

- 구입 두 공 형 로드 셀, 각각 0 N과 N, 15 사이의 범위에서 동작 하며 3.3 V 여기에서 최대 120 mV 범위와 낮은 차동 전압의 출력을 생성 합니다.

-

인쇄 회로 기판 (Pcb) 조작. 이 단계는 회로 기판, 그리고 PCB 제조에 대 한 (즉, 보드 레이아웃,.brd 파일) 삽화와 회로도 (즉,.sch 파일)를 만드는 대 한 것 이다. 회로도 아트 워크 파일을 만드는 과정에 대 한 기본적인 이해는 개발에 대 한 필요 합니다.

- 그림 1A와 같이 전자 디자인 응용 프로그램을 사용 하 여 배터리를 포함 하는 왼쪽된 회로의 설계도 그리기. 두 작품 (.brd) 및 회로도 (.sch) 파일 결과 저장 합니다.

- 그림 1B와 같이 전자 디자인 응용 프로그램을 사용 하 여 MCU를 포함 하는 바로 회로의 설계도 그리기. 두 작품 (.brd) 및 회로도 (.sch) 파일 결과 저장 합니다.

- 회로 기판 PCB 제조 회사와 순서를 배치 하 여 조작.

- 그림 2 및 그림 3에서 같이 Pcb 1.1 단계에서 준비 하는 모든 전자 부품을 땜 납.

주의: 계측 증폭기는 납땜 온도에 매우 민감합니다. 리드 온도 10 300 ° C를 초과 하지 않습니다 납땜 하는 동안 s, 그렇지 않으면 발생할 수 있습니다 구성 요소에 영구적인 손상을.

2. 3D 안경의 프레임 인쇄

- 그림 4A와 같이 3D 모델링 도구를 사용 하는 안경의 머리 조각의 3D 모델을 그립니다. .Stl 파일 형식으로 결과 내보냅니다.

- 3D 그림 4B 에 그림 4C와 같이 모델링 도구를 사용 하 여 안경의 왼쪽과 오른쪽 사원의 3D 모델을 그립니다. .Stl 파일 형식으로 결과 내보냅니다.

- 머리 조각 및 사원 부품 노즐 온도 침대 온도 80 ° C 240 ° C에서 3 차원 프린터와 탄소 섬유 필 라 멘 트를 사용 하 여 인쇄 합니다.

참고: 어떤 상업적인 3 차원 프린터와 아크릴로 니트 릴 부 타 디 엔 스 티 렌 (ABS) 등 polylactide (PLA) 필 라 멘 트의 어떤 종류를 사용 하 여 허용 될 수 있습니다. 노즐 및 침대 온도 필 라 멘 트 및 인쇄 조건에 따라 조정할 수 있다. - 180 ° C의 뜨거운 공기 송풍기를 사용 하 여 사원의 팁이 열 하 고 그들에 벤드 안쪽으로 약 15도 기존의 안경 같은 temporalis 근육의 표 피에 연결할.

참고: 안경 템플의 굴곡의 정도 곡률의 목적 때 피사체의 머리에 안경 여 형태 요소를 증가 하는 엄격한 될 필요가 없습니다. 그러나 조심,, 중요 한 패턴을 수집 하는 게 불가능 한 시키는 temporalis 근육을 만지기에서 사원 방지 것입니다 과도 한 굽 힘. - 두 가지 다른 크기의 그림 4와 같이 여러 머리 크기에 맞게 안경 프레임을 인쇄 하려면 2.1-2.4 단계에서 단계를 반복 합니다.

3. 안경의 모든 부품의 조립

- M2 볼트를 사용 하 여 그림 5와 같이 안경의 양쪽에 Pcb를 삽입 합니다.

- 머리 조각과 사원 경첩 관절에 M2 볼트를 삽입 하 여 조립.

- 그림 5와 같이 3 핀 연결 와이어를 사용 하 여 왼쪽 및 오른쪽 PCBs를 연결 합니다.

- 왼쪽된 회로에 배터리를 연결 하 고 접착 테이프로 왼쪽된 관자놀이 연결할. PCB 설계에 따라 다를 수 있습니다 그것은 배터리의 장착 면 중요 하지 않습니다.

- 커버 고무 테이프 끝에 그림 5와 같이 인간의 피부와 함께 더 많은 마찰을 추가 하려면 코 패드와 안경.

4입니다. 데이터 수집 시스템의 개발

참고: 데이터 수집 시스템 데이터 전송 모듈 및 데이터 수신 모듈 구성 됩니다. 데이터 전송 모듈에 읽어들이고 힘 양측의 신호 수신된 데이터를 수집 하 고.tsv 파일에 기록 하는 데이터 수신 모듈에 보냅니다.

-

절차 단계 4.1.1–4.1.3에 따라 PCB 모듈의 MCU 응용 프로그램을 전송 하는 데이터를 업로드.

- 컴퓨터를 사용 하 여 보조 파일에 연결 된 "GlasSense_Server" 프로젝트를 실행 합니다.

참고:이 프로젝트는 Arduino 통합된 개발 환경 (IDE)으로 건축 되었다. 그것은 시간 200 샘플/s, 신호를 강제로 고 데이터 수신 모듈에 전송 하는 기능을 제공 합니다. - 범용 직렬 버스 (USB) 커넥터를 통해 컴퓨터에 PCB 모듈을 연결 합니다.

- Arduino IDE 플래시 MCU에 4.1.1 단계에서 프로그래밍 코드를에 "업로드" 버튼을 누릅니다.

- 컴퓨터를 사용 하 여 보조 파일에 연결 된 "GlasSense_Server" 프로젝트를 실행 합니다.

-

절차 단계 4.2.1–4.2.3에 따라 데이터를 무선으로 수신 하는 데 사용 되는 스마트폰 데이터 수신 응용 프로그램에 업로드.

- 컴퓨터를 사용 하 여 보조 파일에 연결 된 "GlasSense_Client" 프로젝트를 실행 합니다.

참고:이 프로젝트와 함께 만들어진 C# 프로그래밍 언어. 데이터 수신.tsv 파일을 이름, 성별, 나이, 몸 대량 색인 (BMI) 등 피사체의 정보를 포함 하는 저장 하는 기능을 제공 합니다. - 스마트폰 데이터 수신 응용 프로그램을 구축 하는 USB 커넥터를 통해 컴퓨터에 연결 합니다.

- C# 프로젝트는 스마트폰 데이터 수신 응용 프로그램에 "파일 > 빌드 및 실행" 버튼을 누릅니다.

- 컴퓨터를 사용 하 여 보조 파일에 연결 된 "GlasSense_Client" 프로젝트를 실행 합니다.

5. 데이터 수집 사용자 연구에서

참고:이 연구 수집 6 추천된 활동 세트: 앉아있는 (SR), 앉아 있는 씹는 (SC), 걷기 (W), (CW)를 걷는 동안 씹는, 앉아 이야기 (ST), 휴식과 앉아있는 윙크 (남서).

- 테스트할 사용자에 게 적절 한 크기는 안경의 한 쌍을 선택 합니다. 경첩 (그림 5)에서 지원 볼트로 견고를 미 조정 하십시오.

주의: 힘 값이이 연구에 사용 된 힘 센서 동작 범위를 넘어 좋은 선형 특성을 잃을 수 있습니다 이후 15 N를 초과 해서는 안. 힘 값 느슨하게 하 여 미세 하 게 될 수 있습니다 또는 볼트 지원 강화. -

기록 응용 프로그램에 "기록" 버튼을 누르면 모든 과목의 활동 단계 4.2.3 내장.

- 120-s 블록 중 활동을 기록 하 고 그것의 기록 파일을 생성.

- SR의 경우 주제는의 자에 앉아서 그들이 스마트폰 사용 하거나 책을 읽고. 머리의 움직임을 허용 하지만 전신의 움직임을 피하십시오.

- 사우스 캐롤라이나와 CW의 경우, 과목 (구운된 빵과 씹는 젤리) 다른 음식 속성을 반영 하기 위하여 음식 텍스처의 두 종류를 먹고 있다. 식사에 대 한 좋은 크기 20 m m x 20 m m, 조각에서 구운된 빵을 제공 합니다.

- W의 경우 4.5 km/h의 속도에 디딜 방 아에 걸어 주제 있다.

- ST의 경우 과목 앉아서 그들 책을 읽고는 크게 일반 색조와 속도.

- SW의 경우 0.5의 벨 소리의 타이밍에 윙크 하는 과목을 알려 s 긴 모든 3 s.

- 5.2.1 단계에서 수집 된 데이터에서.tsv 형식으로 녹음 파일을 생성 합니다.

참고:이 파일은 데이터 수신 될 때 시간 순서, 왼쪽된 힘 신호, 바로 힘 신호 및 현재 얼굴 활동을 나타내는 레이블이 포함 되어 있습니다. 시각화의 블록 사용자의 모든 활동의 일시적인 신호는 그림 6에서 묘사 했다. 6 추천된 활동 세트 (SR, 사우스 캐롤라이나, W, CW, 세인트와 소프트웨어)는 각각 1, 2, 3, 4, 5, 및 6으로 분류 했다. 프로토콜의 섹션 8에에서 예측된 클래스를 비교 하는 레이블 사용 되었다. - 녹화 블록 후 60의 휴식을 취하. 휴식 시간 동안, 안경 떨어져가지고 고 다시 그들을 입을 다시 녹화 블록 다시 시작 될 때.

- 각 활동 단계 5.2.1 5.2.2 블록 브레이크 세트 4 번을 반복 합니다.

- SW의 경우 반복적으로 한 블록, 동안 왼쪽된 눈으로 윙크 하 고 다음 다음 블록 중 오른쪽 눈으로 반복적으로 윙크 주제가 있다.

- 120-s 블록 중 활동을 기록 하 고 그것의 기록 파일을 생성.

- 5.1-5.2 단계를 반복 하 고 10 과목에서 데이터를 수집 합니다. 이 연구에서 우리는 5 남성과 여성 5를 사용, 평균 연령은 27.9 ± 4.3 (표준 편차, 사 우 스 다코타) 년,는 19-33 년에, 원거리 및 평균 BMI는 21.6 ± 3.2 (사 우 스 다코타) k g/m2는 17.9-27.4 k g/m2에서 배열 했다.

참고:이 연구에서 누가 어떤 의료 조건, 음식을 씹을 하지 않은 과목 윙크, 산책 했다 모집, 그리고이 조건은 포함 기준에 사용 되었다.

6. 신호 전처리 및 시장 세분화

참고: 왼쪽 및 오른쪽 신호는 다음 절차에서 별도로 계산 됩니다.

-

2의 시간 프레임을 준비 s 긴.

- 세그먼트는 120의 1-s 간격으로 그림 6과 같이 MATLAB를 사용 하 여 호핑에 의해 2 s 프레임의 집합으로 신호를 기록.

참고: 세그먼트 프레임 2의 s 긴 섹션 7에서에서 특징을 추출 하는 데 사용 했다. 1 s 도약 크기 단계 5.2.1에서에서 이미 언급 한 3 s 윙크 간격으로 신호를 분할 하기로 결정 했습니다. - 각 프레임에 대 한 10 Hz의 컷오프 주파수 5번째 차 버터워스 필터를 사용 하 여 저역 통과 필터 (LPF)를 적용 합니다.

- 7.1 단계에서 다음 단계에 대 한 시간 프레임으로 단계 6.1.2의 결과 저장 합니다.

- 세그먼트는 120의 1-s 간격으로 그림 6과 같이 MATLAB를 사용 하 여 호핑에 의해 2 s 프레임의 집합으로 신호를 기록.

-

일련의 스펙트럼 프레임을 준비.

- 안경을 착용 했을 때 미리 로드를 제거 하는 각 프레임의 원래 신호에서 평균을 뺍니다.

그러나 참고: 미리 값 다음 주파수 분석에 대 한 필요 하지 않습니다, 그리고 때문에 그것은 수 있었다, 씹는, 산책, 윙크, 등 에 대 한 정보를 포함 하지 않습니다에서 주제, 주제에서 다를 수 있습니다 중요 한 정보를 포함 모든 설정의 안경, 그리고 순간에서 주제는 안경 착용. - 해 창 주파수 분석, 스펙트럼 누설을 줄이기 위해 각 프레임에 적용 됩니다.

- 생성 하 고 각 프레임에는 고속 푸리에 변환 (FFT)을 적용 하 여 단면 스펙트럼을 저장 합니다.

- 안경을 착용 했을 때 미리 로드를 제거 하는 각 프레임의 원래 신호에서 평균을 뺍니다.

- 시간적 및 프레임 블록으로 동시의 스펙트럼 프레임 (또는 단순히 프레임)의 조합을 정의 합니다.

7입니다. 특징 벡터의 생성

참고: 기능 벡터 프로토콜의 섹션 6에서에서 생산 하는 프레임 마다 생성 됩니다. 왼쪽 및 오른쪽 프레임은 별도로 계산 하 고 다음 절차에서 기능 벡터에 결합. 모든 절차는 MATLAB에 구현 했다.

- 프로토콜의 단계 6.1에서에서 시간 프레임에서 통계 기능을 추출 합니다. 54 특징의 총 수의 목록 표 1에 주어진 다.

- 6.2 프로토콜의 단계에서 스펙트럼 프레임에서 통계 기능을 추출 합니다. 표 2에 30 특징의 총 수의 목록이 제공 됩니다.

- 위의 일시 및 스펙트럼 기능을 결합 하 여 84 차원 특징 벡터를 생성 합니다.

- 5.2 프로토콜의 단계에서 녹음에서 생성 된 특징 벡터를 레이블을 지정 합니다.

- 모든 프레임 블록 단계 7.1-7.4에서에서 단계를 반복 하 고 기능 벡터의 일련을 생성.

8입니다. 클래스에 활동의 분류

참고:이 단계는 주어진된 문제 (즉, 기능 벡터)에서 최고의 정확도 표시 하는 매개 변수를 확인 하 여 지원 벡터 기계 (SVM)23 의 분류자 모델을 선택 하는. SVM은 잘 알려진 감독된 기계 학습 기법을 일반화 및 견고성 클래스와 커널 함수 사이의 최대 여백을 사용 하 여 우수한 성능을 보여줍니다. 우리 페널티 매개 변수 C와 커널 정의를 그리드 검색 및 교차 유효성 검사 메서드를 사용의 방사형으로 함수 (RBF) 커널 매개 변수 γ. 컴퓨터 기술과 SVM 학습의 최소 이해는 다음 절차를 수행 해야 합니다. 일부 참조 자료23,,2425 는 기계 학습 기술 및 SVM 알고리즘의 더 나은 이해 하는 것이 좋습니다. 이 섹션의 모든 절차는 LibSVM25 소프트웨어 패키지를 사용 하 여 구현 되었습니다.

- 그리드 검색에 대 한 쌍 (C, γ)의 표를 정의 합니다. 사용 기 하 급수적으로 성장 하는 C의 시퀀스 (2-10, 2-5,..., 230)와 γ (2-25,..., 2, 2-30,10).

참고: 이러한 시퀀스는 스스로 결정 했다. - 한 쌍 (C, γ)의 정의 (예를 들어, (2-10, 2-30)).

-

8.2 단계에서 정의 된 격자 10 교차 유효성 검사 체계를 수행 합니다.

참고:이 전체 기능 벡터 10 일부 하위 집합으로, 다음 다른 하위에 의해 훈련 분류자 모델에서 하나의 하위 집합을 테스트 나누고 모든 하위 집합을 통해 반복 하나. 따라서, 모든 기능은 벡터는 순차적으로 테스트할 수 있습니다.- 전체 기능 벡터 10 일부 하위 집합으로 나눕니다.

- 하위 집합, 그리고 나머지 9 하위 집합에서 설정 하는 훈련에서 테스트 집합을 정의 합니다.

- 배율 벡터의 범위에 기능 벡터의 모든 요소를 확장 하는 정의 [0, 1] 학습 집합에 대 한.

참고: 배율 벡터는 특징 벡터와 동일한 차원의. 그것은 이루어져 있다 모든 기능 벡터 같은 행 (또는 열)를 확장 하는 멀티 플라이어의 집합의 범위를 [0, 1]. 예를 들어 기능 벡터의 첫 번째 기능은 선형 조정 됩니다의 범위 [0, 1] 훈련 특징 벡터의 모든 첫 번째 기능에 대 한. Note 테스트 세트를 알 수 없는으로 간주 한다 때문에 배율 벡터 학습 집합에서 정의 됩니다. 이 단계 기능 동일 범위 및 계산 하는 동안 숫자 오류를 방지 함으로써 분류의 정확도 증가 한다. - 범위를 설정 하는 훈련의 각 기능을 확장 [0, 1] 단계 8.2.3에서에서 얻은 배율 벡터를 사용 하 여.

- 범위를 설정 하는 테스트의 각 기능을 확장 [0, 1] 단계 8.2.3에서에서 얻은 배율 벡터를 사용 하 여.

- 훈련 단계 8.2, (γ, C)의 정의 된 쌍으로 SVM 통해 학습 집합 빌드하고 분류자 모델.

- (Γ, C)의 정의 된 쌍으로 SVM 통해 테스트 집합을 테스트 하는 단계 8.2에서 그리고 분류자 모델 훈련 절차에서.

- 테스트 집합에 분류 정확도 계산 합니다. 정확도 올바르게 분류 기능 벡터의 비율에서 산출 되었다.

- 모든 하위 집합에 대 한 단계 8.2.2–8.2.8를 반복 하 고 모든 하위 집합의 평균 정확도 계산 합니다.

- (C, γ)의 한 쌍의 모든 격자 포인트 8.2-8.3.9 단계를 반복 합니다.

- 격자의 가장 높은 정확도의 현지 최대를 찾아. 섹션 8의 모든 절차는 그림 7에 설명 됩니다.

- (선택 사항) 그리드의 단계 거친 간주 됩니다, 지역 최대 근처 미세한 격자 단계 8.1-8.5 8.5, 단계에서 발견 하 고 정밀한 격자의 새로운 현지 최대를 찾을 반복 합니다.

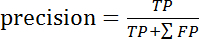

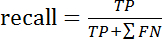

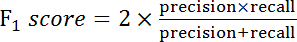

- 정밀, 리콜, 그리고 다음 방정식에서 활동의 각 클래스의 F1 점수 계산:

공식 1

공식 1 공식 2

공식 2 식 3

식 3

어디 TP, FP, 그리고 FN 참 긍정, 거짓 긍정, 그리고 각 활동에 대 한 false 네거티브 각각 나타냅니다. 모든 활동의 혼란 매트릭스 표 3에서 제공 됩니다.

Access restricted. Please log in or start a trial to view this content.

결과

프로토콜에서 설명 하는 절차를 통해 우리 준비 3D 인쇄 프레임의 두 가지 버전의 머리 조각, LH (133 및 138 m m), 그리고 사원, LT (110 및 125 m m), 길이 차별화 하 여 그림 4에서처럼. 따라서, 우리는 과목 머리 크기, 모양, 등 과목 선택 사용자 연구에 대 한 그들의 머리에 맞게 프레임 중 하나에서 변화 될 수 있는 여러 가지 착용 조건...

Access restricted. Please log in or start a trial to view this content.

토론

이 연구에서 우리는 먼저 설계 및 음식 섭취 량과 신체 활동의 패턴을 감지 하는 안경의 제조 과정을 제안 했다. 이 연구는 다른 신체 활동 (산책과 윙크)에서 음식 섭취 량을 구분 하는 데이터 분석에 주로 집중, 센서 및 데이터 수집 시스템 필요한 이동성 녹음의 구현. 따라서, 시스템 센서, 무선 통신 기능, MCU와 배터리 포함 되어있습니다. 소설과 비 접촉 방식으로 음식 섭취 량과 윙크 temporalis 근...

Access restricted. Please log in or start a trial to view this content.

공개

저자는 공개 없다.

감사의 말

이 작품은 Envisible, i n c.에 의해 지원 되었다 이 연구는 한국 건강 기술 R & D 프로젝트, 보건 복지, 한국 공화국 (HI15C1027)의 교부 금에 의해 또한 지원 되었다. 이 연구는 국립 연구 재단의 한국 (NRF-2016R1A1A1A05005348)에 의해 또한 지원 되었다.

Access restricted. Please log in or start a trial to view this content.

자료

| Name | Company | Catalog Number | Comments |

| FSS1500NSB | Honeywell, USA | Load cell | |

| INA125U | Texas Instruments, USA | Amplifier | |

| ESP-07 | Shenzhen Anxinke Technology, China | MCU with Wi-Fi module | |

| 74LVC1G3157 | Nexperia, The Netherlands | Multiplexer | |

| MP701435P | Maxpower, China | LiPo battery | |

| U1V10F3 | Pololu, USA | Voltage regulator | |

| Ultimaker 2 | Ultimaker, The Netherlands | 3D printer | |

| ColorFabb XT-CF20 | ColorFabb, The Netherlands | Carbon fiber filament | |

| iPhone 6s Plus | Apple, USA | Data acquisition device | |

| Jelly Belly | Jelly Belly Candy Company, USA | Food texture for user study |

참고문헌

- Sharma, A. M., Padwal, R. Obesity is a sign-over-eating is a symptom: an aetiological framework for the assessment and management of obesity. Obes Rev. 11 (5), 362-370 (2010).

- Pi-Sunyer, F. X., et al. Clinical guidelines on the identification, evaluation, and treatment of overweight and obesity in adults. Am J Clin Nutr. 68 (4), 899-917 (1998).

- McCrory, P., Strauss, B., Wahlqvist, M. L. Energy balance, food intake and obesity. Exer Obes. , London. (1994).

- Albinali, F., Intille, S., Haskell, W., Rosenberger, M. Proceedings of the 12th ACM international conference on Ubiquitous computing. , ACM. 311-320 (2010).

- Bonomi, A., Westerterp, K. Advances in physical activity monitoring and lifestyle interventions in obesity: a review. Int J Obes. 36 (2), 167-177 (2012).

- Jung, S., Lee, J., Hyeon, T., Lee, M., Kim, D. H. Fabric-Based Integrated Energy Devices for Wearable Activity Monitors. Adv Mater. 26 (36), 6329-6334 (2014).

- Fulk, G. D., Sazonov, E. Using sensors to measure activity in people with stroke. Top Stroke Rehabil. 18 (6), 746-757 (2011).

- Makeyev, O., Lopez-Meyer, P., Schuckers, S., Besio, W., Sazonov, E. Automatic food intake detection based on swallowing sounds. Biomed Signal Process Control. 7 (6), 649-656 (2012).

- Päßler, S., Fischer, W. Food intake activity detection using an artificial neural network. Biomed Tech (Berl). , (2012).

- Passler, S., Fischer, W. -J. Food intake monitoring: Automated chew event detection in chewing sounds. IEEE J Biomed Health Inform. 18 (1), 278-289 (2014).

- Kadomura, A., et al. CHI'13 Extended Abstracts on Human Factors in Computing Systems. , ACM. 1551-1556 (2013).

- Fontana, J. M., Farooq, M., Sazonov, E. Automatic ingestion monitor: A novel wearable device for monitoring of ingestive behavior. IEEE Trans Biomed Eng. 61 (6), 1772-1779 (2014).

- Shen, Y., Salley, J., Muth, E., Hoover, A. Assessing the Accuracy of a Wrist Motion Tracking Method for Counting Bites across Demographic and Food Variables. IEEE J Biomed Health Inform. , (2016).

- Farooq, M., Sazonov, E. International Conference on Bioinformatics and Biomedical Engineering. , Springer. 464-472 (2017).

- Grigoriadis, A., Johansson, R. S., Trulsson, M. Temporal profile and amplitude of human masseter muscle activity is adapted to food properties during individual chewing cycles. J Oral Rehab. 41 (5), 367-373 (2014).

- Strini, P. J. S. A., Strini, P. J. S. A., de Souza Barbosa, T., Gavião, M. B. D. Assessment of thickness and function of masticatory and cervical muscles in adults with and without temporomandibular disorders. Arch Oral Biol. 58 (9), 1100-1108 (2013).

- Standring, S. Gray's anatomy: the anatomical basis of clinical practice. , Elsevier Health Sciences. (2015).

- Farooq, M., Sazonov, E. A novel wearable device for food intake and physical activity recognition. Sensors. 16 (7), 1067(2016).

- Zhang, R., Amft, O. Proceedings of the 2016 ACM International Symposium on Wearable Computers. , ACM. 50-52 (2016).

- Farooq, M., Sazonov, E. Segmentation and Characterization of Chewing Bouts by Monitoring Temporalis Muscle Using Smart Glasses with Piezoelectric Sensor. IEEE J Biomed Health Inform. , (2016).

- Huang, Q., Wang, W., Zhang, Q. Your Glasses Know Your Diet: Dietary Monitoring using Electromyography Sensors. IEEE Internet of Things Journal. , (2017).

- Chung, J., et al. A glasses-type wearable device for monitoring the patterns of food intake and facial activity. Scientific Reports. 7, 41690(2017).

- Cristianini, N., Shawe-Taylor, J. An introduction to support Vector Machines: and other kernel-based learning methods. , Cambridge University Press Cambridge. (2000).

- Giannakopoulos, T., Pikrakis, A. Introduction to Audio Analysis: A MATLAB Approach. , Academic Press. (2014).

- Chang, C. -C., Lin, C. -J. LIBSVM: a library for support vector machines. ACM Trans Intell Syst Technol. 2 (3), 27(2011).

- Po, J., et al. Time-frequency analysis of chewing activity in the natural environment. J Dent Res. 90 (10), 1206-1210 (2011).

- Ji, T. Frequency and velocity of people walking. Struct Eng. 84 (3), 36-40 (2005).

- Knoblauch, R., Pietrucha, M., Nitzburg, M. Field studies of pedestrian walking speed and start-up time. Transp Res Red. 1538, 27-38 (1996).

Access restricted. Please log in or start a trial to view this content.

재인쇄 및 허가

JoVE'article의 텍스트 или 그림을 다시 사용하시려면 허가 살펴보기

허가 살펴보기더 많은 기사 탐색

This article has been published

Video Coming Soon

Copyright © 2025 MyJoVE Corporation. 판권 소유