Zum Anzeigen dieser Inhalte ist ein JoVE-Abonnement erforderlich. Melden Sie sich an oder starten Sie Ihre kostenlose Testversion.

Method Article

End-to-End-Deep Neural Network zur Erkennung von markanten Objekten in komplexen Umgebungen

In diesem Artikel

Zusammenfassung

Das vorliegende Protokoll beschreibt einen neuartigen End-to-End-Algorithmus zur Erkennung von auffälligen Objekten. Es nutzt tiefe neuronale Netze, um die Präzision der Erkennung von auffälligen Objekten in komplizierten Umgebungskontexten zu verbessern.

Zusammenfassung

Die Erkennung hervorstechender Objekte hat sich zu einem aufstrebenden Interessengebiet im Bereich der Computer Vision entwickelt. Die vorherrschenden Algorithmen weisen jedoch eine verminderte Präzision auf, wenn sie mit der Erkennung hervorstechender Objekte in komplizierten und facettenreichen Umgebungen beauftragt sind. Angesichts dieses dringenden Anliegens stellt dieser Artikel ein tiefes neuronales End-to-End-Netzwerk vor, das darauf abzielt, hervorstechende Objekte in komplexen Umgebungen zu erkennen. Die Studie stellt ein tiefes neuronales End-to-End-Netzwerk vor, das darauf abzielt, hervorstechende Objekte in komplexen Umgebungen zu erkennen. Das vorgeschlagene Netzwerk besteht aus zwei miteinander verbundenen Komponenten, nämlich einem Pixel-Level-Multiscale-Full-Convolutional-Network und einem tiefen Encoder-Decoder-Netzwerk, und integriert kontextuelle Semantik, um visuellen Kontrast über Multiskalen-Feature-Maps hinweg zu erzeugen, während tiefe und flache Bildmerkmale verwendet werden, um die Genauigkeit der Objektgrenzenidentifikation zu verbessern. Die Integration eines vollständig verbundenen CRF-Modells (Conditional Random Field) verbessert die räumliche Kohärenz und Konturabgrenzung von Salient Maps weiter. Der vorgeschlagene Algorithmus wird ausführlich anhand von 10 zeitgenössischen Algorithmen in den SOD- und ECSSD-Datenbanken evaluiert. Die Evaluierungsergebnisse zeigen, dass der vorgeschlagene Algorithmus andere Ansätze in Bezug auf Präzision und Genauigkeit übertrifft und damit seine Wirksamkeit bei der Erkennung hervorstechender Objekte in komplexen Umgebungen belegt.

Einleitung

Die Erkennung von auffälligen Objekten ahmt die menschliche visuelle Aufmerksamkeit nach und identifiziert schnell wichtige Bildbereiche, während Hintergrundinformationen unterdrückt werden. Diese Technik wird häufig als Vorverarbeitungswerkzeug bei Aufgaben wie dem Zuschneiden von Bildern1, der semantischen Segmentierung2 und der Bildbearbeitung3 eingesetzt. Es rationalisiert Aufgaben wie das Ersetzen des Hintergrunds und die Extraktion des Vordergrunds und verbessert die Bearbeitungseffizienz und -präzision. Darüber hinaus hilft es bei der semantischen Segmentierung, indem es die Ziellokalisierung verbessert. Das Potenzial der Erkennung hervorstechender Objekte, die Recheneffizienz zu steigern und Speicher zu sparen, unterstreicht ihre bedeutenden Forschungs- und Anwendungsaussichten.

Im Laufe der Jahre hat sich die Erkennung markanter Objekte von anfänglichen traditionellen Algorithmen zur Integration von Deep-Learning-Algorithmen entwickelt. Das Ziel dieser Fortschritte war es, die Lücke zwischen der Erkennung von auffälligen Objekten und menschlichen visuellen Mechanismen zu schließen. Dies hat zur Einführung von Deep-Convolutional-Network-Modellen für die Untersuchung der Erkennung von hervorstechenden Objekten geführt. Borji et al.4 fassten die meisten der klassischen traditionellen Algorithmen zusammen und verallgemeinerten sie, die sich auf die zugrunde liegenden Merkmale des Bildes stützen. Trotz einer gewissen Verbesserung der Erkennungsgenauigkeit stellen manuelle Erfahrung und Kognition weiterhin Herausforderungen für die Erkennung von auffälligen Objekten in komplexen Umgebungen dar.

Die Verwendung von Convolutional Neural Networks (CNNs) ist im Bereich der Erkennung von auffälligen Objekten weit verbreitet. In diesem Zusammenhang werden tiefe neuronale Faltungsnetze für Gewichtsaktualisierungen durch autonomes Lernen verwendet. Convolutional Neural Networks wurden eingesetzt, um kontextuelle Semantik aus Bildern durch die Verwendung von kaskadierten Faltungs- und Pooling-Schichten zu extrahieren, was das Erlernen komplexer Bildmerkmale auf höheren Ebenen ermöglicht, die eine höhere Unterscheidungs- und Charakterisierungsfähigkeit für die Erkennung von hervorstechenden Objekten in verschiedenen Umgebungen aufweisen.

Im Jahr 2016 gewannen vollständig gefaltete neuronale Netze5 als beliebter Ansatz für die Erkennung hervorstechender Objekte erheblich an Bedeutung, auf deren Grundlage Forscher mit der Erkennung von hervorstechenden Objekten auf Pixelebene begannen. Viele Modelle basieren in der Regel auf bestehenden Netzwerken (z. B. VGG166, ResNet7), um die Bilddarstellung zu verbessern und den Effekt der Kantenerkennung zu verstärken.

Liu et al.8 verwendeten ein bereits trainiertes neuronales Netzwerk als Framework, um das Bild global zu berechnen, und verfeinerten dann die Objektgrenze mit einem hierarchischen Netzwerk. Die Kombination der beiden Netzwerke bildet das endgültige Deep-Saliency-Netzwerk. Dies wurde erreicht, indem die zuvor erworbene hervorstechende Karte wiederholt als Vorwissen in das Netzwerk eingespeist wurde. Zhang et al.9 fusionierten effektiv semantische und räumliche Bildinformationen unter Verwendung tiefer Netzwerke mit bidirektionalem Informationstransfer von flachen zu tiefen bzw. von tiefen zu flachen Schichten. Die Erkennung von hervorstechenden Objekten mit Hilfe eines Deep-Modells für gegenseitiges Lernen wurde von Wu et al.10 vorgeschlagen. Das Modell nutzt Vordergrund- und Kanteninformationen innerhalb eines neuronalen Faltungsnetzes, um den Erkennungsprozess zu erleichtern. Li et al.11 verwendeten den "Lochalgorithmus" neuronaler Netze, um die Herausforderung zu bewältigen, die rezeptiven Felder verschiedener Schichten in tiefen neuronalen Netzen im Zusammenhang mit der Erkennung von hervorstechenden Objekten zu fixieren. Für die Erfassung von Objektkanten wird jedoch die Superpixelsegmentierung verwendet, was den Rechenaufwand und die Rechenzeit erheblich erhöht. Ren et al.12 entwickelten ein Multiskalen-Encoder-Decoder-Netzwerk, um hervorstechende Objekte zu erkennen, und nutzten neuronale Faltungsnetze, um tiefe und flache Merkmale effektiv zu kombinieren. Obwohl die Herausforderung der Grenzunschärfe bei der Objekterkennung durch diesen Ansatz gelöst wird, führt die Multiskalenfusion von Informationen unvermeidlich zu erhöhten Rechenanforderungen.

Die Literaturübersicht13 schlägt vor, dass die Salienzerkennung, von traditionellen Methoden zu Deep-Learning-Methoden, zusammengefasst wird und die Entwicklung der Salienzzielerkennung von ihren Ursprüngen bis zur Ära des Deep Learning sehr deutlich zu sehen ist. In der Literatur wurden verschiedene RGB-D-basierte Modelle zur Erkennung von auffälligen Objekten mit guter Leistung vorgeschlagen14. Die obige Literatur gibt einen Überblick über und klassifiziert die verschiedenen Arten von Algorithmen zur Erkennung von Salienzobjekten und beschreibt ihre Anwendungsszenarien, die verwendeten Datenbanken und die Auswertungsmetriken. Dieser Artikel bietet auch eine qualitative und quantitative Analyse der vorgeschlagenen Algorithmen hinsichtlich ihrer vorgeschlagenen Datenbanken und Bewertungsmetriken.

Alle oben genannten Algorithmen haben bemerkenswerte Ergebnisse in öffentlichen Datenbanken erzielt und bieten eine Grundlage für die Erkennung auffälliger Objekte in komplexen Umgebungen. Obwohl es sowohl im In- als auch im Ausland zahlreiche Forschungserfolge auf diesem Gebiet gibt, gibt es noch einige Probleme zu lösen. (1) Herkömmliche Nicht-Deep-Learning-Algorithmen haben in der Regel eine geringe Genauigkeit, da sie auf manuell gekennzeichnete Merkmale wie Farbe, Textur und Frequenz angewiesen sind, die leicht durch subjektive Erfahrung und Wahrnehmung beeinflusst werden können. Folglich ist die Präzision ihrer Fähigkeiten zur Erkennung hervorstechender Objekte verringert. Die Erkennung auffälliger Objekte in komplexen Umgebungen mit herkömmlichen Nicht-Deep-Learning-Algorithmen ist aufgrund ihrer Schwierigkeiten bei der Handhabung komplizierter Szenarien eine Herausforderung. (2) Herkömmliche Methoden zur Erkennung von auffälligen Objekten weisen aufgrund ihrer Abhängigkeit von manuell gekennzeichneten Merkmalen wie Farbe, Textur und Frequenz eine begrenzte Genauigkeit auf. Darüber hinaus kann die Erkennung auf Regionsebene rechenintensiv sein, wobei die räumliche Konsistenz oft ignoriert wird und Objektgrenzen tendenziell schlecht erkannt werden. Diese Probleme müssen angegangen werden, um die Präzision der Erkennung hervorstechender Objekte zu verbessern. (3) Die Erkennung von auffälligen Objekten in komplizierten Umgebungen stellt für die meisten Algorithmen eine Herausforderung dar. Die meisten Algorithmen zur Erkennung von auffälligen Objekten stehen vor ernsthaften Herausforderungen aufgrund der immer komplexeren Umgebung zur Erkennung von auffälligen Objekten mit variablen Hintergründen (ähnliche Hintergrund- und Vordergrundfarben, komplexe Hintergrundtexturen usw.), vielen Unsicherheiten wie inkonsistenten Erkennungsobjektgrößen und der unklaren Definition von Vorder- und Hintergrundkanten.

Die meisten der aktuellen Algorithmen weisen eine geringe Genauigkeit bei der Erkennung hervorstechender Objekte in komplexen Umgebungen mit ähnlichen Hintergrund- und Vordergrundfarben, komplexen Hintergrundtexturen und verschwommenen Kanten auf. Obwohl aktuelle Deep-Learning-basierte Algorithmen für hervorstechende Objekte eine höhere Genauigkeit aufweisen als herkömmliche Erkennungsmethoden, sind die zugrunde liegenden Bildmerkmale, die sie verwenden, immer noch nicht in der Lage, semantische Merkmale effektiv zu charakterisieren, was Raum für Verbesserungen in ihrer Leistung lässt.

Zusammenfassend schlägt diese Studie ein tiefes neuronales End-to-End-Netzwerk für einen Algorithmus zur Erkennung von auffälligen Objekten vor, der darauf abzielt, die Genauigkeit der Erkennung von auffälligen Objekten in komplexen Umgebungen zu verbessern, Zielkanten zu verbessern und semantische Merkmale besser zu charakterisieren. Die Beiträge dieses Papiers sind wie folgt: (1) Das erste Netzwerk verwendet VGG16 als Basisnetzwerk und modifiziert seine fünf Pooling-Schichten mit dem "Lochalgorithmus"11. Das vollständig gefaltete neuronale Multiskalennetz auf Pixelebene lernt Bildmerkmale aus verschiedenen räumlichen Maßstäben, um die Herausforderung statischer rezeptiver Felder über verschiedene Schichten tiefer neuronaler Netze hinweg zu bewältigen und die Erkennungsgenauigkeit in wichtigen Schwerpunktbereichen des Feldes zu verbessern. (2) Jüngste Bemühungen, die Genauigkeit der Erkennung hervorstechender Objekte zu verbessern, konzentrierten sich auf die Nutzung tieferer neuronaler Netze wie VGG16, um sowohl Tiefenmerkmale aus dem Encoder-Netzwerk als auch flache Merkmale aus dem Decoder-Netzwerk zu extrahieren. Dieser Ansatz verbessert effektiv die Erkennungsgenauigkeit von Objektgrenzen und verbessert semantische Informationen, insbesondere in komplexen Umgebungen mit variablen Hintergründen, inkonsistenten Objektgrößen und undeutlichen Grenzen zwischen Vorder- und Hintergrund. (3) Jüngste Bemühungen, die Präzision der Erkennung hervorstechender Objekte zu verbessern, haben die Verwendung tieferer Netzwerke, einschließlich VGG16, zum Extrahieren tiefer Merkmale aus dem Encoder-Netzwerk und flacher Merkmale aus dem Decoder-Netzwerk betont. Dieser Ansatz hat eine verbesserte Erkennung von Objektgrenzen und mehr semantische Informationen gezeigt, insbesondere in komplexen Umgebungen mit unterschiedlichen Hintergründen, Objektgrößen und undeutlichen Grenzen zwischen Vorder- und Hintergrund. Darüber hinaus wurde die Integration eines vollständig verbundenen CRF-Modells (Conditional Random Field) implementiert, um die räumliche Kohärenz und Konturpräzision von hervorstechenden Karten zu erhöhen. Die Wirksamkeit dieses Ansatzes wurde anhand von SOD- und ECSSD-Datensätzen mit komplexem Hintergrund bewertet und als statistisch signifikant befunden.

Verwandte Arbeiten

Fu et al.15 schlugen einen gemeinsamen Ansatz vor, bei dem RGB und Deep Learning zur Erkennung von auffälligen Objekten verwendet werden. Lai et al.16 führten ein schwach überwachtes Modell für die Erkennung von markanten Objekten ein, das aus Annotationen hervorsticht, wobei hauptsächlich Scribble-Labels verwendet werden, um Annotationszeit zu sparen. Während diese Algorithmen eine Fusion zweier komplementärer Netzwerke für die Erkennung von Salienzobjekten darstellten, fehlt ihnen eine eingehende Untersuchung der Salienzerkennung unter komplexen Szenarien. Wang et al.17 entwarfen eine iterative Fusion neuronaler Netzwerkfunktionen in zwei Modi, sowohl von unten nach oben als auch von oben nach unten, wobei die Ergebnisse der vorherigen Iteration schrittweise bis zur Konvergenz optimiert wurden. Zhang et al.18 fusionierten effektiv semantische und räumliche Bildinformationen unter Verwendung tiefer Netzwerke mit bidirektionalem Informationstransfer von flachen nach tiefen bzw. von tiefen zu flachen Schichten. Die Erkennung von hervorstechenden Objekten mit Hilfe eines Deep-Modells für gegenseitiges Lernen wurde von Wu et al.19 vorgeschlagen. Das Modell nutzt Vordergrund- und Kanteninformationen innerhalb eines neuronalen Faltungsnetzes, um den Erkennungsprozess zu erleichtern. Diese auf tiefen neuronalen Netzen basierenden Modelle zur Erkennung hervorstechender Objekte haben eine bemerkenswerte Leistung bei öffentlich zugänglichen Datensätzen erzielt und ermöglichen die Erkennung von hervorstechenden Objekten in komplexen natürlichen Szenen. Dennoch bleibt die Entwicklung noch überlegenerer Modelle ein wichtiges Ziel in diesem Forschungsfeld und dient als Hauptmotivation für diese Studie.

Allgemeiner Rahmen

Die schematische Darstellung des vorgeschlagenen Modells, wie in Abbildung 1 dargestellt, ist hauptsächlich von der VGG16-Architektur abgeleitet und umfasst sowohl ein vollständig konvolutionales neuronales Netzwerk (DCL) auf Pixelebene als auch ein tiefes Encoder-Decoder-Netzwerk (DEDN). Das Modell eliminiert alle endgültigen Pooling- und vollständig verbundenen Schichten von VGG16 und berücksichtigt gleichzeitig Eingabebildabmessungen von B × H. Der Betriebsmechanismus umfasst die anfängliche Verarbeitung des Eingabebildes über die DCL, was die Extraktion tiefer Merkmale erleichtert, während flache Merkmale aus den DEDN-Netzwerken abgerufen werden. Die Verschmelzung dieser Merkmale wird anschließend einem vollständig verbundenen bedingten Zufallsfeldmodell (CRF) unterzogen, das die räumliche Kohärenz und Konturgenauigkeit der erstellten Salienzkarten erhöht.

Um die Wirksamkeit des Modells zu ermitteln, wurde es an SOD20 - und ECSSD21-Datensätzen mit komplizierten Hintergründen getestet und validiert. Nachdem das Eingabebild die DCL durchlaufen hat, werden verschiedene maßstabsgetreue Feature-Maps mit verschiedenen rezeptiven Feldern erhalten, und kontextuelle Semantik wird kombiniert, um eine W × H hervorstechende Karte mit interdimensionaler Kohärenz zu erzeugen. Die DCL verwendet ein Paar von Faltungsschichten mit 7 x 7 Kerneln, um die letzte Pooling-Schicht des ursprünglichen VGG16-Netzwerks zu ersetzen und die Erhaltung räumlicher Informationen in den Feature-Maps zu verbessern. In Kombination mit kontextueller Semantik ergibt dies eine hervorstechende W × H-Karte mit interdimensionaler Kohärenz. In ähnlicher Weise verwendet das Deep Encoder-Decoder Network (DEDN) Faltungsschichten mit 3 x 3 Kerneln in den Decodern und einer einzelnen Faltungsschicht nach dem letzten Dekodierungsmodul. Durch die Nutzung tiefer und flacher Merkmale des Bildes ist es möglich, eine hervorstechende Karte mit einer räumlichen Dimension von B × H zu erstellen, die die Herausforderung undeutlicher Objektgrenzen angeht. Die Studie beschreibt eine bahnbrechende Technik zur Erkennung von auffälligen Objekten, die die DCL- und DEDN-Modelle zu einem einheitlichen Netzwerk zusammenführt. Die Gewichte dieser beiden tiefen Netzwerke werden durch einen Trainingsprozess gelernt, und die resultierenden Salienzkarten werden zusammengeführt und dann mit einem vollständig verbundenen Conditional Random Field (CRF) verfeinert. Das Hauptziel dieser Verfeinerung ist die Verbesserung der räumlichen Konsistenz und der Konturlokalisierung.

Multiskaliges neuronales Multiscale-Netzwerk mit vollständiger Faltung

Die VGG16-Architektur bestand ursprünglich aus fünf Pooling-Schichten mit jeweils 2 Schritten. Jede Pooling-Schicht komprimiert die Bildgröße, um die Anzahl der Kanäle zu erhöhen und mehr Kontextinformationen zu erhalten. Das DCL-Modell ist von der Literatur13 inspiriert und stellt eine Verbesserung des Rahmens von VGG16 dar. In diesem Artikel wird ein DCL-Modell11 auf Pixelebene verwendet, wie in Abbildung 2 innerhalb der Architektur von VGG16, einem tiefen neuronalen Faltungsnetz, gezeigt. Die anfänglichen vier maximalen Pooling-Schichten sind mit drei Kerneln verbunden. Der erste Kern ist 3 × 3 × 128; der zweite Kern ist 1 × 1 × 128; und der dritte Kern ist 1 × 1 × 1. Um eine einheitliche Größe von Feature-Maps nach den ersten vier Pooling-Layern zu erreichen, die mit drei Kernen verbunden sind, wobei jede Größe einem Achtel des Originalbilds entspricht, wird die Schrittweite des ersten Kerns, der mit diesen vier größten Pooling-Schichten verbunden ist, auf 4, 2, 1 bzw. 1 festgelegt.

Um das ursprüngliche rezeptive Feld in den verschiedenen Kernen zu erhalten, wird der in Literatur11 vorgeschlagene "Lochalgorithmus" verwendet, um die Größe des Kerns durch Hinzufügen von Nullen zu erweitern und so die Integrität des Kerns zu erhalten. Diese vier Feature-Maps sind mit unterschiedlichen Schrittweiten mit dem ersten Kernel verbunden. Folglich besitzen die in der letzten Phase erstellten Merkmalskarten identische Abmessungen. Die vier Feature-Maps stellen eine Reihe von Features mit mehreren Maßstäben dar, die aus unterschiedlichen Maßstäben gewonnen wurden und jeweils unterschiedliche Größen von rezeptiven Feldern darstellen. Die resultierenden Merkmalskarten aus den vier Zwischenschichten werden mit der von VGG16 abgeleiteten ultimativen Merkmalskarte verkettet, wodurch eine 5-Kanal-Ausgabe erzeugt wird. Die folgende Ausgabe wird anschließend einem 1 × 1 × 1-Kern mit der Sigmoid-Aktivierungsfunktion unterzogen, wodurch schließlich die hervorstechende Karte (mit einer Auflösung von einem Achtel des Originalbildes) erzeugt wird. Das Bild wird durch bilineare Interpolation hochgerechnet und vergrößert, um sicherzustellen, dass das resultierende Bild, das als Salienzkarte bezeichnet wird, eine identische Auflösung wie das ursprüngliche Bild beibehält.

Tiefes Encoder-Decoder-Netzwerk

In ähnlicher Weise wird das VGG16-Netzwerk als Backbone-Netzwerk verwendet. VGG16 zeichnet sich durch eine geringe Anzahl von flachen Feature-Map-Kanälen, aber hoher Auflösung und eine hohe Anzahl von tiefen Feature-Kanälen, aber niedriger Auflösung aus. Pooling-Layer und Downsampling erhöhen die Rechengeschwindigkeit des Deep Network auf Kosten der Merkmalskartenauflösung. Um dieses Problem zu lösen, wird nach der Analyse in Literatur14 das Encoder-Netzwerk verwendet, um die vollständige Konnektivität der letzten Pooling-Schicht im ursprünglichen VGG16 zu modifizieren. Bei dieser Modifikation wird es durch zwei Faltungsschichten mit 7 × 7 Kernen ersetzt (größere Faltungskerne erhöhen das rezeptive Feld). Beide Faltungskerne sind mit einer Normalisierungsoperation (BN) und einer modifizierten linearen Einheit (ReLU) ausgestattet. Diese Anpassung führt zu einer Encoder-Ausgabe-Feature-Map, die Bildrauminformationen besser beibehält.

Während der Encoder die allgemeine Bildsemantik für die globale Lokalisierung von hervorstechenden Objekten verbessert, wird das Problem der Grenzunschärfe seines hervorstechenden Objekts nicht effektiv verbessert. Um dieses Problem anzugehen, werden tiefe Merkmale mit flachen Merkmalen verschmolzen, die von der Kantenerkennungsarbeit12 inspiriert sind, wobei das Encoder-Decoder-Netzwerkmodell (DEDN) vorgeschlagen wird, wie in Abbildung 3 dargestellt. Die Encoder-Architektur besteht aus drei Kerneln, die mit den ersten vier verbunden sind, während der Decoder die Auflösung der Feature-Map systematisch verbessert, indem er die Maximalwerte verwendet, die aus den maximalen Pooling-Schichten abgerufen werden.

Bei dieser innovativen Methode zur Erkennung von markanten Objekten wird während der Decoderphase eine Faltungsschicht mit einem 3 × 3-Kern in Kombination mit einer Batch-Normalisierungsschicht und einer angepassten Lineareinheit verwendet. Am Ende des endgültigen Dekodierungsmoduls innerhalb der Decoderarchitektur wird eine Faltungsschicht mit einem Solitärkanal verwendet, um eine hervorstechende Karte der räumlichen Abmessungen W × H zu erhalten. Die hervorstechende Karte wird durch eine kollaborative Fusion des Encoder-Decoder-Modells, das das Ergebnis ergibt, und der komplementären Fusion der beiden erzeugt, d.h. der komplementären Fusion von tiefer Information und oberflächlicher Information. Dies erreicht nicht nur eine genaue Lokalisierung des hervorstechenden Objekts und vergrößert das rezeptive Feld, sondern bewahrt auch effektiv Bilddetailinformationen und stärkt die Grenze des hervorstechenden Objekts.

Integrationsmechanismus

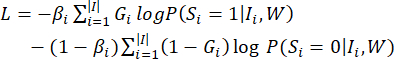

Die Encoder-Architektur besteht aus drei Kerneln, die mit den anfänglichen vier maximalen Pooling-Schichten des VGG16-Modells verbunden sind. Im Gegensatz dazu ist der Decoder absichtlich so formuliert, dass er die Auflösung von Feature-Karten, die aus den Up-Sampling-Schichten gewonnen wurden, schrittweise erhöht, indem die Maximalwerte aus den entsprechenden Pooling-Schichten genutzt werden. Eine Faltungsschicht mit einem 3 x 3-Kern, eine Batch-Normalisierungsschicht und eine modifizierte lineare Einheit werden dann im Decoder verwendet, gefolgt von einer einkanaligen Faltungsschicht, um eine hervorstechende Karte der Abmessungen W × H zu erzeugen. Die Gewichte der beiden tiefen Netzwerke werden durch abwechselnde Trainingszyklen erlernt. Die Parameter des ersten Netzwerks wurden konstant gehalten, während die Parameter des zweiten Netzwerks für insgesamt fünfzig Zyklen trainiert wurden. Während des Prozesses werden die Gewichte der für die Fusion verwendeten Salienzkarte (S1 und S2) über einen zufälligen Gradienten aktualisiert. Die Verlustfunktion11 ist:

(1)

(1)

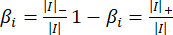

Im angegebenen Ausdruck steht das Symbol G für den manuell beschrifteten Wert, während W für den vollständigen Satz von Netzwerkparametern steht. Die Gewichtung βi dient als Ausgleichsfaktor, um das Verhältnis von hervorstechenden Pixeln zu nicht-hervorstechenden Pixeln im Berechnungsprozess zu regulieren.

Das Bild I zeichnet sich durch drei Parameter aus: |Ich|, |Ich|- und |Ich|+, die die Gesamtzahl der Pixel, die Anzahl der nicht hervorstechenden Pixel bzw. die Anzahl der hervorstechenden Pixel darstellen.

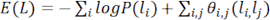

Da die aus den beiden oben genannten Netzwerken erhaltenen salienten Karten die Kohärenz benachbarter Pixel nicht berücksichtigen, wird ein vollständig verbundenes Salienzverfeinerungsmodell CRF15 auf Pixelebene verwendet, um die räumliche Kohärenz zu verbessern. Die Energiegleichung11 lautet wie folgt und löst das Problem der binären Pixelbeschriftung.

(2)

(2)

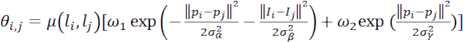

wobei L die binäre Beschriftung (hervorstechender Wert oder nicht hervorstechender Wert) bezeichnet, die allen Pixeln zugewiesen ist. Die Variable P(li) bezeichnet die Wahrscheinlichkeit, dass einem bestimmten Pixel xieine bestimmte Bezeichnung li zugewiesen wird, was die Wahrscheinlichkeit angibt, dass das Pixel xiSalienz ist. Am Anfang ist P(1) = Siund P(0) = 1 - Si, wobei Siden Salienzwert am Pixel xiinnerhalb der fusionierten Salienzkarte S bezeichnet. θi,j(LI,L J) ist das paarweise Potential, das wie folgt definiert ist.

(3)

(3)

Unter ihnen, wenn li≠ lj, dann μ(li,l j) = 1, sonst μ(li,l j) = 0. Die Berechnung von θi,j beinhaltet die Verwendung von zwei Kernen, wobei der Anfangskern sowohl von der Pixelposition P als auch von der Pixelintensität I abhängt. Dies führt dazu, dass Pixel mit ähnlichen Farben vergleichbare Salienzwerte aufweisen. Die beiden Parameter σα und σβ regeln, inwieweit Farbähnlichkeit und räumliche Nähe das Ergebnis beeinflussen. Das Ziel des zweiten Kernels ist es, isolierte kleine Regionen zu eliminieren. Die Minimierung der Energie wird durch eine hochdimensionale Filterung erreicht, die das mittlere Feld der CRF-Verteilung (Conditional Random Field) beschleunigt. Bei der Berechnung zeigt die als Scrf bezeichnete hervorstechende Karte eine verbesserte räumliche Kohärenz und Kontur in Bezug auf die erkannten hervorstechenden Objekte.

Experimentelle Konfigurationen

In diesem Artikel wird ein tiefes Netzwerk zur Erkennung von markanten Zielen basierend auf dem neuronalen VGG16-Netzwerk mit Python erstellt. Das vorgeschlagene Modell wird mit anderen Methoden unter Verwendung der Datensätze SOD20 undECSSD 21 verglichen. Die SOD-Bilddatenbank ist bekannt für ihre komplexen und unübersichtlichen Hintergründe, die Ähnlichkeit der Farben zwischen Vorder- und Hintergrund und die kleinen Objektgrößen. Jedem Bild in diesem Datensatz wird ein manuell gekennzeichneter wahrer Wert für die quantitative und qualitative Leistungsbewertung zugewiesen. Auf der anderen Seite besteht der ECSSD-Datensatz hauptsächlich aus Bildern, die aus dem Internet stammen und komplexere und realistischere Naturszenen mit geringem Kontrast zwischen dem Bildhintergrund und den hervorstechenden Objekten zeigen.

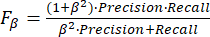

Die Bewertungsindizes, die zum Vergleich des Modells in diesem Artikel verwendet werden, umfassen die häufig verwendete Precision-Recall-Kurve, Fβund EMAE. Um die vorhergesagte Salienzkarte quantitativ zu bewerten, wird die Precision-Recall (P-R)-Kurve22 verwendet, indem der Schwellenwert für die Binarisierung der Salienzkarte von 0 auf 255 geändert wird. Fβist eine umfassende Bewertungsmetrik, die mit den Genauigkeits- und Erinnerungsgleichungen berechnet wird, die aus der binarisierten Salient-Karte und einer True-Value-Karte abgeleitet werden.

(4)

(4)

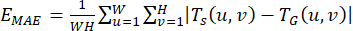

wobei β der Gewichtungsparameter zum Einstellen der Genauigkeit und des Abrufs ist, Einstellung β2 = 0,3. Die Berechnung von EMAEentspricht der Berechnung des mittleren absoluten Fehlers zwischen der resultierenden Salienzkarte und der Ground-Truth-Karte, wie durch den folgenden mathematischen Ausdruck definiert:

(5)

(5)

Ts(u,v) bezeichne den extrahierten Wert der hervorstechenden Kartenpixel (u,v) und TG(u,v) den entsprechenden Wert der echten Kartenpixel (u,v).

Protokoll

1. Versuchsaufbau und Ablauf

- Laden Sie das vortrainierte VGG16-Modell.

HINWEIS: Der erste Schritt besteht darin, das vortrainierte VGG16-Modell aus der Keras-Bibliothek6 zu laden.- Um ein vortrainiertes VGG16-Modell in Python mit gängigen Deep-Learning-Bibliotheken wie PyTorch (siehe Materialtabelle) zu laden, führen Sie die folgenden allgemeinen Schritte aus:

- Brenner importieren. Importieren Sie torchvision.models als Modelle.

- Laden Sie das vortrainierte VGG16-Modell. vgg16_model = models.vgg16(pretrained=True).

- Stellen Sie sicher, dass die Zusammenfassung des VGG16-Modells "print(vgg16_model)" lautet.

- Um ein vortrainiertes VGG16-Modell in Python mit gängigen Deep-Learning-Bibliotheken wie PyTorch (siehe Materialtabelle) zu laden, führen Sie die folgenden allgemeinen Schritte aus:

- Definieren Sie die DCL- und DEDN-Modelle.

- Geben Sie für den Pseudocode des DCL-Algorithmus Input: Image dataset SOD und Output: Trained DCL model an.

- Initialisieren Sie das DCL-Modell mit dem VGG16-Backbone-Netzwerk.

- Verarbeiten Sie den Bilddatensatz D vor (z. B. Größenänderung, Normalisierung).

- Teilen Sie das Dataset in Trainings- und Validierungssätze auf.

- Definieren Sie die Verlustfunktion zum Trainieren des DCL-Modells (z. B. binäre Kreuzentropie).

- Legen Sie die Hyperparameter für das Training fest: Lernrate (0,0001), Anzahl der eingestellten Trainingsepochen (50), Batchgröße (8), Optimierer (Adam).

- Trainieren Sie das DCL-Modell: Führen Sie für jede Epoche in der definierten Anzahl von Epochen für jeden Batch im Trainingssatz aus. Geben Sie Folgendes ein:

- Vorwärtsdurchlauf: Feed-Batch-Bilder in das DCL-Modell. Berechnen Sie den Verlust mit den vorhergesagten Salienzkarten und Ground-Truth-Karten.

- Rückwärtspass: Aktualisieren Sie die Modellparameter mit dem Gradientenabstiegsende. Berechnen Sie den Validierungsverlust und andere Auswertungsmetriken am Ende des Validierungssatzes.

- Speichern Sie das trainierte DCL-Modell.

- Geben Sie das trainierte DCL-Modell zurück.

- Geben Sie für Pseudocode für den DEDN-Algorithmus Folgendes ein: Bilddatensatz (X), Ground-Truth-Salienzkarten (Y), Anzahl der Trainingsiterationen (N).

- Stellen Sie für das Encoder-Netzwerk sicher, dass der Encoder auf dem VGG16-Skelett mit Modifikationen basiert (wie unten erwähnt).

HINWEIS: encoder_input = Eingabe(Form=input_shape)

encoder_conv1 = Conv2D(64, (3, 3), activation='relu', padding='same')(encoder_input)

encoder_pool1 = MaxPooling2D((2, 2))(encoder_conv1)

encoder_conv2 = Conv2D(128, (3, 3), activation='relu', padding='same')(encoder_pool1)

encoder_pool2 = MaxPooling2D((2, 2))(encoder_conv2)

encoder_conv3 = Conv2D(256, (3, 3), activation='relu', padding='same')(encoder_pool2)

encoder_pool3 = MaxPooling2D((2, 2))(encoder_conv3) - Stellen Sie für das Decoder-Netzwerk sicher, dass der Decoder auf dem VGG16-Skelett mit Modifikationen basiert (wie unten erwähnt).

HINWEIS: decoder_conv1 = Conv2D(256, (3, 3), activation='relu', padding='same')(encoder_pool3)

decoder_upsample1 = UpSampling2D((2, 2))(decoder_conv1)

decoder_conv2 = Conv2D(128, (3, 3), activation='relu', padding='same')(decoder_upsample1)

decoder_upsample2 = UpSampling2D((2, 2))(decoder_conv2)

decoder_conv3 = Conv2D(64, (3, 3), activation='relu', padding='same')(decoder_upsample2)

decoder_upsample3 = UpSampling2D((2, 2))(decoder_conv3)

decoder_output = Conv2D(1, (1, 1), activation='sigmoid', padding='same')(decoder_upsample3)

- Stellen Sie für das Encoder-Netzwerk sicher, dass der Encoder auf dem VGG16-Skelett mit Modifikationen basiert (wie unten erwähnt).

- Definieren Sie das DEDN-Modell. model = Modell (Eingaben = encoder_input, Ausgaben = decoder_output).

- Kompilieren Sie das Modell. model.compile (Optimierer = Adam, Verlust = binary_crossentropy).

- Wählen Sie die Trainingsschleife aus.

HINWEIS: Für die Iteration im Bereich (N): # Wählen Sie nach dem Zufallsprinzip einen Stapel von Bildern und Ground-Truth-Karten aus. batch_X, batch_Y = randomly_select_batch(X, Y, batch_size).- Trainieren Sie das Modell mit dem Batch. Verlust = model.train_on_batch(batch_X, batch_Y). Drucken Sie den Verlust für die Überwachung.

- Speichern Sie das trainierte Modell. model.save ('dedn_model.h5').

- Geben Sie für den Pseudocode des DCL-Algorithmus Input: Image dataset SOD und Output: Trained DCL model an.

- Kombinieren.

- Kombinieren Sie die Ausgaben der DCL- und DEDN-Netzwerke und verfeinern Sie die Salienzkarte mit einem vollständig verbundenen CRF-Modell (Conditional Random Field).

2. Bildverarbeitung

- Klicken Sie auf Code ausführen , um die GUI-Schnittstelle aufzurufen (Abbildung 4).

- Klicken Sie auf Bild öffnen , um den Pfad und damit das zu erkennende Bild auszuwählen.

- Klicken Sie auf das Anzeigebild , um das Bild anzuzeigen, das für die Erkennung ausgewählt wurde.

- Klicken Sie auf Erkennung starten , um das ausgewählte Bild zu erkennen.

HINWEIS: Das Erkennungsergebnis wird mit dem erkannten Bild angezeigt, d. h. dem Ergebnis des hervorstechenden Objekts (Abbildung 5). - Klicken Sie auf Speicherpfad auswählen , um die Bildergebnisse der Erkennung hervorstechender Objekte zu speichern.

Ergebnisse

Diese Studie stellt ein tiefes neuronales End-to-End-Netzwerk vor, das zwei komplementäre Netzwerke umfasst: ein Pixel-Level-Multiskalen-Faltungsnetzwerk und ein tiefes Encoder-Decoder-Netzwerk. Das erste Netzwerk integriert kontextuelle Semantik, um visuelle Kontraste aus Multiskalen-Merkmalskarten abzuleiten und die Herausforderung fester rezeptiver Felder in tiefen neuronalen Netzen über verschiedene Schichten hinweg anzugehen. Das zweite Netzwerk verwendet sowohl tiefe als auch flache Bildmerkmale, um das Problem u...

Diskussion

Der Artikel stellt ein tiefes neuronales End-to-End-Netz vor, das speziell für die Erkennung von markanten Objekten in komplexen Umgebungen entwickelt wurde. Das Netzwerk besteht aus zwei miteinander verbundenen Komponenten: einem Pixel-Level-Multiscale-Fully-Convolutional-Network (DCL) und einem tiefen Encoder-Decoder-Netzwerk (DEDN). Diese Komponenten arbeiten synergetisch zusammen und integrieren kontextuelle Semantik, um visuelle Kontraste in Multiskalen-Feature-Maps zu erzeugen. Darüber hinaus nutzen sie sowohl ti...

Offenlegungen

Die Autoren haben nichts offenzulegen.

Danksagungen

Diese Arbeit wird unterstützt durch die Einrichtung des Förderprogramms für wichtige wissenschaftliche Forschungsprojekte der Provinz Henan 2024 (Projektnummer: 24A520053). Diese Studie wird auch durch den Bau eines spezialisierten Erstellungs- und Integrationsmerkmals-Demonstrationskurses in der Provinz Henan unterstützt.

Materialien

| Name | Company | Catalog Number | Comments |

| Matlab | MathWorks | Matlab R2016a | MATLAB's programming interface provides development tools for improving code quality maintainability and maximizing performance. It provides tools for building applications using custom graphical interfaces. It provides tools for combining MATLAB-based algorithms with external applications and languages |

| Processor | Intel | 11th Gen Intel(R) Core (TM) i5-1135G7 @ 2.40GHz | 64-bit Win11 processor |

| Pycharm | JetBrains | PyCharm 3.0 | PyCharm is a Python IDE (Integrated Development Environment) a list of required python: modulesmatplotlib skimage torch os time pydensecrf opencv glob PIL torchvision numpy tkinter |

| PyTorch | PyTorch 1.4 | PyTorch is an open source Python machine learning library , based on Torch , used for natural language processing and other applications.PyTorch can be viewed both as the addition of GPU support numpy , but also can be viewed as a powerful deep neural network with automatic derivatives . |

Referenzen

- Wang, W. G., Shen, J. B., Ling, H. B. A deep network solution for attention and aesthetics aware photo cropping. IEEE Transactions on Pattern Analysis and Machine Intelligence. 41 (7), 1531-1544 (2018).

- Wang, W. G., Sun, G. L., Gool, L. V. Looking beyond single images for weakly supervised semantic segmentation learning. IEEE Transactions on Pattern Analysis and Machine. , (2022).

- Mei, H. L., et al. Exploring dense context for salient object detection. IEEE Transactions on Circuits and Systems for Video Technology. 32 (3), 1378-1389 (2021).

- Borji, A., Itti, L. State-of-the-art in visual attention modeling. IEEE Transactions on Pattern Analysis and Machine Intelligence. 35 (1), 185-207 (2012).

- Long, J., Shelhamer, E., Darrell, T. Fully convolutional networks for semantic segmentation. , 3431-3440 (2015).

- Simonyan, K., Zisserman, A. Very deep convolutional networks for large-scale image recognition. arXiv preprint. , 1409-1556 (2014).

- He, K., Zhang, X., Ren, S., Sun, J. Deep residual learning for image recognition. , 770-778 (2016).

- Liu, N., Han, J. Dhsnet: Deep hierarchical saliency network for salient object detection. , 678-686 (2016).

- Zhang, L., Dai, J., Lu, H., He, Y., Wang, G. A bi-directional message passing model for salient object detection. , 1741-1750 (2018).

- Wu, R., et al. A mutual learning method for salient object detection with intertwined multi-supervision. , 8150-8159 (2019).

- Li, G., Yu, Y. Deep contrast learning for salient object detection. , 478-487 (2019).

- Ren, Q., Hu, R. Multi-scale deep encoder-decoder network for salient object detection. Neurocomputing. 316, 95-104 (2018).

- Wang, W. G., et al. Salient object detection in the deep learning era: An in-depth survey. IEEE Transactions on Pattern Analysis and Machine Intelligence. 44 (6), 3239-3259 (2021).

- Zhou, T., et al. RGB-D salient object detection: A survey. Computational Visual Media. 7, 37-69 (2021).

- Fu, K., et al. Siamese network for RGB-D salient object detection and beyond. IEEE Transactions on Pattern Analysis and Machine Intelligence. 44 (9), 5541-5559 (2021).

- Lai, Q., et al. Weakly supervised visual saliency prediction. IEEE Transactions on Image Processing. 31, 3111-3124 (2022).

- Zhang, L., Dai, J., Lu, H., He, Y., Wang, G. A bi-directional message passing model for salient object detection. , 1741-1750 (2018).

- Wu, R. A mutual learning method for salient object detection with intertwined multi-supervision. , 8150-8159 (2019).

- Wang, W., Shen, J., Dong, X., Borji, A., Yang, R. Inferring salient objects from human fixations. IEEE Transactions on Pattern Analysis and Machine Intelligence. 42 (8), 1913-1927 (2019).

- Movahedi, V., Elder, J. H. Design and perceptual validation of performance measures for salient object segmentation. , 49-56 (2010).

- Shi, J., Yan, Q., Xu, L., Jia, J. Hierarchical image saliency detection on extended CSSD. IEEE Transactions on Pattern Analysis and Machine Intelligence. 38 (4), 717-729 (2015).

- Achanta, R., Hemami, S., Estrada, F., Susstrunk, S. Frequency-tuned salient region detection. , 1597-1604 (2009).

- Yang, C., Zhang, L., Lu, H., Ruan, X., Yang, M. H. Saliency detection via graph-based manifold ranking. , 3166-3173 (2013).

- Wei, Y., et al. Geodesic saliency using background priors. Computer Vision-ECCV 2012. , 29-42 (2012).

- Margolin, R., Tal, A., Zelnik-Manor, L. What makes a patch distinct. , 1139-1146 (2013).

- Perazzi, F., Krähenbühl, P., Pritch, Y., Hornung, A. Saliency filters: Contrast based filtering for salient region detection. , 733-740 (2012).

- Hou, X., Harel, J., Koch, C. Image signature: Highlighting sparse salient regions. IEEE Transactions on Pattern Analysis and Machine Intelligence. 34 (1), 194-201 (2011).

- Jiang, H., et al. Salient object detection: A discriminative regional feature integration approach. , 2083-2090 (2013).

- Li, G., Yu, Y. Visual saliency based on multiscale deep features. , 5455-5463 (2015).

- Lee, G., Tai, Y. W., Kim, J. Deep saliency with encoded low level distance map and high-level features. , 660-668 (2016).

- Liu, N., Han, J. Dhsnet: Deep hierarchical saliency network for salient object detection. , 678-686 (2016).

Nachdrucke und Genehmigungen

Genehmigung beantragen, um den Text oder die Abbildungen dieses JoVE-Artikels zu verwenden

Genehmigung beantragenThis article has been published

Video Coming Soon

Copyright © 2025 MyJoVE Corporation. Alle Rechte vorbehalten