È necessario avere un abbonamento a JoVE per visualizzare questo. Accedi o inizia la tua prova gratuita.

Method Article

Stima della biomassa basata sulla visione artificiale per impianti invasivi

In questo articolo

Riepilogo

Riportiamo procedure dettagliate per un metodo di stima della biomassa vegetale invasiva che utilizza i dati ottenuti dal telerilevamento di veicoli aerei senza pilota (UAV) per valutare la biomassa e catturare la distribuzione spaziale delle specie invasive. Questo approccio si rivela estremamente utile per condurre la valutazione dei pericoli e l'allerta precoce delle piante invasive.

Abstract

Riportiamo le fasi dettagliate di un metodo per stimare la biomassa di piante invasive basato sul telerilevamento UAV e sulla visione artificiale. Per raccogliere campioni dall'area di studio, abbiamo preparato un assemblaggio quadrato di campioni per randomizzare i punti di campionamento. Un sistema di telecamere aeree senza pilota è stato costruito utilizzando un drone e una fotocamera per acquisire immagini RGB continue dell'area di studio attraverso la navigazione automatizzata. Dopo aver completato le riprese, è stata raccolta la biomassa fuori terra nel telaio del campione e tutte le corrispondenze sono state etichettate e imballate. I dati campione sono stati elaborati e le immagini aeree sono state segmentate in piccole immagini di 280 x 280 pixel per creare un set di dati di immagini. Una rete neurale convoluzionale profonda è stata utilizzata per mappare la distribuzione di Mikania micrantha nell'area di studio ed è stato ottenuto il suo indice di vegetazione. Gli organismi raccolti sono stati essiccati e il peso secco è stato registrato come biomassa di base. Il modello di regressione della biomassa vegetale invasiva è stato costruito utilizzando la regressione K-nearest neighbor (KNNR) estraendo l'indice di vegetazione dalle immagini campione come variabile indipendente e integrandolo con la biomassa di base come variabile dipendente. I risultati hanno mostrato che era possibile prevedere con precisione la biomassa delle piante invasive. Un'accurata mappa di distribuzione spaziale della biomassa vegetale invasiva è stata generata mediante attraversamento delle immagini, consentendo l'identificazione precisa delle aree ad alto rischio interessate da piante invasive. In sintesi, questo studio dimostra il potenziale della combinazione del telerilevamento di veicoli aerei senza pilota con tecniche di apprendimento automatico per stimare la biomassa vegetale invasiva. Contribuisce in modo significativo alla ricerca di nuove tecnologie e metodi per il monitoraggio in tempo reale delle piante invasive e fornisce supporto tecnico per il monitoraggio intelligente e la valutazione dei pericoli su scala regionale.

Introduzione

In questo protocollo, il metodo proposto per la stima della biomassa invasiva basato sul telerilevamento UAV e sulla visione artificiale può riflettere la distribuzione degli organismi invasivi e prevedere il grado di rischio biologico invasivo. Le stime della distribuzione e della biomassa degli organismi invasivi sono fondamentali per la prevenzione e il controllo di questi organismi. Una volta invadete, le piante invasive possono danneggiare l'ecosistema e causare enormi perdite economiche. L'identificazione rapida e accurata delle piante invasive e la stima della biomassa delle piante invasive sono le principali sfide nel monitoraggio e nel controllo delle piante invasive. In questo protocollo, prendiamo come esempio Mikania micrantha per esplorare un metodo di stima della biomassa vegetale invasiva basato sul telerilevamento aereo senza pilota e sulla visione artificiale, che fornisce un nuovo approccio e metodo per la ricerca ecologica delle piante invasive e promuove la ricerca ecologica e la gestione delle piante invasive.

Attualmente, la misurazione della biomassa di Mikania micrantha viene effettuata principalmente mediante campionamento manuale1. I metodi tradizionali di misurazione della biomassa richiedono molta forza lavoro e risorse materiali, che sono inefficienti e limitate dal terreno; è difficile soddisfare le esigenze della stima della biomassa regionale di Mikania micrantha. Il principale vantaggio dell'utilizzo di questo protocollo è che fornisce un metodo per quantificare la biomassa delle piante invasive regionali e la distribuzione spaziale delle piante invasive in un modo che non tiene conto dei limiti di campionamento dell'area ed elimina la necessità di indagini manuali.

La tecnologia di telerilevamento UAV ha ottenuto determinati risultati nella stima della biomassa vegetale ed è stata ampiamente utilizzata in agricoltura 2,3,4,5,6,7, silvicoltura 8,9,10,11 e praterie 12,13,14. La tecnologia di telerilevamento UAV presenta i vantaggi di basso costo, alta efficienza, alta precisione e funzionamento flessibile 15,16, che può ottenere in modo efficiente dati di immagini di telerilevamento nell'area di studio; Quindi, la caratteristica della trama e l'indice di vegetazione dell'immagine di telerilevamento vengono estratti per fornire dati di supporto per la stima della biomassa vegetale in una vasta area. Gli attuali metodi di stima della biomassa vegetale sono principalmente classificati in modelli parametrici e non parametrici17. Con lo sviluppo di algoritmi di apprendimento automatico, i modelli di apprendimento automatico non parametrici con maggiore precisione sono stati ampiamente utilizzati nella stima del telerilevamento della biomassa vegetale. Chen et al.18 hanno utilizzato la regressione logistica mista (MLR), la KNNR e la regressione forestale casuale (RFR) per stimare la biomassa fuori terra delle foreste nella provincia dello Yunnan. Hanno concluso che i modelli di apprendimento automatico, in particolare KNNR e RFR, hanno portato a risultati superiori rispetto a MLR. Yan et al.19 hanno impiegato modelli di regressione RFR ed extreme gradient boosting (XGBR) per valutare l'accuratezza della stima della biomassa forestale subtropicale utilizzando vari set di variabili. Tian et al.20 hanno utilizzato undici modelli di apprendimento automatico per stimare la biomassa fuori terra di varie specie di foreste di mangrovie nella baia di Beibuwan. I ricercatori hanno scoperto che il metodo XGBR era più efficace nel determinare la biomassa fuori terra delle foreste di mangrovie. La stima della biomassa vegetale mediante telerilevamento uomo-macchina è una pratica consolidata, tuttavia, l'uso di UAV per la stima della biomassa della pianta invasiva Mikania micrantha deve ancora essere segnalato sia a livello nazionale che internazionale. Questo approccio è fondamentalmente diverso da tutti i precedenti metodi di stima della biomassa per le piante invasive, in particolare la Mikania micrantha.

Per riassumere, il telerilevamento UAV presenta i vantaggi di alta risoluzione, alta efficienza e basso costo. Nell'estrazione di variabili di funzionalità di immagini di telerilevamento, le caratteristiche di texture combinate con gli indici di vegetazione possono ottenere migliori prestazioni di previsione della regressione. I modelli non parametrici possono ottenere modelli di regressione più accurati rispetto a quelli parametrici nella stima della biomassa vegetale. Pertanto, per calcolare con precisione la distribuzione nulla delle piante invasive e della loro biomassa, suggeriamo le seguenti procedure delineate per l'esperimento sulla biomassa vegetale invasiva che si basa sul telerilevamento utilizzando UAV e visione artificiale.

Protocollo

1. Preparazione dei dataset

- Selezione dell'oggetto di ricerca

- Seleziona i campioni di prova in base al focus dello studio sperimentale, considerando opzioni come la Mikania micrantha o altre piante invasive.

- Raccolta di immagini UAV

- Preparare telai quadrati in plastica di dimensioni 0,5 m*0,5 m e quantità 25-50, a seconda delle dimensioni dell'area studiata.

- Utilizzare un approccio di campionamento casuale per determinare le posizioni di campionamento del suolo nell'area di studio utilizzando un numero sufficiente di campioni di biomassa. Posizionare il telaio del campione orizzontalmente sopra la vegetazione, abbracciando completamente le piante con una distanza minima di separazione di 2 m tra ciascuna pianta.

- Utilizzare un drone e una telecamera per formare un sistema di ripresa di telerilevamento UAV, come mostrato nella Figura 1.

- Utilizzare l'UAV per tracciare il percorso all'interno dell'area di studio specificata. L'impostazione della pianificazione del percorso è illustrata nella Figura 2.

- Stabilire un tasso di sovrapposizione di direzione e laterale del 70%, scattare foto a intervalli di tempo uniformi di 2 s, mantenere l'angolo della fotocamera perpendicolare al suolo a 90° e posizionare l'altitudine della fotocamera a 30 m. Ciò ha portato a dati di immagine visibili continui dell'area di studio con una singola risoluzione dell'immagine di 8256 x 5504 pixel, come illustrato nella Figura 3.

- Memorizza le immagini aeree per la successiva elaborazione con il software Python per la stima della biomassa.

- Raccolta della biomassa fuori terra

- Raccogli manualmente la biomassa fuori terra di Mikania micrantha all'interno di ogni appezzamento campione dopo aver completato la raccolta dei dati del drone. Insaccali ed etichetta ogni sacchetto di conseguenza.

- Quando si raccoglie Mikania micrantha, evitare che i grafici campione si muovano. Per prima cosa, taglia la Mikania micrantha lungo il bordo interno del grafico campione.

- Quindi, tagliare il rizoma della Mikania micrantha dal basso. Rimuovi lo sporco, le rocce o altre piante che si sono mescolate. Infine, imbustate ed etichettate i campioni.

- Portare in laboratorio i campioni raccolti di piante invasive dal passaggio 1.3.1. Asciugare all'aria tutti i campioni raccolti per far evaporare la maggior parte dell'umidità.

- Per rimuovere ulteriormente l'umidità dai campioni essiccati all'aria, utilizzare un forno. Impostare la temperatura a 55 °C. Asciugare i campioni per 72 ore, quindi pesare ogni campione su una bilancia elettronica e registrare i dati sulla biomassa in grammi (g).

- Collocare la bilancia elettronica in un ambiente indisturbato, pesare, tarare e continuare a pesare. Posizionare i sacchetti di Mikania micrantha sulla bilancia elettronica, attendere che le letture si stabilizzino e registrare le letture.

- Pesare la Mikania micrantha ogni ora fino a quando la massa non cambia più e registrare la lettura meno il peso del sacchetto come massa misurata di quel campione. Calcolare la biomassa fuori terra della pianta invasiva utilizzando la formula seguente:

dove B rappresenta la biomassa di Mikania micrantha in grammi per metro quadrato (g/m2), M è il peso della Mikania micrantha misurata, misurata in grammi (g), S corrisponde all'area del lotto campione in metri quadrati (m2).

- Raccogli manualmente la biomassa fuori terra di Mikania micrantha all'interno di ogni appezzamento campione dopo aver completato la raccolta dei dati del drone. Insaccali ed etichetta ogni sacchetto di conseguenza.

- Creazione di un set di dati

- Estrarre l'immagine RGB corrispondente all'immagine di esempio dall'immagine UAV originale. Dividilo in una griglia di 280 × 280 pixel utilizzando la programmazione Python (Supplementray, Figura 1).

- Segmenta i dati dell'immagine grezza in immagini più piccole della stessa dimensione delle immagini di esempio utilizzando la programmazione Python. Utilizzare il metodo della finestra scorrevole per la segmentazione, impostando i passi orizzontali e verticali su 280 pixel.

- Dalle piccole immagini segmentate nel passaggio 1.4.2, selezionare in modo casuale 880 immagini di piante invasive e 1500 immagini di sfondo per creare un set di dati. Quindi, suddividi questo set di dati in set di addestramento, convalida e test in un rapporto 6:2:2 (Figura 2 di Supplementray).

2. Identificazione di Mikania micrantha

- Preparazione del software

- Vai al sito Web ufficiale di Anaconda (https://www.anaconda.com/) e scarica e installa Anaconda. Quindi, vai al sito Web di PyCharm (https://www.jetbrains.com/pycharm/) e scarica l'IDE di PyCharm.

- Creazione di un ambiente Conda.

- Apri la riga di comando Anaconda Prompt dopo aver installato Anaconda, quindi digita conda create -n pytorch python==3.8 per creare un nuovo ambiente Conda. Dopo aver creato l'ambiente, immettere conda info --envs per confermare che l'ambiente pytorch esiste.

- Apri il prompt Anaconda e attiva l'ambiente pytorch inserendo conda activate pytorch. Controllare la versione corrente di CUDA (Compute Unified Device Architecture) digitando nvidia-smi. Quindi, installa PyTorch versione 1.8.1 eseguendo il comando conda install pytorch==1.8.1 torchvision==0.9.1 torchaudio==0.8.1 cudatoolkit=11.0 -c pytorch.

- Esecuzioni per il riconoscimento del modello

NOTA: Usa PyTorch per costruire il Mikania micrantha modello di riconoscimento utilizzato in questo articolo. Il modello di rete utilizzato è ResNet10121, che rimane coerente con la carta originale nella sua architettura. Vengono apportate modifiche alla sezione di uscita della rete per soddisfare i requisiti per il riconoscimento della camomilla.- Pre-elaborare le immagini per prepararle per l'input del modello. Ridimensiona le immagini da 280 x 280 pixel a 224 x 224 pixel e normalizzale per assicurarti che soddisfino i requisiti di dimensione del modello utilizzando il seguente codice:

transform = trasforma. Componi([

Trasforma. Ridimensiona((224, 224)),

Trasforma. ToTensor(),

Trasforma. Normalizza([0,485, 0,456, 0,406], [0,229, 0,224, 0,225])]) - Esegui l'estrazione delle caratteristiche dell'immagine e riduci la dimensionalità utilizzando una rete neurale convoluzionale.

- Innanzitutto, inizializza il livello convoluzionale per l'estrazione iniziale delle funzionalità tramite self.conv1. Con questo livello convoluzionale, l'immagine originale viene convoluta in una mappa delle caratteristiche con self.in_channel canali per l'estrazione delle caratteristiche iniziali (Figura 3A supplementare).

NOTA: Le funzioni avanzate vengono estratte in un'operazione di convoluzione sui passaggi residui. Questi strati sono prodotti invocando la funzione _make_layer , che comprende una sequenza di blocchi residui. Ogni blocco residuo è costituito da funzioni di convoluzione, normalizzazione batch e attivazione per estrarre gradualmente funzionalità sofisticate (Figura 3B supplementare). - Utilizzare la funzione del livello per modificare il numero del canale per la riduzione della dimensionalità tramite convoluzione 1x1. Questa operazione riduce il carico computazionale preservando le caratteristiche significative (Figura 3C supplementare).

NOTA: Nel complesso, ResNet101 esegue l'estrazione di funzionalità utilizzando vari livelli convoluzionali e la riduzione della dimensionalità si ottiene attraverso strati convoluzionali 1x1 all'interno del blocco residuo. Questo approccio consente alla rete di apprendere le funzionalità in modo più approfondito ed evitare il problema della scomparsa del gradiente, consentendo così un apprendimento e una rappresentazione più efficienti delle caratteristiche dell'immagine per attività complesse. - Dopo le operazioni di convoluzione e pooling, inserire le funzionalità di alta qualità in un livello completamente connesso.

NOTA: Nell'architettura ResNet, l'estrazione delle caratteristiche avviene nel livello convoluzionale. Queste caratteristiche vengono successivamente inviate al livello completamente connesso (FC) per la classificazione (Figura 4 supplementare). L'operazione self.avgpool(x) esegue il pooling medio adattivo per rimodellare il tensore a una dimensione fissa. L'operazione torch.flatten(x, 1) diffonde il tensore in un vettore unidimensionale e self.fc(x) applica il livello completamente connesso al vettore appiattito, fungendo infine da passaggio finale per la classificazione. Questo processo fa passare efficacemente le caratteristiche estratte attraverso il livello convoluzionale, trasformandole in un formato adatto alla classificazione tramite il livello completamente connesso. - Utilizzare la funzione Softmax per ottenere l'output finale in base ai tre requisiti di classificazione.

- Innanzitutto, inizializza il livello convoluzionale per l'estrazione iniziale delle funzionalità tramite self.conv1. Con questo livello convoluzionale, l'immagine originale viene convoluta in una mappa delle caratteristiche con self.in_channel canali per l'estrazione delle caratteristiche iniziali (Figura 3A supplementare).

- Eseguire il training di un modello di riconoscimento multiclasse con il set di dati del passaggio 1.4. Imposta il numero di iterazioni su 200 e una velocità di apprendimento iniziale di 0,0001. Riduci il tasso di apprendimento di un terzo ogni 10 iterazioni con una dimensione del batch di 64. Salvate automaticamente i parametri ottimali del modello dopo ogni iterazione (Figura 5 supplementare).

- Utilizzare un modello di riconoscimento meticolosamente addestrato e attraversare sistematicamente l'immagine originale dal passaggio 1.2.2 a scopo di identificazione.

- Configura i gradini orizzontali e verticali con precisione a 280 pixel, generando una mappa di distribuzione completa che evidenzia la presenza di flora invasiva all'interno dei confini dell'area di studio. Presentare visivamente i risultati selezionati come mostrato nella Figura 4.

NOTA: l'immagine iniziale viene pre-elaborata segmentandola in blocchi più piccoli, classificando ogni blocco utilizzando un modello di deep learning addestrato e combinando i risultati in un'immagine di output. Se un blocco è classificato come pianta invasiva, la posizione corrispondente sull'immagine di output è impostata su 255. L'immagine di output risultante viene salvata come file immagine in scala di grigi. Il codice di implementazione specifico è illustrato nella Figura 6 supplementare.

- Configura i gradini orizzontali e verticali con precisione a 280 pixel, generando una mappa di distribuzione completa che evidenzia la presenza di flora invasiva all'interno dei confini dell'area di studio. Presentare visivamente i risultati selezionati come mostrato nella Figura 4.

- Pre-elaborare le immagini per prepararle per l'input del modello. Ridimensiona le immagini da 280 x 280 pixel a 224 x 224 pixel e normalizzale per assicurarti che soddisfino i requisiti di dimensione del modello utilizzando il seguente codice:

3. Stima delle biomasse vegetali invasive

- Eseguire un semplice aumento dei dati con le funzioni RandomResizedCrop e RandomHorizontalFlip (Figura 7 supplementare) per estendere il set di immagini creato nel passaggio 1.2 ed estrarre i sei indici di vegetazione comunemente usati per stimare la biomassa, ovvero RBRI, GBRI, GRRI, RGRI, NGBDI e NGRDI. Fare riferimento alla Tabella 1 per le formule di calcolo di questi indici.

- Creare un modello di regressione K-nearest neighbor (KNNR)22 utilizzando l'output del modello per garantire una stima precisa della biomassa delle piante invasive. Utilizzare gli indici di vegetazione estratti come input per il modello di stima.

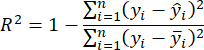

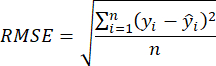

- Utilizzare il coefficiente di determinazione R2 e l'errore quadratico medio (RMSE)23 per valutare l'accuratezza del modello, che viene calcolata come segue:

NOTA: L'algoritmo K-Nearest Neighbor Regression (KNNR) è una tecnica di apprendimento automatico non parametrica utilizzata per risolvere problemi di regressione. Il suo concetto fondamentale è quello di prevedere i risultati determinando i K vicini più vicini nello spazio delle caratteristiche in base alle distanze dei campioni di input. I principali vantaggi dell'utilizzo di KNNR includono la sua semplicità e facilità di comprensione e non richiede alcuna fase di formazione. Inoltre, KNNR non fa ipotesi eccessive sulla distribuzione dei dati. La KNNR può essere applicata in problemi di regressione per anticipare variabili oggettive continue e valutare con precisione la biomassa delle piante invasive. - Utilizzare il modello di stima della biomassa fuori terra scelto nel passaggio 3.2 e scansionare la mappa di distribuzione delle piante invasive dal passaggio 2.3.4 con passi orizzontali e verticali di 280 pixel.

Risultati

Mostriamo i risultati rappresentativi di un metodo basato sulla visione artificiale per la stima delle piante invasive, che viene implementato in modo programmatico su un computer. In questo esperimento, abbiamo valutato la distribuzione spaziale e stimato la biomassa delle piante invasive nei loro habitat naturali, utilizzando Mikania micrantha come soggetto di ricerca. Abbiamo utilizzato un sistema di telecamere per droni per acquisire immagini del sito di ricerca, una parte delle quali è esposta nella

Discussione

Presentiamo le fasi dettagliate di un esperimento sulla stima della biomassa di piante invasive utilizzando il telerilevamento UAV e la visione artificiale. Il processo principale e le fasi di questo accordo sono illustrati nella Figura 7. La corretta qualità dei campioni è uno degli aspetti più cruciali e impegnativi del programma. Questa importanza vale per tutte le piante invasive e per qualsiasi altro esperimento di stima della biomassa vegetale24.

Divulgazioni

Gli autori non hanno nulla da rivelare.

Riconoscimenti

L'autore ringrazia l'Accademia Cinese delle Scienze Agrarie e l'Università del Guangxi per aver sostenuto questo lavoro. Il lavoro è stato supportato dal National Key R&D Program of China (2022YFC2601500 e 2022YFC2601504), dalla National Natural Science Foundation of China (32272633), dallo Shenzhen Science and Technology Program (KCXFZ20230731093259009)

Materiali

| Name | Company | Catalog Number | Comments |

| DSLR camera | Nikon | D850 | Sensor type: CMOS; Maximum number of pixels: 46.89 million; Effective number of pixels: 45.75 million; Maximum resolution 8256 x 5504. |

| GPU - Graphics Processing Unit | NVIDIA | RTX3090 | |

| Hexacopter | DJI | M600PRO | Horizontal flight: 65 km/h (no wind environment); Maximum flight load: 6000 g |

| PyCharm | Python IDE | 2023.1 | |

| Python | Python | 3.8.0 | |

| Pytorch | Pytorch | 1.8.1 |

Riferimenti

- Lian, J. Y., et al. Influence of obligate parasite Cuscuta campestris on the community of its host Mikania micrantha. Weed Research. 46, 441-443 (2006).

- Yu, X., Bao, Q. Aboveground biomass estimation of potato from UAV multispectral imagery. Remote Sensing. 54 (4), 96-99 (2023).

- Guo, T. C., Wang, Y. H., Feng, W. Research on wheat yield estimation based on multimodal data fusion from unmanned aircraft platforms. Acta Agronomica Sinica. 48 (7), 15 (2022).

- Shao, G. M., et al. Estimation of transpiration coefficient and aboveground biomass in maize using time-series UAV multispectral imagery. The Crop Journal. 10 (5), 1376-1385 (2022).

- Jiang, Q., et al. UAV-based biomass estimation for rice-combining spectral, TIN-based structural and meteorological features. Remote Sensing. 11 (7), 890 (2019).

- Fei, S. P., et al. UAV-based multi-sensor data fusion and machine learning algorithm for yield prediction in wheat. Precision Agriculture. 24, 187-212 (2023).

- Shu, S., et al. Aboveground biomass estimation of rice based on unmanned aerial vehicle imagery. Fujian Journal of Agricultural Sciences. 37 (7), 9 (2022).

- Wu, X., et al. UAV LiDAR-based biomass estimation of individual trees. Fujian Journal of Agricultural Sciences. 22 (34), 15028-15035 (2022).

- Yang, X., Zan, M., Munire, M. Estimation of above ground biomass of Populus euphratica forest using UAV and satellite remote sensing. Transactions of the Chinese Society of Agricultural Engineering. 37 (1), 7 (2021).

- Li, B., Liu, K. Forest biomass estimation based on UAV optical remote sensing. Forest Engineering. 5, 38 (2022).

- Li, Z., Zan, Q., Yang, Q., Zhu, D., Chen, Y., Yu, S. Remote estimation of mangrove aboveground carbon stock at the species level using a low-cost unmanned aerial vehicle system. Remote Sensing. 11 (9), 1018 (2019).

- Luo, S., et al. Fusion of airborne LiDAR data and hyperspectral imagery for aboveground and belowground forest biomass estimation. Ecological Indicators. 73, 378-387 (2017).

- Li, S., et al. Research of grassland aboveground biomass inversion based on UAV and satellite remoting sensing. Remote Sensing Technology and Application. 1, 037 (2022).

- Wengert, M., et al. Multisite and multitemporal grassland yield estimation using UAV-borne hyperspectral data. Remote Sensing. 14 (9), 2068 (2022).

- Li, Y., et al. The effect of season on Spartina alterniflora identification and monitoring. Frontiers in Environmental Science. 10, 1044839 (2022).

- Wang, F., et al. Estimation of above-ground biomass of winter wheat based on consumer-grade multi-spectral UAV. Remote Sensing. 14 (5), 1251 (2022).

- Lu, N., et al. Improved estimation of aboveground biomass in wheat from RGB imagery and point cloud data acquired with a low-cost unmanned aerial vehicle system. Plant Methods. 15 (1), 17 (2019).

- Chen, H., et al. Mapping forest aboveground biomass with MODIS and Fengyun-3C VIRR imageries in Yunnan Province, Southwest China using linear regression, K-nearest neighbor and random. Remote Sensing. 14 (21), 5456 (2022).

- Yan, M., et al. Biomass estimation of subtropical arboreal forest at single tree scale based on feature fusion of airborne LiDAR data and aerial images. Sustainability. 15 (2), 1676 (2023).

- Tian, Y. C., et al. Aboveground mangrove biomass estimation in Beibu Gulf using machine learning and UAV remote sensing. Science of the Total Environment. 781, 146816 (2021).

- Shrivastava, A., et al. Beyond skip connections: Top-down modulation for object detection. arXiv. , (2016).

- Belkasim, S. O., Shridhar, M., Ahmadi, M. Pattern classification using an efficient KNNR. Pattern Recognition. 25 (10), 1269-1274 (1992).

- Joel, S., Jose Luis, A., Shawn, C. K. Farming and earth observation: Sentinel-2 data to estimate within-field wheat grain yield. International Journal of Applied Earth Observation and Geoinformation. 107, 102697 (2022).

- Tian, L., et al. Review of remote sensing-based methods for forest aboveground biomass estimation: Progress, challenges, and prospects. Forests. 14 (6), 1086 (2023).

- Wei, X. Biomass estimation: A remote sensing approach. Geography Compass. 4 (11), 1635-1647 (2010).

- Débora, B., et al. New methodology for intertidal seaweed biomass estimation using multispectral data obtained with unoccupied aerial vehicles. Remote Sensing. 15 (13), 3359 (2023).

- Zhang, J. Y., et al. Unmanned aerial system-based wheat biomass estimation using multispectral, structural and meteorological data. Agriculture. 13 (8), 1621 (2023).

- Shen, H., et al. Influence of the obligate parasite Cuscuta campestris on growth and biomass allocation of its host Mikania micrantha. Journal of Experimental Botany. 56 (415), 1277-1284 (2005).

Ristampe e Autorizzazioni

Richiedi autorizzazione per utilizzare il testo o le figure di questo articolo JoVE

Richiedi AutorizzazioneThis article has been published

Video Coming Soon