Zum Anzeigen dieser Inhalte ist ein JoVE-Abonnement erforderlich. Melden Sie sich an oder starten Sie Ihre kostenlose Testversion.

Method Article

Robotisiertes Testen von Kamerapositionen zur Bestimmung der idealen Konfiguration für die Stereo-3D-Visualisierung von Operationen am offenen Herzen

In diesem Artikel

Zusammenfassung

Die menschliche Tiefenwahrnehmung von 3D-Stereovideos hängt von der Kameratrennung, dem Konvergenzpunkt, der Entfernung und der Vertrautheit des Objekts ab. Dieses Papier stellt eine robotisierte Methode zur schnellen und zuverlässigen Testdatenerfassung während einer Live-Operation am offenen Herzen vor, um die ideale Kamerakonfiguration zu bestimmen.

Zusammenfassung

Stereo-3D-Video von chirurgischen Eingriffen kann für die medizinische Ausbildung sehr wertvoll sein und die klinische Kommunikation verbessern. Aber der Zugang zum Operationssaal und zum Operationsfeld ist eingeschränkt. Es ist eine sterile Umgebung, und der physische Raum ist mit chirurgischem Personal und technischer Ausrüstung überfüllt. In diesem Setting sind eine ungesicherte Erfassung und realistische Reproduktion der chirurgischen Eingriffe schwierig. Dieser Artikel stellt eine Methode zur schnellen und zuverlässigen Datenerfassung von stereoskopischen 3D-Videos bei verschiedenen Kamera-Baseline-Entfernungen und Konvergenzabständen vor. Um Testdaten mit minimalen Störungen während der Operation, mit hoher Präzision und Wiederholbarkeit zu sammeln, wurden die Kameras an jeder Hand eines zweiarmigen Roboters befestigt. Der Roboter wurde im Operationssaal an der Decke montiert. Es wurde programmiert, um eine zeitgesteuerte Sequenz synchronisierter Kamerabewegungen durchzuführen, die durch einen Bereich von Testpositionen mit einem Basislinienabstand zwischen 50-240 mm bei inkrementellen Schritten von 10 mm und bei zwei Konvergenzabständen von 1100 mm und 1400 mm schritten. Die Operation wurde angehalten, um 40 aufeinanderfolgende 5-s-Videoproben zu ermöglichen. Insgesamt wurden 10 Operationsszenarien erfasst.

Einleitung

In der Chirurgie kann die 3D-Visualisierung für Bildung, Diagnosen, präoperative Planung und postoperative Bewertung verwendet werden1,2. Realistische Tiefenwahrnehmung kann das Verständnis von normalen und abnormalen Anatomien verbessern3,4,5,6. Einfache 2D-Videoaufnahmen von chirurgischen Eingriffen sind ein guter Anfang. Die fehlende Tiefenwahrnehmung kann es den nicht-chirurgischen Kollegen jedoch erschweren, die antero-posterioren Beziehungen zwischen verschiedenen anatomischen Strukturen vollständig zu verstehen und daher auch das Risiko einer Fehlinterpretation der Anatomie mit sich bringen7,8,9,10.

Das 3D-Betrachtungserlebnis wird von fünf Faktoren beeinflusst: (1) Die Kamerakonfiguration kann entweder parallel oder eingebunden erfolgen, wie in Abbildung 1 dargestellt, (2) Der Basislinienabstand (der Abstand zwischen den Kameras). (3) Abstand zum Objekt von Interesse und anderen Szenenmerkmalen wie dem Hintergrund. (4) Merkmale von Anzeigegeräten wie Bildschirmgröße und Betrachtungsposition1,11,12,13. (5) Individuelle Präferenzen der Zuschauer14,15.

Die Entwicklung eines 3D-Kamera-Setups beginnt mit der Aufnahme von Testvideos, die mit verschiedenen Kamera-Baseline-Entfernungen und -Konfigurationen aufgenommen wurden, um für die subjektive oder automatische Auswertung verwendet zu werden16,17,18,19,20. Der Kameraabstand zum Operationsfeld muss konstant sein, um scharfe Bilder aufzunehmen. Ein fester Fokus wird bevorzugt, da sich der Autofokus anpasst, um sich auf Hände, Instrumente oder Köpfe zu konzentrieren, die möglicherweise sichtbar werden. Dies ist jedoch nicht leicht zu erreichen, wenn der Ort von Interesse das chirurgische Feld ist. Operationssäle sind Bereiche mit eingeschränktem Zugang, da diese Einrichtungen sauber und steril gehalten werden müssen. Technische Geräte, Chirurgen und Scrub Nurses sind oft eng um den Patienten gruppiert, um einen guten visuellen Überblick und einen effizienten Workflow zu gewährleisten. Um die Auswirkungen von Kamerapositionen auf das 3D-Seherlebnis vergleichen und bewerten zu können, sollte ein vollständiger Testbereich von Kamerapositionen die gleiche Szene aufzeichnen, da die Objekteigenschaften wie Form, Größe und Farbe das 3D-Seherlebnis beeinflussen können21.

Aus dem gleichen Grund sollten komplette Testbereiche von Kamerapositionen bei verschiedenen chirurgischen Eingriffen wiederholt werden. Die gesamte Reihenfolge der Positionen muss mit hoher Genauigkeit wiederholt werden. In einem chirurgischen Umfeld sind bestehende Methoden, die entweder eine manuelle Anpassung des Basislinienabstands22 oder verschiedene Kamerapaare mit festen Basislinienabständen23 erfordern, aus Platz- und Zeitgründen nicht durchführbar. Um dieser Herausforderung zu begegnen, wurde diese robotisierte Lösung entwickelt.

Die Daten wurden mit einem zweiarmigen kollaborativen Industrieroboter gesammelt, der in der Decke im Operationssaal montiert war. Kameras wurden an den Handgelenken des Roboters befestigt und bewegten sich entlang einer bogenförmigen Flugbahn mit zunehmendem Basislinienabstand, wie in Abbildung 2 dargestellt.

Um den Ansatz zu demonstrieren, wurden 10 Testreihen von 4 verschiedenen Patienten mit 4 verschiedenen angeborenen Herzfehlern aufgezeichnet. Es wurden Szenen gewählt, in denen eine Pause in der Operation möglich war: mit den schlagenden Herzen kurz vor und nach der chirurgischen Reparatur. Serien wurden auch gemacht, als die Herzen verhaftet wurden. Die Operationen wurden für 3 Minuten und 20 s unterbrochen, um vierzig 5-ssequenzen mit unterschiedlichen Kamerakonvergenzabständen und Basislinienabständen zu sammeln, um die Szene zu erfassen. Die Videos wurden später nachbearbeitet und in 3D für das klinische Team angezeigt, das bewertete, wie realistisch das 3D-Video auf einer Skala von 0-5 war.

Der Konvergenzpunkt für stereo eingebaute Stereokameras ist der Punkt, an dem sich die Mittelpunkte beider Bilder treffen. Der Konvergenzpunkt kann prinzipiell entweder vor, innerhalb oder hinter dem Objekt platziert werden, siehe Abbildung 1A-C. Wenn sich der Konvergenzpunkt vor dem Objekt befindet, wird das Objekt erfasst und links von der Mittellinie für das linke Kamerabild und rechts von der Mittellinie für das rechte Kamerabild angezeigt (Abbildung 1A). Das Gegenteil ist der Fall, wenn sich der Konvergenzpunkt hinter dem Objekt befindet (Abbildung 1B). Wenn sich der Konvergenzpunkt auf dem Objekt befindet, erscheint das Objekt auch in der Mittellinie der Kamerabilder (Abbildung 1C), was vermutlich die angenehmste Betrachtung ergeben sollte, da kein Schielen erforderlich ist, um die Bilder zusammenzuführen. Um ein komfortables Stereo-3D-Video zu erzielen, muss sich der Konvergenzpunkt auf oder leicht hinter dem Objekt von Interesse befinden, andernfalls muss der Betrachter freiwillig nach außen blinzeln (Exotropie).

Die Daten wurden mit einem zweiarmigen kollaborativen Industrieroboter zur Positionierung der Kameras gesammelt (Abbildung 2A-B). Der Roboter wiegt ohne Ausrüstung 38 kg. Der Roboter ist eigensicher; Wenn es einen unerwarteten Aufprall erkennt, hört es auf, sich zu bewegen. Der Roboter wurde so programmiert, dass er die 5-Megapixel-Kameras mit C-Mount-Objektiven entlang einer bogenförmigen Flugbahn positioniert, die bei vorgegebenen Basislinienabständen anhält (Abbildung 2C). Die Kameras wurden mit Adapterplatten an den Roboterhänden befestigt, wie in Abbildung 3 dargestellt. Jede Kamera zeichnete mit 25 Bildern pro Sekunde auf. Die Linsen wurden auf Blendenzahl 1/8 eingestellt, wobei der Fokus auf das Objekt von Interesse (angenäherte geometrische Mitte des Herzens) gerichtet war. Jeder Bildrahmen hatte einen Zeitstempel, der zum Synchronisieren der beiden Videostreams verwendet wurde.

Offsets zwischen dem Roboterhandgelenk und der Kamera wurden kalibriert. Dies kann erreicht werden, indem das Fadenkreuz der Kamerabilder ausgerichtet wird, wie in Abbildung 4 dargestellt. In diesem Setup betrug der gesamte translationale Offset vom Montagepunkt am Roboterhandgelenk und der Mitte des Kamerabildsensors 55,3 mm in X-Richtung und 21,2 mm in Z-Richtung,5, dargestellt in Abbildung 5. Die Rotationsversätze wurden bei einem Konvergenzabstand von 1100 mm und einem Basislinienabstand von 50 mm kalibriert und manuell mit dem Joystick am Roboterbedienfeld eingestellt. Der Roboter in dieser Studie hatte eine spezifizierte Genauigkeit von 0,02 mm im kartesischen Raum und eine Rotationsauflösung von 0,01 Grad24. Bei einem Radius von 1100 m versetzt eine Winkeldifferenz von 0,01 Grad den Mittelpunkt um 0,2 mm. Während der vollständigen Roboterbewegung von 50-240 mm Abstand war das Fadenkreuz für jede Kamera innerhalb von 2 mm vom idealen Konvergenzzentrum entfernt.

Der Basislinienabstand wurde schrittweise durch symmetrische Trennung der Kameras um den Mittelpunkt des Sichtfeldes in Schritten von 10 mm im Bereich von 50-240 mm erhöht (Abbildung 2). Die Kameras wurden in jeder Position für 5 s im Stillstand gehalten und mit einer Geschwindigkeit von 50 mm/s zwischen den Positionen bewegt. Der Konvergenzpunkt konnte über eine grafische Benutzeroberfläche in X- und Z-Richtung eingestellt werden (Abbildung 6). Entsprechend folgte der Roboter in seinem Arbeitsbereich.

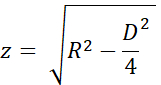

Die Genauigkeit des Konvergenzpunkts wurde anhand der einheitlichen Dreiecke und der Variablennamen in Den Abbildungen 7A und B geschätzt. Die Höhe 'z' wurde aus dem Konvergenzabstand 'R' mit dem Satz des Pythagoras berechnet als

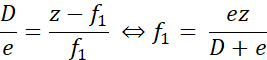

Wenn der reale Konvergenzpunkt näher als der gewünschte Punkt war, wie in Abbildung 7A dargestellt, wurde der Fehlerabstand "f1" wie folgt berechnet:

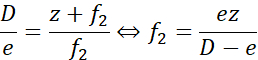

Wenn der Konvergenzpunkt distal zum gewünschten Punkt war, wurde der Fehlerabstand "f2" wie folgt berechnet:

Hier war "e" der maximale Abstand zwischen dem Fadenkreuz, höchstens 2 mm bei maximaler Baseline-Trennung während der Kalibrierung (D = 240 mm). Bei R = 1100 mm (z = 1093 mm) betrug der Fehler weniger als ± 9,2 mm. Bei R = 1400 mm (z = 1395 mm) betrug der Fehler ± 11,7 mm. Das heißt, der Fehler bei der Platzierung des Konvergenzpunkts lag innerhalb von 1% des gewünschten Punktes. Die beiden Testabstände von 1100 mm und 1400 mm waren daher gut voneinander getrennt.

Protokoll

Die Experimente wurden von der örtlichen Ethikkommission in Lund, Schweden, genehmigt. Die Teilnahme war freiwillig, und die Erziehungsberechtigten der Patienten gaben eine schriftliche Einwilligung.

1. Einrichtung und Konfiguration des Roboters

HINWEIS: Bei diesem Experiment wurden ein zweiarmiger kollaborativer Industrieroboter und das Standard-Bedienfeld mit einem Touch-Display verwendet. Gesteuert wird der Roboter mit der Steuerungssoftware RobotWare 6.10.01 und robot integrated development environment (IDE) RobotStudio 2019.525. Von den Autoren entwickelte Software, einschließlich der Roboteranwendung, der Aufzeichnungsanwendung und der Nachbearbeitungsskripte, ist im GitHub-Repository26 verfügbar.

VORSICHT: Verwenden Sie eine Schutzbrille und reduzieren Sie die Geschwindigkeit beim Einrichten und Testen des Roboterprogramms.

- Montieren Sie den Roboter an der Decke oder einem Tisch mit Schrauben mit einer Abmessung von 100 kg, wie auf Seite 25 in der Produktspezifikation24 beschrieben, gemäß den Angaben des Herstellers. Stellen Sie sicher, dass sich die Arme frei bewegen können und die Sichtlinie zum Sichtfeld nicht verdeckt ist.

ACHTUNG: Verwenden Sie Hebe- oder Sicherheitsseile, wenn Sie den Roboter in einer hohen Position montieren. - Starten Sie den Roboter, indem Sie den Startschalter an der Basis des Roboters drehen. Kalibrieren Sie den Roboter, indem Sie das in der Bedienungsanleitung auf den Seiten 47-5625 beschriebene Verfahren befolgen.

- Starten Sie die Robot-IDE auf einem Windows-Computer.

- Verbinden Sie sich mit dem physischen Robotersystem (Bedienungsanleitung Seite 14027).

- Laden Sie den Code für das Roboterprogramm und die Anwendungsbibliotheken für die Benutzeroberfläche in den Roboter:

- Der Robotercode für einen deckenmontierten Roboter befindet sich im Ordner Robot/InvertedCode und für einen tischmontierten Roboter in Robot/TableMountedCode. Für jede der Dateien left/Data.mod, left/MainModule.mod, right/Data.mod und right/MainModule.mod:

- Erstellen Sie ein neues Programmmodul (siehe Bedienungsanleitung Seite 31827) mit dem gleichen Namen wie die Datei (Data oder MainModule) und kopieren Sie den Dateiinhalt in das neue Modul.

- Drücken Sie in der Roboter-IDE auf Übernehmen , um die Dateien auf dem Roboter zu speichern.

- Verwenden Sie File Transfer (Bedienungsanleitung Seite 34627), um die Roboteranwendungsdateien TpSViewStereo2.dll, TpsViewStereo2.gtpu.dll und TpsViewStereo2.pdb im FPApp-Ordner an den Roboter zu übertragen. Nach diesem Schritt wird die Roboter-IDE nicht weiter verwendet.

- Drücken Sie die Reset-Taste auf der Rückseite des Roboter-Touch-Displays (FlexPendant), um die grafische Oberfläche neu zu laden. Die Roboteranwendung Stereo2 wird nun im Touch-Display-Menü sichtbar sein.

- Installieren Sie die Aufzeichnungsanwendung (Liveview) und die Nachbearbeitungsanwendung auf einem Ubuntu 20.04-Computer, indem Sie das Skript install_all_linux.sh ausführen, das sich im Stammordner im Github-Repository befindet.

- Montieren Sie jede Kamera am Roboter. Die für die Montage benötigten Komponenten sind in Abbildung 3A dargestellt.

- Montieren Sie das Objektiv an der Kamera.

- Befestigen Sie die Kamera mit drei M2-Schrauben an der Kameraadapterplatte.

- Befestigen Sie die kreisrunde Montageplatte mit vier M6-Schrauben auf der gegenüberliegenden Seite der Kamera an der Kameraadapterplatte.

- Wiederholen Sie die Schritte 1.9.1-1.9.3 für die andere Kamera. Die resultierenden Baugruppen werden gespiegelt, wie in Abbildung 3B und Abbildung 3C dargestellt.

- Befestigen Sie die Adapterplatte mit vier M2,5-Schrauben am Roboterhandgelenk, wie in Abbildung 3D dargestellt.

- Für einen an der Decke montierten Roboter: Befestigen Sie die linke Kamera in Abbildung 3C am linken Roboterarm, wie in Abbildung 2A dargestellt.

- Für einen Am Tisch montierten Roboter: Befestigen Sie die linke Kamera in Abbildung 3C am rechten Roboterarm.

- Schließen Sie die USB-Kabel an die Kameras (siehe Abbildung 3E) und an den Ubuntu-Computer an.

2. Überprüfen Sie die Kamerakalibrierung

- Drücken Sie auf dem Roboter-Touch-Display die Menü-Taste und wählen Sie Stereo2 , um die Roboteranwendung zu starten. Dadurch wird der Hauptbildschirm geöffnet, wie in Abbildung 6A dargestellt.

- Drücken Sie auf dem Hauptbildschirm auf Go, um für 1100 mm in der Roboteranwendung zu starten, und warten Sie, bis sich der Roboter in die Startposition bewegt hat.

- Entfernen Sie die Schutzkappen von den Kameras und schließen Sie die USB-Kabel an den Ubuntu-Computer an.

- Legen Sie ein gedrucktes Kalibrierraster (CalibrationGrid.png in das Repository) 1100 mm von den Kamerasensoren entfernt auf. Um die korrekte Identifizierung der entsprechenden Quadrate zu erleichtern, platzieren Sie eine kleine Schraubenmutter oder Markierung irgendwo in der Mitte des Gitters.

- Starten Sie die Aufnahmeanwendung auf dem Ubuntu-Computer (führen Sie das Skript start.sh aus, das sich im Liveview-Ordner im Github-Repository befindet). Dadurch wird die Schnittstelle gestartet, wie in Abbildung 4 dargestellt.

- Passen Sie die Blende und den Fokus auf das Objektiv mit der Blende und den Fokusringen an.

- Aktivieren Sie in der Aufzeichnungsanwendung das Kontrollkästchen Fadenkreuz , um das Fadenkreuz zu visualisieren.

- Stellen Sie in der Aufzeichnungsanwendung sicher, dass das Fadenkreuz in beiden Kamerabildern an derselben Position mit dem Kalibrierungsraster ausgerichtet ist, wie in Abbildung 4 dargestellt. Höchstwahrscheinlich werden einige Anpassungen wie folgt erforderlich sein:

- Wenn sich die Kreuze nicht überlappen, drücken Sie das Zahnradsymbol (unten links Abbildung 6A) in der Roboteranwendung auf dem Roboter-Touch-Display, um den Einstellungsbildschirm zu öffnen, wie in Abbildung 6B dargestellt.

- Drücken Sie auf 1. Wechseln Sie zu Start Pos, wie in Abbildung 6B dargestellt.

- Joggen Sie den Roboter mit dem Joystick, um die Kameraposition einzustellen (Bedienungsanleitung Seite 3123).

- Aktualisieren Sie die Werkzeugposition für jeden Roboterarm. Drücken Sie 3. Aktualisieren Sie das linke Werkzeug und 4. Aktualisieren Sie das rechte Werkzeug , um die Kalibrierung für den linken bzw. rechten Arm zu speichern.

- Drücken Sie auf das Zurück-Pfeil-Symbol (oben rechts, Abbildung 6B), um zum Hauptbildschirm zurückzukehren.

- Drücken Sie in der Roboteranwendung auf Experiment ausführen (Abbildung 6A), und überprüfen Sie, ob das Fadenkreuz ausgerichtet ist. Andernfalls wiederholen Sie die Schritte 2.3-2.3.5.

- Fügen Sie an dieser Stelle alle Änderungen der Entfernungen und/oder der Uhrzeit hinzu und testen Sie sie. Dies erfordert Änderungen im Roboterprogrammcode und erweiterte Roboterprogrammierfähigkeiten. Ändern Sie die folgenden Variablen im Datenmodul in der linken Aufgabe (arm): die gewünschten Trennabstände in der Ganzzahlarrayvariablen Distances, die Konvergenzabstände im Ganzzahlarray ConvergencePos und bearbeiten Sie die Zeit bei jedem Schritt durch Editieren der Variablen Nwaittime (Wert in Sekunden).

VORSICHT: Führen Sie niemals ein ungetestetes Roboterprogramm während einer Live-Operation aus. - Wenn die Kalibrierung abgeschlossen ist, drücken Sie auf Erhöhen , um die Roboterarme in die Standby-Position zu heben.

- Schalten Sie optional den Roboter aus.

HINWEIS: Der Vorgang kann zwischen einem der oben genannten Schritte angehalten werden.

3. Vorbereitung zu Beginn der Operation

- Stauben Sie den Roboter ab.

- Wenn der Roboter ausgeschaltet wurde, starten Sie ihn, indem Sie den Startschalter an der Basis des Roboters einschalten.

- Starten Sie die in den Schritten 2.1 und 2.2 beschriebene Roboteranwendung auf dem Touch-Display und der Aufzeichnungsanwendung.

- Erstellen Sie in der Aufnahmeanwendung den Ordner, in dem das Video gespeichert werden soll, und wählen Sie ihn aus (drücken Sie Ordner ändern).

- In der Roboteranwendung: Drücken Sie das Zahnradsymbol, positionieren Sie die Kameras in Bezug auf den Patienten. Ändern Sie die X- und Z-Richtung, indem Sie +/- für Handabstand vom Roboter bzw. Höhe drücken, damit das Bild das Operationsfeld erfasst. Führen Sie die Positionierung in Y-Richtung durch, indem Sie den Roboter oder Patienten manuell bewegen.

HINWEIS: Die Vorbereitungen können zwischen den Vorbereitungsschritten 3.1-3.4 pausiert werden.

4. Experimentieren Sie

ACHTUNG: Alle Mitarbeiter sollten vorher über das Experiment informiert werden.

- Unterbrechen Sie die Operation.

- Informieren Sie das OP-Personal, dass das Experiment gestartet wurde.

- Drücken Sie in der Aufzeichnungsanwendung auf Aufnahme.

- Drücken Sie in der Roboteranwendung auf Experiment ausführen .

- Warten Sie, während das Programm ausgeführt wird. Der Roboter zeigt "Fertig" in der Roboteranwendung auf dem Touch-Display an, wenn er fertig ist.

- Beenden Sie die Aufzeichnung in der Aufnahmeanwendung, indem Sie auf Beenden klicken.

- Informieren Sie das OP-Personal, dass das Experiment beendet ist.

- Nehmen Sie die Operation wieder auf.

HINWEIS: Das Experiment kann während der Schritte 4.1-4.6 nicht angehalten werden.

5. Wiederholen

- Wiederholen Sie die Schritte 4.1-4.6, um eine weitere Sequenz zu erfassen, und die Schritte 3.1-3.4 und die Schritte 4.1-4.6, um Sequenzen aus verschiedenen Operationen zu erfassen. Erfassen Sie etwa zehn vollständige Sequenzen.

6. Nachbearbeitung

HINWEIS: Die folgenden Schritte können mit den meisten Videobearbeitungsprogrammen oder den bereitgestellten Skripten im Postprocessing-Ordner durchgeführt werden.

- Deaktivieren Sie in diesem Fall das Video, da es im RAW-Format gespeichert ist:

- Führen Sie das Skript postprocessing/debayer/run.sh aus, um die in Abbildung 8A dargestellte Debayer-Anwendung zu öffnen.

- Drücken Sie auf Eingabeverzeichnis durchsuchen und wählen Sie den Ordner mit dem RAW-Video aus.

- Klicken Sie auf Ausgabeverzeichnis durchsuchen und wählen Sie einen Ordner für die resultierenden debayerierten und farblich angepassten Videodateien aus.

- Drücken Sie Debayer! und warten Sie, bis der Vorgang abgeschlossen ist - beide Fortschrittsbalken sind voll, wie in Abbildung 8B dargestellt.

- Führen Sie die rechts und links synchronisierten Videos im 3D-Stereoformat zusammen28:

- Führen Sie das Skript postprocessing/merge_tb/run.sh aus, um die Mergeanwendung zu starten. Die in Abbildung 8C dargestellte grafische Benutzeroberfläche wird geöffnet.

- Klicken Sie auf Eingabeverzeichnis durchsuchen und wählen Sie den Ordner mit den gelöschten Videodateien aus.

- Klicken Sie auf Ausgabeverzeichnis durchsuchen und wählen Sie einen Ordner für die resultierende zusammengeführte 3D-Stereodatei aus.

- Drücken Sie Merge! und warten Sie, bis der Fertigbildschirm in Abbildung 8D angezeigt wird.

- Verwenden Sie handelsübliche Videobearbeitungssoftware wie Premiere Pro, um jedem Kameraabstand im Video Textbeschriftungen hinzuzufügen.

HINWEIS: Im Video gibt es jedes Mal, wenn sich der Roboter bewegt, ein sichtbares Schütteln und die Kameraentfernung erhöht. In diesem Experiment wurden die Bezeichnungen A-T für die Kameraabstände verwendet.

7. Bewertung

- Zeigen Sie das Video im 3D-Format von oben bis unten mit einem aktiven 3D-Projektor an.

- Das Seherlebnis hängt vom Betrachtungswinkel und der Entfernung zum Bildschirm ab. bewerten Sie das Video anhand der Zielgruppe und des Setups.

Ergebnisse

Ein akzeptables Auswertungsvideo mit dem rechten Bild oben in stereoskopischem 3D oben und unten wird in Video1 gezeigt. Eine erfolgreiche Sequenz sollte scharf, fokussiert und ohne unsynchronisierte Bildrahmen sein. Nicht synchronisierte Videostreams verursachen Unschärfe, wie in der Datei Video 2 gezeigt. Der Konvergenzpunkt sollte horizontal zentriert sein, unabhängig von der Kameratrennung, wie in Abbildung 9A,B dargestellt. Wenn der R...

Diskussion

Während der Live-Operation war die Gesamtzeit des Experiments, das für die 3D-Videodatenerfassung verwendet wurde, begrenzt, um für den Patienten sicher zu sein. Wenn das Objekt nicht fokussiert oder überbelichtet ist, können die Daten nicht verwendet werden. Die kritischen Schritte sind während der Kalibrierung und Einrichtung des Kamerawerkzeugs (Schritt 2). Die Kamerablende und der Fokus können nicht geändert werden, wenn die Operation begonnen hat. Die gleichen Lichtverhältnisse und Abstände sollten währen...

Offenlegungen

Die Autoren haben nichts preiszugeben.

Danksagungen

Die Forschung wurde mit Mitteln von Vinnova (2017-03728, 2018-05302 und 2018-03651), der Herz-Lungen-Stiftung (20180390), der Familien-Kamprad-Stiftung (20190194) und der Anna-Lisa und Sven Eric Lundgren-Stiftung (2017 und 2018) durchgeführt.

Materialien

| Name | Company | Catalog Number | Comments |

| 2 C-mount lenses (35 mm F2.1, 5 M pixel) | Tamron | M112FM35 | Rated for 5 Mpixel |

| 3D glasses (DLP-link active shutter) | Celexon | G1000 | Any compatible 3D glasses can be used |

| 3D Projector | Viewsonic | X10-4K | Displays 3D in 1080, can be exchanged for other 3D projectors |

| 6 M2 x 8 screws | To attach the cXimea cameras to the camera adaptor plates | ||

| 8 M2.5 x 8 screws | To attach the circular mounting plates to the robot wrist | ||

| 8 M5 x 40 screws | To mount the robot | ||

| 8 M6 x 10 screws with flat heads | For attaching the circular mounting plate and the camera adaptor plates | ||

| Calibration checker board plate (25 by 25 mm) | Any standard checkerboard can be used, including printed, as long as the grid is clearly visible in the cameras | ||

| Camera adaptor plates, x2 | Designed by the authors in robot_camera_adaptor_plates.dwg, milled in aluminium. | ||

| Circular mounting plates, x2 | Distributed with the permission of the designer Julius Klein and printed with ABS plastic on an FDM 3D printer. License Tecnalia Research & Innovation 2017. Attached as Mountingplate_ROBOT_SIDE_ NewDesign_4.stl | ||

| Fix focus usb cameras, x2 (5 Mpixel) | Ximea | MC050CG-SY-UB | With Sony IMX250LQR sensor |

| Flexpendant | ABB | 3HAC028357-001 | robot touch display |

| Liveview | recording application | ||

| RobotStudio | robot integrated development environment (IDE) | ||

| USB3 active cables (10.0 m), x2 | Thumbscrew lock connector, water proofed. | ||

| YuMi dual-arm robot | ABB | IRB14000 |

Referenzen

- Held, R. T., Hui, T. T. A guide to stereoscopic 3D displays in medicine. Academic Radiology. 18 (8), 1035-1048 (2011).

- van Beurden, M. H. P. H., IJsselsteijn, W. A., Juola, J. F. Effectiveness of stereoscopic displays in medicine: A review. 3D Research. 3 (1), 1-13 (2012).

- Luursema, J. M., Verwey, W. B., Kommers, P. A. M., Geelkerken, R. H., Vos, H. J. Optimizing conditions for computer-assisted anatomical learning. Interacting with Computers. 18 (5), 1123-1138 (2006).

- Takano, M., et al. Usefulness and capability of three-dimensional, full high-definition movies for surgical education. Maxillofacial Plastic and Reconstructive Surgery. 39 (1), 10 (2017).

- Triepels, C. P. R., et al. Does three-dimensional anatomy improve student understanding. Clinical Anatomy. 33 (1), 25-33 (2020).

- Beermann, J., et al. Three-dimensional visualisation improves understanding of surgical liver anatomy. Medical Education. 44 (9), 936-940 (2010).

- Battulga, B., Konishi, T., Tamura, Y., Moriguchi, H. The Effectiveness of an interactive 3-dimensional computer graphics model for medical education. Interactive Journal of Medical Research. 1 (2), (2012).

- Yammine, K., Violato, C. A meta-analysis of the educational effectiveness of three-dimensional visualization technologies in teaching anatomy. Anatomical Sciences Education. 8 (6), 525-538 (2015).

- Fitzgerald, J. E. F., White, M. J., Tang, S. W., Maxwell-Armstrong, C. A., James, D. K. Are we teaching sufficient anatomy at medical school? The opinions of newly qualified doctors. Clinical Anatomy. 21 (7), 718-724 (2008).

- Bergman, E. M., Van Der Vleuten, C. P. M., Scherpbier, A. J. J. A. Why don't they know enough about anatomy? A narrative review. Medical Teacher. 33 (5), 403-409 (2011).

- Terzić, K., Hansard, M. Methods for reducing visual discomfort in stereoscopic 3D: A review. Signal Processing: Image Communication. 47, 402-416 (2016).

- Fan, Z., Weng, Y., Chen, G., Liao, H. 3D interactive surgical visualization system using mobile spatial information acquisition and autostereoscopic display. Journal of Biomedical Informatics. 71, 154-164 (2017).

- Fan, Z., Zhang, S., Weng, Y., Chen, G., Liao, H. 3D quantitative evaluation system for autostereoscopic display. Journal of Display Technology. 12 (10), 1185-1196 (2016).

- McIntire, J. P., et al. Binocular fusion ranges and stereoacuity predict positional and rotational spatial task performance on a stereoscopic 3D display. Journal of Display Technology. 11 (11), 959-966 (2015).

- Kalia, M., Navab, N., Fels, S. S., Salcudean, T. A method to introduce & evaluate motion parallax with stereo for medical AR/MR. IEEE Conference on Virtual Reality and 3D User Interfaces. , 1755-1759 (2019).

- Kytö, M., Hakala, J., Oittinen, P., Häkkinen, J. Effect of camera separation on the viewing experience of stereoscopic photographs. Journal of Electronic Imaging. 21 (1), 1-9 (2012).

- Moorthy, A. K., Su, C. C., Mittal, A., Bovik, A. C. Subjective evaluation of stereoscopic image quality. Signal Processing: Image Communication. 28 (8), 870-883 (2013).

- Yilmaz, G. N. A depth perception evaluation metric for immersive 3D video services. 3DTV Conference: The True Vision - Capture, Transmission and Display of 3D Video. , 1-4 (2017).

- Lebreton, P., Raake, A., Barkowsky, M., Le Callet, P. Evaluating depth perception of 3D stereoscopic videos. IEEE Journal on Selected Topics in Signal Processing. 6, 710-720 (2012).

- López, J. P., Rodrigo, J. A., Jiménez, D., Menéndez, J. M. Stereoscopic 3D video quality assessment based on depth maps and video motion. EURASIP Journal on Image and Video Processing. 2013 (1), 62 (2013).

- Banks, M. S., Read, J. C., Allison, R. S., Watt, S. J. Stereoscopy and the human visual system. SMPTE Motion Imaging Journal. 121 (4), 24-43 (2012).

- Kytö, M., Nuutinen, M., Oittinen, P. Method for measuring stereo camera depth accuracy based on stereoscopic vision. Three-Dimensional Imaging, Interaction, and Measurement. 7864, 168-176 (2011).

- Kang, Y. S., Ho, Y. S. Geometrical compensation algorithm of multiview image for arc multi-camera arrays. Advances in Multimedia Information Processing. 2008, 543-552 (2008).

- Product Specification IRB 14000. DocumentID: 3HAC052982-001 Revision J. ABB Robotics Available from: https://library.abb.com/en/results (2018)

- Operating Manual IRB 14000. Document ID: 3HAC052986-001 Revision F. ABB Robotics Available from: https://library.abb.com/en/results (2019)

- . Github repository Available from: https://github.com/majstenmark/stereo2 (2021)

- Operating manual RobotStudio. Document ID: 3HAC032104-001 Revision Y. ABB Robotics Available from: https://library.abb.com/en/results (2019)

- Won, C. S. Adaptive interpolation for 3D stereoscopic video in frame-compatible top-bottom packing. IEEE International Conference on Consumer Electronics. 2011, 179-180 (2011).

- Kim, S. K., Lee, C., Kim, K. T., Javidi, B., Okano, F., Son, J. Y. Multi-view image acquisition and display. Three-Dimensional Imaging, Visualization, and Display. , 227-249 (2009).

- Liu, F., Niu, Y., Jin, H. Keystone correction for stereoscopic cinematography. IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops. 2012, 1-7 (2012).

- Kang, W., Lee, S. Horizontal parallax distortion correction method in toed-in camera with wide-angle lens. 3DTV Conference: The True Vision - Capture, Transmission and Display of 3D Video. 2009, 1-4 (2009).

Nachdrucke und Genehmigungen

Genehmigung beantragen, um den Text oder die Abbildungen dieses JoVE-Artikels zu verwenden

Genehmigung beantragenWeitere Artikel entdecken

This article has been published

Video Coming Soon

Copyright © 2025 MyJoVE Corporation. Alle Rechte vorbehalten