Method Article

从武器训练场景图像生成战士头像,用于爆炸曝光模拟

摘要

开发了一种计算框架,以使用图像和/或视频数据自动重建由士兵的 3D 化身组成的虚拟场景。虚拟场景有助于估计武器训练期间的爆炸超压暴露。该工具有助于在各种场景中的爆炸暴露模拟中真实地表示人体姿势。

摘要

参与武器训练的军事人员会反复遭受低空爆炸。估计爆炸载荷的主流方法涉及可穿戴式爆炸量计。然而, 使用可穿戴传感器数据,如果不了解服役人员的身体姿势,就无法准确估计头部或其他器官的爆炸负荷。开发了一个用于进行更安全武器训练的图像/视频增强互补实验计算平台。本研究描述了从视频数据自动生成武器训练场景以进行爆炸暴露模拟的协议。在武器射击的瞬间,从视频数据中提取的爆炸场景涉及军人的身体化身、武器、地面和其他结构。计算协议用于使用这些数据重建服务成员的位置和姿势。从服役人员身体剪影中提取的图像或视频数据用于生成解剖骨骼和关键的人体测量数据。这些数据用于生成 3D 体表头像,这些头像被分割成单独的身体部位,并进行几何转换以匹配提取的服役人员姿势。最终的虚拟武器训练场景用于对军人身上的武器冲击波载荷进行 3D 计算模拟。武器训练场景生成器已用于从图像或视频中以各种方向和姿势构建单个服役人员身体的 3D 解剖头像。给出了从肩扛式突击武器系统和迫击炮武器系统图像数据生成训练场景的结果。爆炸超压 (BOP) 工具使用虚拟武器训练场景对军人化身上的冲击波负载进行 3D 模拟。本文介绍了武器射击的爆炸波传播的 3D 计算模拟,以及训练中军人身上的相应爆炸载荷。

引言

在军事训练期间,军人和教官经常受到重型和轻型武器的低强度爆炸。最近的研究表明,爆炸暴露可能导致神经认知能力下降 1,2 和血液生物标志物改变 3,4,5,6。反复的低强度爆炸暴露导致难以保持最佳性能和最大限度地降低受伤风险 7,8。使用可穿戴压力传感器的传统方法有缺点,尤其是在精确确定头部9 上的爆炸压力时。重复低强度爆炸暴露对人类表现(例如,在训练和操作角色期间)的已知不利影响加剧了这个问题。国会授权(第 734 和 717 节)规定了在训练和战斗中监测爆炸暴露的要求,并将其纳入军人的医疗记录10。

可穿戴传感器可用于监测这些战斗训练操作期间的爆炸超压。然而,由于冲击波与人体相互作用的复杂性,这些传感器会受到身体姿势、方向和与冲击源的距离等变量的影响9。以下因素会影响压力分布和传感器测量9:

距爆炸源的距离:随着爆炸波的分散和衰减,压力强度随距离而变化。更靠近爆炸的传感器记录更高的压力,从而影响数据的准确性和一致性。

身体姿势:不同的姿势会使各种身体表面暴露在爆炸中,从而改变压力分布。例如,站立与蹲伏会产生不同的压力读数 9,11。

方向:物体相对于爆炸源的角度会影响压力波与物体的相互作用,从而导致读数9 的差异。基于物理的数值模拟通过系统地考虑这些变量来提供更准确的评估,与可穿戴传感器相比,可提供受控的全面分析,而可穿戴传感器本身受这些因素的影响。

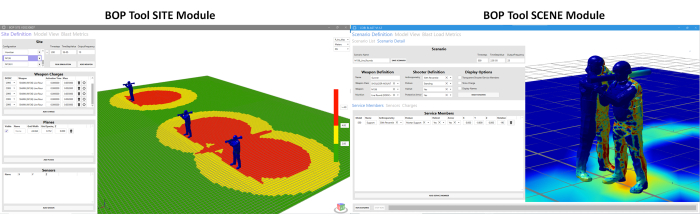

为了应对这些挑战,人们齐心协力开发更复杂的工具。在这个方向上,开发了爆炸超压 (BOP) 工具。该工具用于估计武器系统周围不同军人姿势和位置下的超压暴露。BOP 工具11 下有两个不同的模块。它们是 (a) BOP 工具 SCENE 模块和 (b) BOP 工具 SITE 模块。这些模块用于估计武器射击期间的爆炸超压12。BOP SCENE 模块用于估计参与训练场景的单个服务人员或教官所经历的爆炸超压,而 BOP SITE 模块则重建了培训课程的鸟瞰图,描绘了多个射击站产生的爆炸超压区。 图 1 显示了这两个模块的快照。目前,防喷器工具模块包括四个国防部定义的一级武器系统的武器爆炸超压特性(等效爆炸源术语),包括 M107 .50 cal 特殊应用狙击步枪 (SASR)、M136 肩扛式突击武器、M120 间接火力迫击炮和突破炸药。术语 Weapon blast kernel 是指一个等效的爆炸源术语,用于复制武器系统周围与实际武器相同的爆炸场。用于开发 BOP 工具的计算框架的更详细说明可供进一步参考11。超压仿真使用 CoBi-Blast 求解器引擎运行。这是一个用于模拟爆炸超压的多尺度多物理场工具。该发动机的爆炸建模能力根据文献12 中的实验数据进行了验证。此 BOP 工具目前正在集成到靶场管理器工具包 (RMTK) 中,用于不同的武器训练靶场。RMTK 是一套多服务桌面工具,旨在通过自动化靶场操作、安全和现代化流程来满足整个陆军、海军陆战队、空军和海军靶场管理人员的需求。

图 1:BOP 工具 SCENE 模块和 BOP 工具 SITE 模块的图形用户界面 (GUI)。 BOP SCENE 模块旨在估计军人和教官身体模型上的爆炸超压,而 BOP SITE 模块旨在提供代表训练场的平面上的超压等值线估计。用户可以选择飞机相对于地面的高度。 请单击此处查看此图的较大版本。

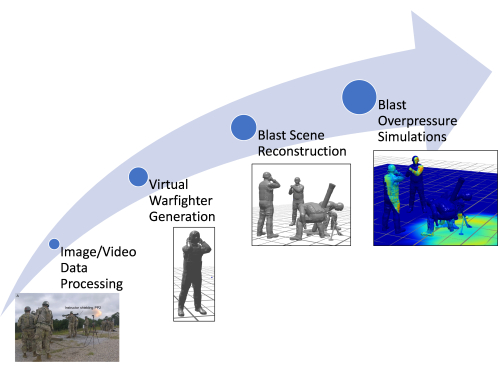

现有 BOP 工具 SCENE 模块的一个限制是它使用手动估计的数据来构建虚拟服务成员身体模型,包括他们的人体测量学、姿势和位置。以适当的姿势手动生成虚拟服务成员是劳动密集型且耗时的11,12。传统 BOP 工具(传统方法)使用预配置姿势的数据库,根据图像数据(如果可用)构建武器训练场景。此外,由于姿势是通过视觉评估手动近似的,因此可能无法为复杂的姿势设置捕捉到正确的姿势。因此,这种方法在估计单个服役人员的超压暴露中引入了不准确(因为姿势的变化可能会改变更脆弱区域的超压暴露)。本文介绍了对现有计算框架所做的改进,以便使用现有的最先进的姿态估计工具快速自动生成服役人员模型。本文讨论了 BOP 工具的增强,特别强调开发一种新颖且快速的计算管道,用于使用视频和图像数据重建爆炸现场。与传统方法相比,改进后的工具还可以在武器射击时重建军人和教官的详细身体模型,利用视频数据创建个性化的头像。这些头像准确地反映了服役人员的姿势。这项工作简化了生成爆炸场景的过程,并有助于更快速地为其他武器系统包含爆炸场景,从而显著减少创建武器训练场景所需的时间和精力。图 2 显示了本文讨论的增强计算框架的示意图。

图 2:计算框架中的整体工艺流程图示意图。 不同的步骤包括图像/视频数据处理、虚拟战斗机生成、爆炸场景重建和爆炸超压模拟。 请单击此处查看此图的较大版本。

本文介绍了 BOP 工具中实施的自动化方法,这代表了可用于估计训练和操作期间超压暴露的计算工具的重大改进。该工具通过快速生成个性化头像和训练场景而与众不同,允许沉浸式爆炸超压模拟。这标志着与传统上依赖群体平均人体模型的巨大不同,提供了一种更精确和个性化的方法。

自动化过程中使用的计算工具

虚拟服务成员模型的自动生成是一个多步骤过程,它利用高级计算工具将原始图像或视频数据转换为详细的 3D 表示。整个过程是自动化的,但如果需要,可以进行调整以允许手动输入已知测量值。

3D 姿态估计工具: 自动化管道的核心是 3D 姿势估计工具。这些工具分析图像数据,以识别服役人员体内每个关节的位置和方向,从而有效地创建数字骨架。该管道目前支持提供 Python API 的 Mediapipe 和 MMPose。但是,该系统在设计时考虑了灵活性,允许结合其他工具,例如深度相机,前提是它们可以输出必要的 3D 关节和骨骼数据。

人体测量模型生成器 (AMG): 一旦估计了 3D 姿势,AMG 就开始发挥作用。该工具利用姿势数据创建与服役人员独特的身体尺寸相匹配的 3D 皮肤表面模型。AMG 工具允许自动或手动输入人体测量结果,然后将其链接到工具中的主组件,以相应地变形 3D 体网格。

OpenSim 骨骼建模: 下一步涉及开源 OpenSim 平台13,其中调整骨骼模型以与 3D 姿势数据对齐。姿势估计工具不会在骨骼中强制要求骨骼长度一致,这可能会导致身体中出现不切实际的不对称。使用解剖学上正确的 OpenSim 骨骼可产生更逼真的骨骼结构。标记放置在 OpenSim 骨架上,以与姿势估计工具识别的关节中心相对应。然后,使用标准动画技术将此骨架模型装配到 3D 蒙皮网格上。

反向运动学和 Python 脚本: 为了最终确定虚拟服务成员的姿态,采用了逆运动学算法。此算法会调整 OpenSim 骨架模型,以最好地匹配估计的 3D 姿势。整个姿势管道是完全自动化的,并在 Python 3 中实现。通过集成这些工具,生成虚拟服务成员模型的过程大大加快,将所需时间从几天缩短到几秒钟或几分钟。这一进步代表了武器训练场景模拟和分析的飞跃,提供了使用图像或视频记录的特定场景的快速重建。

研究方案

本研究中使用的图像和视频不是作者直接从人类受试者那里获得的。一张图片来自维基共享资源上的免费资源,该资源可在公共领域许可下使用。另一张图片由沃尔特·里德陆军研究所 (WRAIR) 的合作者提供。从 WRAIR 获得的数据身份不明,并根据其机构指南共享。对于 WRAIR 提供的图像,该协议遵循了 WRAIR 人类研究伦理委员会的指导方针,包括获得所有必要的批准和同意。

1. 访问 BOP Tool SCENE 模块

- 单击 BOP Tool SCENE 模块 按钮,从 BOP Tool Interface 打开 BOP Tool SCENE 模块。

- 单击 Scenario Definition ,然后单击 Scenario Detail 选项卡。

2. 读取和处理图像数据

- 单击 BOP 工具 SCENE 模块中的 POSETOOL IMPORT 按钮。此时会打开一个弹出窗口,要求用户选择相关的图像或视频。

- 导航到文件夹,然后使用鼠标操作选择相关的图像/视频。

- 点击 可选 选择图像后,在弹出窗口中。

注意:该操作读取图像或视频文件,如果选中视频则生成图像,在后台运行位姿估计算法,生成武器训练场景中涉及的虚拟军人模型,并将其加载到 BOP Tool SCENE 模块的相应位置。

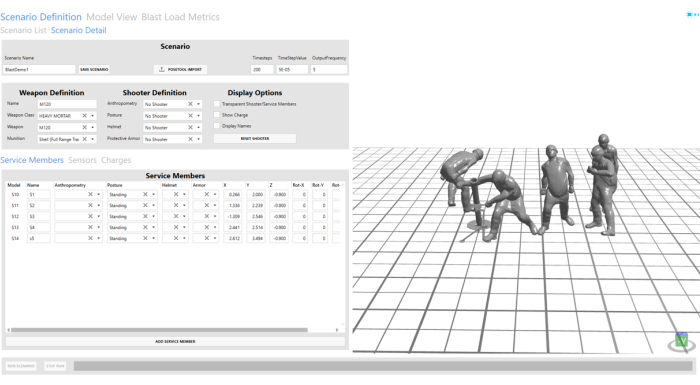

3. 配置武器和射手

- 使用 Scenario Name (方案名称) 下的文本框选择方案的名称。这是用户选择。对于此处讨论的场景,开发人员选择了场景名称 BlastDemo1。

- 在 Weapon Definition 下的 Name 字段下选择一个自定义名称。这同样是用户的选择。对于此处讨论的场景,开发人员选择了武器名称 120Mortar。

- 从下拉菜单的选项列表中选择适当的武器类别,例如 HEAVY MORTAR。

- 从下拉列表中的选项列表中选择武器(在本例中为 M120)。选择武器系统后,相应的爆炸内核将自动加载到 Charges 子选项卡下的 GUI 中。

注意:下拉菜单将包含特定于上面选择的武器类别的不同可能武器系统。 - 使用下拉选项为所选武器系统选择 弹药壳(全范围训练轮)。

- 从下拉选项中选择 Anthropometry, Posture, Helmet, 和 Protective armor 字段下的 Shooter Definition。有关配置的射手和服务成员,请参见 图 3 。

注意:由于拍摄器将包含在通过步骤 4 导入的场景中,因此在 Shooter Definition 下未选择任何拍摄器。

图 3:从图像数据导入的爆炸现场。 爆炸场景在 GUI 工具右侧的可视化窗口中可见。 请单击此处查看此图的较大版本。

4. 配置服务成员

- 单击 Service Members 选项卡。此选项卡控制从图像数据导入的服务成员的位置和方向;使用 X、Y、Z 和旋转选项来执行此操作。对于副炮手对应的头像,笔者将 Y 位置从 2.456 调整为 2,以获得更合理的副炮手位置。

- 使用 Service Members 选项卡下的 Name 字段为导入到 GUI 中的所有虚拟服务成员模型选择自定义名称。此处为所有自动导入的服务成员模型选择 S1、S2、S3、S4 和 S5。

注意:对于此处讨论的方案,它们被命名为 S1 和 S2。其他字段将自动填充。用户可以修改它们以优化自动估计的位置/姿势。 - 使用 Delete (删除 ) 按钮删除 S2、S4 和 S5。在此处演示的场景中,射击时只有射手和助理炮手在场。

注意:执行此操作是为了演示自定义用户选项,以便根据需要删除或添加服务人员模型到现有场景。

5. 配置虚拟传感器

- 导航到 传感器 选项卡。通过单击 Add Sensor 添加新的虚拟传感器。

- 在 Name (名称) 字段下选择自定义名称。开发人员在本文中选择了 V1 进行演示。

- 通过单击下面的 Drop-down 传感器类型 字段。

- 通过编辑 X、Y 和 Z 字段下的文本框,选择要为 (-0.5, 2, 0.545) 的传感器位置。对于此处讨论的场景,开发人员在 4 个不同的位置创建了 4 个不同的传感器,用于演示目的。开发人员选择了 V2、V3 和 V4 作为其他传感器的传感器名称。

- 重复 5.1 到 5.4 的步骤,在 (-0.5, 1, 0.545)、(-0.5, 0.5, 0.545) 和 (-0.5, 0, 0.545) 处创建其他传感器。将 Rotation (旋转) 值保留为零。

注意:用户还可以选择平面传感器,在此期间,旋转可用于调整传感器相对于爆炸装药的方向。

6. 保存并运行程序

- 通过单击顶部 GUI 中的 Save Scenario 按钮来保存武器训练场景。

- 通过单击底部的 Run Scenario (运行场景) 按钮,运行 M120 武器训练场景的爆炸超压模拟。模拟进度使用底部的进度条显示。

7. 可视化结果

- 导航到 Model View 选项卡以检查爆炸超压暴露模拟。

- 单击 Current 按钮,将已完成的模拟加载到可视化窗口中。

- 加载模拟后,使用屏幕底部的 Play 按钮可视化模拟。

- 用户可以在导航栏中的不同选项之间进行选择,以不同的速度播放和暂停模拟。下面的播放控件的屏幕截图显示了更多选项。用户可以使用鼠标控制交互窗口。右键单击并拖动可旋转模式,左键可平移模型,中键可滚动/向内/向外滚动。

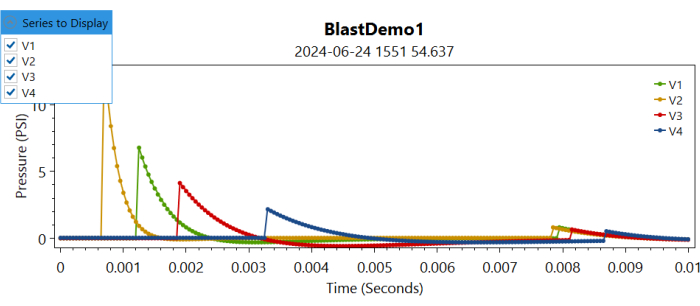

- 查看模拟后,单击导航到 Blast Load Metrics 选项卡。

- 单击 当前 按钮,在虚拟传感器位置加载超压图。

注意:这将在不同绘图的不同传感器位置加载超压信息。 - 导航到下拉列表 Series to Display 并选中 相应传感器的框 进行选择,以绘制该虚拟传感器记录的超压(参见 图 4)。

图 4:绘制不同虚拟传感器的超压控制随时间的变化。 用户可以通过选中或取消选中不同的传感器来选择要显示的系列。 请单击此处查看此图的较大版本。

结果

自动重建虚拟服务成员和爆炸现场

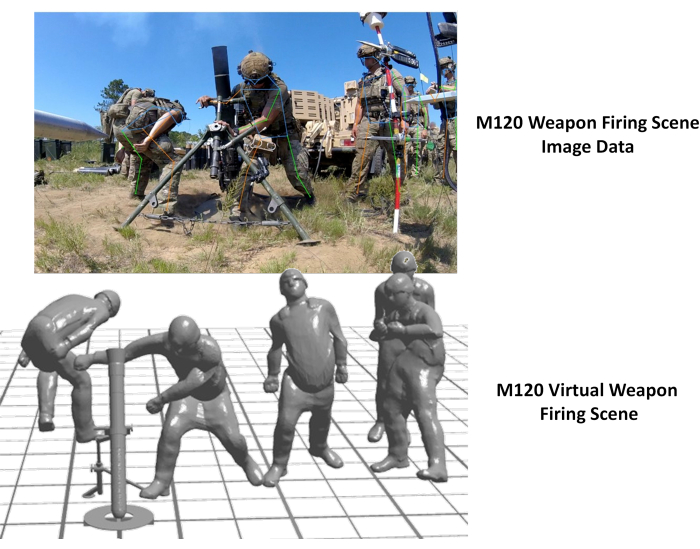

通过 BOP Tool 自动化功能实现了自动化虚拟军人身体模型和武器训练场景模型生成。 图 5 显示了从图像数据生成的虚拟训练场景。从这里可以看出,生成的场景很好地表示了图像数据。 图 5 中用于演示的图像来自 Wikimedia Commons。

图 5:来自图像数据的虚拟武器训练场景。 左侧图片显示了 AT4 武器射击对应的图像数据,右侧显示了虚拟自动生成的武器训练场景。此数字来自 Wikimedia Commons。 请单击此处查看此图的较大版本。

此外,该方法还用于重建 M120 武器射击场景。该图像由 WRAIR 收集,作为 M120 迫击炮武器压力数据收集工作的一部分。下面的 图 6 与原始图像一起展示了重建的虚拟武器射击场景。在虚拟重建中观察到助理炮手的位置存在差异。这可以通过使用 BOP GUI 用户选项调整辅助炮手的位置来纠正。此外,教练的骨盆姿势似乎不准确,可能是由于图像中的木桩阻碍了。将这种方法与其他深度成像模式相结合将有助于解决这些差异。

图 6:来自图像数据的虚拟武器训练场景。 左侧图片显示了 M120 武器射击对应的图像数据,右侧显示了自动生成的虚拟武器训练场景。 请单击此处查看此图的较大版本。

验证自动场景生成方法

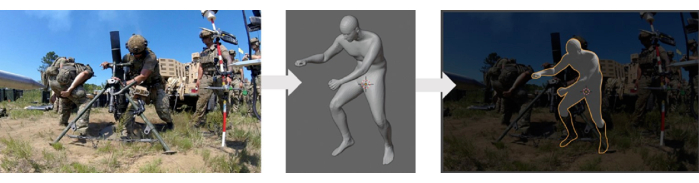

本研究中使用的人体模型生成器使用 ANSUR II 人体扫描数据库14 进行了验证,其中包括来自医学成像数据的人体测量。利用这种人体模型生成器的自动重建方法用手头的数据进行了定性验证。该验证过程包括通过叠加重建模型与实验数据(图像)进行比较。 图 7 显示了 3D 虚拟形象模型与实验数据之间的比较。但是,有必要对这种方法进行更彻底的验证,这将需要来自现场的额外实验数据,包括参与训练场景的不同服役人员的精确位置、姿势和方向。

图 7:与图像生成的虚拟人体模型的定性比较。 左侧面板显示原始图像,中间面板显示生成的虚拟体模型,右侧面板显示与原始图像重叠的虚拟模型。 请单击此处查看此图的较大版本。

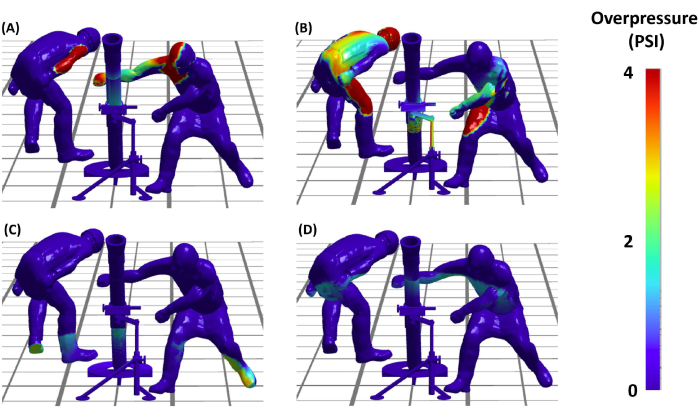

代表性爆破超压模拟

设置爆炸现场后,作者能够进入运行爆炸超压 (BOP) 模拟的关键阶段。这将使我们能够了解武器射击场景中涉及的不同军人的爆炸载荷分布。 图 8 显示了 AT4 武器射击事件期间这些 BOP 模拟的结果。模拟提供了随时间变化的不同时刻场景中虚拟军人身上的超压载荷的详细可视化。总之,结果不仅证明了该协议在创建准确且分析有用的武器训练场景重建方面的可行性,而且证明了该协议的有效性,从而为军事训练安全性和效率方面的更高级研究铺平了道路。

图 8:射手身上的爆炸超压暴露。 (A、B、C 和 D)这四个面板显示了模型在不同时刻预测参与 M120 迫击炮射击的虚拟军人爆炸超压。面板 (C) 和 (D) 显示了由于接地反射引起的超压传播。 请单击此处查看此图的较大版本。

讨论

与以前使用的使用视觉评估的手动方法相比,本文提出的计算框架显着加快了爆炸武器训练场景的生成。这种方法证明了该框架快速捕捉和重建各种军事姿态的能力。

当前方法的优点

创建特定姿势和位置的虚拟人体模型是一项具有挑战性的任务,可用于此目的的工具有限。传统方法中采用的传统方法,特别是 BOP 工具,使用 CoBi-DYN 14,15,16,17。这种方法涉及手动创建包含服装、头盔、防护盔甲和靴子的虚拟人体模型。这些模型是通过近似视觉近似生成的,缺乏系统的方法。在旧版 BOP 工具中,CoBi-DYN 用于创建人体模型数据库,该数据库可在 场景配置 步骤中访问。用户将手动选择一个近似的姿势配置,并针对特定武器系统进行大致定位,以运行 BOP 场景。尽管从现有服务成员数据库(从 BOP 工具的下拉菜单访问)重建爆炸现场相对较快,但虚拟服务成员模型数据库的初始创建非常耗时,由于该过程的手动和近似性质,每个场景大约需要 16-24 小时。相比之下,新方法利用成熟的姿势估计工具来更自动化、更快速地创建虚拟人体模型。这些工具自动利用视频和图像数据,使用虚拟服务成员头像快速重建爆炸现场。这大大减少了创建人体数据库所需的时间。这种新颖的方法只需单击一下按钮,即可从成像数据生成或重建完整的虚拟场景,而无需额外的软件。现在,每个场景的整个过程大约需要 5-6 秒(读取图像数据后,如视频中所示),与传统方法相比,效率有了显著提高。这种方法并不是为了取代原来的方法,而是通过加快虚拟服务成员模型的生成来补充它(将来可以添加到服务成员身体模型数据库中)。它简化了具有不同复杂性的新配置的添加,并促进了未来新武器系统的集成,从而增强了 BOP 工具的可扩展性。与传统方法相比,很明显,所提出的方法提供了一种更加简化和自动化的解决方案,减少了手动工作和时间,同时提高了虚拟人体模型创建的准确性和系统性。这突出了所描述的方法在该领域的优势和创新。

验证自动场景生成

通过将重建的场景叠加在图像数据上,对该方法进行了定性验证。然而,由于缺乏有关这些图像的定位和姿势的可用数据,定量验证是不可行的。作者认识到更彻底验证的重要性,并计划在未来的工作中解决这个问题。为了实现这一目标,作者设想了全面的数据收集工作,以获得精确的定位和姿势信息。这将使我们能够进行详细的定量验证,最终提高方法的稳健性和准确性。

Blast 暴露模拟的验证

武器爆炸内核是使用武器射击期间收集的铅笔探针数据开发和验证的。有关武器爆炸内核和相关曝光的更多详细信息将包含在即将发布的出版物中。这方面的一些信息也可以在过去的出版物11,12 中找到。这项持续的努力将有助于提高爆炸超压模拟的精度和有效性,从而增强该工具的有效性。

这里介绍的方法也可用于生成服役人员的虚拟形象,随后可以使用 BOP 工具将其合并到数据库中以供选择。尽管当前过程不会自动将模型保存到数据库中,但作者计划在 BOP 工具的未来版本中包含此功能。此外,作者拥有内部工具,一旦从图像数据生成自动姿势和 3D 模型,就可以手动修改姿势。目前,此功能独立存在,未集成到 BOP 工具中,因为需要在用户界面上进行进一步开发。尽管如此,这是一项正在进行的工作,作者打算将其整合到 BOP 工具的未来版本中。

爆炸载荷数据也可以以 ASCII 文本文件的形式导出,并且可以应用进一步的后处理步骤来更详细地研究不同武器系统的爆炸剂量模式。目前,正在努力开发用于输出指标(如冲量、强度等)的高级后处理工具,这些工具可以帮助用户理解和研究这些场景中更复杂的重复爆炸载荷。此外,这些工具专为提高计算效率而开发,可实现快速的仿真速度。因此,这些工具允许我们运行逆向优化研究,以确定武器射击场景中的最佳姿势和位置。这些改进增强了该工具在不同武器训练靶场中优化训练方案的适用性。爆炸剂量估计还可用于为不同的脆弱解剖区域(如大脑、肺等)开发更精细的高分辨率宏观计算模型 18,19,20 和微观损伤模型 20,21。在这里,模型中的头盔和盔甲仅用于视觉表示,不会影响这些仿真中的爆炸剂量。这是因为这些模型被视为刚性结构,这意味着它们的包含不会改变或影响爆炸超压模拟的结果。

本文利用现有的开源姿态估计工具来估计武器训练场景中的人体姿态。请注意,此处开发和讨论的框架与工具无关,即,随着更多进步的取得,作者可以用新工具替换现有工具。总体而言,测试表明,虽然现代软件工具非常强大,但基于图像的姿势检测是一项具有挑战性的任务。但是,有几条建议可用于增强姿势检测性能。当感兴趣的人在摄像机的清晰视野中时,这些工具的性能最佳。虽然在武器训练演习中并不总是可以做到这一点,但在放置摄像头时考虑这一点可以改善姿势检测结果。此外,进行训练演习的军人经常穿着迷彩服,与周围环境融为一体。这使得它们更难被人眼和机器学习 (ML) 算法检测到。存在增强 ML 算法检测穿着 camouflage23 的人类的能力的方法,但这些方法的实现并非易事。在可能的情况下,在具有高对比度背景的位置收集武器训练的图像可以改进姿势检测。

此外,从图像中估计 3D 量的传统方法是使用具有多个相机角度的摄影测量技术。从多个角度录制图像/视频也可用于改进姿势估计。融合来自多个相机的姿态估计相对简单24.另一种可以改善结果的摄影测量技术是使用棋盘或其他已知尺寸的对象作为每个照相机的公共参考点。使用多台摄像机的一个挑战是使它们进行时间同步。可以开发经过定制训练的机器学习模型来检测头盔而不是面部等特征,或者检测穿着军用特定服装和设备(例如靴子、背心、防弹衣)的人。现有的姿态估计工具可以使用自定义训练的 ML 模型进行增强。虽然这既耗时又乏味,但它可以显著提高姿态估计模型的性能。

总之,本文有效地概述了增强型爆破超压框架的各个组成部分。在这里,作者还认识到通过更无缝的整合和完全自动化管道来提高其适用性和有效性的潜力。使用 AMG 工具生成缩放的 3D 体网格等元素正在自动化过程中,以减少用户手动输入。目前,正在努力将这些功能集成到 BOP 工具 SCENE 模块中。随着这项技术的发展,所有国防部利益相关者和实验室都将可以使用它。此外,正在进行的工作包括为其他武器系统表征和验证武器内核。这种对改进和验证方法的持续努力确保了作者开发的工具始终处于技术进步的最前沿,为军事训练演习的安全性和有效性做出了重大贡献。未来的出版物将提供有关这些发展的更多详细信息,为更广泛的军事训练和安全领域做出贡献。

披露声明

作者没有什么可披露的。

致谢

该研究由国防部爆炸伤害研究协调办公室资助,隶属于 MTEC 项目 MTEC-22-02-MPAI-082。作者还感谢 Hamid Gharahi 对武器爆炸内核的贡献,以及 Zhijian J Chen 为开发武器发射爆炸超压模拟建模功能的贡献。本演示文稿中表达的观点、意见和/或调查结果是作者的观点、意见和/或调查结果,不反映陆军部或国防部的官方政策或立场。

材料

| Name | Company | Catalog Number | Comments |

| Anthropometric Model Generator (AMG) | CFD Research | N/A | For generting 3D human body models with different anthropometric characteristics. The tool is DoD Open Source. |

| BOP Tool | CFD Research | N/A | For setting up blast scenes and overpressure simulations. The tool is DoD open source. |

| BOP Tool SCENE Module | CFD Research | N/A | For setting up blast scenes and overpressure simulations. The tool is DoD open source. |

| Mediapipe | Version 0.9 | Open-source pose estimation library. | |

| MMPose | OpenMMLab | Version 1.2 | Open-source pose estimation library. |

| OpenSim | Stanford University | Version 4.4 | Open-source musculoskeletal modeling and simulation platform. |

| Python 3 | Anaconda Inc | Version 3.8 | The open source Individual Edition containing Python 3.8 and preinstalled packages to perform video processing and connecting the pose estimation tools. |

参考文献

- LaValle, C. R., et al. Neurocognitive performance deficits related to immediate and acute blast overpressure exposure. Front Neurol. 10, (2019).

- Kamimori, G. H., et al. Longitudinal investigation of neurotrauma serum biomarkers, behavioral characterization, and brain imaging in soldiers following repeated low-level blast exposure (New Zealand Breacher Study). Military Med. 183 (suppl_1), 28-33 (2018).

- Wang, Z., et al. Acute and chronic molecular signatures and associated symptoms of blast exposure in military breachers. J Neurotrauma. 37 (10), 1221-1232 (2020).

- Gill, J., et al. Moderate blast exposure results in increased IL-6 and TNFα in peripheral blood. Brain Behavior Immunity. 65, 90-94 (2017).

- Carr, W., et al. Ubiquitin carboxy-terminal hydrolase-L1 as a serum neurotrauma biomarker for exposure to occupational low-Level blast. Front Neurol. 6, (2015).

- Boutté, A. M., et al. Brain-related proteins as serum biomarkers of acute, subconcussive blast overpressure exposure: A cohort study of military personnel. PLoS One. 14 (8), e0221036(2019).

- Skotak, M., et al. Occupational blast wave exposure during multiday 0.50 caliber rifle course. Front Neurol. 10, (2019).

- Kamimori, G. H., Reilly, L. A., LaValle, C. R., Silva, U. B. O. D. Occupational overpressure exposure of breachers and military personnel. Shock Waves. 27 (6), 837-847 (2017).

- Misistia, A., et al. Sensor orientation and other factors which increase the blast overpressure reporting errors. PLoS One. 15 (10), e0240262(2020).

- National Defense Authorization Act for Fiscal Year 2020. Wikipedia. , https://en.wikipedia.org/w/index.php?title=National_Defense_Authorization_Act_for_Fiscal_Year_2020&oldid=1183832580 (2023).

- Przekwas, A., et al. Fast-running tools for personalized monitoring of blast exposure in military training and operations. Military Med. 186 (Supplement_1), 529-536 (2021).

- Spencer, R. W., et al. Fiscal year 2018 National Defense Authorization Act, Section 734, Weapon systems line of inquiry: Overview and blast overpressure tool-A module for human body blast wave exposure for safer weapons training. Military Med. 188 (Supplement_6), 536-544 (2023).

- Delp, S. L., et al. OpenSim: open-source software to create and analyze dynamic simulations of movement. IEEE Trans Biomed Eng. 54 (11), 1940-1950 (2007).

- Zhou, X., Sun, K., Roos, P. E., Li, P., Corner, B. Anthropometry model generation based on ANSUR II database. Int J Digital Human. 1 (4), 321(2016).

- Zhou, X., Przekwas, A. A fast and robust whole-body control algorithm for running. Int J Human Factors Modell Simulat. 2 (1-2), 127-148 (2011).

- Zhou, X., Whitley, P., Przekwas, A. A musculoskeletal fatigue model for prediction of aviator neck manoeuvring loadings. Int J Human Factors Modell Simulat. 4 (3-4), 191-219 (2014).

- Roos, P. E., Vasavada, A., Zheng, L., Zhou, X. Neck musculoskeletal model generation through anthropometric scaling. PLoS One. 15 (1), e0219954(2020).

- Garimella, H. T., Kraft, R. H. Modeling the mechanics of axonal fiber tracts using the embedded finite element method. Int J Numer Method Biomed Eng. 33 (5), (2017).

- Garimella, H. T., Kraft, R. H., Przekwas, A. J. Do blast induced skull flexures result in axonal deformation. PLoS One. 13 (3), e0190881(2018).

- Przekwas, A., et al. Biomechanics of blast TBI with time-resolved consecutive primary, secondary, and tertiary loads. Military Med. 184 (Suppl 1), 195-205 (2019).

- Gharahi, H., Garimella, H. T., Chen, Z. J., Gupta, R. K., Przekwas, A. Mathematical model of mechanobiology of acute and repeated synaptic injury and systemic biomarker kinetics. Front Cell Neurosci. 17, 1007062(2023).

- Przekwas, A., Somayaji, M. R., Gupta, R. K. Synaptic mechanisms of blast-induced brain injury. Front Neurol. 7, 2(2016).

- Liu, Y., Wang, C., Zhou, Y. Camouflaged people detection based on a semi-supervised search identification network. Def Technol. 21, 176-183 (2023).

- Batpurev, T. Real time 3D body pose estimation using MediaPipe. , Available from: https://temugeb.github.io/python/computer_vision/2021/09/14/bodypose3d.html (2021).

转载和许可

请求许可使用此 JoVE 文章的文本或图形

请求许可探索更多文章

This article has been published

Video Coming Soon

版权所属 © 2025 MyJoVE 公司版权所有,本公司不涉及任何医疗业务和医疗服务。